Hvad er en AI-detektionsfjerner, og hvordan fungerer den?

Opdag hvad en AI-detektionsfjerner er, og hvordan den hjælper dig med at komme forbi AI-detektorer. Lær om teknologien, etisk brug, og hvordan du vælger det rigtige værktøj.

Så hvad er en AI-detektionsfjerner egentlig? Tænk på den som en specialiseret editor til AI-genereret tekst. Disse værktøjer tager indhold, der lyder lidt stift eller robotagtigt, og omskriver det, så det flyder naturligt – og dermed glider det problemfrit forbi den AI-detektionssoftware, der bliver mere og mere udbredt hver dag.

Hvis du bruger AI til at hjælpe med dit skriveri, er et værktøj som dette praktisk talt et must-have. Det hjælper dig med at forfine de maskinproducerede førstudkast til engagerende, poleret indhold, der ikke bliver markeret. Du kunne for eksempel tage et AI-genereret afsnit til en marketing-e-mail, køre det gennem værktøjet og få en version tilbage, der lyder varmere og mere overbevisende – klar til at sende til dine kunder.

Den nye udfordring med AI-indholdsdetektering

Internettet er oversvømmet med indhold lige nu, og en kæmpe del af det kommer fra kraftfulde AI-værktøjer, der gør det næsten ubesværet at skrive artikler, essays og rapporter. Denne eksplosion i AI-drevet indholdsskabelse har sat gang i en helt ny udfordring: at skelne mellem hvad et menneske har skrevet, og hvad en maskine har genereret.

Denne massive tilstrømning har udløst et digitalt kat-og-mus-spil. For at håndtere bølgen af automatiseret tekst har søgemaskiner, universiteter og store indholdsplatforme rullet sofistikerede AI-detektorer ud. Disse systemer er trænet til at spotte de subtile, afslørende tegn på AI – de forudsigelige sætningsstrukturer, manglen på en unik stemme – og markere alt, der ikke føles helt menneskeligt.

Problemet for moderne skabere

Dette skaber en reel hovedpine for mange mennesker. Marketingfolk, studerende og skribenter, der er afhængige af AI for at arbejde hurtigere, risikerer nu at blive straffet. Deres arbejde, selv hvis det er velresearchet og oprigtigt værdifuldt, kan blive nedrangeret eller stillet spørgsmålstegn ved, blot fordi AI gav en hånd med i udkastprocessen.

Omfanget er overvældende. Inden 2025 forudser nogle analytikere, at 30–40% af al tekst på nettet vil stamme fra AI-systemer. Andre fremskrivninger er endnu mere dristige og antyder, at tallet kan nå 90% inden årets udgang.

Det er præcis her, en AI-detektionsfjerner bliver en uundværlig del af den moderne skribenters værktøjskasse. Det handler ikke om snyd eller uærlighed. Det handler om at tage et solidt AI-genereret udkast og polere det, indtil det lyder autentisk og menneskeligt.

Forfine, ikke bedrage

Målet er simpelt: at bevare din egen stemme og sikre, at dit arbejde bedømmes på sine idéer, ikke sin oprindelse. Denne proces lader dig beholde hastigheden og effektiviteten fra AI uden at ofre kvaliteten og autenticiteten af det endelige produkt.

Ved at gøre AI-tekst uopdagelig kan du undgå uretfærdige straffe og stadig producere fremragende arbejde. Målet er at:

- Forbedre læsbarheden: Forvandle kluntede, robotagtige sætninger til prosa, der flyder jævnt og naturligt. For eksempel: Ændre "Anvendelsen af denne metodologi resulterer i en forøgelse af effektiviteten" til "Brugen af denne metode gør tingene mere effektive."

- Bevare originaliteten: Holde kernbudskabet og idéerne i dit udkast intakte, mens du løfter måden de præsenteres på. Værktøjet bør ændre stilen, ikke substansen.

- Undgå straffe: Sikre, at dit indhold får grønt lys fra detektorer brugt af platforme som Google eller akademiske institutioner.

I sidste ende bygger disse værktøjer bro mellem maskineffektivitet og menneskelig kreativitet. De hjælper med at sikre, at dit endelige resultat ikke bare er effektivt, men virkelig autentisk.

Hvordan AI-detektorer spotter maskinskrevet tekst

For at få mest muligt ud af en AI-detektionsfjerner skal du først vide, hvad du er oppe imod. Tænk på en AI-detektor som en lingvistisk detektiv, men i stedet for at lede efter fingeraftryk scanner den efter de subtile, næsten usynlige spor af en maskine. Den leder ikke efter ét enkelt afsløring, men et helt mønster af robotagtige træk.

Disse digitale spørhunde er trænet på kolossale datasæt pakket med millioner af eksempler på både menneskeligt og AI-genereret skrivearbejde. Dette dybe dyk i data, herunder en forståelse af GPT og Transformer-mekanismer, lærer dem at spotte statistiske mønstre, som selv en erfaren redaktør ville overse.

De afslørende tegn på AI-tekst

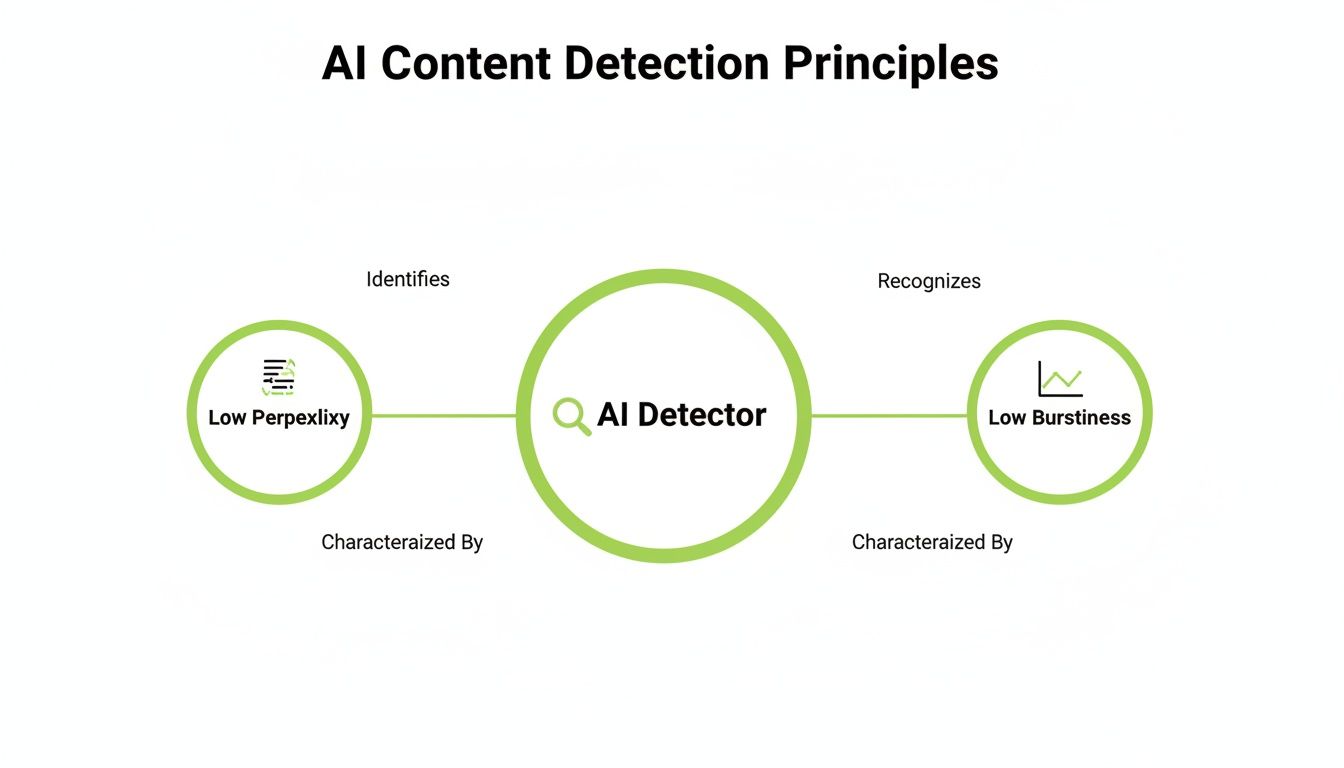

Når en AI-detektor scanner et stykke indhold, kigger den primært på to nøglemetrikker: perpleksitet og burstiness. Det lyder måske som højteknologisk jargon, men det er faktisk simple koncepter. At forstå dem er det første skridt mod at skabe indhold, der flyver under radaren.

- Perpleksitet (Forudsigelighed): Det er bare en flot måde at måle, hvor forudsigelig din tekst er. AI-modeller er designet til at vælge det statistisk mest sandsynlige ord efter det foregående. Det skaber tekst, der er grammatisk perfekt, men ofte føles flad, kedelig og lidt for simpel. Den mangler overraskelse.

- Burstiness (Rytme og flow): Dette måler den naturlige variation i sætningsstruktur. En menneskelig skribent kan lave en lang, snørklet sætning for at udforske en kompleks tanke og derefter følge den op med en kort, skarp sætning for at understrege en pointe. Det skaber en dynamisk, "burstig" rytme.

AI-genereret tekst rammer ofte ved siden af denne naturlige kadence. Dens sætninger har tendens til at være ensartede i længde og struktur, hvilket skaber en monoton, næsten hypnotisk rytme, som detektorer er trænet til at fange. Det er forskellen mellem et håndlavet træbord med unikke ådremønstre og et perfekt glat, maskinformet stykke plastik.

Menneskelig skrivning er i sagens natur varieret. Den har ebbe og flod, med en blanding af enkle og komplekse sætninger. AI-tekst mister ofte denne rytme og vælger en konsistent, ensartet struktur, der føles unaturligt perfekt.

Praktiske eksempler på AI-afsløringer

Lad os gøre det konkret. En AI kunne generere noget som dette: "Hunden løb over marken. Hunden var meget hurtig. Hunden nød løbeturen." Læg mærke til, hvordan sætningerne er enkle, repetitive og totalt forudsigelige. Det er et klassisk eksempel på lav perpleksitet og lav burstiness.

En menneskelig skribent kunne male det samme billede med mere burstiness: "Sluppet løs fløj den gyldne retriever over den åbne mark, en sløring af pels og uhæmmet glæde. Sikke en sprint!" Sætningslængderne er forskellige, ordforrådet er rigere, og det hele føles simpelthen mere autentisk. En AI-detektionsfjerner sigter mod at udføre præcis denne type transformation automatisk.

At forstå disse kerneprincipper er altafgørende. En god AI-detektionsfjerner udskifter ikke bare et par ord her og der. Den omskriver fundamentalt teksten for at indsprøjte den naturlige perpleksitet og burstiness, som detektorer leder efter. Du kan lære mere om denne proces og opdage om uopdagelig AI virkelig virker i vores detaljerede guide. Denne viden er din nøgle til at forvandle robotagtige udkast til indhold, der virkelig forbinder med mennesker.

Teknologien bag en AI-detektionsfjerner

Så hvordan udfører et værktøj som dette egentlig tryllekunsten med at gøre AI-tekst usynlig for detektorer? Det er ikke bare en fancy synonymordbog, der udskifter ord. Tænk på det mindre som en simpel parafraseværktøj og mere som en dygtig digital håndværker, der tager et robotagtigt udkast og omhyggeligt omformer det med et menneskeligt touch.

Disse værktøjer er bygget på sofistikerede sprogmodeller, der er fodret med en enorm mængde ægte menneskelig tekst – millioner af artikler, essays og rapporter. I stedet for bare at ændre ord, re-konstruerer de teksten fuldstændigt fra bunden. De analyserer alt fra sætningsstruktur og ordforråd til den overordnede rytme og jager efter de afslørende mønstre, som AI-detektorer er bygget til at opfange.

Slette de digitale fingeraftryk

Hovedmålet er at øge tekstens perpleksitet og burstiness – de to nøglemetrikker, vi talte om tidligere. AI-tekst har tendens til at være meget forudsigelig og ensartet. Ved at variere sætningslængder, introducere mere komplekse strukturer og bruge mindre almindelige ordvalg, bryder værktøjet den monotone konsistens.

Praktisk tip: Før du humaniserer en tekst, prøv at læse den højt. Hvis den lyder monoton eller mangler en naturlig rytme, har den lav burstiness. En god humanizer vil fikse dette ved at variere sætningslængde og -struktur. For eksempel kan den kombinere to korte sætninger til en kompleks sætning eller bryde en lang sætning op i kortere, mere slagkraftige fraser.

Som du kan se, er kombinationen af lav perpleksitet og lav burstiness det klassiske visitkort for AI-genereret indhold, der skaber et tydeligt signal, som detektorer er trænet til at fange.

Hele denne proces handler ikke bare om at få teksten til at lyde bedre. Det handler om metodisk at slette de statistiske "afslørninger", der skriger: "en maskine har skrevet dette!" Værktøjet forvandler et udkast, der måske er grammatisk perfekt, men helt sjælløst, til noget der læses, som om det var skrevet af et menneske fra starten – alt imens den originale mening og idéer bevares.

Hvordan avancerede humanizers klarer det

De bedste værktøjer tager et kæmpe skridt videre ved at bygge på enorme, højkvalitets datasæt. En førsteklasses AI-detektionsfjerner bruger avanceret lingvistisk modellering til at skabe tekst, der lyder virkelig naturlig.

En AI-detektionsfjerner som HumanText.pro konverterer AI-udkast til menneskelignende tekst, der kommer forbi detektorer som GPTZero og Turnitin med 99% succesrate. Dette er muligt, fordi dens modeller er trænet på 1,2 millioner menneskelige skriveprøver for at garantere autenticitet.

Denne type dybdegående træning gør det muligt for værktøjet at producere uopdagelige essays, blogs og andre professionelle dokumenter. Det beskytter også brugernes privatliv ved ikke at gemme noget indhold og tilbyder øjeblikkelige prøveversioner til at teste det. Du kan dykke dybere ned i de bredere branchetrends med disse statistikker og resultater om kunstig intelligens.

Ved at fokusere på disse dybe strukturelle og stilistiske ændringer tilbyder en AI-humanizer en solid løsning for alle, der har brug for at polere deres AI-assisterede arbejde til noget uopdageligt. Det er den essentielle bro mellem maskineffektivitet og autentisk menneskelig udtryk.

Brug af AI-detektionsfjernere etisk og effektivt

Lad os slå én ting fast: en AI-detektionsfjerner er ikke en tryllestav til akademisk uærlighed. At tænke sådan om det misser fuldstændigt pointen. Se det i stedet som et finish-værktøj – en polerer for indhold, der starter med AI, men ender med menneskelig indsigt og kreativitet.

Etikken ved at bruge en humanizer koger helt ned til din hensigt. Prøver du at udgive et rå, uredigeret AI-udkast som dit eget geniale værk? Det er et problem. Eller bruger du det til at forfine et AI-assisteret udkast, glatte det robotagtige sprog ud, så dine egne idéer kan skinne igennem? Det er bare en smart arbejdsgang.

Praktisk tip: Den mest etiske arbejdsgang er en hybrid. Brug AI til de første 70% (research, skitsering, udkast), og brug derefter en humanizer til de næste 20% (sproglig polering). De sidste 10% bør altid være din egen gennemgang – faktatjek, tilføjelse af personlige anekdoter og sikring af, at tonen matcher dit brand eller din akademiske stemme.

Virkelige scenarier for etisk brug

Så hvordan ser det ud i praksis? Det handler ikke om snyd; det handler om at overvinde virkelige flaskehalse uden at ofre kvalitet. Nøglen er altid at tilføje din egen værdi, ikke at omgå arbejdet.

Her er et par almindelige, ansvarlige måder folk bruger disse værktøjer på:

For indholdsmarketingfolk: Et marketingteam har et ambitiøst mål: udgive 10 høj-kvalitets blogindlæg om ugen for at drive deres SEO-strategi. De bruger AI til at generere første udkast ud fra detaljerede briefinger og sparer derved hundredvis af timer. Derefter bruger de en humanizer til at polere sproget, gøre det mere engagerende og sikre, at det ikke bliver markeret af spamfiltre. De kan skalere produktionen uden at lyde som robotter.

For studerende: En historiestuderende arbejder med et komplekst essay. De bruger AI til at lave en grundlæggende skitse og organisere deres research. Efter selv at have skrevet det fulde essay kører de det gennem en humanizer for at udjævne klodsede formuleringer og forbedre det overordnede flow. Det hjælper deres unikke analyse med at komme tydeligt igennem, idet værktøjet fungerer som en sofistikeret korrekturlæser snarere end en ghostwriter.

At bruge en AI-detektionsfjerner ansvarligt handler om at bygge bro mellem maskineffektivitet og menneskelig kreativitet. Det giver dig mulighed for at forfine AI-genereret indhold til et slutprodukt, der er poleret, autentisk og tilfører ægte værdi.

Professionelle der polerer deres kommunikation

Behovet for et menneskeligt touch rækker langt ud over indholdsteams og klasselokaler. For enhver professionel er det daglig rutine at udarbejde rapporter, lave præsentationer eller besvare kundeemails. AI kan lave en skabelon eller et første udkast på sekunder, hvilket sparer enorm tid.

Men at sende en generisk, maskinskrevet e-mail kan skade et kundeforhold. Ved at køre det udkast gennem en AI-detektionsfjerner kan du sikre, at den endelige besked lyder personlig, professionel og autentisk. Det handler om at opretholde en menneskelig forbindelse i en verden, der bevæger sig hurtigere end nogensinde.

At forstå disse anvendelser er det første skridt. Ved at lære hvordan man undgår AI-detektering på ansvarlig vis kan du gøre disse værktøjer til en kraftfuld og etisk del af din arbejdsgang.

Etiske anvendelser af AI-detektionsfjernere på tværs af erhverv

For at gøre det endnu tydeligere, lad os se på, hvordan forskellige professionelle etisk kan udnytte AI-humanizers til at løse almindelige udfordringer, de står over for hver dag.

| Brugerprofil | Almindelig udfordring | Etisk løsning med en AI-detektionsfjerner |

|---|---|---|

| SEO-specialist | Skal producere store mængder unikt, høj-kvalitets indhold, der rangerer godt og undgår søgemaskinestraffe for "uhjælpsom" AI-tekst. | Genererer søgeordsoptimerede udkast med AI og bruger derefter en humanizer til at forfine syntaks og flow, så den endelige artikel er engagerende og værdifuld for læserne. |

| Ikke-engelsktalende | Har fremragende idéer, men kæmper med naturlige formuleringer og idiomatiske udtryk, hvilket fører til tekst, der lyder stiv eller "fremmed." | Skriver indholdet først selv og bruger derefter en AI-humanizer som et avanceret sprogværktøj til at polere teksten, så den lyder mere flydende og naturlig. |

| Freelanceskribent | Har stramme deadlines og skal maksimere effektiviteten for at håndtere flere kunder, uden at skrivestilen bliver repetitiv eller generisk. | Bruger AI til indledende research og udkast, anvender derefter en humanizer for at tilføje stilistisk variation og en unik stemme tilpasset hver kundes brand. |

| Ejer af en lille virksomhed | Jonglerer med alle marketingopgaver og skal hurtigt skabe overbevisende hjemmesidetekst, produktbeskrivelser og opslag på sociale medier. | Laver funktionelle første udkast med en AI-assistent og humaniserer dem derefter for at sikre, at brandets personlighed og stemme kommer autentisk igennem. |

| Akademisk forsker | Skal opsummere komplekse resultater i klart, tilgængeligt sprog til ansøgninger om bevillinger eller publikationer, men finder sin tekst tæt og jargonfyldt. | Kører tekniske udkast gennem en humanizer for at forbedre læsbarheden og flowet, så forskningen bliver mere forståelig for et bredere publikum uden at ændre kernedataene. |

I sidste ende er målet ikke at skjule brugen af AI. Det er at sikre, at det endelige produkt tjener sit menneskelige publikum på den bedst mulige måde. Når det bruges med integritet, er en AI-detektionsfjerner en kraftfuld allieret for klar, effektiv og autentisk kommunikation.

Sådan vælger du en sikker og pålidelig AI-detektionsfjerner

Med så mange værktøjer, der oversvømmer markedet, kan det føles som at navigere i et minefelt at vælge en pålidelig AI-detektionsfjerner. Lad os være klare: ikke alle humanizers er skabt lige. Nogle er bare glorificerede parafraseringsværktøjer, der øjeblikkeligt knækker over for moderne detektorer, mens andre stille og roligt kan kompromittere dit privatliv.

At træffe et informeret valg betyder at se forbi de prangende marketingpåstande. Det rigtige værktøj bør føles som en pålidelig partner, et der glider ind i din arbejdsgang og leverer konsistente, høj-kvalitets resultater hver gang. Det handler om at fokusere på de funktioner, der virkelig betyder noget for ydeevne, sikkerhed og brugervenlighed.

Nøglekriterier for valg af et værktøj

Når du begynder at sammenligne muligheder, brug denne tjekliste til at skære igennem støjen. Disse punkter er ikke til forhandling for alle, der er seriøse omkring at producere autentisk, uopdageligt indhold uden at åbne døren for nye risici.

Et solidt værktøj skal levere på tre kernelofter:

- Succesrate for detektionsomgåelse: Hele pointen med værktøjet er at komme forbi detektorer. Led efter platforme, der er transparente om deres succesrater mod de store navne som GPTZero, Turnitin og Originality.ai. Praktisk tip: Brug en gratis prøveversion, før du forpligter dig. Tag en AI-eksempeltekst, kør den gennem humanizeren, og test derefter outputtet med en gratis AI-detektor for at verificere påstanden.

- Betydningsbevarelse: Hvad nytter uopdagelig tekst, hvis den ødelægger dit originale budskab? Et virkelig effektivt værktøj skal omskrive indhold uden at ændre kernebetydningen. Test det med noget nuanceret. Hvis det spytter grammatiske fejl ud eller forvrænger dit argument, er det ikke det rigtige for dig.

- Privatliv og datasikkerhed: Det er en stor ting, der ofte overses. En troværdig udbyder har en krystalklar privatlivspolitik, der fastslår, at dit indhold aldrig gemmes eller bruges til træningsdata. Hvis en tjeneste er vag omkring, hvordan den håndterer din tekst, gå videre.

Vurdering af brugervenlighed og funktioner

Ud over disse kernekriterier, tænk over den faktiske oplevelse af at bruge værktøjet. En klodset, kompliceret brugerflade bremser dig bare og modvirker fuldstændigt formålet med at bruge AI for at være mere effektiv. Led efter et rent, intuitivt design, der gør humaniseringsprocessen hurtig og smertefri.

Det er også værd at bemærke den bredere kontekst her. Den digitale verden kæmper med en bølge af sofistikeret svindel, der afspejler eksplosionen i deepfake-teknologi. For eksempel omgik deepfakes liveness-detektion 704% mere effektivt i 2023, hvilket alvorligt underminerer online tillid. Det understreger bare det voksende behov for autentificeringsteknologier. En pålidelig humanizer hjælper med at sikre, at dit indhold forbliver på den rigtige side af den grænse og beviser sin ægte, menneskecentrerede værdi. Du kan opdage, hvordan deepfakes påvirker digital tillid og se, hvor høje indsatserne er ved at blive.

Dine spørgsmål, besvaret

At kaste sig ud i AI-indholdsverdenen kan føles lidt som Det Vilde Vesten. Det er naturligt at have spørgsmål. Her er klare, ligefremme svar på de mest almindelige ting, folk spørger om vedrørende AI-detektionsfjernere.

Er det lovligt at bruge en AI-detektionsfjerner?

Ja, det er fuldstændigt lovligt at bruge en AI-detektionsfjerner. I bund og grund er disse værktøjer bare sofistikerede parafraseringsværktøjer eller stilredaktører, ligesom en kraftfuld grammatikkontrol. Det virkelige spørgsmål handler ikke om lovlighed – det handler om, hvordan du bruger det.

Tænk over det på denne måde: at bruge en humanizer til at polere dit blogindlæg eller skærpe din marketingtekst er en helt standard og smart praksis. Men når det kommer til skolearbejde, skal du spille efter din institutions regler. De fleste akademiske integritetspolitikker insisterer på, at den endelige aflevering afspejler dine egne idéer og kritiske tænkning, så tjek altid deres retningslinjer først.

Kan humaniseret indhold stadig blive markeret?

Mens de bedste AI-humanizers har utroligt høje succesrater, kan intet værktøj love en 100% garanti, der holder for evigt. AI-detektionsteknologi bliver konstant smartere, og det er et konstant kat-og-mus-spil mellem detektorerne og humanizers.

Når det er sagt, er topværktøjer trænet på massive biblioteker af ægte menneskelig tekst. Det gør dem i stand til at producere tekst, der statistisk set er umulig at skelne fra noget, et menneske ville skrive. Det sænker sandsynligheden for at blive markeret af en nuværende eller fremtidig detektor dramatisk.

Vil en AI-detektionsfjerner ødelægge min oprindelige mening?

En kvalitets AI-detektionsfjerner er bygget fra bunden til at beskytte kernebetydningen, fakta og hensigten i din tekst. Den udskifter ikke bare ord tilfældigt. I stedet omformulerer den intelligent sætninger og diversificerer dit ordforråd for at tilføje det menneskelige touch.

Hele pointen er at forbedre flow og stil uden at ændre substansen. Det er som at give dit udkast til en dygtig redaktør, der polerer din prosa, mens dit originale budskab forbliver fuldstændigt intakt. Dit arbejde forbliver præcist og tro mod din vision.

Klar til at forvandle dine AI-udkast til uopdageligt indhold af menneskelig kvalitet? Prøv HumanText.pro i dag og oplev forskellen selv. https://humantext.pro

Klar til at transformere dit AI-genererede indhold til naturlig, menneskelig skrivning? Humantext.pro forfiner din tekst øjeblikkeligt og sikrer at den læses naturligt mens den omgår AI-detektorer. Prøv vores gratis AI-humaniserer i dag →

Relaterede Artikler

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.