En guide til at bestå AI-detektion og humanisere dit indhold

Opdag hvordan du kan bestå AI-detektion med dokumenterede strategier. Vores guide tilbyder handlingsorienterede teknikker og indsigter til at humanisere dit indhold og komme forbi AI-detektorer.

Hvis du konsekvent vil sejle forbi AI-detektorer, skal du først ind i deres hoveder. Det handler ikke om magi; det handler om at forstå, hvad de er trænet til at spotte: forudsigelighed og ensartethed.

Hemmeligheden er at tage det rene, logiske AI-udkast og rode det lidt til - ligesom et menneske ville gøre. Ved bevidst at variere dine sætningsstrukturer og bytte almindelige ordvalg ud med mere unikke, kan du efterligne den lidt kaotiske, naturlige rytme i menneskelig skrivning. Dette manuelle touch er den mest pålidelige måde, jeg har fundet til at gøre indhold virkelig uopsporeligt.

Forståelse af hvordan AI-detektorer faktisk fungerer

Værktøjer som GPTZero eller Turnitin's AI-detektor læser ikke dit indhold for betydning eller nuancer. De kører en matematisk analyse.

Tænk på dem som statistikere, ikke litteraturkritikere. De er blevet trænet på massive biblioteker af menneskeskrevet tekst og har lært alle vores vidunderlige særheder, rodede vaner og uforudsigelige formuleringer. Når de scanner din artikel, leder de bare efter de afslørende matematiske fingeraftryk fra en maskine.

Der er to store statistiske mønstre, som Large Language Models (LLM'er) efterlader sig. Når du forstår disse signaler, kan du begynde systematisk at demontere dem.

Problemet med lav perpleksitet

Perpleksitet er bare et fancy udtryk for, hvor forudsigelig en række ord er. Menneskelige forfattere er herligt uforudsigelige. Vi bruger mærkelige idiomer, skaber странge metaforer og kombinerer ord på måder, der er teknisk korrekte, men statistisk usandsynlige.

AI-modeller gør det modsatte på egen hånd. De er designet til at vælge det mest statistisk sandsynlige næste ord.

Dette skaber tekst, der føles sikker, logisk og ofte lidt kedelig. For eksempel vil en AI højst sandsynligt følge "Dataene tyder på..." med "...at en ny tilgang er nødvendig." Det er korrekt, men kedeligt. Et menneske ville måske skrive, "Dataene skriger på os om at prøve noget nyt." Denne lave perpleksitet er et enormt rødt flag for enhver detektor.

Nøgle-takeaway: AI-genereret tekst lyder ofte som en strålende elev, der har lært en tesaurus udenad, men har nul livserfaring. Den vælger altid det mest almindelige, "korrekte" ord, hvilket skaber en forudsigelig rytme, som detektorer kan spotte lang vejs fra.

Det afslørende tegn på lav burstiness

Burstiness måler variationen i din sætningslængde og struktur. Tænk på hvordan du taler. Du bruger måske en kort, kontant sætning. Så følger du den måske med en lang, snoet en, der udforsker en mere kompleks idé. Det er høj burstiness.

AI-modeller kæmper ofte med denne naturlige kadence. De har tendens til at producere sætninger af lignende længde og struktur, hvilket skaber et monotont, næsten hypnotisk flow. Denne ensartede rytme er endnu et dødt giveaway, et klart digitalt fingeraftryk, som detektorer er bygget til at finde. Dette er et kritisk område, hvor du kan lære mere om at skabe uopdageligt AI-indhold.

Her er en hurtig gennemgang af, hvad disse detektorer jager, og hvordan du kan slå tilbage.

AI-skrivemønstre og humaniseringsløsninger

| AI-detektionssignal | Hvad det betyder i praksis | Din menneskelige løsning |

|---|---|---|

| Lav perpleksitet | Teksten bruger meget almindelige og forudsigelige ordsekvenser. Tænk "afslutningsvis," "det er vigtigt at bemærke," osv. | Byt almindelige ord ud med mere interessante synonymer. Introducér idiomer, analogier eller personlige anekdoter. Omformulér sætninger til at være mindre direkte. |

| Lav burstiness | Sætninger er alle nogenlunde samme længde og følger lignende grammatiske mønstre (f.eks. Subjekt-Verbum-Objekt igen og igen). | Bland aktivt korte, kontante sætninger med længere, mere komplekse. Brug sætningsfragmenter til eftertryk. Start sætninger forskelligt (f.eks. med en præpositionsfrase eller adverbium). |

| Ensartet flow | Afsnit er ofte af lignende længde, og overgangene imellem dem føles formelmæssige ("Desuden," "Ydermere," "Derudover"). | Variér afsnitslængden. Brug naturlige, samtaleagtige overgange som "Men her er tingen," "Lad os nu tale om," eller start simpelthen en ny, relateret tanke. |

| Mangel på stemme | Tonen er neutral, objektiv og mangler enhver mærkbar personlighed. Det føles som en lærebog. | Injicer din egen stemme. Stil retoriske spørgsmål. Brug sammentrækninger ("det er" i stedet for "det er"). Tilføj personlige meninger eller korte aside. |

Ved at fokusere dine redigeringsbestræbelser på disse specifikke områder, gætter du ikke længere bare - du målretter strategisk de kernemetrikker, som detektionssystemer er afhængige af.

I dette konstante katte-og-mus-spil mellem AI-forfattere og detektorer er gammeldags manuel redigering stadig kongen. Det har vist sig at reducere AI-detektionsrater fra utrolige 82% ned til kun 21,5% i gennemsnit. Det er ikke bare en teori; det er det, vi ser i test efter test på tværs af værktøjer som GPTZero og Originality.AI.

Ved bevidst at arbejde for at øge både perpleksitet og burstiness underminerer du direkte detektorens hele model og lægger grundlaget for at transformere det robotagtige udkast til noget ægte menneskeligt.

Få beskidte hænder: Praktiske humaniseringsteknikker

Okay, nu hvor du ved, hvad AI-detektorer snuser efter, er det tid til at smøge ærmerne op. Det handler ikke om at brænde hele udkastet og starte forfra. Tænk på dig selv som en redaktør, ikke bare en forfatter. Du injicerer strategisk lidt menneskeligt kaos i maskinens perfekte, sterile orden.

Dit hovedmål er manuelt at skrue op for tekstens perpleksitet og burstiness. Disse hands-on-redigeringer er uden tvivl den mest effektive måde at sejle forbi AI-detektion. Du bytter i bund og grund forudsigelige, maskinlignende mønstre ud med dit eget unikke, menneskelige fingeraftryk.

Bland dine sætninger for at booste burstiness

Det døde giveaway af et AI-udkast er ofte dets monotone rytme. Sætning efter sætning af lignende længde skaber en robotagtig, forudsigelig kadence, der kan få en læser til at falde i søvn. Din første mission er at smadre det mønster.

- Variér længden: Bland bevidst korte, kontante sætninger med længere, mere beskrivende. En kort sætning lander et punkt. Hårdt. En længere giver dig plads til at forklare, tilføje farve og opbygge en mere kompleks tanke.

- Brug fragmenter: Nogle gange virker et enkelt ord. Virkelig. Det er en fantastisk måde at tilføje eftertryk og få din skrivning til at føles mere samtaleagtig.

- Skift dine åbninger: Lad ikke hver sætning starte på samme måde ("Virksomheden gjorde dette," "Softwaren gør det"). Start med en præpositionsfrase, et adverbium eller en afhængig sætning for at skabe et meget mere dynamisk flow.

Her er et klassisk AI-genereret eksempel.

AI-udkast: Marketingteamet skal udnytte sociale medieplatforme for at forbedre kundeengagement. Denne strategi er vigtig for at opbygge brandloyalitet. Virksomheden kan opnå bedre resultater ved at poste konsekvent.

Grammatisk er det fint. Men det er fuldstændig sjælløst. Lad os nu injicere lidt liv i det.

Humaniseret version: For virkelig at forbinde med kunder skal marketingteamet være aktive på sociale medier. Hvorfor? Fordi det er den moderne nøgle til at opbygge ægte brandloyalitet. Konsekvent posting, tankevækkende svar, ægte forbindelse - det er det, der driver resultater.

Ser du forskellen? Vi blandede sætningslængderne, kastede et spørgsmål ind og brugte endda et fragment for lidt ekstra punch. Rytmen føles øjeblikkeligt mere naturlig og engagerende.

Smid forudsigelige ord for mere engagerende sprog

Næste skridt: perpleksitet. Du skal jage AI'ens yndlings-ti-dollar-ord. Sprogmodeller er trænet på bjerge af formel tekst, så de har en tendens til at læne sig op ad ord, der lyder officielle, men er totalt blottet for personlighed. Tid til en "ord-ektomi."

Start med at lave en "hitliste" af almindelige AI-ord og byt dem ud med mere naturlige alternativer. Denne simple ændring er et kraftfuldt træk til at få dit indhold til at bestå AI-checks.

| Almindeligt AI-ord | Bedre menneskeligt alternativ |

|---|---|

| Udnytte | Bruge, prøve, gå med |

| Problemfrit | Nemt, glat, simpelt |

| Dykke ned i | Se på, udforske, finde ud af |

| Følgelig | Så, på grund af dette |

| Desuden | Også, plus, oven i det |

At sætte dette i praksis er nemt. Lad os tage endnu en stiv, AI-genereret sætning.

AI-udkast: Desuden er det bydende nødvendigt at dykke ned i dataene for at formulere en omfattende strategi.

Lad os nu bare sige det som en person.

Humaniseret version: Plus, vi skal virkelig grave i dataene for at finde ud af en solid plan.

Betydningen er identisk, men tonen er en helt anden verden. Den er direkte, den er samtaleagtig, og den er langt mindre forudsigelig for en detektionsalgoritme.

Handlingsorienteret tip: Hold en løbende liste over dine egne "AI-tells" - de mærkelige ord, du bemærker popper op i dine udkast igen og igen. Efter et par redigeringssessioner har du et tilpasset snydearк, der gør denne proces så meget hurtigere.

Injicer din autentiske stemme og personlighed

Dette er det sidste og mest afgørende lag. En AI har ingen livserfaring. Den har ingen meninger, ingen humoristisk sans, ingen historier at fortælle. At tilføje disse unikt menneskelige elementer er dit ultimative forsvar mod detektion, fordi de per definition kun kan komme fra dig.

- Fortæl en hurtig historie: Væv en kort, relevant personlig anekdote ind. At starte en sætning med "Jeg husker at prøve dette for første gang og..." gør øjeblikkeligt indholdet mere autentisk og relaterbart.

- Stil retoriske spørgsmål: Træk din læser ind i samtalen. "Men hvad betyder dette faktisk for din bundlinje?" Det tvinger dem til at pause og tænke, hvilket bryder den passive læseoplevelse.

- Brug sammentrækninger: Dette er et så simpelt, men kraftfuldt trick. At skrive "det er," "du er," og "gør ikke" i stedet for "det er," "du er," og "gør ikke" får øjeblikkeligt din tone til at føles mere naturlig og mindre som en lærebog. AI-modeller undgår ofte sammentrækninger, medmindre du specifikt fortæller dem at bruge dem.

- Udtryk en mening: Vær ikke bange for at have et synspunkt. En AI er programmeret til neutralitet, men mennesker har perspektiver. Sætninger som "Efter min erfaring..." eller "Ærligt talt mener jeg..." introducerer en personlighed, som algoritmer kæmper for at replikere.

Disse manuelle redigeringer gør mere end bare at hjælpe dig med at flyve under AI-detektionsradaren. De transformerer en generisk, glembar artikel til noget overbevisende, der faktisk forbinder med en rigtig person. Det er forskellen mellem en maskinmonolog og en menneskelig samtale.

Opbygning af en gentagelig arbejdsproces til humanisering af AI-indhold

At kende et par redigeringstricks er én ting. Konsekvent at anvende dem for at gøre AI-indhold uopsporeligt er noget helt andet. Hvis du virkelig vil bestå AI-detektion hver gang, har du brug for et system - en gentagelig proces, der tager gætteriet ud af det.

Uden en solid arbejdsproces laver du bare tilfældige redigeringer og håber på det bedste. Det er en opskrift på inkonsistente resultater, især når du har en deadline. En struktureret, multi-pass-tilgang lader dig fokusere på specifikke forbedringer på hvert trin, hvilket gør hele processen hurtigere og langt mere effektiv.

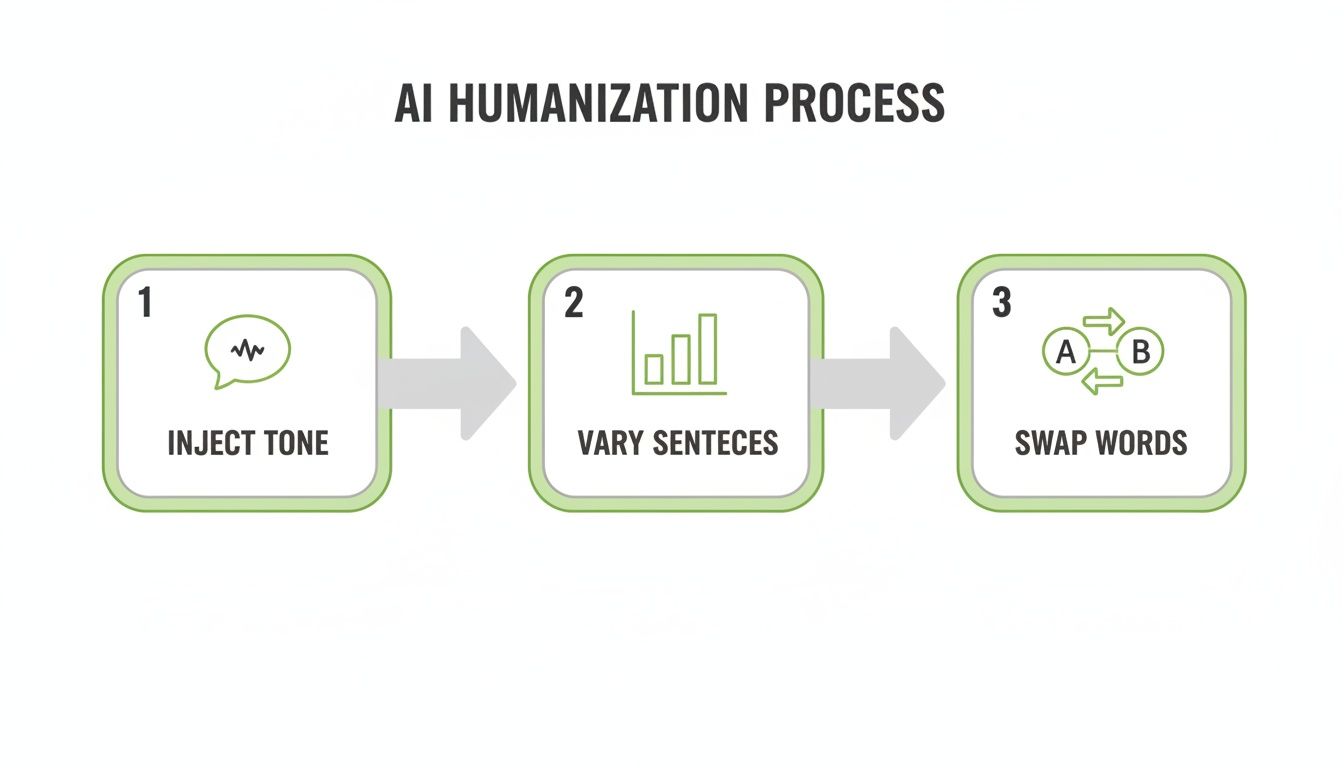

Tænk på det som en kvalitetskontrol-tjekliste til at omdanne robotagtig tekst til noget med en rigtig puls. Dette flowdiagram bryder kerneideen ned i tre enkle, fokuserede trin.

Som du kan se, handler det ikke om én magisk løsning. Det handler om at lagdele dine redigeringer, starte med det store billede-stemme og derefter bore ned til ord-for-ord-detaljerne.

Første gennemgang: Det store billede & stemmeredigering

Din første gennemlæsning handler ikke om at fange tastefejl eller bytte ord. Det handler om de store ting: struktur, flow og vigtigst af alt, stemme. Et råt AI-udkast kan være faktisk korrekt, men det mangler næsten altid et rigtigt synspunkt. Det er her, du gør artiklen din.

Læs hele udkastet fra start til slut. Flyder det faktisk som en rigtig samtale, eller føles det som en lærebog? Er der nogen personlighed, eller er det bare en tør oplæsning af fakta?

- Injicer dit perspektiv: Dette er det mest kraftfulde humaniseringssignal, du har. Tilføj personlige anekdoter, meninger eller unikke indsigter. En simpel sætning som, "Efter min erfaring..." eller "Her er hvad jeg har lært..." er noget, en AI bare ikke kan fake autentisk.

- Fix det narrative flow: AI lægger ofte information ud på en smertefuldt lineær måde. Bryd det forudsigelige mønster. Flyt afsnit rundt for at opbygge spænding, skabe et stærkere argument eller bare gøre det til en mere interessant læsning.

- Justér tonen: Er tonen rigtig for dit publikum? AI falder ofte tilbage til en formel, akademisk stemme, når du har brug for noget mere afslappet og engagerende. Nu er tiden til at indstille den overordnede følelse, før du bliver begravet i detaljerne.

Denne første gennemgang handler om at transformere AI'ens logiske skelet til indhold med et menneskeligt hjerteslag.

Mit personlige tip: Jeg læser altid det rå AI-udkast højt på min første gennemgang. Dine ører vil fange ting, dine øjne går glip af - monotone sætningsrytmer, akavet frasering og robotagtige sætninger. Hvis det lyder mærkeligt, når du siger det, vil det helt sikkert læse mærkeligt.

Anden gennemgang: Polering på sætningsniveau

Okay, med strukturen og stemmen låst fast er det tid til at blive kirurgisk. Denne anden gennemgang handler om sætningsniveau-detaljerne. Dit mål her er direkte at angribe de lave perpleksitets- og lave **burstiness-**signaler, som AI-detektorer er trænet til at finde. Du gør teksten statistisk rodet, ligesom menneskelig skrivning.

Her er din tjekliste til denne gennemgang:

- Variér sætningslængde: Jag afsnit, hvor hver sætning er nogenlunde samme længde. Dette er et dødt giveaway. Kombinér to korte sætninger eller opdel en lang for at skabe en mere dynamisk, naturlig rytme.

- Byt forudsigelige ord: Find og dræb almindelige AI-krykkeord. Bliv af med "udnytte," "problemfrit," "dykke," og "desuden." Erstat dem med mere naturlige, samtaleagtige alternativer.

- Brug sammentrækninger: Skift "det er" til "det er" og "du vil" til "du vil." Dette er en dødsimpel redigering, der øjeblikkeligt får teksten til at føles mindre stiv og mere menneskelig.

- Tilføj retoriske spørgsmål: Træk læseren ind i samtalen. At droppe et spørgsmål som, "Men hvordan fungerer det faktisk i praksis?" bryder det passive flow og efterligner, hvordan rigtige mennesker taler og tænker.

Denne gennemgang handler ikke om at omskrive enorme sektioner. Det handler om at lave små, målrettede ændringer, der, når de kombineres, har en massiv indvirkning på detektionsscoren.

Sidste gennemgang: Den altafgørende testfase

Du ville ikke lancere en hjemmeside uden at teste den på forskellige browsere, vel? Den samme logik gælder her. Publicer ikke dit indhold uden at køre det gennem et par forskellige AI-detektorer.

At stole på et enkelt værktøj er en af de største fejl, folk laver. Hver detektor bruger en lidt anderledes algoritme, så hvad der består på én, kan blive flaget på en anden.

Jeg anbefaler at krydstjekke med mindst to eller tre førende værktøjer - tænk GPTZero, Originality.ai, og Turnitin's detektor, hvis du har adgang. Dit mål er at få en konsensus.

Når resultaterne kommer tilbage, skal du ikke bare kigge på den overordnede score. Det rigtige guld er i de dele, de fremhæver. De fleste detektorer vil vise dig de nøjagtige sætninger, de tror er AI-genererede. Gå tilbage til de fremhævede sektioner og anvend endnu en runde humaniseringsredigeringer. Måske skal du omformulere en kompleks sætning eller bytte endnu et forudsigeligt ord ud. Ofte er disse sidste, målrettede tweaks alt, hvad du har brug for for at få en "menneskeskrevet" score på tværs af hele linjen.

Valg af det rigtige AI-humaniseringsværktøj til jobbet

Okay, du har en solid humaniseringsarbejdsproces. Nu tænker du måske på at tilføje et dedikeret værktøj for at fremskynde tingene. Men her er fælden: markedet er absolut oversvømmet med muligheder, og ærligt talt er de fleste af dem ikke din tid værd.

At vælge den forkerte spilder ikke bare penge; det spilder timer af din dag og efterlader dig med indhold, der stadig bliver flaget af AI-detektorer. Det er frustrerende.

Det rigtige trick er at kende forskellen mellem en simpel "parafraserer" og en ægte AI-humanizer. Et grundlæggende spinnerværktøj bytter bare ord ud med synonymer - et gammeldags trick, som moderne detektorer som Turnitin gennemskuer. En ægte humanizer er et helt andet beist. Den er trænet på massive biblioteker af menneskeskrevet tekst til grundlæggende at omstrukturere sætninger, introducere varieret syntaks og tweake tonen præcis rigtigt til at flyve under radaren.

Kernekritierier for evaluering af ethvert værktøj

Når du vurderer et værktøj, skal du ignorere de prangende marketingløfter. Din beslutning bør koges ned til en håndfuld ikke-forhandlingsbare kriterier, der adskiller de effektive værktøjer fra de glorificerede tesauruser.

I sidste ende er det eneste spørgsmål, der betyder noget: virker det faktisk? Se efter værktøjer, der er gennemsigtige om deres succesrater mod en række populære detektorer, ikke bare én, de ved, de kan slå.

Her er hvad jeg altid tjekker for:

- Detektions-bypass-rate: Får værktøjet konsekvent en "menneskelig" score på hårde platforme som GPTZero, Originality.ai, og Sapling? Et pålideligt værktøj skal være effektivt mod flere algoritmer.

- Betydningsbevarelse: Outputtet skal sige, hvad du oprindeligt mente. Hvis værktøjet omskriver din tekst til noget, der er faktisk forkert eller bare rent vrøvl, er det fuldstændig ubrugeligt.

- Brugervenlighed: Grænsefladen skal være ren, hurtig og intuitiv. Du skal ikke kæmpe med softwaren for at få et resultat; den skal passe glat ind i, hvordan du allerede arbejder.

Det hjælper også at forstå, hvad du prøver at fikse i første omgang. At lege med et værktøj som en AI Post Generator giver dig en fornemmelse af den slags robotagtige output, du har brug for at humanisere. Denne kontekst hjælper dig med at værdsætte de subtile, men kritiske forbedringer, en god humanizer laver.

Den oversete faktor: Databeskyttelse

Dette er den ene ting, de fleste mennesker glemmer at tjekke, og det er uden tvivl det vigtigste. Når du indsætter din artikel i et tilfældigt online værktøj, hvor går de data hen? Nogle tjenester gemmer din tekst og bruger den måske endda til at træne deres egne AI-modeller.

Det er en massiv risiko. Dit indhold - hvad enten det er til en klient, et følsomt forskningspapir eller din virksomheds næste store marketingplan - er din intellektuelle ejendom. At overlevere det til en tjeneste med en tvivlsom privatlivspolitik er en chance, du bare ikke bør tage.

Privatlivstjek: Læs altid, altid værktøjets privatlivspolitik. Se efter eksplicitte garantier for, at din tekst ikke vil blive gemt, delt eller brugt til træningsformål. En troværdig tjeneste vil gøre dette løfte klart og direkte.

At vælge et værktøj, der respekterer dit privatliv, sikrer at dit arbejde forbliver dit og dit alene. For et dybt dyk ind i, hvilke værktøjer der opfylder disse standarder, kan du tjekke vores detaljerede gennemgang af de bedste AI-humanizer-muligheder, der er tilgængelige.

Fra grundlæggende til avanceret: En hurtig sammenligning

For at sætte dette alt i perspektiv, lad os se på de forskellige niveauer af værktøjer derude. At kende dette hierarki hjælper dig med at præcisere, hvad du faktisk har brug for til dine specifikke kvalitets- og uopsporbarheds-mål.

| Værktøjstype | Hvordan det virker | Almindeligt resultat |

|---|---|---|

| Simpel parafraserer | Bytter individuelle ord med synonymer. Kan let omarrangere sætninger. | Lyder ofte akavet eller "spunnet." Fejler de fleste moderne AI-detektorer. |

| Grundlæggende AI-omskriver | Bruger AI til at omskrive sætninger én efter én. Mangler et holistisk syn på teksten. | Forbedrer parafrasering, men har stadig en robotagtig følelse. Kæmper med hårde detektorer som Turnitin. |

| Avanceret humanizer | Genopbygger tekst ved hjælp af modeller trænet på menneskelig skrivning. Fokuserer på flow, rytme og struktur. | Producerer naturligt, uopsporeligt output, der bevarer den oprindelige betydning. |

I sidste ende sparer investering i en avanceret humanizer en masse redigeringstid og giver dig et slutprodukt, du kan stole på. Det er den mest pålidelige vej til konsekvent at bestå AI-detektion uden at ofre kvaliteten af dit indhold.

Brug af AI-humanizers etisk og ansvarligt

At få dit indhold til at bestå AI-detektion er én ting. At gøre det ansvarligt er noget helt andet. Der er en skarp linje mellem at bruge AI som en kraftfuld assistent og bruge den til direkte at bedrage folk, og den linje er trukket med hensigt. Det er forskellen mellem at strømline din arbejdsproces og begå akademisk bedrageri eller bare oversvømme internettet med lav kvalitet, automatiseret skrald.

Målet er ikke bare at være uopdagelig. Det er at producere højkvalitets, ærligt arbejde, som du faktisk kan stå ved. Når du tænker etisk fra starten, sikrer du, at det endelige produkt har integritet, uanset om du indsender en opgave til en professor eller udgiver en artikel til dit publikum.

Den klare linje for studerende

For studerende er reglerne stort set ikke-forhandlingsbare. Universiteter bygger deres akademiske integritetspolitikker omkring original tanke, kritisk analyse og korrekt citering. At tage et AI-genereret essay, køre det gennem en humanizer og indsende det til et system som Turnitin er ikke en smart omvej - det er en klar krænkelse af disse principper.

Hele den tilgang går glip af pointen med opgaven i første omgang, som er at lære, syntetisere information og artikulere dine egne unikke argumenter. Den etiske måde at bruge AI i skolen ser helt anderledes ud.

- Brainstorming og oversigter: At bruge AI til at kickstarte dit arbejde ved at udforske emner, strukturere en oversigt eller få styr på komplekse ideer er helt legitimt.

- Udkast-support: Det kan være et fantastisk værktøj til at omformulere en kluntet sætning eller finde et bedre ord, næsten som en super-kraftig tesaurus.

- Aldrig til endelig indsendelse: Kernen i arbejdet - argumenterne, analysen, konklusionerne - skal være dine. Punktum.

Nøgle-takeaway: Tænk på en AI-humanizer som en sidste polerer til dine egne ideer, ikke en ghostwriter for arbejde, du ikke har lavet. I sekundet det bruges til at tage æren for tænkning, der ikke er din, har du krydset en alvorlig etisk linje.

Bedste praksis for professionelle

For marketingfolk, forfattere og SEO'er handler det etiske spil mere om publikumstillid og indholdskvalitet. Dine læsere kommer til dig for ekspertise, autenticitet og reel værdi. Bare at humanisere et generisk AI-udkast og trykke "publicer" er en hurtig måde at forråde den tillid og skade dit brand.

I et professionelt miljø betyder ansvar at beskytte dit brands unikke stemme og sikre, at hvert enkelt stykke indhold er faktisk korrekt og ægte nyttigt. Dit omdømme er bygget på kvaliteten af dit arbejde, ikke mængden.

Her er en hurtig tjekliste for at holde tingene etiske og ansvarlige:

- Faktacheck alt: AI-modeller er berygtede for at opfinde ting. Dette fænomen, ofte kaldet "hallucination," er et reelt problem. Bekræft altid, altid hver statistik, påstand og citat med en velrenommeret kilde.

- Injicer reel ekspertise: Brug AI-udkastet som et skelet. Den rigtige værdi - kødet - kommer, når du tilføjer dine egne indsigter, personlige erfaringer og branchespecifik viden, som ingen maskine nogensinde kunne have.

- Bevar din brandstemme: En humanizer kan udjævne sætningsstrukturer, men du er vogteren af dit brands personlighed. Sørg for, at den endelige tekst lyder som dig, ikke en generisk robot.

- Oprethold databeskyttelse: Som professionel er håndtering af data etisk ikke-forhandlingsbar. Hvis du bruger AI-værktøjer i en forretningskontekst, er det værd at gennemgå en AI GDPR Compliance Guide for at sikre, at du har alle dine juridiske og etiske baser dækket.

I sidste ende er den mest etiske tilgang også den mest effektive. Indhold, der er omhyggeligt redigeret, faktachecket og gennemsyret af ægte menneskelig ekspertise, består ikke bare AI-detektion - det performer bedre med søgemaskiner og forbinder dybere med dit publikum. Målet er at forstærke din intelligens, ikke erstatte den.

Et par almindelige spørgsmål om at omgå AI-detektorer

Selvom du har en solid gameplan, dukker et par spørgsmål altid op, når du forsøger at få AI-genereret tekst til at flyve under radaren. Lad os tackle nogle af de mest almindelige, jeg hører. At få disse sorteret hjælper dig med at redigere med meget mere selvtillid.

Kan AI-detektorer nogensinde være 100% nøjagtige?

Nej. Og det er ret usandsynligt, de nogensinde vil være det.

Du skal tænke på AI-detektorer som probabilistiske værktøjer, ikke som ufejlbarlige dommere. De er bygget til at spotte statistiske mønstre, der har tendens til at dukke op i maskinskrivning. De handler ikke i sikkerhed, hvilket betyder, at de tager fejl - meget.

- Falske positiver: Dette er når detektoren skriger "AI!" til noget et menneske skrev. Det er almindeligt med ligetil, faktuel skrivning, der naturligt mangler komplekse sætningsstrukturer.

- Falske negativer: Dette er det modsatte - et AI-genereret stykke slipper forbi fuldstændig uopdaget. Lidt smart redigering er ofte alt, hvad der skal til for at narre algoritmen.

Her er en bedre måde at se på det: En detektors score er ikke en dom. Det er en guide. En høj AI-score fremhæver bare de sætninger, der lyder mest robotagtige, og viser dig præcis, hvor du skal fokusere dine redigeringsbestræbelser. For eksempel, hvis et værktøj flager "Det er afgørende at implementere det nye system," ved du at ændre det til noget som, "Se, vi skal have dette nye system op at køre."

Vil humanisering af mit AI-indhold skade min SEO?

Det er faktisk omvendt - det vil næsten helt sikkert hjælpe det. Dette er en enorm misforståelse, der kommer fra en frygt for at få et klask med en Google-straf. Men hvis du tænker på, hvad Google faktisk vil have, stemmer humanisering af dit indhold perfekt overens med deres mål.

Søgemaskiner er designet til at belønne indhold, der er hjælpsomt, pålideligt og giver læseren en god oplevelse. Dette er hele pointen med Googles E-E-A-T (Experience, Expertise, Authoritativeness, and Trustworthiness) retningslinjer.

Generisk, robotagtig AI-tekst bomber på alle disse fronter. Den har ikke den unikke stemme eller førstehåndserfaring, der signalerer reel ekspertise. Når du omskriver den tekst til at være mere autentisk og engagerende, gør du den bedre for mennesker. Og at gøre indhold bedre for mennesker er det bedste signal, du muligvis kan sende til søgemaskiner. Hvis du vil gå dybere, kan du også læse om hvorvidt uopsporeligt AI virkelig virker i vores omfattende guide.

Er det forkert at bruge værktøjer til at bestå AI-detektion?

Etikken her koges virkelig ned til to ting: din hensigt og det endelige produkt. Værktøjet i sig selv er bare kode; hvad du gør med det er det, der betyder noget.

Hvis du bruger AI til at komme forbi skribentblok eller kortlægge et første udkast, og så omhyggeligt redigerer det output for at afspejle din egen viden og stemme, er det bare en smart arbejdsproces. Du bruger et værktøj til at assistere din egen intelligens, ikke til at erstatte den.

Den etiske linje bliver krydset, når målet er at bedrage.

- For studerende: At indsende et AI-genereret essay, der bare er blevet kørt gennem en humanizer, er akademisk uærlighed, helt enkelt. Hele pointen med en opgave er at lære og tænke kritisk.

- For professionelle: Standarden er enkel: er du ærlig og giver værdi? Hvis et værktøj hjælper dig med at producere ægte hjælpsomt, højkvalitetsindhold til dit publikum mere effektivt, bruger du det ansvarligt. Hvis du bruger det til at pumpe lavkvalitets, unøjagtige artikler ud bare for mængdens skyld, er det uetisk og vil i sidste ende sænke dit brand.

Den ansvarlige tilgang er ret klar. Brug AI som dit startblok, men sørg altid for, at det endelige stykke er faktachecket, fyldt med dit eget unikke perspektiv og faktisk hjælper læseren. Det er sådan, du skaber indhold, der ikke bare er "uopsporeligt," men ægte godt.

Klar til at transformere dit AI-genererede indhold til naturlig, menneskelig skrivning? Humantext.pro forfiner din tekst øjeblikkeligt og sikrer at den læses naturligt mens den omgår AI-detektorer. Prøv vores gratis AI-humaniserer i dag →

Relaterede Artikler

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.