Wat is een AI-detectieverwijderaar en hoe werkt het?

Ontdek wat een AI-detectieverwijderaar is en hoe het je helpt om AI-detectoren te omzeilen. Leer over de technologie, ethisch gebruik en hoe je de juiste tool kiest.

Dus, wat is een AI-detectieverwijderaar precies? Zie het als een gespecialiseerde editor voor AI-gegenereerde tekst. Deze tools nemen content die een beetje stijf of robotachtig klinkt en herschrijven het zodat het natuurlijk leest, waardoor het soepel langs de AI-detectiesoftware glijdt die elke dag gebruikelijker wordt.

Als je AI gebruikt om te helpen bij het schrijven, is een tool als deze praktisch onmisbaar. Het helpt je om die machinaal gemaakte eerste concepten om te vormen tot boeiende, gepolijste content die niet wordt gemarkeerd. Je zou bijvoorbeeld een AI-gegenereerde alinea voor een marketing-e-mail kunnen nemen, het door de tool halen en een versie terugkrijgen die warmer en overtuigender klinkt – klaar om naar je klanten te sturen.

De nieuwe uitdaging van AI-contentdetectie

Het internet wordt momenteel overspoeld met content, en een enorm deel daarvan komt van krachtige AI-tools die het schrijven van artikelen, essays en rapporten bijna moeiteloos maken. Deze explosie in AI-gestuurde contentcreatie heeft een geheel nieuwe uitdaging in gang gezet: het verschil onderscheiden tussen wat een mens heeft geschreven en wat een machine heeft gegenereerd.

Deze massale toestroom heeft een digitaal kat-en-muisspel ontketend. Om de golf van geautomatiseerde tekst te hanteren, hebben zoekmachines, universiteiten en grote contentplatformen geavanceerde AI-detectoren uitgerold. Deze systemen zijn getraind om de subtiele, veelzeggende tekenen van AI te herkennen – de voorspelbare zinsstructuren, het ontbreken van een unieke stem – en alles te markeren dat niet helemaal menselijk aanvoelt.

Het probleem voor moderne creators

Dit creëert een echt hoofdpijn voor veel mensen. Marketeers, studenten en schrijvers die op AI vertrouwen om sneller te werken, lopen nu het risico bestraft te worden. Hun werk, zelfs als het goed onderzocht en oprecht waardevol is, zou lager gerangschikt of in twijfel getrokken kunnen worden alleen omdat AI een handje hielp bij het opstelproces.

De schaal hiervan is verbijsterend. Tegen 2025 voorspellen sommige analisten dat 30–40% van alle tekst op het web afkomstig zal zijn van AI-systemen. Andere projecties zijn nog gewaagder en suggereren dat dit getal tegen het einde van het jaar 90% zou kunnen bereiken.

Dit is precies waar een AI-detectieverwijderaar een onmisbaar onderdeel wordt van de toolkit van de moderne schrijver. Het gaat niet om bedrog of oneerlijkheid. Het gaat om het nemen van een solide AI-gegenereerd concept en het polijsten totdat het authentiek en menselijk klinkt.

Verfijnen, niet misleiden

Het doel is simpel: je eigen stem bewaren en ervoor zorgen dat je werk beoordeeld wordt op zijn ideeën, niet op zijn oorsprong. Dit proces laat je de snelheid en efficiëntie van AI behouden zonder de kwaliteit en authenticiteit van het eindproduct op te offeren.

Door AI-tekst ondetecteerbaar te maken, kun je oneerlijke straffen ontwijken terwijl je nog steeds geweldig werk levert. Het doel is om:

- Leesbaarheid verbeteren: Houterige, robotachtige zinnen omzetten in proza dat soepel en natuurlijk leest. Bijvoorbeeld: "Het gebruik van deze methodologie resulteert in een toename van efficiëntie" veranderen in "Het gebruik van deze methode maakt dingen efficiënter."

- Originaliteit bewaren: De kernboodschap en ideeën van je concept intact houden terwijl je de presentatie verbetert. De tool moet de stijl veranderen, niet de inhoud.

- Straffen vermijden: Ervoor zorgen dat je content groen licht krijgt van detectoren die worden gebruikt door platforms zoals Google of academische instellingen.

Uiteindelijk overbruggen deze tools de kloof tussen machine-efficiëntie en menselijke creativiteit. Ze helpen ervoor te zorgen dat je eindresultaat niet alleen effectief is, maar echt authentiek.

Hoe AI-detectoren machinaal geschreven tekst herkennen

Om het meeste uit een AI-detectieverwijderaar te halen, moet je eerst weten waar je tegenop loopt. Zie een AI-detector als een taalkundige detective, maar in plaats van naar vingerafdrukken te zoeken, scant hij naar de subtiele, bijna onzichtbare kenmerken van een machine. Hij zoekt niet naar één enkele aanwijzing, maar naar een heel patroon van robotachtige eigenschappen.

Deze digitale speurders zijn getraind op kolossale datasets vol met miljoenen voorbeelden van zowel menselijk als AI-gegenereerd schrijfwerk. Deze diepe duik in data, inclusief een begrip van GPT- en Transformer-mechanismen, leert hen statistische patronen te herkennen die zelfs een ervaren redacteur zou missen.

De veelzeggende tekenen van AI-tekst

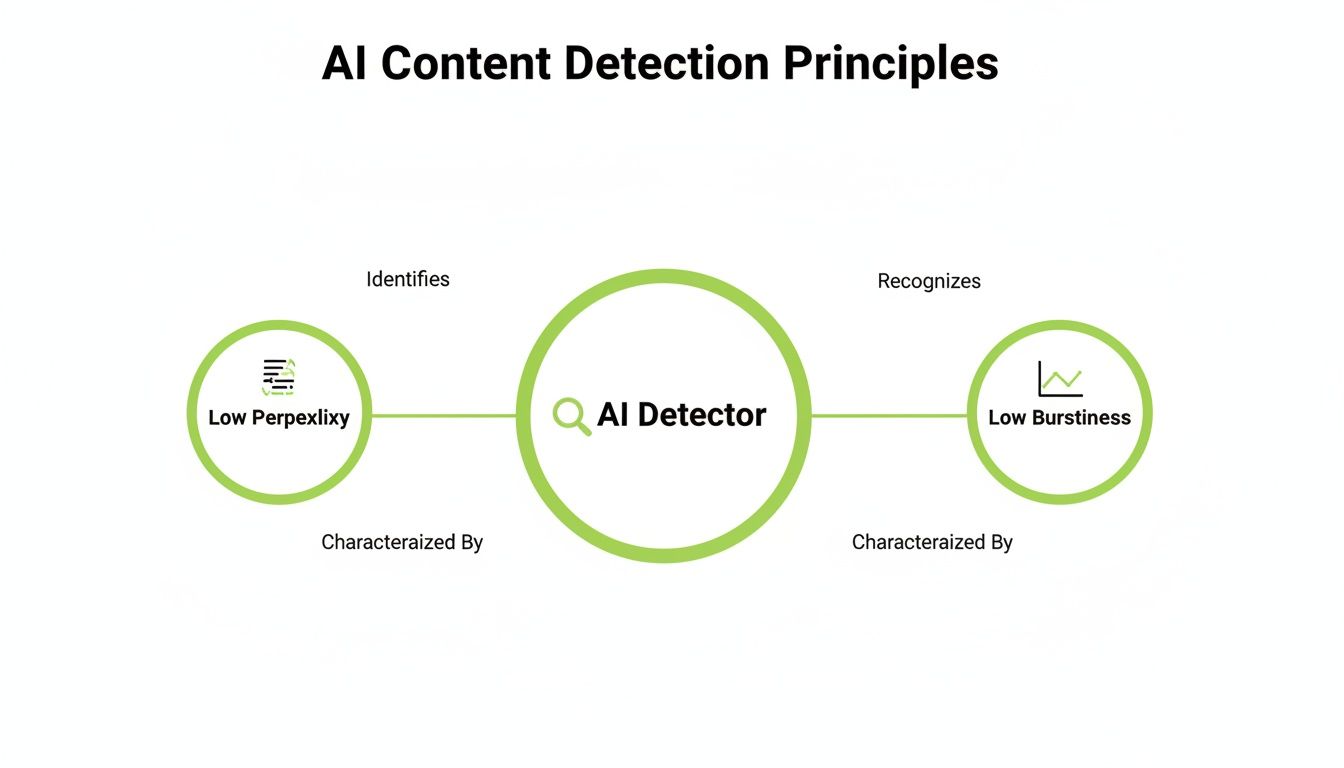

Wanneer een AI-detector een stuk content scant, kijkt hij voornamelijk naar twee belangrijke metrieken: perplexiteit en burstiness. Dit klinkt misschien als hightech jargon, maar het zijn eigenlijk simpele concepten. Ze begrijpen is de eerste stap naar het creëren van content die onder de radar vliegt.

- Perplexiteit (Voorspelbaarheid): Dit is gewoon een mooie manier om te meten hoe voorspelbaar je tekst is. AI-modellen zijn geprogrammeerd om het statistisch meest waarschijnlijke woord te kiezen na het vorige. Dit creëert tekst die grammaticaal perfect is maar vaak vlak, saai en een beetje te simpel aanvoelt. Het mist verrassing.

- Burstiness (Ritme en flow): Dit meet de natuurlijke variatie in zinsstructuur. Een menselijke schrijver zou een lange, kronkelende zin kunnen maken om een complex idee te verkennen, en dan volgen met een korte, scherpe zin voor nadruk. Dit creëert een dynamisch, "burstig" ritme.

AI-gegenereerde tekst mist vaak deze natuurlijke cadans. De zinnen zijn doorgaans uniform in lengte en structuur, wat een monotoon, bijna hypnotiserend ritme creëert dat detectoren getraind zijn om te markeren. Het is het verschil tussen een handgemaakt houten tafel met unieke nerf patronen en een perfect glad, machinaal gevormd stuk plastic.

Menselijk schrijven is van nature gevarieerd. Het heeft eb en vloed, met een mix van eenvoudige en complexe zinnen. AI-tekst verliest dit ritme vaak en kiest voor een consistente, uniforme structuur die onnatuurlijk perfect aanvoelt.

Praktische voorbeelden van AI-verklikkersignalen

Laten we dit concreet maken. Een AI zou iets als dit kunnen genereren: "De hond rende over het veld. De hond was erg snel. De hond genoot van het rennen." Merk op hoe de zinnen eenvoudig, repetitief en totaal voorspelbaar zijn. Dit is een klassiek voorbeeld van lage perplexiteit en lage burstiness.

Een menselijke schrijver zou hetzelfde beeld kunnen schetsen met meer burstiness: "Losgelaten schoot de golden retriever over het open veld, een waas van vacht en ongebreidelde vreugde. Wat een sprint!" De zinslengtes verschillen, de woordenschat is rijker, en het geheel voelt gewoon authentieker aan. Een AI-detectieverwijderaar heeft als doel precies dit soort transformatie automatisch uit te voeren.

Het begrijpen van deze kernprincipes is alles. Een goede AI-detectieverwijderaar wisselt niet zomaar een paar woorden hier en daar uit. Hij herschrijft de tekst fundamenteel om die natuurlijke perplexiteit en burstiness te injecteren waar detectoren naar zoeken. Je kunt meer over dit proces leren en ontdekken of ondetecteerbare AI echt werkt in onze gedetailleerde gids. Deze kennis is je sleutel om robotachtige concepten om te vormen tot content die echt verbinding maakt met mensen.

De technologie achter een AI-detectieverwijderaar

Dus, hoe voert een tool als deze eigenlijk de goocheltruc uit om AI-tekst onzichtbaar te maken voor detectoren? Het is niet zomaar een fancy thesaurus die woorden verwisselt. Zie het minder als een simpele parafrasetool en meer als een bekwame digitale ambachtsman, die een robotachtig concept neemt en het zorgvuldig hervormt met een menselijke touch.

Deze tools zijn gebouwd op geavanceerde taalmodellen die gevoed zijn met een enorme hoeveelheid authentiek menselijk schrijfwerk – miljoenen artikelen, essays en rapporten. In plaats van alleen woorden te veranderen, herstructureren ze de tekst volledig vanaf de basis. Ze analyseren alles van zinsstructuur en woordenschat tot het algehele ritme, op zoek naar de veelzeggende patronen die AI-detectoren getraind zijn om op te pikken.

De digitale vingerafdrukken wissen

Het hoofddoel is om de perplexiteit en burstiness van de tekst op te voeren – die twee belangrijke metrieken waar we het eerder over hadden. AI-tekst is doorgaans erg voorspelbaar en gelijkmatig. Door zinslengtes te variëren, complexere structuren te introduceren en minder gangbare woordkeuzes te gebruiken, doorbreekt de tool die monotone consistentie.

Praktische tip: Probeer voor het humaniseren van een tekst deze hardop voor te lezen. Als het monotoon klinkt of een natuurlijk ritme mist, heeft het lage burstiness. Een goede humanizer lost dit op door zinslengte en -structuur te variëren. Bijvoorbeeld door twee korte zinnen samen te voegen tot een complexe zin, of een lange zin op te breken in kortere, krachtigere frasen.

Zoals je kunt zien, is de combinatie van lage perplexiteit en lage burstiness het klassieke visitekaartje van AI-gegenereerde content, wat een duidelijk signaal creëert dat detectoren getraind zijn om op te vangen.

Dit hele proces draait niet alleen om de tekst beter te laten klinken. Het gaat om het methodisch wissen van de statistische "aanwijzingen" die schreeuwen: "een machine heeft dit geschreven!" De tool transformeert een concept dat grammaticaal perfect maar volstrekt zielloos kan zijn in iets dat leest alsof het van begin af aan door een mens is geschreven, terwijl de oorspronkelijke betekenis en ideeën intact blijven.

Hoe geavanceerde humanizers het voor elkaar krijgen

De beste tools gaan een enorme stap verder door te steunen op enorme, hoogwaardige datasets. Een eersteklas AI-detectieverwijderaar gebruikt geavanceerde taalkundige modellering om tekst te produceren die echt natuurlijk klinkt.

Een AI-detectieverwijderaar zoals HumanText.pro converteert AI-concepten naar menselijk klinkende tekst die langs detectoren als GPTZero en Turnitin komt met 99% succespercentage. Dit is mogelijk omdat de modellen getraind zijn op 1,2 miljoen menselijke schrijfvoorbeelden om authenticiteit te garanderen.

Dit soort diepgaande training stelt de tool in staat om ondetecteerbare essays, blogs en andere professionele documenten te produceren. Het beschermt ook de privacy van gebruikers door geen content op te slaan en biedt directe proefversies om het uit te proberen. Je kunt dieper ingaan op de bredere industrietrends met deze statistieken en bevindingen over kunstmatige intelligentie.

Door te focussen op deze diepgaande structurele en stilistische veranderingen, biedt een AI-humanizer een solide oplossing voor iedereen die AI-ondersteund werk moet oppoetsen tot iets ondetecteerbaar. Het is de essentiële brug tussen machine-efficiëntie en authentieke menselijke expressie.

AI-detectieverwijderaars ethisch en effectief gebruiken

Laten we één ding duidelijk stellen: een AI-detectieverwijderaar is geen toverstaf voor academische oneerlijkheid. Zo erover denken mist het punt volledig. Zie het in plaats daarvan als een afwerkingstool – een polijster voor content die begint met AI maar eindigt met menselijk inzicht en creativiteit.

De ethiek van het gebruik van een humanizer komt volledig neer op je intentie. Probeer je een ruw, onbewerkt AI-concept af te schuiven als je eigen genialiteit? Dat is een probleem. Of gebruik je het om een AI-ondersteund concept te verfijnen, de robotachtige taal glad te strijken zodat je eigen ideeën kunnen doorschijnen? Dat is gewoon een slimme workflow.

Praktische tip: De meest ethische workflow is een hybride. Gebruik AI voor de eerste 70% (onderzoek, schetsen, eerste concept), en gebruik dan een humanizer voor de volgende 20% (taal oppoetsen). De laatste 10% moet altijd je eigen review zijn – feitcontrole, persoonlijke anekdotes toevoegen en ervoor zorgen dat de toon past bij je merk of academische stem.

Praktijkscenario's voor ethisch gebruik

Dus, hoe ziet dit er in de praktijk uit? Het gaat niet om bedrog; het gaat om het overwinnen van echte knelpunten zonder kwaliteit op te offeren. De sleutel is altijd om je eigen waarde toe te voegen, niet om het werk te ontlopen.

Hier zijn een paar veelvoorkomende, verantwoorde manieren waarop mensen deze tools gebruiken:

Voor contentmarketeers: Een marketingteam heeft een ambitieus doel: 10 hoogwaardige blogposts per week publiceren om hun SEO-strategie aan te drijven. Ze gebruiken AI om eerste concepten te genereren vanuit gedetailleerde briefings, waardoor ze honderden uren besparen. Vervolgens gebruiken ze een humanizer om de taal op te poetsen, het aantrekkelijker te maken en ervoor te zorgen dat het niet door spamfilters wordt gemarkeerd. Ze kunnen de productie opschalen zonder als robots te klinken.

Voor studenten: Een geschiedenisstudent werkt aan een complex essay. Ze gebruiken AI om een basisoverzicht te maken en hun onderzoek te organiseren. Na het zelf schrijven van het volledige essay, laten ze het door een humanizer lopen om onhandige formuleringen glad te strijken en de algehele flow te verbeteren. Dit helpt hun unieke analyse helder door te komen, waarbij de tool dient als geavanceerde corrector in plaats van ghostwriter.

Het verantwoord gebruiken van een AI-detectieverwijderaar gaat over het overbruggen van de kloof tussen machine-efficiëntie en menselijke creativiteit. Het stelt je in staat om AI-gegenereerde content te verfijnen tot een eindproduct dat gepolijst, authentiek is en echte waarde toevoegt.

Professionals die hun communicatie verfijnen

De behoefte aan een menselijke touch reikt veel verder dan contentteams en klaslokalen. Voor elke professional is het opstellen van rapporten, het maken van presentaties of het beantwoorden van klant-e-mails dagelijkse routine. AI kan in seconden een sjabloon of eerste concept maken, wat enorm veel tijd bespaart.

Maar het versturen van een generieke, machinaal geschreven e-mail kan een klantrelatie beschadigen. Door dat concept door een AI-detectieverwijderaar te halen, kun je ervoor zorgen dat het uiteindelijke bericht persoonlijk, professioneel en authentiek klinkt. Het draait allemaal om het behouden van een menselijke connectie in een wereld die sneller dan ooit beweegt.

Het begrijpen van deze toepassingen is de eerste stap. Door te leren hoe je AI-detectie kunt vermijden op een verantwoorde manier, kun je deze tools een krachtig en ethisch onderdeel van je workflow maken.

Ethische toepassingen van AI-detectieverwijderaars in verschillende beroepen

Om dit nog duidelijker te maken, laten we bekijken hoe verschillende professionals AI-humanizers ethisch kunnen inzetten om veelvoorkomende uitdagingen aan te pakken.

| Gebruikersprofiel | Veelvoorkomende uitdaging | Ethische oplossing met een AI-detectieverwijderaar |

|---|---|---|

| SEO-specialist | Moet grote hoeveelheden unieke, hoogwaardige content produceren die goed scoort en zoekmachinastraffen voor "onbehulpzame" AI-tekst vermijdt. | Genereert keyword-geoptimaliseerde concepten met AI en gebruikt vervolgens een humanizer om de syntaxis en flow te verfijnen, zodat het uiteindelijke artikel boeiend en waardevol is voor lezers. |

| Niet-moedertaalspreker Engels | Heeft uitstekende ideeën maar worstelt met natuurlijke formuleringen en idiomatische uitdrukkingen, wat leidt tot tekst die gekunsteld of "buitenlands" klinkt. | Schrijft de content eerst zelf en gebruikt dan een AI-humanizer als geavanceerde taaltool om het schrijfwerk op te poetsen en natuurlijker en vloeiender te laten klinken. |

| Freelance schrijver | Heeft te maken met strakke deadlines en moet de efficiëntie maximaliseren om meerdere klanten te bedienen zonder dat de schrijfstijl repetitief of generiek wordt. | Gebruikt AI voor eerste onderzoek en concepten, past dan een humanizer toe om stilistische variatie en een unieke stem toe te voegen die is afgestemd op het merk van elke klant. |

| Kleine ondernemer | Jongleert met alle marketingtaken en moet snel overtuigende websiteteksten, productomschrijvingen en social media-posts creëren. | Maakt functionele eerste concepten met een AI-assistent en humaniseert ze vervolgens om ervoor te zorgen dat de persoonlijkheid en stem van het merk authentiek doorkomt. |

| Academisch onderzoeker | Moet complexe bevindingen samenvatten in heldere, toegankelijke taal voor subsidieaanvragen of publicaties, maar vindt de tekst compact en jargonrijk. | Laat technische concepten door een humanizer lopen om de leesbaarheid en flow te verbeteren, waardoor het onderzoek begrijpelijker wordt voor een breder publiek zonder de kerndata te veranderen. |

Uiteindelijk is het doel niet om het gebruik van AI te verbergen. Het gaat erom dat het eindproduct zijn menselijk publiek op de best mogelijke manier bedient. Wanneer het met integriteit wordt gebruikt, is een AI-detectieverwijderaar een krachtige bondgenoot voor heldere, effectieve en authentieke communicatie.

Hoe kies je een veilige en betrouwbare AI-detectieverwijderaar

Met zoveel tools die de markt overspoelen, kan het kiezen van een betrouwbare AI-detectieverwijderaar aanvoelen als navigeren door een mijnenveld. Laten we duidelijk zijn: niet alle humanizers zijn gelijk. Sommige zijn gewoon opgehemelde parafrasetool die direct bezwijken tegen moderne detectoren, terwijl andere stilletjes je privacy in gevaar kunnen brengen.

Een weloverwogen keuze maken betekent verder kijken dan de opvallende marketingclaims. De juiste tool moet aanvoelen als een betrouwbare partner, eentje die soepel in je workflow past en elke keer consistente, hoogwaardige resultaten levert. Het draait allemaal om focussen op de functies die er echt toe doen voor prestaties, veiligheid en gebruiksgemak.

Belangrijke criteria bij het selecteren van een tool

Wanneer je opties begint te vergelijken, gebruik dan deze checklist om door de ruis te snijden. Deze punten zijn niet onderhandelbaar voor iedereen die serieus is over het produceren van authentieke, ondetecteerbare content zonder de deur te openen voor nieuwe risico's.

Een solide tool moet drie kernbeloften waarmaken:

- Succespercentage bij het omzeilen van detectie: Het hele punt van de tool is om langs detectoren te komen. Zoek naar platforms die transparant zijn over hun succespercentages bij de grote namen zoals GPTZero, Turnitin en Originality.ai. Praktische tip: Gebruik voor je je vastlegt een gratis proefversie. Neem een voorbeeld-AI-tekst, haal het door de humanizer en test dan de output met een gratis AI-detector om de claim te verifiëren.

- Betekenisbehoud: Wat heb je aan ondetecteerbare tekst als het je oorspronkelijke boodschap verminkt? Een echt effectieve tool moet content herschrijven zonder de kernbetekenis te veranderen. Test het met iets genuanceerds. Als het grammaticale fouten uitspuugt of je argument verdraait, is het niet de juiste voor jou.

- Privacy en gegevensbeveiliging: Dit is een grote, en wordt vaak over het hoofd gezien. Een betrouwbare aanbieder heeft een glashelder privacybeleid dat stelt dat je content nooit wordt opgeslagen of gebruikt voor trainingsdata. Als een dienst vaag is over hoe het met je tekst omgaat, loop dan weg.

Gebruiksvriendelijkheid en functies evalueren

Naast deze kerncriteria, denk na over de daadwerkelijke ervaring van het gebruik van de tool. Een lompe, gecompliceerde interface vertraagt je alleen maar, waardoor het hele doel van het gebruik van AI voor meer efficiëntie teniet wordt gedaan. Zoek naar een clean, intuïtief ontwerp dat het humaniseringsproces snel en pijnloos maakt.

Het is ook de moeite waard om de bredere context te vermelden. De digitale wereld worstelt met een golf van geavanceerde fraude, die de explosie in deepfake-technologie weerspiegelt. Zo omzeilden deepfakes liveness-detectie in 2023 704% effectiever, wat het online vertrouwen ernstig ondermijnt. Dit onderstreept alleen maar de groeiende behoefte aan authenticatietechnologieën. Een betrouwbare humanizer helpt ervoor te zorgen dat je content aan de goede kant van die scheidslijn blijft en zijn echte, mensgericht waarde bewijst. Je kunt ontdekken hoe deepfakes het digitale vertrouwen beïnvloeden en zien hoe hoog de inzet wordt.

Jouw vragen, beantwoord

De wereld van AI-content betreden kan een beetje aanvoelen als het Wilde Westen. Het is natuurlijk om vragen te hebben. Hier zijn heldere, eerlijke antwoorden op de meest gestelde vragen over AI-detectieverwijderaars.

Is het legaal om een AI-detectieverwijderaar te gebruiken?

Ja, het gebruik van een AI-detectieverwijderaar is volkomen legaal. In de kern zijn deze tools gewoon geavanceerde parafrasetool of stijleditors, vergelijkbaar met een krachtige grammaticacontrole. De echte vraag is niet over legaliteit – het gaat over hoe je het gebruikt.

Denk er zo over: een humanizer gebruiken om je blogpost op te poetsen of je marketingtekst aan te scherpen is een volkomen standaard en slimme praktijk. Als het echter gaat om schoolwerk, moet je je aan de regels van je instelling houden. De meeste academische integriteitsregels staan erop dat de uiteindelijke inlevering je eigen ideeën en kritisch denken weerspiegelt, dus controleer altijd eerst hun richtlijnen.

Kan gehumaniseerde content alsnog gemarkeerd worden?

Hoewel de beste AI-humanizers ongelooflijk hoge succespercentages hebben, kan geen enkele tool een 100% garantie beloven die eeuwig standhoudt. AI-detectietechnologie wordt voortdurend slimmer, en het is een constant kat-en-muisspel tussen de detectoren en de humanizers.

Dat gezegd hebbende, toptools zijn getraind op enorme bibliotheken van authentiek menselijk schrijfwerk. Dit stelt hen in staat om tekst te produceren die, statistisch gezien, niet te onderscheiden is van wat een mens zou schrijven. Het verlaagt de kans om gemarkeerd te worden door een huidige of toekomstige detector drastisch.

Zal een AI-detectieverwijderaar mijn oorspronkelijke betekenis verpesten?

Een kwalitatieve AI-detectieverwijderaar is van de grond af opgebouwd om de kernbetekenis, feiten en intentie van je tekst te beschermen. Het verwisselt niet zomaar willekeurig woorden. In plaats daarvan herformuleert het zinnen op intelligente wijze en diversifieert het je woordenschat om die menselijke touch toe te voegen.

Het hele punt is om de flow en stijl te verbeteren zonder de inhoud te veranderen. Het is alsof je je concept aan een bekwame redacteur geeft die je proza polijst terwijl je oorspronkelijke boodschap volledig intact blijft. Je werk blijft accuraat en trouw aan je visie.

Klaar om je AI-concepten om te vormen tot ondetecteerbare, menselijk kwalitatieve content? Probeer HumanText.pro vandaag nog uit en ervaar zelf het verschil. https://humantext.pro

Klaar om je AI-gegenereerde content om te zetten in natuurlijk, menselijk geschreven tekst? Humantext.pro verfijnt je tekst direct en zorgt ervoor dat deze natuurlijk leest terwijl AI-detectoren worden omzeild. Probeer onze gratis AI-humanizer vandaag →

Gerelateerde Artikelen

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.