Een gids om AI-detectie te doorstaan en uw inhoud te humaniseren

Ontdek hoe u AI-detectie doorstaat met bewezen strategieën. Onze gids biedt actiegerichte technieken en inzichten om uw inhoud te humaniseren en AI-detectoren te omzeilen.

Als u consequent langs AI-detectoren wilt zeilen, moet u zich eerst in hun hoofden verplaatsen. Het gaat niet om magie; het gaat erom te begrijpen waar ze op getraind zijn om te spotten: voorspelbaarheid en uniformiteit.

Het geheim is om dat schone, logische AI-concept een beetje rommelig te maken – net zoals een mens zou doen. Door opzettelijk uw zinsstructuren te variëren en veelvoorkomende woordkeuzes te vervangen door uniekere, kunt u het enigszins chaotische, natuurlijke ritme van menselijk schrijven nabootsen. Deze handmatige aanpak is de meest betrouwbare manier die ik heb gevonden om inhoud echt ondetecteerbaar te maken.

Begrijpen hoe AI-detectoren werkelijk werken

Tools zoals GPTZero of de AI-detector van Turnitin lezen uw inhoud niet op betekenis of nuance. Ze voeren een wiskundige analyse uit.

Beschouw ze als statistici, niet als literatuurcritici. Ze zijn getraind op enorme bibliotheken van door mensen geschreven tekst, waarbij ze al onze prachtige eigenaardigheden, rommelige gewoonten en onvoorspelbare formuleringen hebben geleerd. Wanneer ze uw artikel scannen, zoeken ze gewoon naar de verradelijke wiskundige vingerafdrukken van een machine.

Er zijn twee grote statistische patronen die Large Language Models (LLM's) achterlaten. Zodra u deze signalen begrijpt, kunt u beginnen ze systematisch te ontmantelen.

Het probleem van lage perplexiteit

Perplexiteit is gewoon een chique term voor hoe voorspelbaar een reeks woorden is. Menselijke schrijvers zijn heerlijk onvoorspelbaar. We gebruiken vreemde uitdrukkingen, creëren vreemde metaforen en combineren woorden op manieren die technisch correct maar statistisch onwaarschijnlijk zijn.

AI-modellen doen op zichzelf het tegenovergestelde. Ze zijn ontworpen om het statistisch meest waarschijnlijke volgende woord te kiezen.

Dit creëert tekst die veilig, logisch en vaak een beetje flauw aanvoelt. Een AI zal bijvoorbeeld zeer waarschijnlijk "De data suggereert..." volgen met "...dat een nieuwe aanpak noodzakelijk is." Het is correct maar saai. Een mens zou kunnen schrijven: "De data schreeuwt naar ons om iets nieuws te proberen." Deze lage perplexiteit is een enorm waarschuwingssignaal voor elke detector.

Belangrijkste conclusie: AI-gegenereerde tekst klinkt vaak als een briljante student die een thesaurus uit zijn hoofd heeft geleerd maar nul levenservaring heeft. Het kiest altijd het meest voorkomende, "correcte" woord, waardoor een voorspelbaar ritme ontstaat dat detectoren van kilometers afstand kunnen herkennen.

Het verradelijke teken van lage burstiness

Burstiness meet de variatie in uw zinlengte en -structuur. Denk aan hoe u praat. U zou een korte, krachtige zin kunnen gebruiken. Dan zou u deze kunnen volgen met een lange, kronkelende die een complexer idee verkent. Dat is hoge burstiness.

AI-modellen hebben vaak moeite met deze natuurlijke cadans. Ze hebben de neiging zinnen van vergelijkbare lengte en structuur te produceren, waardoor een monotone, bijna hypnotische flow ontstaat. Dit uniforme ritme is een andere dode giveaway, een duidelijke digitale vingerafdruk die detectoren gebouwd zijn om te vinden. Dit is een kritiek gebied waar u meer kunt leren over het creëren van undetectable AI-inhoud.

Hier is een snelle uitsplitsing van wat deze detectoren zoeken en hoe u terug kunt vechten.

AI-schrijfpatronen en humaniseringsoplossingen

| AI-detectiesignaal | Wat het in de praktijk betekent | Uw menselijke touch |

|---|---|---|

| Lage perplexiteit | De tekst gebruikt zeer veel voorkomende en voorspelbare woordreeksen. Denk aan "concluderend", "het is belangrijk op te merken", enz. | Verwissel gewone woorden voor interessantere synoniemen. Introduceer idiomen, analogieën of persoonlijke anekdotes. Herformuleer zinnen om minder direct te zijn. |

| Lage burstiness | Zinnen zijn allemaal ongeveer even lang en volgen vergelijkbare grammaticale patronen (bijv. Onderwerp-Werkwoord-Object keer op keer). | Mix actief korte, krachtige zinnen met langere, complexere. Gebruik zinfragmenten voor nadruk. Begin zinnen anders (bijv. met een voorzetseluitdrukking of bijwoord). |

| Uniforme flow | Alinea's zijn vaak van vergelijkbare lengte en de overgangen ertussen voelen geformuleerd aan ("Bovendien", "Daarnaast", "Aanvullend"). | Varieer de alinealengte. Gebruik natuurlijke, gemoedelijke overgangen zoals "Maar hier is het ding", "Laten we nu praten over", of begin gewoon een nieuwe, gerelateerde gedachte. |

| Gebrek aan stem | De toon is neutraal, objectief en mist elke herkenbare persoonlijkheid. Het voelt als een handboek. | Injecteer uw eigen stem. Stel retorische vragen. Gebruik samentrekkingen ("het is" in plaats van "het is"). Voeg persoonlijke meningen of korte zijstappen toe. |

Door uw bewerkingsinspanningen op deze specifieke gebieden te richten, raadt u niet meer alleen maar – u richt zich strategisch op de kernmetrieken waar detectiesystemen op vertrouwen.

In dit constante kat-en-muisspel tussen AI-schrijvers en detectoren is goede ouderwetse handmatige bewerking nog steeds de koning. Er is aangetoond dat het AI-detectiepercentages van verbijsterende 82% naar slechts 21,5% gemiddeld verlaagt. Dat is niet alleen een theorie; dat zien we in test na test over tools zoals GPTZero en Originality.AI.

Door doelbewust te werken aan het verhogen van zowel perplexiteit als burstiness, ondermijnt u direct het hele model van de detector en legt u de basis om dat robotachtige concept in iets echt menselijks te transformeren.

Uw handen vuil maken: Praktische humaniseringstechnieken

Goed, nu u weet waar AI-detectoren naar snuffelen, is het tijd om uw mouwen op te rollen. Dit gaat niet over het verbranden van het hele concept en helemaal opnieuw beginnen. Beschouw uzelf als redacteur, niet alleen als schrijver. U injecteert strategisch een beetje menselijke chaos in de perfecte, steriele orde van de machine.

Uw hoofddoel is om de perplexiteit en burstiness van de tekst handmatig op te voeren. Deze praktische bewerkingen zijn zonder twijfel de meest effectieve manier om langs AI-detectie te zeilen. U verwisselt in wezen voorspelbare, machineachtige patronen voor uw eigen unieke, menselijke vingerafdruk.

Mix uw zinnen om burstiness te verhogen

Het verradelijke teken van een AI-concept is vaak zijn monotone ritme. Zin na zin van vergelijkbare lengte, wat een robotachtige, voorspelbare cadans creëert die een lezer in slaap kan brengen. Uw eerste missie is om dat patroon te doorbreken.

- Varieer de lengte: Mix opzettelijk korte, krachtige zinnen met langere, meer beschrijvende. Een korte zin maakt een punt. Hard. Een langere geeft u ruimte om uit te leggen, kleur toe te voegen en een complexere gedachte op te bouwen.

- Gebruik fragmenten: Soms werkt een enkel woord. Echt. Het is een geweldige manier om nadruk toe te voegen en uw schrijven meer gemoedelijk te laten aanvoelen.

- Verander uw openingen: Laat niet elke zin op dezelfde manier beginnen ("Het bedrijf deed dit", "De software doet dat"). Begin met een voorzetseluitdrukking, een bijwoord of een bijzin om een veel dynamischere flow te creëren.

Hier is een klassiek AI-gegenereerd voorbeeld.

AI-concept: Het marketingteam moet sociale mediaplatforms gebruiken om klantbetrokkenheid te verbeteren. Deze strategie is belangrijk voor het opbouwen van merkloyaliteit. Het bedrijf kan betere resultaten behalen door consequent te posten.

Grammaticaal is het prima. Maar het is volledig zielloos. Laten we er nu wat leven in brengen.

Gehumaniseerde versie: Om echt contact te maken met klanten, moet het marketingteam actief worden op sociale media. Waarom? Omdat het de moderne sleutel is tot het opbouwen van echte merkloyaliteit. Consequent posten, doordachte antwoorden, echte connectie – dat drijft resultaten.

Ziet u het verschil? We hebben de zinlengtes gemengd, een vraag ingegooid en zelfs een fragment gebruikt voor een extra punch. Het ritme voelt onmiddellijk natuurlijker en boeiender aan.

Vervang voorspelbare woorden door boeiendere taal

Verder: perplexiteit. U moet de favoriete dure woorden van de AI opsporen. Taalmodellen zijn getraind op bergen formele tekst, dus ze hebben de neiging te leunen op woorden die officieel klinken maar totaal zonder persoonlijkheid zijn. Tijd voor een "woord-ectomie".

Begin met het maken van een "dodenlijst" van veelvoorkomende AI-woorden en verwissel ze voor natuurlijkere alternatieven. Deze eenvoudige verandering is een krachtpatser om uw inhoud door AI-controles te krijgen.

| Veelvoorkomend AI-woord | Beter menselijk alternatief |

|---|---|

| Gebruiken | Gebruiken, proberen, kiezen voor |

| Naadloos | Makkelijk, soepel, eenvoudig |

| Zich verdiepen in | Kijken naar, verkennen, uitzoeken |

| Bijgevolg | Dus, hierdoor |

| Bovendien | Ook, plus, daarbovenop |

Dit in de praktijk brengen is makkelijk. Laten we nog een stijve, AI-gegenereerde zin nemen.

AI-concept: Bovendien is het absoluut noodzakelijk om zich in de data te verdiepen om een alomvattende strategie te formuleren.

Laten we het nu gewoon zeggen als een persoon.

Gehumaniseerde versie: Plus, we moeten echt in de data graven om een solide plan uit te zoeken.

De betekenis is identiek, maar de toon is een wereld apart. Het is direct, het is gemoedelijk, en het is veel minder voorspelbaar voor een detectiealgoritme.

Actiegerichte tip: Houd een lopende lijst bij van uw eigen "AI-verraadjes" – die merkwaardige woorden die u steeds weer in uw concepten ziet opduiken. Na een paar bewerkingssessies heeft u een aangepast spiekbriefje dat dit proces zoveel sneller maakt.

Injecteer uw authentieke stem en persoonlijkheid

Dit is de laatste en meest cruciale laag. Een AI heeft geen levenservaring. Het heeft geen meningen, geen gevoel voor humor, geen verhalen te vertellen. Het toevoegen van deze uniek menselijke elementen is uw ultieme verdediging tegen detectie, omdat ze per definitie alleen van u kunnen komen.

- Vertel een kort verhaal: Verweef een korte, relevante persoonlijke anekdote. Een zin beginnen met "Ik herinner me toen ik dit voor het eerst probeerde en..." maakt de inhoud onmiddellijk authentieker en herkenbaar.

- Stel retorische vragen: Trek uw lezer in het gesprek. "Maar wat betekent dit eigenlijk voor uw bedrijfsresultaat?" Het dwingt hen te pauzeren en na te denken, waardoor de passieve leeservaring wordt doorbroken.

- Gebruik samentrekkingen: Dit is zo'n eenvoudige maar krachtige truc. "Het is", "u bent" en "niet" schrijven in plaats van "het is", "u bent" en "niet" laat uw toon onmiddellijk natuurlijker en minder als een handboek klinken. AI-modellen vermijden vaak samentrekkingen tenzij u ze specifiek vertelt ze te gebruiken.

- Geef een mening: Wees niet bang om een standpunt in te nemen. Een AI is geprogrammeerd voor neutraliteit, maar mensen hebben perspectieven. Zinnen zoals "In mijn ervaring..." of "Eerlijk gezegd denk ik..." introduceren een persoonlijkheid die algoritmes moeilijk kunnen repliceren.

Deze handmatige bewerkingen doen meer dan alleen u helpen onder de AI-detectieradar te vliegen. Ze transformeren een generiek, vergeetbaar artikel in iets overtuigends dat daadwerkelijk verbinding maakt met een echte persoon. Het is het verschil tussen een machinemonoloog en een menselijk gesprek.

Een herhaalbare workflow bouwen voor het humaniseren van AI-inhoud

Een paar bewerkingstechnieken kennen is één ding. Ze consequent toepassen om AI-inhoud ondetecteerbaar te maken is iets heel anders. Als u echt elke keer AI-detectie wilt doorstaan, heeft u een systeem nodig – een herhaalbaar proces dat het giswerk eruit haalt.

Zonder een solide workflow maakt u alleen willekeurige bewerkingen en hoopt u op het beste. Dat is een recept voor inconsistente resultaten, vooral wanneer u een deadline heeft. Een gestructureerde, meerfasenaanpak stelt u in staat om u in elke fase op specifieke verbeteringen te richten, waardoor het hele proces sneller en veel effectiever wordt.

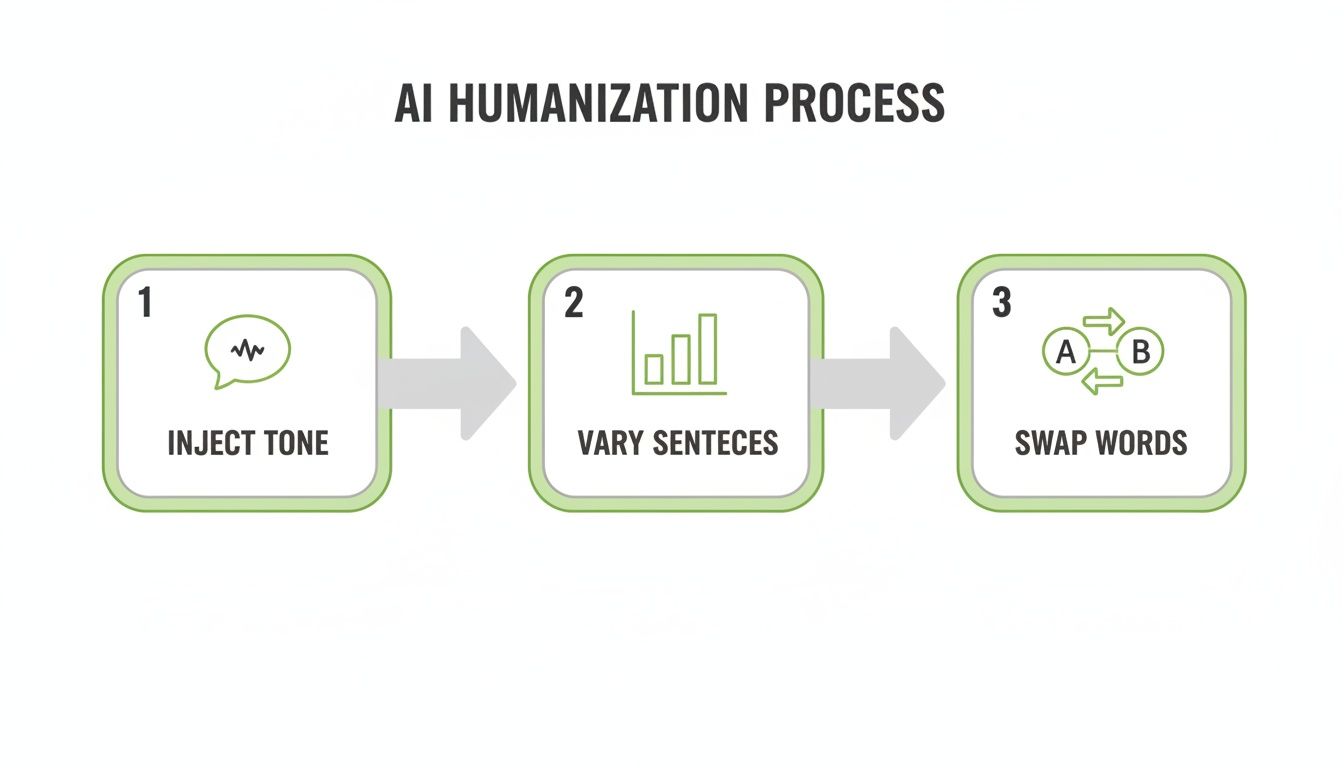

Beschouw het als een kwaliteitscontrolelijst voor het transformeren van robotachtige tekst in iets met een echte hartslag. Dit stroomdiagram splitst het kernidee uit in drie eenvoudige, gefocuste fasen.

Zoals u kunt zien, gaat het niet om één magische oplossing. Het gaat om het lagen van uw bewerkingen, beginnend met het grote geheel en stem en vervolgens doorboren naar de woord-voor-woord details.

Eerste ronde: Het grote plaatje & stembewerking

Uw eerste doorlezing is niet voor het vinden van typefouten of het verwisselen van woorden. Het gaat om de grote dingen: structuur, flow en het belangrijkst, stem. Een rauw AI-concept kan feitelijk correct zijn, maar het mist bijna altijd een echt standpunt. Hier maakt u het artikel van u.

Lees het hele concept van begin tot eind. Vloeit het eigenlijk als een echt gesprek, of voelt het als een handboek? Is er enige persoonlijkheid, of is het gewoon een droge opsomming van feiten?

- Injecteer uw perspectief: Dit is het krachtigste humaniseringssignaal dat u heeft. Voeg persoonlijke anekdotes, meningen of unieke inzichten toe. Een eenvoudige zin zoals "In mijn ervaring..." of "Dit is wat ik heb geleerd..." is iets dat een AI gewoon niet authentiek kan faken.

- Herstel de narratieve flow: AI legt informatie vaak op pijnlijk lineaire wijze uit. Doorbreek dat voorspelbare patroon. Verplaats alinea's om spanning op te bouwen, een sterker argument te creëren, of het gewoon een interessantere lezing te maken.

- Pas de toon aan: Is de toon juist voor uw publiek? AI gebruikt standaard vaak een formele, academische stem wanneer u iets informelere en boeiendere nodig heeft. Nu is de tijd om dat algemene gevoel in te stellen voordat u vastloopt in de details.

Deze eerste ronde draait allemaal om het transformeren van het logische skelet van de AI in inhoud met een menselijke hartslag.

Mijn persoonlijke tip: Ik lees het ruwe AI-concept altijd hardop bij mijn eerste ronde. Uw oren zullen dingen opvangen die uw ogen missen – monotone zinritmes, onhandige formuleringen en robotachtige zinnen. Als het raar klinkt wanneer u het zegt, zal het zeker raar lezen.

Tweede ronde: De polijsting op zinsniveau

Oké, met de structuur en stem op slot, is het tijd om chirurgisch te worden. Deze tweede ronde draait allemaal om de details op zinsniveau. Uw doel hier is om de lage perplexiteits- en lage burstiness-signalen direct aan te vallen die AI-detectoren getraind zijn om te vinden. U maakt de tekst statistisch rommelig, net als menselijk schrijven.

Hier is uw checklist voor deze ronde:

- Varieer zinlengte: Jaag op alinea's waar elke zin ongeveer dezelfde lengte heeft. Dit is een dode giveaway. Combineer twee korte zinnen of breek een lange op om een dynamischer, natuurlijker ritme te creëren.

- Verwissel voorspelbare woorden: Vind en elimineer veelvoorkomende AI-krukwoorden. Kom van "gebruiken", "naadloos", "verdiepen" en "bovendien" af. Vervang ze door natuurlijkere, gemoedelijkere alternatieven.

- Gebruik samentrekkingen: Verander "het is" naar "het is" en "u zult" naar "u zult". Dit is een doodsimpele bewerking die de tekst onmiddellijk minder stijf en menselijker laat aanvoelen.

- Voeg retorische vragen toe: Trek de lezer in het gesprek. Een vraag inwerpen zoals "Maar hoe werkt dat eigenlijk in de praktijk?" doorbreekt de passieve flow en bootst na hoe echte mensen praten en denken.

Deze ronde gaat niet over het herschrijven van enorme secties. Het gaat om het maken van kleine, gerichte veranderingen die, wanneer gecombineerd, een enorme impact hebben op de detectiescore.

Laatste ronde: De uiterst belangrijke testfase

U zou een website niet lanceren zonder deze op verschillende browsers te testen, toch? Dezelfde logica geldt hier. Publiceer uw inhoud niet zonder deze door een paar verschillende AI-detectoren te laten lopen.

Vertrouwen op een enkele tool is een van de grootste fouten die mensen maken. Elke detector gebruikt een iets ander algoritme, dus wat op de ene slaagt, kan op de andere worden gemarkeerd.

Ik raad aan om te kruisverwijzen met minstens twee of drie toonaangevende tools – denk aan GPTZero, Originality.ai en de detector van Turnitin als u toegang heeft. Uw doel is om een consensus te krijgen.

Wanneer de resultaten terugkomen, kijk dan niet alleen naar de algemene score. Het echte goud zit in de delen die ze markeren. De meeste detectoren tonen u de exacte zinnen waarvan ze denken dat ze AI-gegenereerd zijn. Ga terug naar die gemarkeerde secties en pas een nieuwe ronde humaniserende bewerkingen toe. Misschien moet u een complexe zin herformuleren of nog een voorspelbaar woord verwisselen. Vaak zijn deze laatste, gerichte aanpassingen alles wat u nodig heeft om een "menselijk geschreven" score over de hele linie te krijgen.

De juiste AI-humaniseringstool voor de klus kiezen

Goed, u heeft een solide humaniseringsworkflow. Nu denkt u misschien na over het toevoegen van een speciale tool om dingen te versnellen. Maar hier is het probleem: de markt is absoluut overspoeld met opties, en eerlijk gezegd zijn de meeste uw tijd niet waard.

De verkeerde kiezen verspilt niet alleen geld; het verspilt uren van uw dag en laat u achter met inhoud die nog steeds wordt gemarkeerd door AI-detectoren. Het is frustrerend.

De echte truc is het verschil kennen tussen een eenvoudige "parafraseerder" en een echte AI-humaniseerder. Een basale spinneertool verwisselt alleen woorden voor synoniemen – een ouderwetse truc die moderne detectoren zoals Turnitin doorzien. Een echte humaniseerder is een heel ander beest. Het is getraind op enorme bibliotheken van door mensen geschreven tekst om zinnen fundamenteel te herstructureren, gevarieerde syntaxis te introduceren en de toon precies goed af te stemmen om onder de radar te vliegen.

Kerncriteria voor het evalueren van een tool

Wanneer u een tool beoordeelt, negeer de opvallende marketingbeloften. Uw beslissing moet neerkomen op een handvol niet-onderhandelbare criteria die de effectieve tools scheiden van de verheerlijkte thesauri.

Uiteindelijk is de enige vraag die ertoe doet: werkt het daadwerkelijk? Zoek naar tools die transparant zijn over hun succespercentages tegen een reeks populaire detectoren, niet slechts één waarvan ze weten dat ze hem kunnen verslaan.

Hier is wat ik altijd controleer:

- Detectieomzeilingspercentage: Krijgt de tool consequent een "menselijke" score op moeilijke platforms zoals GPTZero, Originality.ai en Sapling? Een betrouwbare tool moet effectief zijn tegen meerdere algoritmes.

- Betekenisbehoud: De output moet zeggen wat u oorspronkelijk bedoelde. Als de tool uw tekst herschrijft tot iets dat feitelijk verkeerd of gewoon onzin is, is het volledig nutteloos.

- Bruikbaarheid: De interface moet schoon, snel en intuïtief zijn. U zou niet met de software moeten hoeven vechten om een resultaat te krijgen; het zou soepel moeten passen in hoe u al werkt.

Het helpt ook om te begrijpen wat u in de eerste plaats probeert te repareren. Spelen met een tool zoals een AI Post Generator geeft u een gevoel voor het soort robotachtige output dat u moet humaniseren. Deze context helpt u de subtiele maar kritieke verbeteringen waarderen die een goede humaniseerder maakt.

De over het hoofd geziene factor: Gegevensprivacy

Dit is het enige wat de meeste mensen vergeten te controleren, en het is aantoonbaar het belangrijkste. Wanneer u uw artikel in een willekeurige online tool plakt, waar gaan die gegevens naartoe? Sommige diensten slaan uw tekst op en zouden deze zelfs kunnen gebruiken om hun eigen AI-modellen te trainen.

Dat is een enorm risico. Uw inhoud – of het nu voor een klant is, een gevoelig onderzoekspaper of het volgende grote marketingplan van uw bedrijf – is uw intellectuele eigendom. Het overhandigen aan een dienst met een twijfelachtig privacybeleid is een gok die u gewoon niet zou moeten nemen.

Privacy-check: Lees altijd, altijd het privacybeleid van de tool. Zoek naar expliciete garanties dat uw tekst niet zal worden opgeslagen, gedeeld of gebruikt voor trainingsdoeleinden. Een betrouwbare dienst zal deze belofte duidelijk en vooraf maken.

Een tool kiezen die uw privacy respecteert, zorgt ervoor dat uw werk van u blijft en alleen van u. Voor een diepgaande duik in welke tools aan deze normen voldoen, bekijk onze gedetailleerde uitsplitsing van de best AI humanizer-opties.

Van basis tot geavanceerd: Een snelle vergelijking

Om dit allemaal in perspectief te plaatsen, laten we kijken naar de verschillende lagen van tools die er zijn. Deze hiërarchie kennen helpt u precies te bepalen wat u nodig heeft voor uw specifieke kwaliteits- en ondetecteerbaarheidsdoelen.

| Tooltype | Hoe het werkt | Gemeenschappelijk resultaat |

|---|---|---|

| Eenvoudige parafraseerder | Verwisselt individuele woorden voor synoniemen. Kan zinsdelen licht herschikken. | Klinkt vaak onhandig of "gespind". Faalt bij de meeste moderne AI-detectoren. |

| Basis AI-herschrijver | Gebruikt AI om zinnen één voor één te herschrijven. Mist een holistisch beeld van de tekst. | Verbetert op parafraseren maar heeft nog steeds een robotachtig gevoel. Worstelt met moeilijke detectoren zoals Turnitin. |

| Geavanceerde humaniseerder | Herbouwt tekst met modellen getraind op menselijk schrijven. Focust op flow, ritme en structuur. | Produceert natuurlijke, ondetecteerbare output die de oorspronkelijke betekenis behoudt. |

Aan het eind van de dag bespaart investeren in een geavanceerde humaniseerder een hoop bewerkingstijd en geeft u een eindproduct waar u op kunt vertrouwen. Het is het meest betrouwbare pad om consequent AI-detectie te doorstaan zonder de kwaliteit van uw inhoud op te offeren.

AI-humaniseerders ethisch en verantwoordelijk gebruiken

Uw inhoud laten AI-detectie doorstaan is één ding. Het verantwoordelijk doen is iets heel anders. Er is een scherpe lijn tussen het gebruik van AI als krachtige assistent en het gebruik ervan om mensen ronduit te misleiden, en die lijn wordt getrokken met intentie. Het is het verschil tussen het stroomlijnen van uw workflow en het plegen van academische fraude of gewoon het internet overspoelen met laagwaardige, geautomatiseerde rommel.

Het doel is niet alleen om ondetecteerbaar te zijn. Het is om hoogwaardig, eerlijk werk te produceren waar u daadwerkelijk achter kunt staan. Wanneer u vanaf het begin ethisch denkt, zorgt u ervoor dat het eindproduct integriteit heeft, of u nu een essay indient bij een professor of een artikel publiceert voor uw publiek.

De duidelijke lijn voor studenten

Voor studenten zijn de regels behoorlijk niet-onderhandelbaar. Universiteiten bouwen hun academische integriteitsbeleid op origineel denken, kritische analyse en juiste citatie. Een AI-gegenereerd essay nemen, het door een humaniseerder laten lopen en het indienen bij een systeem zoals Turnitin is geen slimme oplossing – het is een duidelijke schending van die principes.

Die hele aanpak mist het punt van de opdracht in de eerste plaats, namelijk leren, informatie synthetiseren en uw eigen unieke argumenten articuleren. De ethische manier om AI op school te gebruiken ziet er totaal anders uit.

- Brainstormen en schetsen: AI gebruiken om uw werk op gang te brengen door onderwerpen te verkennen, een schets te structureren of grip te krijgen op complexe ideeën is volkomen legitiem.

- Conceptondersteuning: Het kan een geweldige tool zijn om een onhandige zin te herformuleren of een beter woord te vinden, bijna als een super-aangedreven thesaurus.

- Nooit voor eindpresentatie: De kern van het werk – de argumenten, de analyse, de conclusies – moet van u zijn. Punt.

Belangrijkste conclusie: Beschouw een AI-humaniseerder als laatste oppoetser voor uw eigen ideeën, niet als ghostwriter voor werk dat u niet heeft gedaan. Zodra het wordt gebruikt om krediet te nemen voor denken dat niet van u is, heeft u een serieuze ethische lijn overschreden.

Best practices voor professionals

Voor marketeers, schrijvers en SEO's gaat het ethische spel meer over publieksvertrouwen en inhoudskwaliteit. Uw lezers komen naar u voor expertise, authenticiteit en echte waarde. Gewoon een generiek AI-concept humaniseren en op "publiceren" drukken is een snelle manier om dat vertrouwen te verraden en uw merk te beschadigen.

In een professionele setting betekent verantwoordelijkheid het beschermen van de unieke stem van uw merk en ervoor zorgen dat elk stuk inhoud feitelijk correct en echt nuttig is. Uw reputatie is gebouwd op de kwaliteit van uw werk, niet op de hoeveelheid.

Hier is een snelle checklist om dingen ethisch en verantwoordelijk te houden:

- Controleer alles op feiten: AI-modellen zijn berucht om dingen te verzinnen. Dit fenomeen, vaak "hallucinatie" genoemd, is een echt probleem. Verifieer altijd, altijd elke statistiek, claim en citaat met een gerenommeerde bron.

- Injecteer echte expertise: Gebruik het AI-concept als skelet. De echte waarde – het vlees – komt wanneer u uw eigen inzichten, persoonlijke ervaringen en branchespecifieke kennis toevoegt die geen machine ooit zou kunnen hebben.

- Behoud uw merkstem: Een humaniseerder kan zinsstructuren gladstrijken, maar u bent de bewaker van de persoonlijkheid van uw merk. Zorg ervoor dat de eindtekst klinkt als u, niet als een generieke robot.

- Handhaaf gegevensprivacy: Als professional is het ethisch omgaan met gegevens niet-onderhandelbaar. Als u AI-tools in een zakelijke context gebruikt, is het de moeite waard om een AI GDPR Compliance Guide te bekijken om ervoor te zorgen dat u al uw juridische en ethische bases gedekt heeft.

Aan het eind van de dag is de meest ethische aanpak ook de meest effectieve. Inhoud die zorgvuldig is bewerkt, op feiten is gecontroleerd en doordrenkt is van echte menselijke expertise doorstaat niet alleen AI-detectie – het presteert beter bij zoekmachines en maakt dieper contact met uw publiek. Het doel is om uw intelligentie te versterken, niet te vervangen.

Een paar veelgestelde vragen over het omzeilen van AI-detectoren

Zelfs met een solide spelplan duiken er altijd een paar vragen op wanneer u probeert AI-gegenereerde tekst onder de radar te laten vliegen. Laten we enkele van de meest voorkomende aanpakken die ik hoor. Deze uitzoeken zal u helpen met veel meer vertrouwen te bewerken.

Kunnen AI-detectoren ooit 100% nauwkeurig zijn?

Nee. En het is behoorlijk onwaarschijnlijk dat ze dat ooit zullen zijn.

U moet AI-detectoren beschouwen als probabilistische tools, niet als onfeilbare rechters. Ze zijn gebouwd om statistische patronen te herkennen die de neiging hebben op te duiken in machineschrijven. Ze hebben niet te maken met zekerheden, wat betekent dat ze het vaak mis hebben.

- Fout-positieven: Dit is wanneer de detector "AI!" schreeuwt bij iets dat een mens heeft geschreven. Het is gebruikelijk bij eenvoudig, feitelijk schrijven dat van nature geen complexe zinsstructuren heeft.

- Fout-negatieven: Dit is het tegenovergestelde – een AI-gegenereerd stuk glipt volledig onopgemerkt door. Een beetje slimme bewerking is vaak alles wat nodig is om het algoritme te misleiden.

Hier is een betere manier om ernaar te kijken: De score van een detector is geen vonnis. Het is een gids. Een hoge AI-score markeert alleen de zinnen die het meest robotachtig klinken, en toont u precies waar u uw bewerkingsinspanningen op moet richten. Als een tool bijvoorbeeld "Het is cruciaal om het nieuwe systeem te implementeren" markeert, weet u het te veranderen in iets als "Kijk, we moeten dit nieuwe systeem aan de praat krijgen."

Zal het humaniseren van mijn AI-inhoud mijn SEO schaden?

Het is eigenlijk precies andersom – het zal het vrijwel zeker helpen. Dit is een enorm misverstand dat voortkomt uit angst voor een Google-boete. Maar als u nadenkt over wat Google eigenlijk wil, sluit het humaniseren van uw inhoud perfect aan bij hun doelen.

Zoekmachines zijn ontworpen om inhoud te belonen die nuttig, betrouwbaar is en de lezer een goede ervaring biedt. Dit is het hele punt van Google's E-E-A-T (Experience, Expertise, Authoritativeness, and Trustworthiness)-richtlijnen.

Generieke, robotachtige AI-tekst bombarneert op al deze fronten. Het heeft niet de unieke stem of eerstehands ervaring die echte expertise signaleert. Wanneer u die tekst herschrijft om authentieker en boeiender te zijn, maakt u het beter voor mensen. En inhoud beter maken voor mensen is het beste signaal dat u mogelijk naar zoekmachines kunt sturen. Als u dieper wilt gaan, kunt u ook lezen over of undetectable AI echt werkt in onze uitgebreide gids.

Is het verkeerd om tools te gebruiken om AI-detectie te doorstaan?

De ethiek hier komt echt neer op twee dingen: uw intentie en het eindproduct. De tool zelf is gewoon code; wat u ermee doet is wat telt.

Als u AI gebruikt om een schrijversblok te doorbreken of een eerste concept te schetsen, en vervolgens die output zorgvuldig bewerkt om uw eigen kennis en stem te weerspiegelen, is dat gewoon een slimme workflow. U gebruikt een tool om uw eigen intelligentie te ondersteunen, niet om deze te vervangen.

De ethische lijn wordt overschreden wanneer het doel is om te misleiden.

- Voor studenten: Een AI-gegenereerd essay indienen dat alleen door een humaniseerder is gehaald, is academische oneerlijkheid, simpel gezegd. Het hele punt van een opdracht is om te leren en kritisch te denken.

- Voor professionals: De standaard is eenvoudig: bent u eerlijk en biedt u waarde? Als een tool u helpt om echt nuttige, hoogwaardige inhoud voor uw publiek efficiënter te produceren, gebruikt u het verantwoordelijk. Als u het gebruikt om laagwaardige, onnauwkeurige artikelen uit te pompen alleen omwille van het volume, is dat onethisch en zal het uiteindelijk uw merk zinken.

De verantwoordelijke aanpak is behoorlijk duidelijk. Gebruik AI als uw startblok, maar zorg er altijd voor dat het eindstuk op feiten is gecontroleerd, gevuld is met uw eigen unieke perspectief en daadwerkelijk de lezer helpt. Zo creëert u inhoud die niet alleen "ondetecteerbaar" is, maar echt goed.

Klaar om je AI-gegenereerde content om te zetten in natuurlijk, menselijk geschreven tekst? Humantext.pro verfijnt je tekst direct en zorgt ervoor dat deze natuurlijk leest terwijl AI-detectoren worden omzeild. Probeer onze gratis AI-humanizer vandaag →

Gerelateerde Artikelen

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.