Hva er en AI-deteksjonsfjerning og hvordan fungerer den?

Oppdag hva en AI-deteksjonsfjerning er og hvordan den hjelper deg med å komme forbi AI-detektorer. Lær om teknologien, etisk bruk og hvordan du velger riktig verktøy.

Så, hva er egentlig en AI-deteksjonsfjerning? Tenk på det som en spesialisert redigerer for AI-generert tekst. Disse verktøyene tar innhold som høres litt stivt eller robotaktig ut og skriver det om slik at det flyter naturlig, noe som hjelper det å gli forbi AI-deteksjonsprogramvaren som blir stadig mer vanlig.

Hvis du bruker AI som hjelp i skrivingen din, er et verktøy som dette praktisk talt et must. Det hjelper deg med å foredle de maskinproduserte førsteutkastene til engasjerende, polert innhold som ikke blir flagget. For eksempel kan du ta et AI-generert avsnitt for en markedsførings-e-post, kjøre det gjennom verktøyet og få tilbake en versjon som høres varmere og mer overbevisende ut, klar til å sendes til kundene dine.

Den nye utfordringen med AI-innholdsdeteksjon

Internett flommer over av innhold akkurat nå, og en enorm del av det kommer fra kraftige AI-verktøy som gjør det nesten umiddelbart å skrive artikler, essays og rapporter. Denne eksplosjonen i AI-drevet innholdsproduksjon har satt i gang en helt ny utfordring: å skille mellom hva et menneske har skrevet og hva en maskin har generert.

Denne massive tilstrømningen har startet et digitalt katt-og-mus-spill. For å håndtere bølgen av automatisert tekst har søkemotorer, universiteter og store innholdsplattformer rullet ut sofistikerte AI-detektorer. Disse systemene er trent til å oppdage de subtile, avslørende tegnene på AI – de forutsigbare setningsstrukturene, mangelen på en unik stemme – og flagge alt som ikke føles helt menneskelig.

Problemet for moderne skapere

Dette skaper en reell hodepine for mange mennesker. Markedsførere, studenter og skribenter som stoler på AI for å jobbe raskere, risikerer nå å bli straffet. Arbeidet deres, selv om det er godt forsket og genuint verdifullt, kan bli nedrangert eller stilt spørsmål ved bare fordi en AI bidro i utkastprosessen.

Omfanget av dette er svimlende. Innen 2025 forutsier noen analytikere at 30–40 % av all tekst på nettet vil komme fra AI-systemer. Andre prognoser er enda dristigere og antyder at dette tallet kan nå 90 % innen slutten av året.

Det er akkurat her en AI-deteksjonsfjerning blir en uunnværlig del av den moderne skribentens verktøykasse. Det handler ikke om å jukse eller være uærlig. Det handler om å ta et solid AI-generert utkast og polere det til det høres autentisk og menneskelig ut.

Foredle, ikke villede

Målet her er enkelt: å bevare din egen stemme og sørge for at arbeidet ditt vurderes etter ideene sine, ikke opprinnelsen sin. Denne prosessen lar deg beholde hastigheten og effektiviteten til AI uten å ofre kvaliteten og autentisiteten i det endelige stykket.

Ved å gjøre AI-tekst uoppdagbar kan du unngå urettferdige straffer samtidig som du fortsatt produserer godt arbeid. Målet er å:

- Forbedre lesbarheten: Forvandle klønete, robotaktige setninger til prosa som flyter jevnt og naturlig. For eksempel, endre "Anvendelsen av denne metodikken resulterer i en økning i effektivitet" til "Å bruke denne metoden gjør ting mer effektivt."

- Bevare originaliteten: Behold kjernebudskapet og ideene i utkastet ditt intakt mens du hever måten de formidles på. Verktøyet skal endre stilen, ikke substansen.

- Unngå straffer: Sørg for at innholdet ditt får grønt lys fra detektorer brukt av plattformer som Google eller akademiske institusjoner.

Til syvende og sist bygger disse verktøyene bro over gapet mellom maskineffektivitet og menneskelig kreativitet. De bidrar til å sikre at sluttproduktet ditt ikke bare er effektivt, men genuint autentisk.

Hvordan AI-detektorer oppdager maskinskrevet tekst

For å få mest mulig ut av en AI-deteksjonsfjerning må du først vite hva du står overfor. Tenk på en AI-detektor som en lingvistisk detektiv, men i stedet for å lete etter fingeravtrykk skanner den etter de subtile, nesten usynlige sporene til en maskin. Den leter ikke etter ett enkelt avslørende tegn, men et helt mønster av robotaktige trekk.

Disse digitale etterforskerne er trent på kolossale datasett fylt med millioner av eksempler på både menneskelig og AI-generert skriving. Dette dype dykket i data, inkludert en forståelse av GPT og Transformer-mekanismer, lærer dem å oppdage statistiske mønstre som selv en erfaren redaktør ville oversett.

De avslørende tegnene på AI-skriving

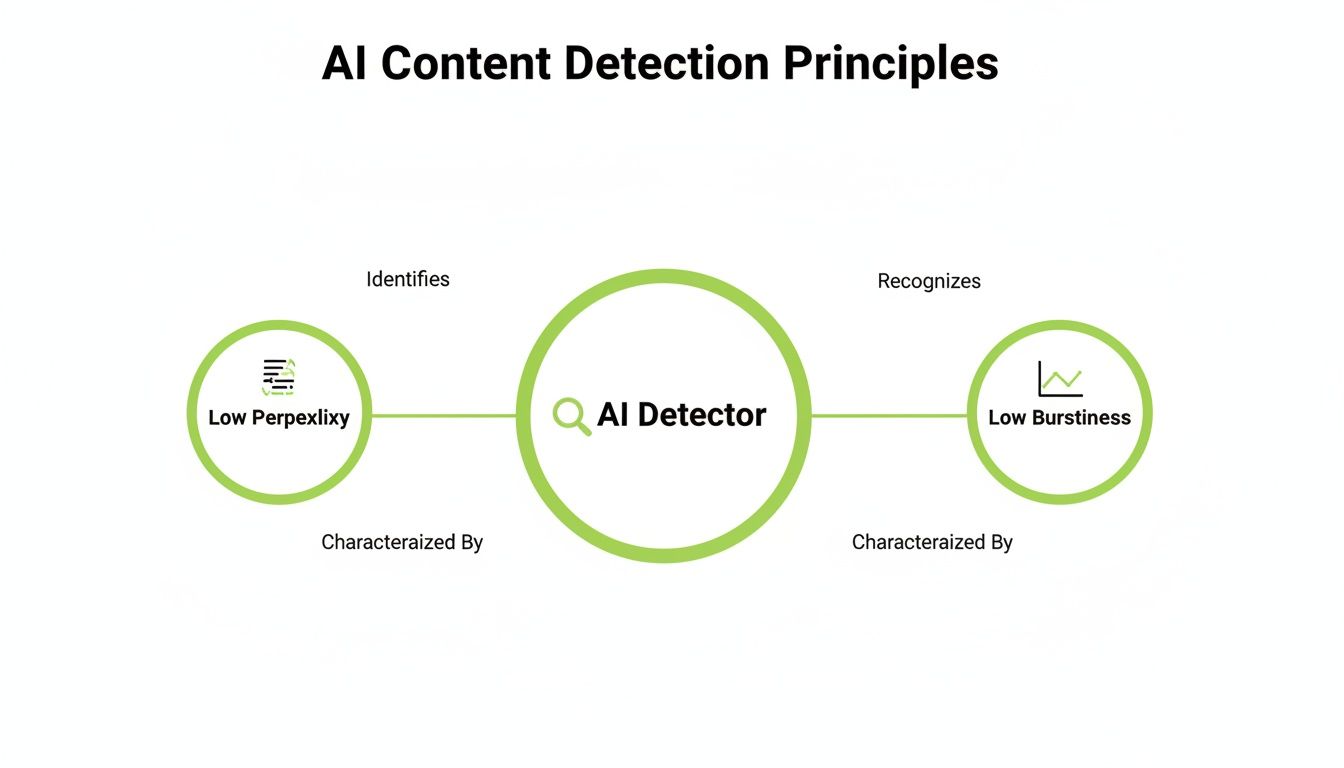

Når en AI-detektor skanner et innhold, ser den primært på to nøkkelmålinger: perpleksitet og burstighet. Disse kan høres ut som høyteknologisk sjargong, men de er faktisk enkle konsepter. Å forstå dem er det første steget mot å lage innhold som flyr under radaren.

- Perpleksitet (Forutsigbarhet): Dette er bare en fancy måte å måle hvor forutsigbar skrivingen din er. AI-modeller er programmert til å velge det statistisk mest sannsynlige ordet etter det forrige. Dette skaper tekst som er grammatisk perfekt, men ofte føles flat, intetsigende og litt for enkel. Den mangler overraskelse.

- Burstighet (Rytme og flyt): Dette måler den naturlige variasjonen i setningsstruktur. En menneskelig skribent kan lage en lang, svingete setning for å utforske en kompleks tanke, og deretter følge den med en kort, skarp setning for å understreke poenget. Dette skaper en dynamisk, "burstig" rytme.

AI-generert tekst bommer ofte på denne naturlige kadensen. Setningene har en tendens til å være ensartede i lengde og struktur, noe som skaper en monoton, nesten hypnotisk rytme som detektorer er trent til å flagge. Det er forskjellen mellom et håndlaget trebord med unike åremønstre og et perfekt glatt, maskinformet plastprodukt.

Menneskelig skriving er i sin natur variert. Den har oppturer og nedturer, med en blanding av enkle og komplekse setninger. AI-tekst mister ofte denne rytmen og velger en konsistent, ensartet struktur som føles unaturlig perfekt.

Praktiske eksempler på AI-avsløringer

La oss gjøre dette konkret. En AI kan generere noe som: "Hunden løp over jordet. Hunden var veldig rask. Hunden likte løpeturen." Legg merke til hvordan setningene er enkle, repetitive og totalt forutsigbare. Dette er et klassisk eksempel på lav perpleksitet og lav burstighet.

En menneskelig skribent kan male det samme bildet med mer burstighet: "Sluppet løs sprintet den gylne retrieveren over det åpne jordet, en uskarphet av pels og uhemmet glede. For en sprint!" Setningslengdene er forskjellige, ordforrådet er rikere, og hele greia føles bare mer autentisk. En AI-deteksjonsfjerning har som mål å utføre nøyaktig denne typen transformasjon automatisk.

Å forstå disse grunnleggende prinsippene er alt. En god AI-deteksjonsfjerning bytter ikke bare ut noen ord her og der. Den omskriver teksten fundamentalt for å injisere den naturlige perpleksiteten og burstigheten som detektorer leter etter. Du kan lære mer om denne prosessen og oppdage om uoppdagbar AI virkelig fungerer i vår detaljerte guide. Denne kunnskapen er nøkkelen din til å forvandle robotaktige utkast til innhold som genuint berører folk.

Teknologien bak en AI-deteksjonsfjerning

Så, hvordan klarer et verktøy som dette faktisk å utføre tryllekunsten med å gjøre AI-tekst usynlig for detektorer? Det er ikke bare en fancy synonymordbok som bytter ut ord. Tenk på det mindre som en enkel omskriver og mer som en dyktig digital håndverker, som tar et robotaktig utkast og omhyggelig omformer det med en menneskelig berøring.

Disse verktøyene er bygget på sofistikerte språkmodeller som har blitt matet med en massiv diett av genuint menneskelig skriving – millioner av artikler, essays og rapporter. I stedet for bare å endre ord, rekonstruerer de teksten fullstendig fra bunnen av. De analyserer alt fra setningsstruktur og ordforråd til den overordnede rytmen, og jakter på de avslørende mønstrene som AI-detektorer er bygget for å oppdage.

Slette de digitale fingeravtrykkene

Hovedmålet er å øke tekstens perpleksitet og burstighet – de to nøkkelmålingene vi snakket om tidligere. AI-skriving har en tendens til å være veldig forutsigbar og jevn. Ved å blande setningslengder, introdusere mer komplekse strukturer og bruke mindre vanlige ordvalg, knuser verktøyet den monotone konsistensen.

Praktisk tips: Før du humaniserer en tekst, prøv å lese den høyt. Hvis den høres monoton ut eller mangler en naturlig rytme, har den lav burstighet. En god humaniserer vil fikse dette ved å variere setningslengde og struktur. For eksempel kan den kombinere to korte setninger til en kompleks setning eller bryte en lang setning i kortere, mer slagkraftige fraser.

Som du kan se, er kombinasjonen av lav perpleksitet og lav burstighet det klassiske kjennetegnet på AI-generert innhold, som skaper et tydelig signal som detektorer er trent til å fange opp.

Hele denne prosessen handler ikke bare om å få teksten til å høres bedre ut. Det handler om å metodisk slette de statistiske "avsløringene" som skriker "en maskin skrev dette!" Verktøyet forvandler et utkast som kan være grammatisk perfekt men fullstendig sjellest til noe som leses som om det ble skrevet av et menneske helt fra starten, alt mens den opprinnelige meningen og ideene bevares intakt.

Hvordan avanserte humaniserere får jobben gjort

De beste verktøyene tar dette et enormt steg videre ved å støtte seg på enorme datasett av høy kvalitet. En førsteklasses AI-deteksjonsfjerning bruker avansert lingvistisk modellering for å skape tekst som høres genuint naturlig ut.

En AI-deteksjonsfjerning som HumanText.pro konverterer AI-utkast til menneskelignende tekst som passerer detektorer som GPTZero og Turnitin med 99 % suksessrate. Dette er mulig fordi modellene ble trent på 1,2 millioner menneskelige skriveprøver for å garantere autentisitet.

Denne typen dyp trening gjør det mulig for verktøyet å produsere uoppdagbare essays, blogger og andre profesjonelle dokumenter. Det beskytter også brukernes personvern ved å ikke lagre noe innhold og tilbyr umiddelbare prøveperioder for å teste det ut. Du kan dykke dypere inn i de bredere bransjetrendene med denne statistikken og funnene om kunstig intelligens.

Ved å fokusere på disse dype strukturelle og stilistiske endringene tilbyr en AI-humaniserer en solid løsning for alle som trenger å polere sitt AI-assisterte arbeid til noe uoppdagbart. Det er den essensielle broen mellom maskineffektivitet og autentisk menneskelig uttrykk.

Bruk av AI-deteksjonsfjerning etisk og effektivt

La oss slå fast én ting: en AI-deteksjonsfjerning er ikke et tryllestav for akademisk uredelighet. Å tenke på det slik bommer helt på poenget. Se det heller som et finpussingsverktøy – en polerer for innhold som starter med AI, men ender med menneskelig innsikt og kreativitet.

Etikken rundt bruk av en humaniserer koker helt ned til intensjonen din. Prøver du å fremstille et rått, uredigert AI-utkast som ditt eget geniale verk? Det er et problem. Eller bruker du det til å foredle et AI-assistert utkast, jevne ut det robotaktige språket slik at dine egne ideer kan skinne gjennom? Det er bare smart arbeidsflyt.

Praktisk tips: Den mest etiske arbeidsflyten er en hybrid. Bruk AI for de første 70 % (research, disposisjon, utkast), og bruk deretter en humaniserer for de neste 20 % (språkpolering). De siste 10 % bør alltid være din egen gjennomgang – faktasjekking, tilføying av personlige anekdoter og sikring av at tonen samsvarer med merkevaren din eller den akademiske stemmen din.

Virkelige scenarioer for etisk bruk

Så, hvordan ser dette ut i praksis? Det handler ikke om å jukse; det handler om å overvinne virkelige flaskehalser uten å ofre kvalitet. Nøkkelen er alltid å tilføre din egen verdi, ikke å omgå arbeidet.

Her er et par vanlige, ansvarlige måter folk bruker disse verktøyene på:

For innholdsmarkedsførere: Et markedsføringsteam har et ambisiøst mål: publisere 10 blogginlegg av høy kvalitet per uke for å drive SEO-strategien sin. De bruker AI til å generere førsteutkast fra detaljerte briefer, noe som sparer hundrevis av timer. Deretter bruker de en humaniserer for å polere språket, gjøre det mer engasjerende og sikre at det ikke blir flagget av spamfiltre. De kan skalere produksjonen uten å høres ut som roboter.

For studenter: En historiestudent tar fatt på et komplekst essay. De bruker AI til å få en grunnleggende disposisjon og organisere forskningen sin. Etter å ha skrevet hele essayet selv, kjører de det gjennom en humaniserer for å jevne ut klønete formuleringer og forbedre den overordnede flyten. Dette hjelper den unike analysen deres med å komme tydelig frem, og verktøyet brukes som en sofistikert korrekturleser snarere enn en ghostwriter.

Å bruke en AI-deteksjonsfjerning ansvarlig handler om å bygge bro over gapet mellom maskineffektivitet og menneskelig kreativitet. Det gir deg muligheten til å foredle AI-generert innhold til et sluttprodukt som er polert, autentisk og tilfører genuint verdi.

Profesjonelle som polerer kommunikasjonen sin

Behovet for en menneskelig berøring strekker seg langt utover innholdsteam og klasserom. For enhver profesjonell er det å skrive rapporter, lage presentasjoner eller svare på kunde-e-poster en daglig rutine. AI kan lage en mal eller et førsteutkast på sekunder, noe som sparer enormt med tid.

Men å sende en generisk, maskinskrevet e-post kan skade et kundeforhold. Ved å kjøre utkastet gjennom en AI-deteksjonsfjerning kan du sikre at den endelige meldingen høres personlig, profesjonell og autentisk ut. Det handler om å opprettholde en menneskelig kontakt i en verden som beveger seg raskere enn noensinne.

Å forstå disse anvendelsene er det første steget. Ved å lære hvordan du unngår AI-deteksjon på en ansvarlig måte, kan du gjøre disse verktøyene til en kraftig og etisk del av arbeidsflyten din.

Etiske anvendelser av AI-deteksjonsfjerning på tvers av yrker

For å gjøre dette enda tydeligere, la oss se på hvordan ulike profesjonelle etisk kan utnytte AI-humaniserere for å løse vanlige utfordringer de møter daglig.

| Brukerprofil | Vanlig utfordring | Etisk løsning med en AI-deteksjonsfjerning |

|---|---|---|

| SEO-spesialist | Trenger å produsere store volumer av unikt innhold av høy kvalitet som rangerer godt og unngår søkemotorstraffer for "uhjelpsomme" AI-tekster. | Genererer søkeordoptimaliserte utkast med AI, og bruker deretter en humaniserer for å foredle syntaks og flyt, slik at den endelige artikkelen er engasjerende og verdifull for leserne. |

| Ikke-morsmålstalende engelskbruker | Har utmerkede ideer, men sliter med naturlige formuleringer og idiomatiske uttrykk, noe som fører til tekst som høres stiv eller "utenlandsk" ut. | Skriver innholdet sitt først, og bruker deretter en AI-humaniserer som et avansert språkverktøy for å polere skrivingen, slik at den høres mer flytende og naturlig ut. |

| Frilansskribent | Har stramme tidsfrister og trenger å maksimere effektiviteten for å håndtere flere kunder uten at skrivestilen blir repetitiv eller generisk. | Bruker AI til innledende research og utkast, og bruker deretter en humaniserer for å tilføre stilistisk variasjon og en unik stemme tilpasset hver kundes merkevare. |

| Småbedriftseier | Jonglerer alle markedsføringsoppgaver og trenger raskt å lage overbevisende nettsidetekster, produktbeskrivelser og innlegg i sosiale medier. | Lager funksjonelle førsteutkast med en AI-assistent og humaniserer dem deretter for å sikre at merkevarens personlighet og stemme kommer autentisk frem. |

| Akademisk forsker | Trenger å oppsummere komplekse funn til klart, tilgjengelig språk for søknader eller publikasjoner, men finner teksten sin tett og sjargongtung. | Kjører sine tekniske utkast gjennom en humaniserer for å forbedre lesbarheten og flyten, noe som gjør forskningen mer forståelig for et bredere publikum uten å endre kjernedata. |

Til syvende og sist er ikke målet å skjule bruken av AI. Det er å sikre at sluttproduktet tjener sitt menneskelige publikum på best mulig måte. Når den brukes med integritet, er en AI-deteksjonsfjerning en kraftig alliert for tydelig, effektiv og autentisk kommunikasjon.

Hvordan velge en sikker og pålitelig AI-deteksjonsfjerning

Med så mange verktøy som oversvømmer markedet, kan det å velge en pålitelig AI-deteksjonsfjerning føles som å navigere i et minefelt. La oss være tydelige: ikke alle humaniserere er skapt like. Noen er bare glorifiserte omskrivere som faller sammen umiddelbart mot moderne detektorer, mens andre stille kan kompromittere personvernet ditt.

Å ta et informert valg betyr å se forbi de flashy markedsføringspåstandene. Det rette verktøyet bør føles som en pålitelig partner, et som glir smidig inn i arbeidsflyten din og leverer konsistente resultater av høy kvalitet hver gang. Det handler om å fokusere på funksjonene som faktisk betyr noe for ytelse, sikkerhet og brukervennlighet.

Viktige kriterier for valg av verktøy

Når du begynner å sammenligne alternativer, bruk denne sjekklisten for å skjære gjennom støyen. Disse punktene er ikke-forhandlingsbare for alle som er seriøse med å produsere autentisk, uoppdagbart innhold uten å åpne døren for nye risikoer.

Et solid verktøy må levere på tre kjerneløfter:

- Suksessrate for deteksjonspassering: Hele poenget med verktøyet er å komme forbi detektorer. Se etter plattformer som er transparente om suksessratene sine mot de store navnene som GPTZero, Turnitin og Originality.ai. Praktisk tips: Før du forplikter deg, bruk en gratis prøveperiode. Ta en AI-tekst som eksempel, kjør den gjennom humanisereren, og test deretter resultatet på en gratis AI-detektor for å verifisere påstanden.

- Bevaring av mening: Hva er vitsen med uoppdagbar tekst hvis den ødelegger det opprinnelige budskapet ditt? Et virkelig effektivt verktøy må skrive om innhold uten å endre kjernebetydningen. Test det med noe nyansert. Hvis det spytter ut grammatiske feil eller forvrenger argumentet ditt, er det ikke riktig verktøy for deg.

- Personvern og datasikkerhet: Dette er et stort punkt, og det blir ofte oversett. En pålitelig leverandør vil ha en krystallklar personvernpolicy som sier at innholdet ditt aldri lagres eller brukes til treningsdata. Hvis en tjeneste er vag om hvordan den håndterer teksten din, gå videre.

Vurdere brukervennlighet og funksjoner

Utover disse kjernekriteriene, tenk på den faktiske opplevelsen av å bruke verktøyet. Et klønete, komplisert grensesnitt bremser deg bare ned, noe som fullstendig motvirker formålet med å bruke AI for å være mer effektiv. Se etter et rent, intuitivt design som gjør humaniseringsprosessen rask og smidig.

Det er også verdt å merke seg den bredere konteksten her. Den digitale verden sliter med en bølge av sofistikert svindel, som speiler eksplosjonen i deepfake-teknologi. For eksempel passerte deepfakes liveness-deteksjon 704 % mer effektivt i 2023, noe som alvorlig undergraver tillit på nettet. Dette understreker bare det voksende behovet for autentiseringsteknologier. En pålitelig humaniserer bidrar til å sikre at innholdet ditt forblir på riktig side av den grensen, og beviser sin genuine, menneskesentrerte verdi. Du kan oppdage hvordan deepfakes påvirker digital tillit og se hvor høye innsatsene blir.

Dine spørsmål, besvart

Å kaste seg inn i AI-innholdsverdenen kan føles litt som ville vesten. Det er naturlig å ha spørsmål. Her er noen tydelige, rett-på-sak svar på de vanligste tingene folk spør om AI-deteksjonsfjerning.

Er det lovlig å bruke en AI-deteksjonsfjerning?

Ja, å bruke en AI-deteksjonsfjerning er helt lovlig. I kjernen er disse verktøyene bare sofistikerte omskrivere eller stilredigerere, mye som en avansert grammatikksjekker. Det virkelige spørsmålet handler ikke om lovlighet – det handler om hvordan du bruker det.

Tenk på det slik: å bruke en humaniserer for å polere blogginnlegget ditt eller skjerpe markedsføringsteksten din er en helt standard og smart praksis. Men når det gjelder skolearbeid, må du følge institusjonens regler. De fleste retningslinjer for akademisk integritet insisterer på at den endelige innleveringen gjenspeiler dine egne ideer og kritiske tenkning, så sjekk alltid retningslinjene deres først.

Kan humanisert innhold fortsatt bli flagget?

Mens de beste AI-humanisererne har utrolig høye suksessrater, kan intet verktøy love en 100 % garanti som varer for alltid. AI-deteksjonsteknologi blir stadig smartere, og det er et konstant katt-og-mus-spill mellom detektorene og humanisererne.

Når det er sagt, er førsteklasses verktøy trent på massive biblioteker med genuint menneskelig skriving. Dette gjør det mulig for dem å produsere tekst som, statistisk sett, er umulig å skille fra noe et menneske ville skrevet. Det reduserer dramatisk sjansene for å bli flagget av noen nåværende eller nær-fremtidig detektor.

Vil en AI-deteksjonsfjerning ødelegge den opprinnelige meningen min?

En kvalitets-AI-deteksjonsfjerning er bygget fra grunnen av for å beskytte kjernebetydningen, faktaene og intensjonen i teksten din. Den bytter ikke bare ut ord tilfeldig. I stedet omformulerer den intelligent setninger og diversifiserer ordforrådet ditt for å tilføre den menneskelige berøringen.

Hele poenget er å forbedre flyten og stilen uten å endre substansen. Det er som å levere utkastet ditt til en dyktig redaktør som polerer prosaen din mens det opprinnelige budskapet ditt bevares helt intakt. Arbeidet ditt forblir nøyaktig og trofast mot visjonen din.

Klar for å forvandle AI-utkastene dine til uoppdagbart innhold av menneskelig kvalitet? Prøv HumanText.pro i dag og se forskjellen selv. https://humantext.pro

Klar til å transformere ditt AI-genererte innhold til naturlig, menneskelig tekst? Humantext.pro forfiner teksten din umiddelbart og sørger for at den høres naturlig ut og omgår AI-detektorer. Prøv vår gratis AI-humaniserer →

Relaterte Artikler

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.