En guide for å bestå AI-deteksjon og humanisere innholdet ditt

Oppdag hvordan du består AI-deteksjon med velprøvde strategier. Vår guide tilbyr handlingsorienterte teknikker og innsikter for å humanisere innholdet ditt og unngå AI-detektorer.

Hvis du vil konsekvent seile forbi AI-detektorer, må du først komme inn i hodene deres. Det handler ikke om magi; det handler om å forstå hva de er trent til å oppdage: forutsigbarhet og ensartethet.

Hemmeligheten er å ta det rene, logiske AI-utkastet og rote det til litt – akkurat som et menneske ville gjort. Ved å bevisst variere setningsstrukturene dine og bytte ut vanlige ordvalg med mer unike, kan du etterligne den litt kaotiske, naturlige rytmen i menneskelig skriving. Denne manuelle berøringen er den mest pålitelige måten jeg har funnet for å gjøre innhold virkelig uoppdagelig.

Forstå hvordan AI-detektorer faktisk fungerer

Verktøy som GPTZero eller Turnitins AI-detektor leser ikke innholdet ditt for betydning eller nyanser. De kjører en matematisk analyse.

Tenk på dem som statistikere, ikke litteraturkritikere. De har blitt trent på massive biblioteker av menneskeskrevet tekst og lært alle våre vidunderlige særegenheter, rotete vaner og uforutsigbare fraser. Når de skanner artikkelen din, leter de bare etter de avslørende matematiske fingeravtrykkene fra en maskin.

Det er to store statistiske mønstre som store språkmodeller (LLM) etterlater seg. Når du forstår disse signalene, kan du begynne å systematisk demontere dem.

Problemet med lav perpleksitet

Perpleksitet er bare et fancy begrep for hvor forutsigbar en rekke ord er. Menneskelige forfattere er herlig uforutsigbare. Vi bruker rare idiomer, skaper rare metaforer og kombinerer ord på måter som er teknisk korrekte, men statistisk usannsynlige.

AI-modeller gjør det motsatte på egen hånd. De er designet for å velge det mest statistisk sannsynlige neste ordet.

Dette skaper tekst som føles trygg, logisk og ofte litt kjedelig. For eksempel er det svært sannsynlig at en AI følger "Dataene antyder..." med "...at en ny tilnærming er nødvendig." Det er korrekt, men kjedelig. Et menneske ville kanskje skrevet: "Dataene skriker til oss om å prøve noe nytt." Denne lave perpleksiteten er et enormt rødt flagg for enhver detektor.

Viktig poeng: AI-generert tekst høres ofte ut som en strålende student som har memorert en ordbok, men har null livserfaring. Den velger alltid det vanligste, "korrekte" ordet, noe som skaper en forutsigbar rytme som detektorer kan oppdage på lang avstand.

Det avslørende tegnet på lav burstiness

Burstiness måler variasjonen i setningslengde og struktur. Tenk på hvordan du snakker. Du bruker kanskje en kort, slagkraftig setning. Deretter følger du den kanskje med en lang, slingrende setning som utforsker en mer kompleks idé. Det er høy burstiness.

AI-modeller sliter ofte med denne naturlige kadensen. De har en tendens til å produsere setninger av lignende lengde og struktur, noe som skaper en monoton, nesten hypnotisk flyt. Denne enhetlige rytmen er nok et dødt giveaway, et klart digitalt fingeravtrykk som detektorer er bygget for å finne. Dette er et kritisk område hvor du kan lære mer om å lage uoppdagelig AI-innhold.

Her er en rask oversikt over hva disse detektorene jakter på og hvordan du kan slå tilbake.

AI-skrivemønstre og humaniseringsløsninger

| AI-deteksjonssignal | Hva det betyr i praksis | Din menneskelige touch-løsning |

|---|---|---|

| Lav perpleksitet | Teksten bruker svært vanlige og forutsigbare ordsekvenser. Tenk "konklusjonen er," "det er viktig å merke seg," etc. | Bytt ut vanlige ord med mer interessante synonymer. Introduser idiomer, analogier eller personlige anekdoter. Omformuler setninger for å være mindre direkte. |

| Lav burstiness | Setninger er alle omtrent like lange og følger lignende grammatiske mønstre (f.eks. Subjekt-Verb-Objekt om og om igjen). | Bland aktivt korte, slagkraftige setninger med lengre, mer komplekse. Bruk setningsfragmenter for å legge til trykk. Start setninger forskjellig (f.eks. med en preposisjonsfrase eller adverb). |

| Enhetlig flyt | Avsnitt er ofte av lignende lengde, og overgangene mellom dem føles formelmessige ("Videre," "Dessuten," "I tillegg"). | Variere avsnittslengde. Bruk naturlige, samtaleaktige overganger som "Men her er greia," "Nå, la oss snakke om," eller bare start en ny, relatert tanke. |

| Mangel på stemme | Tonen er nøytral, objektiv og mangler enhver merkbar personlighet. Det føles som en lærebok. | Tilsett din egen stemme. Still retoriske spørsmål. Bruk sammentrekninger ("det er" i stedet for "det er"). Legg til personlige meninger eller korte sidespor. |

Ved å fokusere redigeringsinnsatsen din på disse spesifikke områdene, gjetter du ikke lenger – du retter deg strategisk mot kjernemetrikken som deteksjonssystemer er avhengige av.

I dette konstante katt-og-mus-spillet mellom AI-forfattere og detektorer er god gammeldags manuell redigering fortsatt kongen. Det har vist seg å kutte AI-deteksjonsraten fra hele 82% ned til bare 21,5% i gjennomsnitt. Det er ikke bare en teori; det er hva vi ser i test etter test på tvers av verktøy som GPTZero og Originality.AI.

Ved bevisst å jobbe for å øke både perpleksitet og burstiness undergräver du direkte detektorens hele modell og legger grunnlaget for å forvandle det robotiske utkastet til noe genuint menneskelig.

Ta tak i det: Praktiske humaniseringsteknikker

Okay, nå som du vet hva AI-detektorer leter etter, er det på tide å brette opp ermene. Det handler ikke om å brenne hele utkastet og starte på nytt fra bunnen av. Tenk på deg selv som en redaktør, ikke bare en forfatter. Du injiserer strategisk litt menneskelig kaos i maskinens perfekte, sterile orden.

Ditt hovedmål er å manuelt skru opp tekstens perpleksitet og burstiness. Disse hands-on-redigeringene er uten tvil den mest effektive måten å seile forbi AI-deteksjon på. Du bytter i hovedsak ut forutsigbare, maskinlignende mønstre med ditt eget unike, menneskelige fingeravtrykk.

Bland setningene dine for å øke burstiness

Det døde giveaway'et til et AI-utkast er ofte dets monotone rytme. Setning etter setning av lignende lengde, noe som skaper en robotisk, forutsigbar kadens som kan få en leser til å sovne. Ditt første oppdrag er å knuse det mønsteret.

Variere lengden: Bland bevisst korte, slagkraftige setninger med lengre, mer beskrivende. En kort setning lander et poeng. Hardt. En lengre gir deg rom til å forklare, legge til farge og bygge en mer kompleks tanke.

Bruk fragmenter: Noen ganger fungerer et enkelt ord. Virkelig. Det er en flott måte å legge til trykk på og få skrivingen din til å føles mer samtaleaktig.

Endre åpningene dine: Ikke la hver setning starte på samme måte ("Selskapet gjorde dette," "Programvaren gjør det"). Start med en preposisjonsfrase, et adverb eller en avhengig setning for å skape en mye mer dynamisk flyt.

Her er et klassisk AI-generert eksempel.

AI-utkast: Markedsføringsteamet må bruke sosiale medieplattformer for å forbedre kundeengasjement. Denne strategien er viktig for å bygge merkelojalitet. Selskapet kan oppnå bedre resultater ved å poste konsekvent.

Grammatisk er det greit. Men det er helt sjelelest. Nå, la oss injisere litt liv i det.

Humanisert versjon: For virkelig å knytte an til kunder må markedsføringsteamet bli aktive på sosiale medier. Hvorfor? Fordi det er den moderne nøkkelen til å bygge ekte merkelojalitet. Konsekvent posting, gjennomtenkte svar, ekte forbindelse – det er det som driver resultater.

Ser du forskjellen? Vi blandet setningslengdene, kastet inn et spørsmål og brukte til og med et fragment for litt ekstra kraft. Rytmen føles umiddelbart mer naturlig og engasjerende.

Dropp forutsigbare ord for mer engasjerende språk

Neste steg: perpleksitet. Du må jakte ned AI:s favorittord på ti dollar. Språkmodeller er trent på fjell av formell tekst, så de har en tendens til å lene seg på ord som høres offisielle ut, men er helt uten personlighet. Tid for en "ord-ektomi."

Start med å lage en "hit list" av vanlige AI-ord og bytte dem ut med mer naturlige alternativer. Denne enkle endringen er et kraftfullt trekk for å få innholdet ditt til å bestå AI-sjekker.

| Vanlig AI-ord | Bedre menneskelig alternativ |

|---|---|

| Utnytte | Bruk, prøv, velg |

| Sømløs | Lett, smidig, enkel |

| Fordype seg i | Se på, utforske, finne ut av |

| Følgelig | Så, på grunn av dette |

| Dessuten | Også, pluss, i tillegg til det |

Å sette dette i praksis er enkelt. La oss ta en annen stiv, AI-generert setning.

AI-utkast: Dessuten er det absolutt nødvendig å fordype seg i dataene for å formulere en omfattende strategi.

Nå, la oss bare si det som en person.

Humanisert versjon: Pluss, vi må virkelig grave i dataene for å finne ut en solid plan.

Betydningen er identisk, men tonen er en verden unna. Den er direkte, den er samtaleaktig, og den er langt mindre forutsigbar for en deteksjonsalgoritme.

Handlingsbart tips: Hold en løpende liste over dine egne "AI tells" – de rare ordene du merker dukker opp i utkastene dine igjen og igjen. Etter noen redigeringsøkter har du et tilpasset jukseark som gjør denne prosessen så mye raskere.

Tilsett din autentiske stemme og personlighet

Dette er det siste og mest avgjørende laget. En AI har ingen livserfaring. Den har ingen meninger, ingen sans for humor, ingen historier å fortelle. Å legge til disse unikt menneskelige elementene er ditt ultimate forsvar mot deteksjon fordi de per definisjon bare kan komme fra deg.

- Fortell en rask historie: Vev inn en kort, relevant personlig anekdote. Å starte en setning med "Jeg husker da jeg prøvde dette for første gang og..." gjør umiddelbart innholdet mer autentisk og relaterbart.

- Still retoriske spørsmål: Dra leseren inn i samtalen. "Men hva betyr dette egentlig for bunnlinjen din?" Det tvinger dem til å pause og tenke, noe som bryter opp den passive leseopplevelsen.

- Bruk sammentrekninger: Dette er et så enkelt, men kraftfullt triks. Å skrive "det er," "du er," og "ikke" i stedet for "det er," "du er," og "gjør ikke" gjør umiddelbart tonen din mer naturlig og mindre som en lærebok. AI-modeller unngår ofte sammentrekninger med mindre du spesifikt ber dem om å bruke dem.

- Uttrykk en mening: Ikke vær redd for å ha et synspunkt. En AI er programmert for nøytralitet, men mennesker har perspektiver. Fraser som "Etter min erfaring..." eller "Ærlig talt, jeg tror..." introduserer en personlighet som algoritmer sliter med å replikere.

Disse manuelle redigeringene gjør mer enn bare å hjelpe deg fly under AI-deteksjonsradaren. De forvandler en generisk, glemmelig artikkel til noe overbevisende som faktisk knytter an til en ekte person. Det er forskjellen mellom en maskinmonolog og en menneskelig samtale.

Bygge en repeterbar arbeidsflyt for å humanisere AI-innhold

Å kjenne til noen redigeringstriks er én ting. Å konsekvent anvende dem for å gjøre AI-innhold uoppdagelig er noe helt annet. Hvis du virkelig vil bestå AI-deteksjon hver gang, trenger du et system – en repeterbar prosess som tar bort gjetningen.

Uten en solid arbeidsflyt gjør du bare tilfeldige redigeringer og håper på det beste. Det er en oppskrift på inkonsekvente resultater, spesielt når du har en deadline. En strukturert, multi-pass tilnærming lar deg fokusere på spesifikke forbedringer på hvert stadium, noe som gjør hele prosessen raskere og langt mer effektiv.

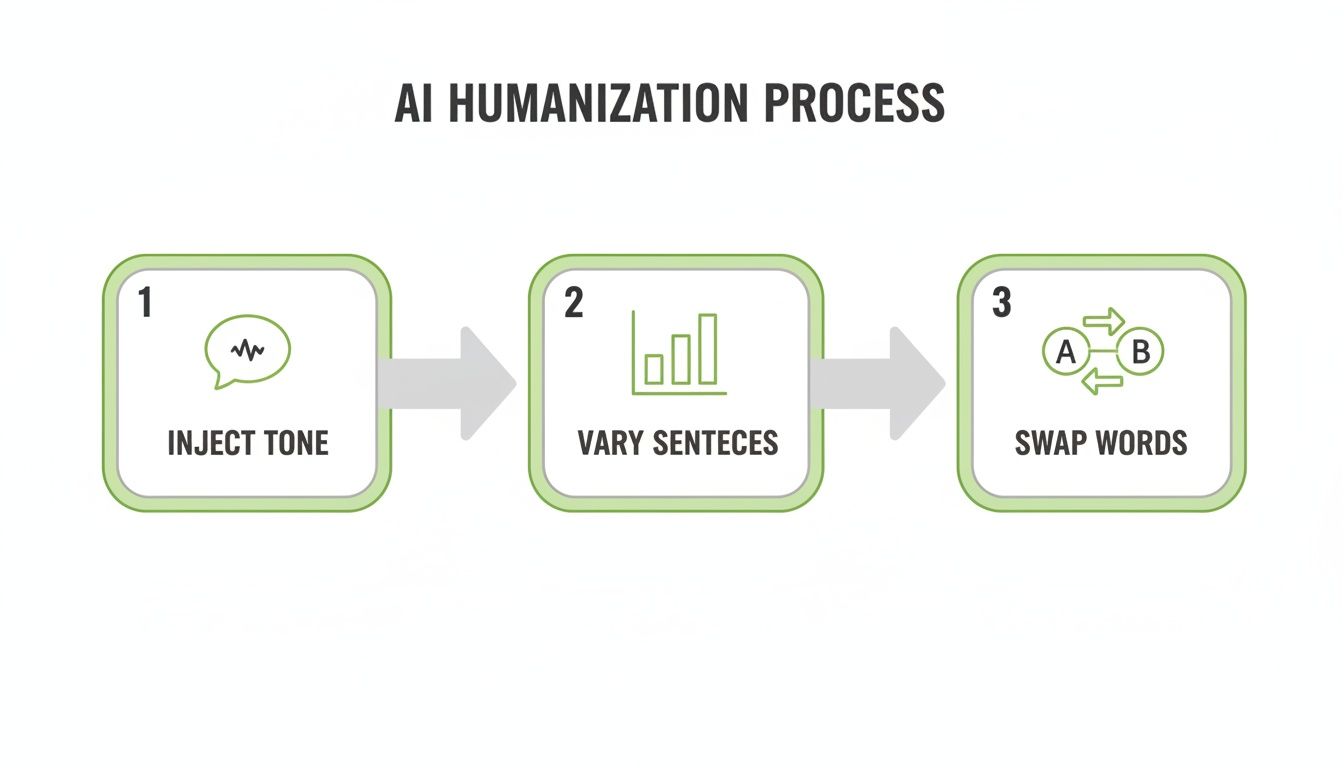

Tenk på det som en kvalitetskontrollsjekkliste for å forvandle robotisk tekst til noe med en ekte puls. Dette flytskjemaet bryter ned kjerneideen i tre enkle, fokuserte stadier.

Som du kan se, handler det ikke om én magisk løsning. Det handler om å legge redigeringene dine i lag, starte med det store bildet og stemme, og deretter bore ned til ord-for-ord-detaljer.

Første pass: Det store bildet & stemmeredigering

Din første gjennomlesning handler ikke om å fange skrivefeil eller bytte ord. Det handler om det store: struktur, flyt og viktigst av alt, stemme. Et rått AI-utkast kan være faktisk korrekt, men det mangler nesten alltid et ekte synspunkt. Det er her du gjør artikkelen til din.

Les hele utkastet fra start til slutt. Flyter det faktisk som en ekte samtale, eller føles det som en lærebok? Er det noen personlighet, eller er det bare en tørr opplesning av fakta?

- Tilsett ditt perspektiv: Dette er det kraftigste humaniseringssignalet du har. Legg til personlige anekdoter, meninger eller unike innsikter. En enkel frase som "Etter min erfaring..." eller "Her er hva jeg har lært..." er noe en AI rett og slett ikke kan fake autentisk.

- Fiks narrativ flyt: AI legger ofte ut informasjon på en smertefull lineær måte. Bryt det forutsigbare mønsteret. Flytt avsnitt for å bygge spenning, skape et sterkere argument eller bare gjøre det til en mer interessant lesning.

- Juster tonen: Er tonen riktig for publikummet ditt? AI bruker ofte som standard en formell, akademisk stemme når du trenger noe mer avslappet og engasjerende. Nå er det på tide å stille inn den generelle følelsen før du blir begravd i detaljene.

Dette første passet handler om å forvandle AI:s logiske skjelett til innhold med et menneskelig hjerteslag.

Mitt personlige tips: Jeg leser alltid det rå AI-utkastet høyt på mitt første pass. Ørene dine vil fange opp ting øynene dine går glipp av – monotone setningsrytmer, klønete fraser og robotiske setninger. Hvis det høres rart ut når du sier det, kommer det definitivt til å leses rart.

Andre pass: Setningsnivåets polering

Okay, med strukturen og stemmen på plass er det på tide å bli kirurgisk. Dette andre passet handler om setningsnivåets detaljer. Målet ditt her er å direkte angripe de lave perpleksitets- og lave **burstiness-**signalene som AI-detektorer er trent til å finne. Du gjør teksten statistisk rotete, akkurat som menneskelig skriving.

Her er din sjekkliste for dette passet:

- Variere setningslengde: Jakt ned avsnitt hvor hver setning er omtrent like lang. Dette er et dødt giveaway. Kombiner to korte setninger eller bryt opp en lang for å skape en mer dynamisk, naturlig rytme.

- Bytt forutsigbare ord: Finn og drep vanlige AI-krykker. Bli kvitt "utnytte," "sømløs," "fordype," og "dessuten." Erstatt dem med mer naturlige, samtaleaktige alternativer.

- Bruk sammentrekninger: Endre "det er" til "det er" og "du vil" til "du vil." Dette er en dødsenkel redigering som umiddelbart får teksten til å føles mindre stiv og mer menneskelig.

- Legg til retoriske spørsmål: Dra leseren inn i samtalen. Å slippe inn et spørsmål som "Men hvordan fungerer det faktisk i praksis?" bryter opp den passive flyten og etterligner hvordan ekte mennesker snakker og tenker.

Dette passet handler ikke om å skrive om store seksjoner. Det handler om å gjøre små, målrettede endringer som, når de kombineres, har en massiv innvirkning på deteksjonsscoren.

Siste pass: Den aller viktigste testfasen

Du ville ikke lansert et nettsted uten å teste det på forskjellige nettlesere, eller hvordan? Den samme logikken gjelder her. Ikke publiser innholdet ditt uten å kjøre det gjennom noen forskjellige AI-detektorer.

Å stole på et enkelt verktøy er en av de største feilene folk gjør. Hver detektor bruker en litt annen algoritme, så det som består på én kan bli flagget på en annen.

Jeg anbefaler å kryssreferere med minst to eller tre ledende verktøy – tenk GPTZero, Originality.ai og Turnitins detektor hvis du har tilgang. Målet ditt er å få en konsensus.

Når resultatene kommer tilbake, ikke bare kast et blikk på den samlede scoren. Det virkelige gullet er i delene de fremhever. De fleste detektorer vil vise deg nøyaktig hvilke setninger de tror er AI-generert. Gå tilbake til de fremhevede seksjonene og bruk en ny runde med humaniseringsredigeringer. Kanskje må du omformulere en kompleks setning eller bytte ut et annet forutsigbart ord. Ofte er disse siste, målrettede justeringene alt du trenger for å få en "menneskeskrevet" score over hele linjen.

Velge det riktige AI-humaniseringsverktøyet for jobben

Okay, du har en solid humaniseringsarbeidsflyt. Nå tenker du kanskje på å legge til et dedikert verktøy for å fremskynde ting. Men her er fangsten: markedet er absolutt oversvømmet med alternativer, og ærlig talt er de fleste av dem ikke verdt tiden din.

Å velge feil sløser ikke bare bort penger; det sløser bort timer av dagen din og etterlater deg med innhold som fortsatt blir flagget av AI-detektorer. Det er frustrerende.

Det virkelige trikset er å vite forskjellen mellom en enkel "parafraserer" og en ekte AI-humaniserer. Et grunnleggende spinnerverktøy bytter bare ut ord mot synonymer – et gammeldags triks som moderne detektorer som Turnitin ser rett gjennom. En genuin humaniserer er et helt annet beist. Den er trent på massive biblioteker av menneskeskrevet tekst for å fundamentalt omstrukturere setninger, introdusere variert syntaks og justere tonen akkurat riktig for å fly under radaren.

Kjernekriterier for å evaluere hvilket som helst verktøy

Når du vurderer et verktøy, ignorer de prangende markedsføringsløftene. Avgjørelsen din bør koke ned til en håndfull ikke-omsettelige kriterier som skiller de effektive verktøyene fra de glorifiserte synonymordbøkene.

Til syvende og sist er det eneste spørsmålet som betyr noe: fungerer det faktisk? Se etter verktøy som er transparente om suksessratene sine mot et utvalg av populære detektorer, ikke bare én de vet de kan slå.

Her er hva jeg alltid sjekker etter:

- Deteksjonsomgåelsesrate: Får verktøyet konsekvent en "menneskelig" score på tøffe plattformer som GPTZero, Originality.ai og Sapling? Et pålitelig verktøy må være effektivt mot flere algoritmer.

- Betydningsbevaring: Utdataen må si hva du opprinnelig mente. Hvis verktøyet omskriver teksten din til noe som er faktisk feil eller bare rent tull, er det helt ubrukelig.

- Brukervennlighet: Grensesnittet må være rent, raskt og intuitivt. Du burde ikke måtte kjempe med programvaren for å få et resultat; den bør passe jevnt inn i hvordan du allerede jobber.

Det hjelper også å forstå hva du prøver å fikse i utgangspunktet. Å leke rundt med et verktøy som en AI Post Generator gir deg en følelse av hvilken type robotisk output du trenger å humanisere. Denne konteksten hjelper deg å sette pris på de subtile, men kritiske forbedringene en god humaniserer gjør.

Den oversette faktoren: Datasikkerhet

Dette er det ene som de fleste glemmer å sjekke, og det er uten tvil det viktigste. Når du limer inn artikkelen din i et tilfeldig nettverktøy, hvor tar dataen veien? Noen tjenester lagrer teksten din og kan til og med bruke den til å trene sine egne AI-modeller.

Det er en massiv risiko. Innholdet ditt – enten det er for en klient, en sensitiv forskningsartikkel eller selskapets neste store markedsføringsplan – er din intellektuelle eiendom. Å overlevere det til en tjeneste med en tvilsom personvernpolicy er et sjansespill du rett og slett ikke bør ta.

Personvernssjekk: Les alltid, alltid verktøyets personvernpolicy. Se etter eksplisitte garantier om at teksten din ikke vil bli lagret, delt eller brukt til treningsformål. En pålitelig tjeneste vil gjøre dette løftet klart og på forhånd.

Å velge et verktøy som respekterer ditt personvern sikrer at arbeidet ditt forblir ditt og ditt alene. For en dypdykking i hvilke verktøy som oppfyller disse standardene, sjekk ut vår detaljerte oversikt over de beste AI-humaniserer-alternativene tilgjengelig.

Fra grunnleggende til avansert: En rask sammenligning

For å sette alt dette i perspektiv, la oss se på de forskjellige nivåene av verktøy der ute. Å kjenne til dette hierarkiet hjelper deg å identifisere hva du faktisk trenger for dine spesifikke kvalitets- og uoppdagelighetsmål.

| Verktøytype | Hvordan det fungerer | Vanlig utfall |

|---|---|---|

| Enkel parafraserer | Bytter ut individuelle ord med synonymer. Kan omorganisere setninger litt. | Høres ofte klønete ut eller "spunnet." Mislykkes med de fleste moderne AI-detektorer. |

| Grunnleggende AI-omskriver | Bruker AI til å omskrive setninger én etter én. Mangler et helhetlig syn på teksten. | Forbedrer parafrasering, men har fortsatt en robotisk følelse. Sliter med tøffe detektorer som Turnitin. |

| Avansert humaniserer | Bygger om tekst ved hjelp av modeller trent på menneskelig skriving. Fokuserer på flyt, rytme og struktur. | Produserer naturlig, uoppdagelig output som bevarer den opprinnelige betydningen. |

Til syvende og sist sparer en investering i en avansert humaniserer en masse redigeringstid og gir deg et sluttprodukt du kan stole på. Det er den mest pålitelige veien for konsekvent å bestå AI-deteksjon uten å ofre kvaliteten på innholdet ditt.

Bruke AI-humaniserere etisk og ansvarlig

Å få innholdet ditt til å bestå AI-deteksjon er én ting. Å gjøre det ansvarlig er noe helt annet. Det er en skarp linje mellom å bruke AI som en kraftfull assistent og å bruke den til å direkte lure mennesker, og den linjen trekkes med intensjon. Det er forskjellen mellom å strømlinjeforme arbeidsflyten din og å begå akademisk bedrageri eller bare oversvømme internett med lavkvalitets, automatisert søppel.

Målet er ikke bare å være uoppdagelig. Det er å produsere høykvalitets, ærlig arbeid som du faktisk kan stå for. Når du tenker etisk fra starten av, sikrer du at sluttproduktet har integritet, enten du leverer inn en oppgave til en professor eller publiserer en artikkel for publikummet ditt.

Den klare linjen for studenter

For studenter er reglene ganske ikke-omsettelige. Universiteter bygger sin akademiske integritetspolicy rundt original tenkning, kritisk analyse og riktig sitering. Å ta en AI-generert oppgave, kjøre den gjennom en humaniserer og levere den til et system som Turnitin er ikke en smart løsning – det er et klart brudd på disse prinsippene.

Hele tilnærmingen går glipp av poenget med oppgaven i utgangspunktet, som er å lære, syntetisere informasjon og artikulere dine egne unike argumenter. Den etiske måten å bruke AI på skolen ser helt annerledes ut.

- Brainstorming og disposisjon: Å bruke AI til å kickstarte arbeidet ditt ved å utforske emner, strukturere en disposisjon eller få grep om komplekse ideer er helt legitimt.

- Utkast-støtte: Det kan være et flott verktøy for å omformulere en klønete setning eller finne et bedre ord, nesten som en superkraftig synonymordbok.

- Aldri for sluttinnlevering: Kjernen i arbeidet – argumentene, analysen, konklusjonene – må være dine. Punktum.

Viktig poeng: Tenk på en AI-humaniserer som en sluttpolerer for dine egne ideer, ikke en spøkelsesskribent for arbeid du ikke gjorde. Sekundet den brukes til å ta æren for tenkning som ikke er din, har du krysset en alvorlig etisk linje.

Beste praksis for fagfolk

For markedsførere, forfattere og SEO-er handler det etiske spillet mer om publikumstillit og innholdskvalitet. Leserne dine kommer til deg for ekspertise, autentisitet og ekte verdi. Å bare humanisere et generisk AI-utkast og trykke på "publiser" er en rask måte å forråde den tilliten på og skade merkevaren din.

I en profesjonell setting betyr ansvar å beskytte merkevarens unike stemme og sikre at hvert enkelt innhold er faktisk korrekt og genuint nyttig. Ditt omdømme bygges på kvaliteten på arbeidet ditt, ikke kvantiteten.

Her er en rask sjekkliste for å holde det etisk og ansvarlig:

- Faktasjekk alt: AI-modeller er beryktede for å finne på ting. Dette fenomenet, ofte kalt "hallusinasjon," er et reelt problem. Verifiser alltid, alltid hver statistikk, påstand og sitat med en anerkjent kilde.

- Tilsett ekte ekspertise: Bruk AI-utkastet som et skjelett. Den virkelige verdien – kjøttet – kommer når du legger til dine egne innsikter, personlige erfaringer og bransjespesifikk kunnskap som ingen maskin noensinne kunne ha.

- Bevar din merkevare-stemme: En humaniserer kan jevne ut setningsstrukturer, men du er vokteren av merkevarens personlighet. Sørg for at den endelige teksten høres ut som deg, ikke en generisk robot.

- Oppretthold datasikkerhet: Som fagperson er håndtering av data etisk ikke-omsettelig. Hvis du bruker AI-verktøy i en forretningskontekst, er det verdt å se gjennom en AI GDPR Compliance Guide for å sikre at du har alle dine juridiske og etiske baser dekket.

Til syvende og sist er den mest etiske tilnærmingen også den mest effektive. Innhold som er nøye redigert, faktasjekket og infundert med genuin menneskelig ekspertise består ikke bare AI-deteksjon – det presterer bedre med søkemotorer og knytter dypere an til publikummet ditt. Målet er å forsterke din intelligens, ikke erstatte den.

Noen vanlige spørsmål om å unngå AI-detektorer

Selv med en solid spillplan dukker noen spørsmål alltid opp når du prøver å få AI-generert tekst til å fly under radaren. La oss takle noen av de vanligste jeg hører. Å få disse sortert vil hjelpe deg å redigere med mye mer selvtillit.

Kan AI-detektorer noensinne være 100% nøyaktige?

Nei. Og det er ganske usannsynlig at de noensinne vil være det.

Du må tenke på AI-detektorer som probabilistiske verktøy, ikke som ufeilbarlige dommere. De er bygget for å oppdage statistiske mønstre som har en tendens til å dukke opp i maskinskriving. De håndterer ikke sikkerhet, noe som betyr at de får ting galt – mye.

- Falske positiver: Dette er når detektoren skriker "AI!" til noe et menneske skrev. Det er vanlig med grei, faktisk skriving som naturlig mangler komplekse setningsstrukturer.

- Falske negativer: Dette er det motsatte – et AI-generert stykke glir forbi helt uoppdaget. Litt smart redigering er ofte alt som kreves for å lure algoritmen.

Her er en bedre måte å se på det: En detektors score er ikke en dom. Det er en guide. En høy AI-score markerer bare setningene som høres mest robotiske ut og viser deg nøyaktig hvor du skal fokusere redigeringsinnsatsen din. For eksempel, hvis et verktøy flagger "Det er avgjørende å implementere det nye systemet," vet du at du skal endre det til noe som "Se, vi må få dette nye systemet i gang."

Vil humanisering av mitt AI-innhold skade min SEO?

Det er faktisk tvert imot – det vil nesten helt sikkert hjelpe det. Dette er en enorm misforståelse som kommer fra en frykt for å bli slått med en Google-straff. Men hvis du tenker på hva Google faktisk vil, har humanisering av innholdet ditt perfekt i tråd med deres mål.

Søkemotorer er designet for å belønne innhold som er hjelpsomt, pålitelig og gir leseren en god opplevelse. Dette er hele poenget med Googles E-E-A-T (Erfaring, Ekspertise, Autoritet og Pålitelighet)-retningslinjer.

Generisk, robotisk AI-tekst bomber på alle disse frontene. Den har ikke den unike stemmen eller førstehånds erfaringen som signaliserer ekte ekspertise. Når du omskriver den teksten for å være mer autentisk og engasjerende, gjør du den bedre for mennesker. Og å gjøre innhold bedre for mennesker er det beste signalet du muligens kan sende til søkemotorer. Hvis du vil gå dypere, kan du også lese om hvorvidt uoppdagelig AI virkelig fungerer i vår omfattende guide.

Er det galt å bruke verktøy for å bestå AI-deteksjon?

Etikken her koker virkelig ned til to ting: din intensjon og sluttproduktet. Verktøyet i seg selv er bare kode; hva du gjør med det er det som betyr noe.

Hvis du bruker AI for å komme forbi skriveblokk eller kartlegge et første utkast, og deretter nøye redigerer den outputen for å gjenspeile din egen kunnskap og stemme, er det bare en smart arbeidsflyt. Du bruker et verktøy for å assistere din egen intelligens, ikke for å erstatte den.

Den etiske linjen krysses når målet er å lure.

- For studenter: Å levere inn en AI-generert oppgave som bare har blitt kjørt gjennom en humaniserer er akademisk uærlighet, rett og slett. Hele poenget med en oppgave er å lære og tenke kritisk.

- For fagfolk: Standarden er enkel: er du ærlig og gir verdi? Hvis et verktøy hjelper deg å produsere genuint hjelpsomt, høykvalitets innhold for publikummet ditt mer effektivt, bruker du det ansvarlig. Hvis du bruker det til å masse ut lavkvalitets, feilaktige artikler bare for antallet, er det uetisk og vil til slutt synke merkevaren din.

Den ansvarlige tilnærmingen er ganske klar. Bruk AI som ditt startpunkt, men sørg alltid for at den endelige biten er faktasjekket, fylt med ditt eget unike perspektiv og faktisk hjelper leseren. Det er slik du skaper innhold som ikke bare er "uoppdagelig," men genuint bra.

Klar til å transformere ditt AI-genererte innhold til naturlig, menneskelig tekst? Humantext.pro forfiner teksten din umiddelbart og sørger for at den høres naturlig ut og omgår AI-detektorer. Prøv vår gratis AI-humaniserer →

Relaterte Artikler

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.