AI-humanizer uden ordgrænse: En praktisk guide til at humanisere langt indhold

AI-humanizer uden ordgrænse: Lær praktiske workflows til at omdanne langt indhold til engagerende, naturligt klingende tekst uden begrænsninger.

Lad os være ærlige: en ægte AI-humanizer uden ordgrænse er lidt af en myte. Du finder ikke en magisk knap, der fejlfrit humaniserer et manuskript på 100.000 ord i ét hug. De fleste værktøjer har tegn- eller ordgrænser, der tvinger dig til at fodre dem med din afhandling eller e-bog i små, frustrerende bidder.

Håndtering af storskala indholds-humanisering

Uanset om du er en kandidatstuderende, der kæmper med en afhandling på 10.000 ord, en SEO-professionel, der jonglerer med et dusin artikler, eller en forsker, der udarbejder en tæt akademisk artikel – problemet er altid det samme. Du sidder på et bjerg af AI-genereret tekst, der skal lyde ægte menneskelig – ikke bare for at bestå nutidens smartere AI-detektorer, men for faktisk at skabe forbindelse til dine læsere.

Den sædvanlige copy-paste-rutine, hvor man bearbejder 300 eller 500 ord ad gangen, er mere end bare kedelig. Det er en regulær workflow-dræber. Dette manuelle slid inviterer fejl, mudrer din tone og æder timer, du burde bruge på strategi og finpudsning. For alle, der skaber indhold i stor skala, er det en alvorlig flaskehals.

Når du arbejder med langt indhold, rækker udfordringerne ud over simple ordtællinger. Den virkelige kamp er at bevare værkets integritet fra start til slut.

Udfordringer ved humanisering af langt AI-indhold

| Udfordring | Påvirkning af dit arbejde | Strategisk løsning |

|---|---|---|

| Tab af kontekst | Værktøjet overser den overordnede fortælling, hvilket fører til generiske eller irrelevante omskrivninger. | Bearbejd indhold i logiske, selvstændige sektioner (f.eks. kapitler, hovedargumenter) for at give tilstrækkelig kontekst. |

| Narrativ fragmentering | Flowet mellem afsnit bryder sammen og skaber en usammenhængende og skurrende læseoplevelse. | Lad dine tekstblokke overlappe en smule, og gennemgå overgange manuelt for at sikre et flydende, sammenhængende flow. |

| Tonal inkonsistens | Dit dokument ender med at lyde, som om det er skrevet af et udvalg, med skiftende toner og stilarter. | Etabler en klar stilguide eller referencetone for humanizeren, og rediger manuelt for konsistens efter bearbejdning. |

| Ekstrem tidsineffektivitet | Det manuelle arbejde med at opdele og samle tekst igen modarbejder formålet med at bruge AI for hastighed. | Anvend en systematisk "chunking-metode", der strømliner opdelings- og gensamlingsprocessen og gør den til en forudsigelig workflow. |

Disse forhindringer understreger, hvorfor et simpelt værktøj ikke er nok; du har brug for en smartere proces.

Hvorfor standardværktøjer kommer til kort

De fleste AI-humanizers er designet til hurtige opgaver: e-mails, billedtekster til sociale medier eller korte afsnit. Deres bearbejdningsgrænser er en praktisk realitet knyttet til serveromkostninger og den enorme kompleksitet i at omskrive tekst og samtidig bevare kernebetydningen.

Når du forsøger at presse et stort dokument igennem disse værktøjer, bliver begrænsningerne smertefuldt tydelige:

- Kontekstblindhed: Et værktøj, der kun ser en lille del af dit arbejde, kan ikke forstå de narrative tråde, argumenter eller fagtermer, du har etableret. Det svarer til at bede nogen om at beskrive en film efter kun at have set et 30-sekunders klip.

- Brudt flow: Bearbejdning kapitel for kapitel smadrer ofte de logiske broer mellem ideer. Du ender med en samling afsnit, der ikke rigtig taler sammen, hvilket tvinger læseren til at arbejde alt for hårdt.

- Fælden med manuelt arbejde: Den indsats, det kræver at skære et stort dokument op, bearbejde det og sy det sammen igen, er enorm. Det underminerer fuldstændig den effektivitet, som AI burde give i første omgang.

Den virkelige udfordring er ikke bare at bestå en detektor; det handler om at bevare sjælen og sammenhængen i et langt stykke tekst. Et dokument, der scorer 100 % menneskeligt, men læses som et rodet virvar, er en total fiasko.

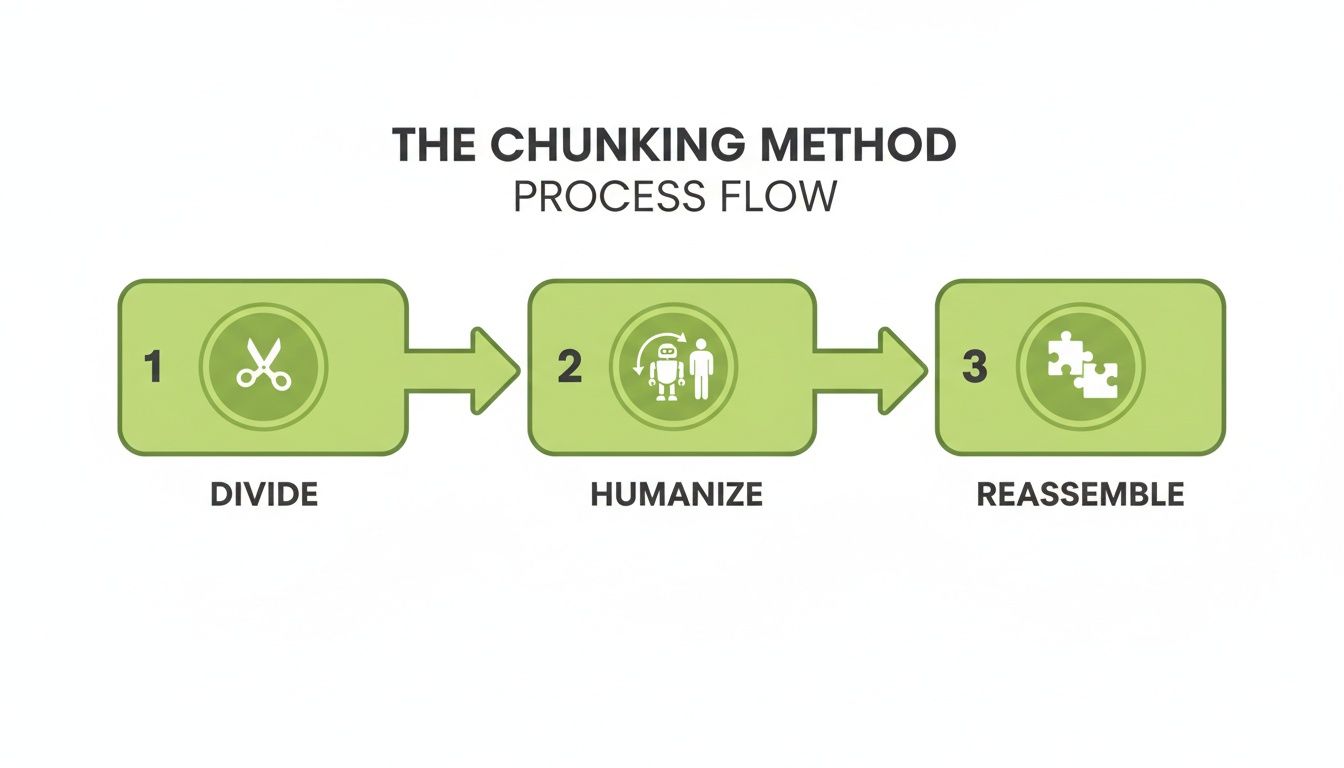

Her gør en strategisk workflow hele forskellen. I stedet for at jage efter en mytisk AI-humanizer uden ordgrænse er den virkelige løsning at arbejde metodisk. Den mest effektive strategi, jeg har fundet, er 'chunking-metoden' – et system til intelligent at opdele, humanisere og gensamle store dokumenter med bibeholdelse af kvaliteten. Det forvandler en skræmmende opgave til en overskuelig, gentagelig proces.

For et dybere dyk ned i forskellige værktøjer og deres styrker, se vores guide til de best AI humanizer muligheder for forskellige typer indhold.

Chunking-metoden til fejlfri humanisering

Så du stirrer på et massivt dokument – en afhandling, en e-bog, måske en pillar page på tusindvis af ord. At forsøge at humanisere det hele på én gang er som at prøve at koge havet. Det er ineffektivt og ødelægger ofte det værktøj, du bruger.

I stedet har du brug for en smartere tilgang. Vi kalder det chunking-metoden. Det handler om at bryde den bunke tekst ned i håndterbare, logiske stykker.

Tænk på det som en arkitekt, der planlægger en bygning, ikke et nedrivningshold, der tilfældigt vælter vægge. Du vil opdele dit dokument langs dets naturlige strukturelle linjer for at holde kontekst og flow intakt.

Her er en praktisk oversigt over, hvordan du vælger dine blokke:

- For en forskningsartikel: Jeg opdeler den efter kerneafsnittene – Introduktion, Litteraturgennemgang, Metode, Resultater og Konklusion. Hver del er et selvstændigt argument, perfekt til bearbejdning ét ad gangen.

- For et langt blogindlæg: H2-underoverskrifterne er dine bedste venner. De signalerer allerede et emneskift og er dermed de mest naturlige brudpunkter.

- For en e-bog eller roman: Det er nemt. Brug kapitlerne. Hvert kapitel har sin egen mini-fortællebue, så det er den ideelle enhed at fodre ind i en humanizer.

Denne strategi sikrer, at når du bearbejder et stykke, har AI'en nok omgivende tekst til at forstå det specifikke punkt, du fremfører i den sektion, hvilket fører til langt bedre og mere relevante resultater.

At finde den ideelle blokstørrelse

Den perfekte blokstørrelse er en balancegang. Du har brug for nok tekst til at bevare den narrative integritet, men ikke så meget, at du overbelaster værktøjet.

De fleste humanizers, herunder HumanText.pro, tilbyder en generøs gratis prøvegrænse, typisk omkring 500 ord. Efter min erfaring er dette det ideelle punkt. Det er stort nok til at dække en komplet idé eller et par detaljerede afsnit uden at miste tråden i argumentationen.

Sådan ser en standard humaniseringsinterface ud – du indsætter en af dine blokke direkte i indtastningsfeltet.

Det rene, enkle layout er afgørende. Når du bearbejder dusinvis af blokke, er det sidste, du ønsker, en kompliceret workflow.

Samling af det humaniserede indhold

Når alle dine blokke er blevet bearbejdet, er det tid til gensamling. Og nej, dette er ikke bare en copy-paste-opgave. Det er her, du tager redaktørhatten på og udjævner sømmene, hvor de forskellige stykker mødes.

Fokuser på at skabe sømløse overgange. Nogle gange afslutter en humanizer en blok med en pæn, afsluttende sætning, men den næste blok er ment til at fortsætte den samme tanke. Du bliver nødt til at gribe ind og manuelt tilpasse de sætninger for at bygge bro over kløften.

Praktisk eksempel:

- Original overgang (akavet): "...og det er grunden til, at solpaneler er effektive." [Slutning af Blok 1] "Geotermisk energi tilbyder en anden bæredygtig mulighed." [Start af Blok 2]

- Forbedret overgang (flydende): "...og det er grunden til, at solpaneler er effektive." [Slutning af Blok 1] "Mens solenergi er et populært valg, tilbyder geotermisk energi en anden bæredygtig mulighed." [Start af Blok 2]

Professionelt tip: Læs hele det samlede dokument højt fra start til slut. Det er den absolut bedste måde at fange akavede skift i tone eller stil, der måtte have sneget sig ind mellem blokkene. Dit mål er en ensartet stemme, der føles helt bevidst.

At få en fornemmelse for ordtællinger er en stor del af optimeringen af denne proces. For at lære mere, se vores guide om how long 500 words really is. Det er en game-changer for at mestre din chunking-strategi.

Lad os blive praktiske. Hvordan fungerer dette egentlig?

Forestil dig, at du har en tæt artikel på 3.000 ord, som en AI har spyttet ud om bæredygtig byplanlægning. Fakta er der, men den er søvndyssende – stiv, robotagtig og skriger "AI" til enhver detektor på markedet. Vores mission er at forvandle den til noget engagerende og, vigtigst af alt, menneskeligt.

Det første træk er simpelt: del den op i blokke. Jeg ville bryde det 3.000-ords-monster ned i seks håndterbare stykker på 500 ord. Tricket er at lave logiske snit. Jeg deler normalt artikler præcis ved H2-underoverskrifterne. Det holder kerneargumentet i hver sektion intakt og forhindrer humanizeren i at miste konteksten og blande dine ideer sammen.

Bearbejdning og kvalitetskontrol

Med mine seks blokke klar til at gå, starter jeg det virkelige arbejde. Jeg tager den første sektion på 500 ord, sætter den ind i HumanText.pro-interfacet og trykker "Humanize". Det tager kun få sekunder.

Men før jeg springer til den næste blok, laver jeg en hurtig kvalitetskontrol af resultatet. Dette trin er ikke til forhandling for mig.

Her er min mini-tjekliste for hvert stykke:

- Budskabets integritet: Bevarede omskrivningen de originale fakta og argumenter? Hvis den originale tekst f.eks. nævnte "en 25% reduktion i emissioner", kan den humaniserede tekst ikke bare sige "en betydelig reduktion".

- Tonkonsistens: Lyder den nye tekst stadig professionel og informativ? Målet er at få den til at lyde bedre, ikke som om den er skrevet af en helt anden person.

Jeg gentager simpelthen denne proces for alle seks blokke og gemmer hvert humaniseret resultat i et nyt dokument. Det er en metodisk tilgang, men den garanterer, at hver del får den opmærksomhed, den har brug for, før den endelige samling.

Hele denne workflow – opdel, humaniser, gensaml – er nøglen til effektivt at håndtere langt indhold.

At bryde en stor opgave ned i mindre, kontrollerede trin som dette er, hvordan du opretholder kvalitetskontrol og ender med et poleret, sømløst endelig udkast.

Gensamling og sidste finpudsning

Når alle blokkene er humaniseret, er det tid til at sy dem sammen igen. Jeg gensamler sektionerne i deres oprindelige rækkefølge. Denne del er mere end en simpel copy-paste-opgave; jeg leder efter sømmene mellem blokkene og udjævner akavede overgange for at sikre, at fortællingen flyder naturligt.

Derefter kører jeg den fulde artikel på 3.000 ord gennem en AI-detektor. Jeg skal se en høj menneskelig score over hele dokumentet, ikke bare i isolerede dele.

Men det mest kritiske sidste trin er en simpel menneskelig gennemlæsning. Jeg læser altid hele artiklen højt. Det er den bedste måde at fange underlige formuleringer eller skurrende sætninger, som software måtte overse. Det er den finpudsning, der adskiller godt indhold fra virkelig fantastisk indhold.

Denne afsluttende kontrol er afgørende. De bedste værktøjer har trods alt en detektionsnøjagtighed på 65-90 %, så den menneskelige verifikation er dit ultimative sikkerhedsnet. Det sikrer, at indholdet ikke bare består en scanning, men faktisk forbinder med et rigtigt menneske.

Hvis du håndterer meget indhold, er det en selvfølge at opgradere til en betalt HumanText.pro-plan. Det fjerner ordgrænser og gør hele workflowet hurtigere og mere effektivt. For flere tips, se vores guide om, hvordan en https://humantext.pro/blog/chat-gpt-humanizer kan løfte din proces. Du kan også integrere denne workflow med førende AI-indholdskalender-værktøjer for at styre hele din indholdspipeline fra skabelse til publicering.

Avancerede strategier for automatisering og skalering

Hvis du driver et indholdsagentur, administrerer en flåde af SEO-sites eller bare har et bjerg af tekst at komme igennem, er den manuelle chunking-proces et reelt slæb. Manuelt at kopiere, indsætte og gensamle tekst er en alvorlig flaskehals, der tærer på det hastighedsforspring, du fik ved at bruge AI i første omgang.

Når du håndterer dusinvis af artikler om ugen, hober den "hurtige" manuelle proces sig op. For virkelig at få dette til at fungere i stor skala, er du nødt til at gå videre end browseren og omfavne automatisering.

Her bliver en API (Application Programming Interface) din nye bedste ven. Tænk på den som en direkte linje fra dine systemer til en AI-humanizer som HumanText.pro, uden menneskelige klik. I stedet for at fodre maskinen med ét lille stykke ad gangen kan du bygge en elegant pipeline, der automatiserer hele sekvensen.

Opbygning af en automatiseret humaniseringspipeline

At opsætte en automatiseret workflow lyder mere skræmmende, end det er. Kerneideen er simpel: skab et system, der kan hente et langt dokument, skære det i perfekt dimensionerede blokke, sende hver af dem til humanizerens API og derefter pænt samle den bearbejdede tekst igen.

Du behøver ikke være udvikler for at klare dette. Det kan gøres med simple scripts eller endda no-code-platforme som Zapier eller Make. Forestil dig en workflow, hvor det at placere en ny AI-udarbejdet artikel i en Google Drive-mappe automatisk starter hele humaniseringsprocessen i baggrunden.

Sådan ser det ud i praksis:

- Trigger: En ny fil tilføjes til en specifik Google Drive-mappe.

- Handling 1 (Automatisk chunking): En Zapier- eller Make.com-workflow opdeler automatisk dokumentet i tekstblokke på 500 ord.

- Handling 2 (API-kald): Workflowet sender hver blok én ad gangen til HumanText.pro API-endpunktet.

- Handling 3 (Gensamling): Scriptet samler alle humaniserede outputs og opretter et nyt dokument i en anden Google Drive-mappe, klar til endelig gennemgang.

At bygge en pipeline som denne er nøglen til at skalere dine indholdsoperationer. En workflow, der engang krævede en times manuelt arbejde, kan gennemføres på minutter, så dit team kan fokusere på strategi, redigering og kreative opgaver.

Når du overvejer kilden til dette indhold, som f.eks. en kraftfuld AI-pressemeddelses-generator, kan du se, hvorfor en strømlinet humaniseringsproces i backend er så kritisk.

Styring af omkostninger og kvalitet i stor skala

Mens automatisering er en game-changer for effektivitet, bringer det også et par nye ting at holde øje med. Når du opererer i stor skala, skal du være smart omkring omkostningsstyring og kvalitetssikring.

Omkostningsstyring: De fleste API-adgange er pay-as-you-go, typisk faktureret pr. tegn eller ord. Før du slår fuld automatisering til, lav et overslag. Estimer dit månedlige volumen og modeller de potentielle omkostninger, så der ingen overraskelser kommer. Det er også en god idé at opsætte advarsler for at overvåge dit forbrug.

Kvalitetssikring: Automatisering er hurtig, men den er ikke perfekt. Et afsluttende menneskeligt eftersyn er ikke til forhandling. Byg et hurtigt kvalitetstjek ind i slutningen af din pipeline. Efter at dokumentet er gensamlet, bør nogen give det en afsluttende gennemlæsning for at udjævne akavede overgange mellem blokke eller rette underlige formuleringer, som maskinen måtte have overset. Denne sidste finpudsning sikrer, at dit skalerede indhold stadig lever op til dine høje standarder.

Undgå almindelige faldgruber i AI-humanisering

Når du bearbejder et langt dokument stykke for stykke, inviterer du nogle subtile problemer, der kan sabotere det endelige produkt, hvis du ikke er opmærksom. Selv den mest sofistikerede AI-humanizer uden ordgrænse-workflow kræver et skarpt øje for at fange disse almindelige fejl. De to største syndere er tonal inkonsistens og konteksttab – begge kan fuldstændig underminere dit indholds troværdighed.

Tonal inkonsistens er skurrende for en læser. Forestil dig, at ét kapitel af din e-bog lyder som en stiv akademisk artikel, men det næste læses som et uformelt, snakkende blogindlæg. Det sker, når humanizeren, der arbejder på isolerede blokke, træffer forskellige stilistiske valg for hvert stykke. Du ender med et usammenhængende rod.

Så er der konteksttab. Det er, når værktøjet simpelthen ikke kan se det store billede. Det kan overse afgørende nuancer, tilbagevendende temaer eller specialiseret terminologi, du omhyggeligt har etableret i tidligere sektioner. Det fører til generiske eller endda modstridende omskrivninger. En humanizer kan forenkle et begreb i én blok, men lade det være højteknisk i en anden, hvilket efterlader din læser fuldstændig forvirret.

Den essentielle sammenhængsredigering

For at løse alt dette skal du absolut udføre en dedikeret "sammenhængsredigering" efter at have samlet dine humaniserede blokke igen. Det er din chance for at ensrette dokumentets stemme og udjævne eventuelle ru overgange. Det er et ikke-forhandlingsbart trin.

Her er en handlingsorienteret tjekliste til din sammenhængsredigering:

- Ensret stemme og tone: Læs det første afsnit af hver hovedsektion. Lyder de, som om de er skrevet af den samme person? Hvis ikke, juster ordvalgene. Eksempel: Erstat "anvende" i én sektion med "bruge", hvis resten af dokumentet er mere uformelt.

- Udjævn overgange: Scan den første sætning i hvert afsnit, der følger efter et sektionsskift. Forbinder den til den forrige idé? Hvis ikke, tilføj en simpel forbindende sætning. Eksempel: Ændr "Dataene viser en tendens" til "I forlængelse af det foregående punkt viser dataene også en tendens."

- Tjek nøgletermer: Brug din tekstbehandlers søgefunktion (Ctrl+F eller Cmd+F) til at finde nøgletermer. Introducerede du en forkortelse som "SEO" i begyndelsen? Sørg for, at du ikke staver "Search Engine Optimization" ud igen i et senere kapitel.

Denne sammenhængsredigering er så meget mere end bare korrekturlæsning. Det handler om at væve individuelle tråde tilbage til et enkelt, sømløst tæppe. Det er det ene trin, der løfter en samling velskrevne afsnit til et virkelig sammenhængende, virkningsfuldt dokument.

Den endelige menneskelige gennemgang

Uanset hvor sofistikerede dine værktøjer er, kan intet erstatte en endelig menneskelig gennemgang. Denne sidste gennemlæsning er, hvor du fanger subtile fejl og tilføjer det sidste lag finpudsning, som automatisering simpelthen ikke kan replikere. Det er din mulighed for at tilføje personlighed, dobbelttjekke fakta og sikre, at indholdet virkelig forbinder med dit publikum.

For bureauer, der skalerer webtekster, er hele denne proces en livredder. Du kan indsætte råt indhold, få en øjeblikkelig AI-score og humanisere det på sekunder, mens kernebetydningen bevares og det afgørende lag af autenticitet tilføjes. Her skinner HumanText.pro virkelig, med sproglige modeller trænet på over 1,2 millioner tekstprøver til at efterligne naturlig skrivning – du behøver ikke engang at tilmelde dig en prøveperiode. Freelancere har fortalt os, at det forvandler poleret AI til engagerende opslag, der klarer enhver kontrol, og hjælper dem med at lande opgaver uden at rejse røde flag. Du kan finde mere information om bypassing AI detection with these methods on papergen.ai.

Almindelige spørgsmål om humanisering af langt indhold

Når du stirrer på et bjerg af AI-tekst, dukker der altid et par spørgsmål op. Det er naturligt at undre sig over logistikken, virkningen og sikkerheden ved processen. Lad os tackle nogle af de mest almindelige spørgsmål, vi hører fra brugere, der tager store projekter op.

Kan denne metode virkelig fungere for en bog eller en afhandling?

Absolut. Det er præcis det, chunking-strategien er designet til. Du skal ikke indsætte et helt manuskript på 80.000 ord i et værktøj på én gang – det ville være kaos. I stedet deler du det op.

Praktisk indsigt: For en afhandling, behandl hvert kapitel (Introduktion, Litteraturgennemgang, Metode osv.) som et separat projekt. Humaniser først alle sektionerne i Kapitel 1, udfør en sammenhængsredigering af det kapitel, og gå først derefter videre til Kapitel 2. Det opdeler arbejdet og forebygger overvældning. For en bog, brug den samme kapitel-for-kapitel-tilgang.

Vil humanisering i batches skade min SEO?

Tværtimod – det bør give din SEO et seriøst løft. Søgemaskiner bliver smartere hver dag, og de er blevet meget gode til at spotte robotagtigt, uhjælpsomt indhold. Når du humaniserer din tekst, selv i stykker, er det endelige produkt mere naturligt og engagerende. Det er en stor gevinst for SEO.

Så længe du samler artiklen logisk igen og bevarer dit keyword-fokus, gør processen dit indhold bedre for rigtige mennesker. Og hvad der er godt for mennesker, er nu også godt for Google.

Den gyldne regel for moderne SEO er at levere reel værdi til dine læsere. Humaniseret indhold er i sagens natur mere værdifuldt, fordi det er klarere, mere engagerende og føles autentisk.

I sidste ende placerer denne tilgang dig præcis i overensstemmelse med det, søgealgoritmer er bygget til at belønne.

Hvordan beskytter HumanText.pro mine følsomme dokumenter?

Vi forstår det. At overdrage følsom akademisk forskning eller fortrolige forretningsplaner er en stor sag. Derfor har vi bygget HumanText.pro med en streng privatlivs-først-politik: vi opbevarer, deler eller bruger ikke dit indhold til noget som helst, især ikke til træning af vores modeller.

I det øjeblik du bearbejder din tekst og lukker sessionen, er den væk fra vores side. Det gælder for alle, uanset om du er på en gratis prøveperiode eller en betalt plan. Din proprietære information forbliver fuldstændig fortrolig, sikker og – vigtigst af alt – din. Altid.

Klar til at stoppe med at bekymre dig om ordgrænser og begynde at skabe indhold, der virkelig forbinder? HumanText.pro giver dig en klar, effektiv workflow til at humanisere tekst af enhver længde. Forvandl dine AI-udkast til højkvalitets tekster, som dit publikum faktisk vil læse.

Besøg https://humantext.pro for at komme gratis i gang.

Klar til at transformere dit AI-genererede indhold til naturlig, menneskelig skrivning? Humantext.pro forfiner din tekst øjeblikkeligt og sikrer at den læses naturligt mens den omgår AI-detektorer. Prøv vores gratis AI-humaniserer i dag →

Relaterede Artikler

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.