Din guide til at bruge en anti-AI-detektor etisk

Opdag hvordan en anti-AI-detektor virker, hvorfor AI-detektion er fejlbehæftet, og hvordan du etisk kan skabe uopdagelig AI-assisteret indhold til dine projekter.

En anti-AI-detektor er ikke et lyssky hackingværktøj. Det er simpelthen software designet til at tage AI-genereret tekst og justere den, så den læses som om den blev skrevet af et menneske, hvilket gør den usynlig for detektionssoftware. Disse værktøjer kaldes ofte AI-humanizers, og deres opgave er at omskrive indhold ved at ændre sætningsstrukturen, ordforrådet og rytmen for at efterligne en naturlig, menneskelig stemme.

Kat-og-mus-spillet om AI-indholdsproduktion

Velkommen til den nye virkelighed inden for digital skrivning: en endeløs jagt mellem AI-indholdsgeneratorer og de detektorer, der er bygget til at opspore dem. Tænk på det som et højteknologisk kat-og-mus-spil. Hver gang en ny AI-skrivemodel kommer ud, er en smartere detektor ikke langt bagefter. Og lige i hælene på den? En endnu bedre anti-AI-detektor. Denne cyklus er den centrale udfordring for forfattere i dag.

Lad os være ærlige – studerende, marketingfolk og kreative bruger alle AI. Det er fantastisk til at komme i gang, brainstorme ideer og slå første udkast ud. Friktionen starter, når det AI-assisterede indhold skal indsendes til en karakter eller offentliggøres online. For at være troværdig skal det føles ægte. Problemet er, at rå AI-tekst ofte efterlader subtile "fingeraftryk", som forudsigelige sætningsmønstre og en robotagtig mangel på stil, som detektorer er bygget til at finde.

Det boomende detektionsmarked

Omfanget af dette frem og tilbage er massivt. Millioner af artikler, essays og rapporter scannes dagligt af værktøjer, der er direkte integreret i akademiske platforme og indholdssystemer. Dette har sat gang i et guldfeber og skabt en enorm industri fokuseret på at opdage maskinskrevet tekst.

Hvor stort er dette marked? Ifølge en analyse blev det globale AI-detektormarked vurderet til 453,2 millioner USD og forventes at eksplodere til 5.226,4 millioner USD i 2033. Det afspejler en forbløffende sammensat årlig vækstrate på 31,6%. Du kan lære mere om disse markedsprognoser og deres indvirkning.

Dette finansielle boom skaber et kraftfuldt incitament for detektorer til at blive endnu mere aggressive, hvilket igen driver efterspørgslen efter effektive humaniseringsværktøjer.

At finde en vej til autenticitet

Målet her er ikke bare at "slå" et stykke software. Det handler om at tage et nyttigt, men fejlbehæftet AI-udkast og forfine det til noget, der afspejler ægte menneskelige tanker og personlighed. Dette er præcis, hvor værktøjer designet til at humanisere tekst kommer ind i billedet og bygger bro mellem maskinlignende effektivitet og menneskelig kreativitet.

Sådan ser en typisk anti-AI-detektor-grænseflade ud, bygget til enkelhed og hastighed.

Hele arbejdsgangen er designet til at være ren og intuitiv: du indsætter din tekst, analyserer den og humaniserer den med ét klik. Dette er bygget til forfattere, der har brug for pålidelige resultater uden en kompliceret proces. I sidste ende handler udfordringen ikke kun om at få en bestået score; det handler om at genvinde den naturlige stemme i din skrivning.

Hvordan AI-detektorer opdager deres digitale fingeraftryk

For at komme uden om AI-detektorer skal du først forstå, hvad de faktisk leder efter. Tænk på AI-genereret tekst som havende et subtilt, men konsistent "sprogligt fingeraftryk". Det er usynligt for en tilfældig læser, men det består af forudsigelige mønstre, som specialiserede algoritmer er trænet til at opdage.

Disse værktøjer er ikke magi. De er bare meget sofistikerede mønstergenkendelsessystemer. De analyserer tekst baseret på et par kerneprincipper, der næsten altid adskiller maskinskrivning fra menneskelig skrivning. Når du forstår disse principper, vil du se præcis, hvor AI-genereret indhold kommer til kort – og hvorfor humanisering af det virker så godt.

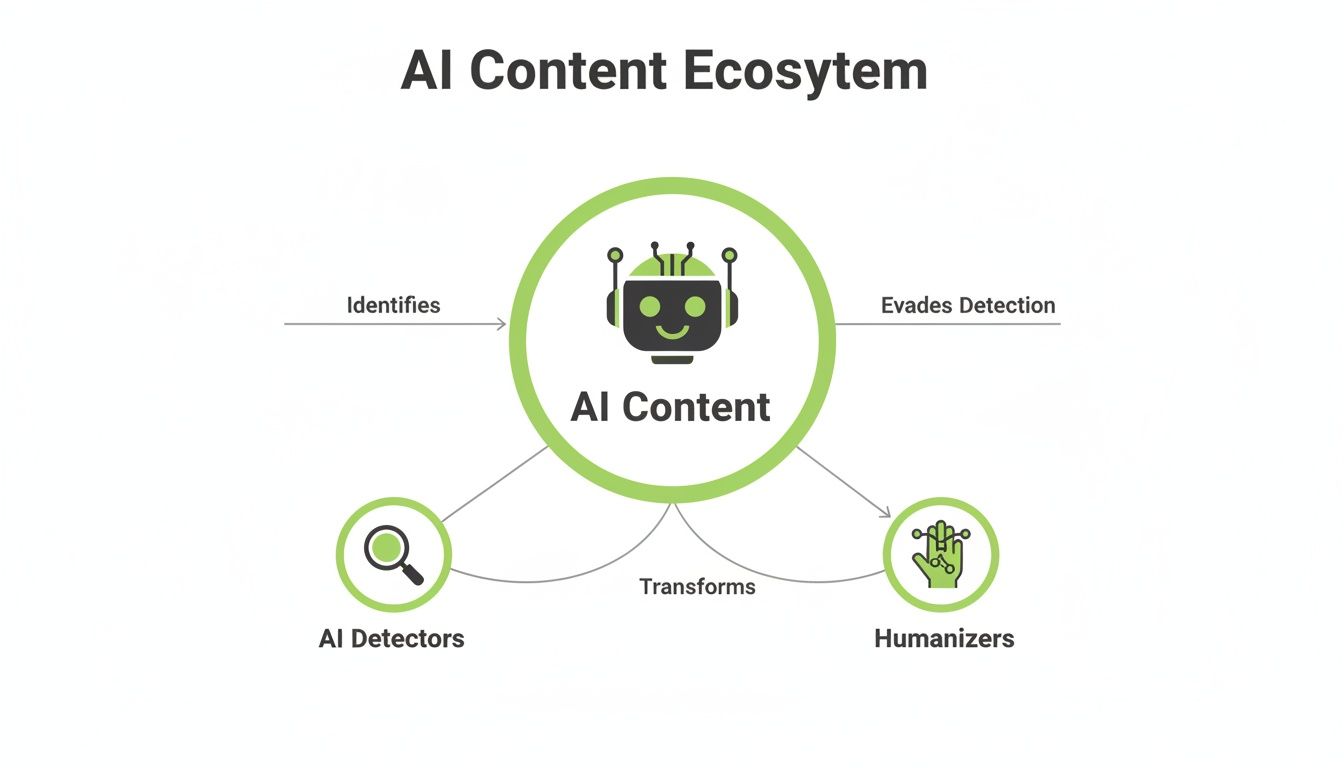

Dette kort viser skub-og-træk-forholdet mellem AI-indhold, detektorerne bygget til at opspore det og humanizers designet til at gøre det uopsporeligt.

Dette hele økosystem drejer sig om et centralt kat-og-mus-spil: AI genererer tekst, detektorer undersøger den, og humanizers forfiner den.

Jagten på forudsigelighed (lav perplexitet)

En af de største afslørende tegn på AI-indhold er, hvor forudsigeligt det er. I deres kerne er AI-modeller ekspert-gættere. De er trænet til at vælge det statistisk mest sandsynlige næste ord, igen og igen. Dette skaber tekst, der er glat og logisk, men ofte mangler ægte gnist eller originalitet.

I tekniske termer måles dette ved perplexitet. En lav perplexitetsscore betyder, at teksten er meget forudsigelig, som en musiker, der kun spiller de samme tre akkorder i samme rækkefølge. Menneskelig skrivning derimod er naturligt mere kaotisk. Den har en højere perplexitet, fordi vi bruger uventede ord, mærkelige formuleringer og kreative sætningsstrukturer.

- Praktisk eksempel: En AI kunne fuldføre sætningen "Himlen er..." med "blå." Det er det mest almindelige, statistisk sikre svar. En menneskelig forfatter, der sigter mod en mere fremkaldende tone, kunne vælge "et forslået lilla" eller "farven af gammel tv-støj." Disse mindre forudsigelige valg øger perplexiteten.

Detektorer er bygget til at analysere netop denne kvalitet. Hvis et stykke skrivning er lidt for perfekt, og dets ordvalg altid er de mest indlysende, udløser det et rødt flag. Det er et klassisk tegn på, at en maskine sad bag tastaturet.

Analyse af sætningsvariation (burstiness)

En anden nøglemåling er burstiness. Menneskelig skrivning flyder naturligt op og ned. Vi skriver måske et par korte, slagkraftige sætninger og følger dem derefter op med en længere, mere kompleks. Denne variation i sætningslængde og struktur skaber en dynamisk, engagerende rytme.

AI-modeller? Ikke så meget. De har tendens til at producere sætninger af meget ensartet længde og kompleksitet. Deres output er ofte stabilt og monotont og mangler de "bursts" af kreativitet, der findes i menneskelig prosa. En AI-detektor måler denne konsistens; hvis teksten er for flad, er det mere sandsynligt, at den bliver markeret.

- Handlingsorienteret indsigt: Efter at have genereret AI-tekst, gennemgå og bryd bevidst rytmen. Kombiner to korte sætninger til en længere med en konjunktion som "men" eller "mens". Tag derefter en lang, kompleks sætning og opdel den i to eller tre korte, slagkraftige. Denne enkelte redigeringsgennemgang kan dramatisk øge burstiness.

Et effektivt anti-AI-detektorværktøj bytter ikke bare et par ord ud. Det omstrukturerer sætninger intelligent, introducerer varierede rytmer og bryder den robotagtige ensartethed op for at øge både perplexitet og burstiness, hvilket gør teksten statistisk uadskillelig fra noget en person skrev.

Dette detektionsvåbenkapløb er blevet drevet af den enorme mængde AI-indhold derude. ChatGPT's markedsdominans har for eksempel skabt et massivt, ensartet datasæt for detektorer at træne på. I et nyligt år havde ChatGPT en utrolig 60,2% af den globale AI-værktøjsmarkedsandel.

Dette har ført til en stigning i detektion, hvor platforme som Turnitin gennemgår 200 millioner studenteropgaver på et enkelt år og markerer 11% af dem for betydelig AI-brug. Du kan dykke ned i flere data om AI-værktøjsbrug og dens indvirkning på Statista.com.

Almindelige AI-detektionsmetoder på et øjeblik

Så hvordan identificerer detektorer faktisk disse digitale fingeraftryk? De bruger flere metoder, og selvom teknologien bliver kompliceret, falder de grundlæggende tilgange i et par hovedkategorier.

Denne tabel opdeler de mest almindelige teknikker på højt niveau.

| Detektionsmetode | Hvad analyseres | Simpel analogi |

|---|---|---|

| Statistisk analyse | Forudsigelighed (perplexitet), sætningsvariation (burstiness) og ordfrekvens. | En musikkritiker, der analyserer, om en sang er for simpel og repetitiv til at være skrevet af en erfaren komponist. |

| Klassifikatorbaserede modeller | Komplekse, kombinerede mønstre lært fra millioner af menneskelige vs. AI-skriveprøver. | En højt uddannet kunstekspert, der kan spotte en forfalskning ved at bemærke tusindvis af små, subtile penselstrøg, der ikke "føles" rigtigt. |

| Forensisk analyse | Skjulte metadata eller digitale artefakter efterladt af en specifik AI-model. | En detektiv, der leder efter fingeraftryk på et gerningssted. |

| Vandmærkning | Usynlige signaler eller mønstre indlejret direkte i AI'ens output af dens skabere. | Et skjult vandmærke på en pengeseddel, der kun er synligt under et specielt lys. |

Hver metode har sine styrker, men de deler alle en fælles sårbarhed: de er afhængige af mønstre. Og mønstre kan bevidst forstyrres. Ved at forstå disse teknikker bliver det meget klarere, hvordan værktøjer som ZeroGPT finder deres mål.

Hvis du er interesseret i et dybere kig på at komme forbi et specifikt værktøj, så tjek vores guide om hvordan du omgår ZeroGPT-detektion.

Hvorfor AI-detektor-scores kan være vildledende

En AI-detektors score kan føles som en endelig dom, men den er langt fra ufejlbarlig. Disse værktøjer opererer på sandsynligheder, ikke sikkerhed, hvilket betyder, at deres domme ofte bare er uddannede gæt. At stole fuldt ud på dem er som at stole på en vejr-app, der kun har ret nogle gange – du får måske solskin, eller du bliver måske fanget i en storm.

Denne indbyggede usikkerhed fører til et betydeligt og bekymrende problem: falske positiver. En falsk positiv opstår, når tekst skrevet helt af et menneske fejlagtigt bliver markeret som værende genereret af AI. Dette er ikke en sjælden fejl; det er en almindelig fejl, der kan have alvorlige konsekvenser for studerende, forfattere og fagfolk, der pludselig finder deres autentiske arbejde uretfærdigt stillet spørgsmålstegn ved.

Når menneskelig skrivning ser robotagtig ud

Så hvorfor bliver perfekt menneskeligt arbejde forvekslet med AI? Årsagerne ligger ofte i skrivningsstile, der simpelthen ikke matcher, hvad detektoren betragter som "normal". Enhver strategi til at navigere i disse værktøjer skal tage højde for deres iboende bias.

For eksempel lærer ikke-modersmålstalende af engelsk ofte sproget på en meget struktureret, formel måde. Deres skrivning kan naturligt have lavere "perplexitet" og "burstiness" – præcis de egenskaber, som detektorer er trænet til at associere med maskiner. Tilsvarende bliver forfattere inden for tekniske eller akademiske områder lært at være direkte og præcise, en stil der nemt kan efterligne den ligefremme karakter af AI-genereret tekst.

Her er et par scenarier, hvor menneskelige forfattere har høj risiko for at få en falsk positiv:

- Formel akademisk skrivning: Essays, der følger strenge strukturelle regler og bruger formelt sprog.

- Teknisk dokumentation: Manualer eller rapporter, hvor klarhed prioriteres over stilistisk flair.

- Ikke-modersmålstalende: Personer, hvis sætningskonstruktion kan være grammatisk perfekt, men mindre varieret.

En "100% Menneske"-score er ikke en garanti for kvalitet, ligesom en "90% AI"-score ikke er definitivt bevis på maskingenerering. Disse scores er blot datapunkter, og de skal behandles med sund skepsis, ikke blind tillid.

Problemets omfang

Den eksplosive vækst af AI-detektorer i uddannelse er et massivt vågn-op-kald. I et enkelt akademisk år undersøgte Turnitin 200 millioner opgaver og markerede 11% af dem – det er 22 millioner dokumenter – som indeholdende mere end 20% AI-genereret indhold. Selvom dette fremhæver omfanget af detektion, understreger det også det enorme pres på studerende og det himmel-høje potentiale for fejl, når millioner af opgaver scannes automatisk.

Når du arbejder med så store tal, kan selv en lille fejlrate påvirke tusindvis af individer. En studerende kan blive mødt med anklager om akademisk uærlighed, eller en professionel forfatter kan miste en klients tillid, alt sammen baseret på en fejlbehæftet algoritmisk score.

Falske negativer: Den AI, der slipper igennem

På den anden side af mønten er falske negativer, hvor AI-genereret indhold med succes narrer en detektor og får en "menneskelig" score. Efterhånden som sprogmodeller bliver mere sofistikerede, forbedres deres evne til at efterligne menneskelig skrivning, hvilket gør dem meget sværere at fange. Dette gælder især for indhold, der er blevet let redigeret eller kørt gennem en AI-humanizer.

Eksistensen af både falske positiver og falske negativer afslører en kritisk sandhed: AI-detektorer er simpelthen ikke pålidelige nok til at være den eneste dommer af en teksts oprindelse. De kan være et nyttigt værktøj til indledende analyse, men deres scores bør aldrig nogensinde tilsidesætte menneskelig vurdering. For dem, der ønsker at forstå, hvordan humanizers arbejder for at bekæmpe disse problemer, kan du lære mere om om uopdagelig AI virkelig virker i vores detaljerede guide. Denne kontekst er afgørende for alle, der bruger AI-assisterede skriveværktøjer ansvarligt.

Handlingsorienterede strategier til humanisering af AI-indhold

At vide hvorfor AI-detektorer markerer dit indhold er halvdelen af kampen. At vide hvordan man fikser det er, hvor det rigtige arbejde begynder. At transformere robotagtig, forudsigelig AI-tekst til noget, der ånder med menneskelig personlighed, er ikke magi – det handler om at anvende specifikke, hands-on skriveteknikker.

Dette er afspilningsbogen for at omdanne et sterilt første udkast til overbevisende, autentisk indhold, der faktisk forbinder med læsere og sejler forbi detektorer.

Disse manuelle strategier er selve grundlaget for, hvordan et effektivt anti-AI-detektorværktøj fungerer. Når du forstår dem, vil du sætte pris på de komplekse sproglige justeringer, som humanizers anvender automatisk, hvilket sparer dig for timer med kedelig redigering.

Mestre sætningsstruktur og flow

Det afslørende tegn nummer et på AI-skrivning er dens monotone rytme. AI-modeller er trænet på ensartethed, så de spytter ofte sætninger af lignende længde og struktur ud, den ene efter den anden. Din første opgave er at knuse det mønster og introducere en naturlig kadence.

Det er her, du fokuserer på at øge burstiness. Bland det. Skriv en kort, slagkraftig sætning. Følg den med en lang, flydende, der indeholder flere led. Den variation er kendetegnet for menneskelig udtryk.

Før (AI-genereret):

"Implementeringen af nye softwaresystemer kan præsentere betydelige udfordringer for organisationer. Medarbejdere kræver ofte omfattende træning for at tilpasse sig de nye arbejdsgange. Denne proces kan være tidskrævende og kan påvirke indledende produktivitetsniveauer."

Efter (Humaniseret):

"At rulle ny software ud er hårdt. Medarbejdere står over for en stejl læringskurve, og den tilpasningsperiode æder ind i produktiviteten – det er bare en del af processen."

"Efter"-versionen kombinerer ideer, dropper det formelle sprog og varierer sætningslængden, hvilket skaber et langt mere engagerende og menneskelignende flow.

Injicer din unikke stemme og personlighed

AI-modeller har ikke meninger, personlige erfaringer eller sans for humor. De kan kun efterligne dem baseret på træningsdata. For virkelig at humanisere et stykke tekst skal du gennemtrænge det med dit eget unikke perspektiv. Dette er et kritisk skridt, som ingen maskine nogensinde helt kan replikere.

Sådan gør du det:

- Tilføj personlige anekdoter: Del en kort, relevant historie. At starte med "Jeg husker en tid, hvor..." signalerer straks et menneskeligt præg. I stedet for at sige, at AI forbedrer arbejdsgangen, beskriv et specifikt projekt, hvor det halverede din researchtid.

- Brug specifikke, konkrete eksempler: I stedet for at sige "forskellige faktorer", så list dem op. Forklar abstrakte begreber i virkelige scenarier, dit publikum forstår.

- Inkorporer talemåder og kollokvialismer: Brug sætninger som "bide i det sure æble" eller "en velsignelse i forklædning". Disse er ofte for nuancerede til, at AI kan bruge dem korrekt og naturligt.

Interessant nok overlapper mange af principperne for at humanisere AI-indhold med generelle best practices for at skrive godt. Ved at fokusere på stemme og autenticitet omgår du ikke bare detektorer; du bliver en bedre forfatter. For et dybere dyk, udforsk disse strategier for at skabe engagerende indhold.

Diversificer dit ordforråd og formulering

AI-modeller har en liste over "yndlingsord". De læner sig stærkt på visse formelle og generiske termer, fordi de er statistisk almindelige i de data, de blev trænet på. Dit mål er at spotte disse gentagne ord og bytte dem til mere interessante, mindre forudsigelige alternativer.

Tænk på det som at tilføje krydderi til en fad ret. Drop de kedelige verber og adjektiver for mere dynamiske.

| Almindeligt AI-ord | Humaniseret alternativ |

|---|---|

| Endvidere | Oveni købet / Plus |

| Følgelig | Som et resultat / Så |

| Afgørende / Vital | Nøgle / En nødvendighed |

| Til sidst | For at afrunde / I sidste ende |

De bedste anti-AI-detektorteknikker fokuserer på at gøre tekst mindre perfekt. Menneskelig skrivning er fyldt med særheder, lidt usædvanlige ordvalg og bevidste stilistiske afvigelser. Omfavn lidt ufuldkommenhed for at opnå ægte autenticitet.

Faktaktjek og tilføj kritisk indsigt

Endelig, stol aldrig blindt på de oplysninger, en AI giver dig. Sprogmodeller er kendt for at "hallucinere", selvsikkert udtalende ting, der er forkerte. Det vigtigste humaniseringstrin er manuelt at verificere hver eneste påstand, statistik og datapunkt.

Men stop ikke ved bare at være nøjagtig. Gå dybere ved at tilføje din egen kritiske analyse.

- Stil spørgsmålstegn ved AI'ens output: Giver denne konklusion faktisk mening? Er der et andet perspektiv at overveje?

- Tilføj din egen analyse: Forklar hvorfor et bestemt faktum er vigtigt, eller hvad dets implikationer er. Hvis en AI for eksempel angiver, at et marked vil vokse med 10%, tilføj din analyse om hvilke specifikke segmenter, der vil drive den vækst.

- Forbind forskellige ideer: Træk forbindelser mellem punkter, som AI'en var for lineær til at lave.

Dette lag af menneskelig intelligens og kritisk tænkning er dit ultimative forsvar mod detektion. Det løfter indholdet fra en simpel resumé af information til et værdifuldt, indsigtsfuldt stykke, der utvivlsomt er dit.

At navigere i den etiske labyrint af AI-humanizers

Kraften i et anti-AI-detektor-værktøj rejser et kritisk spørgsmål: hvor ligger ansvaret? På den ene side er disse værktøjer fantastiske til at polere udkast og smadre igennem skriveblokade. På den anden side kan de være en genvej til akademisk uærlighed. Det er afgørende at trække en fast linje.

Tænk på en AI-humanizer mindre som en tryllestav, der skaber arbejde ud af ingenting, og mere som en utrolig avanceret stavekontrol. Dens rigtige job er at polere, afklare og løfte tekst, du allerede har konceptualiseret og struktureret. Kerneidéerne, argumenterne og indsigterne skal starte med dig.

AI som affyringsrampe, ikke som faldskærm

Den mest ansvarlige måde at nærme sig AI-humanizers på er ved at behandle AI-genereret tekst som et udgangspunkt – en affyringsrampe for din egen tænkning. AI er genial til at spytte et generisk, grundlæggende udkast ud. Den kan opsummere komplekse emner eller skitsere nøglepunkter på sekunder, hvilket sparer dig for en masse tid.

Men den indledende output er bare råmateriale. Dit job er at bygge på det, udfordre dets antagelser og injicere dit unikke perspektiv og analyse.

Den etiske linje krydses i det øjeblik, AI'ens bidrag opvejer dit eget. Hvis det endelige arbejde ikke afspejler din kritiske tænkning, personlige stemme og intellektuelle indsats, bruger du ikke længere et værktøj – du delegerer dit ansvar.

Denne skelnen er alt. At bruge en AI til at hjælpe med at udkaste en outline eller forklare et tricky koncept er bare smart. Men at indsende et let omformuleret AI-essay som dit eget? Det underminerer fuldstændig akademisk og professionel integritet.

Søjlerne for ansvarlig brug

For at holde dig på den rigtige side af den etiske kløft, hold dig til disse vejledende principper. De vil hjælpe dig med at bruge AI-humanizers til at forbedre dit arbejde uden at kompromittere din integritet.

- Du er forfatteren: Det endelige stykke skal være et produkt af din intellektuelle arbejdskraft. AI kan hjælpe med sætningsstruktur og ordvalg, men analysen, beviserne og konklusionerne skal være dine.

- Original tanke er konge: Brug AI til at overvinde en skriveblokering, ikke en tænkeblokering. Målet er at artikulere dine ideer mere effektivt, ikke at lade maskinen have ideerne for dig.

- Faktjek er ikke til forhandling: Du er 100% ansvarlig for nøjagtigheden af hver påstand i dit arbejde. AI-modeller kan og gør opdigtninger, så du skal verificere hver statistik, dato og faktum på egen hånd.

En ramme for etisk anvendelse

Så hvordan ser dette ud i den virkelige verden? Lad os overveje et par scenarier for etisk brug af et anti-AI-detektor-værktøj.

Etisk anvendelsestilfælde: En studerende bruger ChatGPT til at generere en resumé af tre forskellige økonomiske teorier til et essay. Hun skriver derefter sin egen analyse, der sammenligner og kontrasterer dem. Endelig bruger hun en AI-humanizer til at forfine sin prosa og sikre, at den flyder naturligt og lyder menneskelig. Her tjente AI'en som forskningsassistent, men den kritiske tænkning var helt hendes.

Uetisk anvendelsestilfælde: En marketingmedarbejder genererer et helt blogindlæg med et AI-værktøj, bytter et par ord om og kører det gennem en humanizer for at omgå detektorer, før det offentliggøres som originalt indhold. Dette er dybest set plagiat, da det intellektuelle kernearbejde blev udført af maskinen, ikke personen.

Ved at adoptere denne tankegang kan du selvsikkert bruge disse kraftfulde værktøjer til at blive en mere effektiv og poleret forfatter, alt imens du holder din integritet intakt.

Den praktiske anvendelse: En anti-AI-detektor i aktion

Al teorien er fantastisk, men lad os se, hvordan dette fungerer i den virkelige verden. Det er her, vi går fra abstrakte begreber til et hands-on kig på, hvordan et værktøj kan transformere et fladt, AI-genereret afsnit til noget, der føles ægte menneskeligt. Hele processen er bygget til hastighed og enkelhed.

Lad os starte med et stykke tekst direkte fra en AI. Det er rent, grammatisk korrekt og formidler pointen. Men det er også lidt... livløst. Det har den forudsigelige rytme og sikre ordvalg, som AI-detektorer er trænet til at opdage fra en kilometer væk. Dette er præcis den slags skrivning, der bliver markeret for sin robotagtige struktur og lave perplexitet.

Fra robotagtig til realistisk i tre enkle trin

Med et værktøj som humantext.pro er arbejdsgangen utrolig ligetil. Idéen er at tage det AI-udkast, lade teknologien identificere dets maskinlignende træk og derefter omskrive det til at lyde helt naturligt – alt sammen uden at ændre kernebeskeden.

Her er opdelingen i kun tre trin:

- Indsæt og analyser: Du starter med at indsætte din rå AI-tekst direkte i værktøjet. Det kører en hurtig scanning og giver dig normalt en score, der viser, hvor sandsynligt det er at blive markeret af detektorer.

- Humaniser med ét klik: Dette er den magiske knap. Du trykker på "Humaniser", og algoritmen går i gang. Den bytter ikke bare ord ud; den omstrukturerer sætninger, varierer ordforrådet og justerer det overordnede flow for at gøre det mindre forudsigeligt.

- Gennemgå og kør: På få sekunder får du den omskrevne version. Outputtet er klar til brug, justeret lige nok til at overtage de subtile særheder og nuancer af menneskelig skrivning.

Dette billede giver dig et perfekt før-og-efter-snapshot, der viser, hvordan en høj AI-detektionsscore vendes til en menneskelig.

Det rigtige take-away her er det dramatiske skift i tekstens DNA. Den humaniserede version har mere variation i sætningslængde og bruger mindre almindelige ordkombinationer, hvilket gør den statistisk næsten identisk med noget en person ville skrive. For at dykke dybere ned i den teknologi, der gør dette muligt, tjek vores fulde guide om AI-indholdshumanizer.

Ud over et enkelt værktøj

Fordelene er klare: det er hurtigt, nemt, og det virker. Dette viser, hvordan disse værktøjer kan glide ind i en effektiv og etisk skriveproces. Mens vi fokuserer på humanizers her, er det værd at huske, at de er en del af et meget større økosystem af forskellige AI-indholdsværktøjer designet til alle slags kreative behov.

Ved at håndtere de kedelige dele af redigering giver en AI-humanizer dig tiden tilbage til at fokusere på det, der virkelig betyder noget: idéerne, argumenterne og de unikke indsigter, som kun et menneske kan bringe. Det er en smart måde at polere AI-assisterede udkast til virkelig autentisk arbejde.

Dine spørgsmål om AI-detektorer, besvaret

Verdenen af AI-skrivning og -detektion er fuld af gråzoner. Hvis du føler dig lidt fortabt, er du ikke alene. Lad os rydde op i nogle af de mest almindelige spørgsmål, vi hører.

Kan AI-detektorer nogensinde være 100 procent nøjagtige?

Absolutt ikke. Det er umuligt for nogen AI-detektor at opnå 100% nøjagtighed. Disse værktøjer er bygget på sandsynligheder og statistiske mønstre, ikke definitivt bevis. De laver et uddannet gæt, ikke en dom.

Dette betyder, at de altid vil have en fejlmargin, hvilket fører til både falske positiver (markering af menneskelig skrivning som AI) og falske negativer (manglende AI-genereret tekst). Ting som din personlige skrivningsstil, emnets kompleksitet eller endda den specifikke anvendte AI-model kan kaste en detektor af sporet.

Tænk på en detektionsscore som et forslag, ikke en dom. Det er ét datapunkt, der kræver en menneskelig gennemgang, ikke en endelig dom. En anti-AI-detektor hjælper simpelthen med at flytte tekstens statistiske profil til at ligne de mønstre, mennesker naturligt skaber.

Er det uetisk at bruge et anti-AI-detektorværktøj?

Etikken kommer ned til én simpel ting: din hensigt.

Bruger du et værktøj til at polere et AI-assisteret udkast, få det til at flyde bedre og lyde mere som dig? Det er bare smart redigering. Det er ikke anderledes end at bruge en sofistikeret grammatikkontrol til at forfine dit arbejde.

Men hvis dit mål er at udgive 100% AI-genereret arbejde som din egen originale tanke – især i skolen eller på arbejdet – har du krydset en grænse. Den etiske tilgang er at bruge AI som en samarbejdspartner, ikke en ghostwriter. Du leverer ideerne, du har det sidste ord, og du tager ansvaret for det færdige produkt.

Hvordan omgår AI-humanizers faktisk detektion?

AI-humanizers virker ved i det væsentlige at reverse-engineere detektionsprocessen. De ved, hvad detektorer leder efter, og demonterer systematisk disse mønstre.

De starter med at rode med tekstens rytme, varierer sætningslængder og -strukturer for at skabe mere "burstiness" – den let uforudsigelige kadence af menneskelig skrivning. De bytter også almindelige, højsandsynlige AI-ordvalg til mindre forudsigeligt ordforråd, hvilket sænker tekstens "perplexitet".

Kort sagt tager de et stykke skrivning, der er statistisk for perfekt, og introducerer det subtile, organiske kaos, der definerer menneskelig udtryk, alt sammen uden at ændre kernebetydningen.

Klar til at omdanne dine AI-udkast til autentisk, poleret indhold, der sejler forbi detektorer? Med humantext.pro kan du humanisere din tekst med et enkelt klik og sikre, at den lyder naturlig og er klar til dit publikum. Prøv det nu og se forskellen selv.

Klar til at transformere dit AI-genererede indhold til naturlig, menneskelig skrivning? Humantext.pro forfiner din tekst øjeblikkeligt og sikrer at den læses naturligt mens den omgår AI-detektorer. Prøv vores gratis AI-humaniserer i dag →

Relaterede Artikler

AI Writing Assistance: Master Ethical Content Creation

Master AI writing assistance: learn workflows, best practices, & ethical use to create high-quality, human-sounding content that truly works.

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.