Sådan omgår du Originality AI og humaniserer dit indhold

Lær hvordan du omgår Originality AI med dokumenterede teknikker. Vores guide viser dig, hvordan du humaniserer AI-tekst for at undgå detektion og sikre, at dit indhold består.

Den mest effektive måde at håndtere et værktøj som Originality.AI på er at "humanisere" din tekst. Dette betyder at tage et AI-genereret udkast og grundigt omskrive det for at introducere varierede sætningsstrukturer, inkorporere unikt ordforråd og tilføje dine egne personlige indsigter. Det er en proces med enten manuel redigering for nuancer og flow eller i nogle tilfælde at bruge et AI-humaniseringsværktøj til automatisk at omarbejde de skrivemønstre, som detektorer er trænet til at markere.

Realiteten af fejlbehæftet AI-detektion

Lad os være klare: AI-genereret indhold er en massiv fordel for forfattere, marketingfolk og studerende. Men det kommer med et stort problem—fejlbehæftede AI-detektorer. Disse værktøjer er designet til at opdage maskinskrevet tekst, men de ender ofte med at straffe legitimt, AI-assisteret arbejde.

Forestil dig en travl marketingmedarbejder, der bruger en AI-assistent til at oprette et første udkast til et blogindlæg. De bruger timer på at redigere det og væve deres egen ekspertise og brandstemme ind, kun for at se det blive markeret som 100% AI. Pludselig er denne artikel i fare for at blive degraderet af søgemaskiner. Scenarier som dette sker hver dag.

Problemet er, at disse detektorer ikke måler sandhed, kvalitet eller værdi. De måler mønstre. De leder efter de forudsigelige sætningsstrukturer og almindelige ordvalg, som store sprogmodeller har tendens til at producere. Dette skaber en frustrerende fælde, hvor selv stærkt redigeret, højkvalitetsindhold kan udløse en falsk positiv og bringe dit hårde arbejde i fare.

Hvorfor "humanisering" er en nødvendig færdighed

Denne guide handler ikke om at fremme akademisk uærlighed eller producere spam. Den handler om en afgørende strategi for moderne forfattere: humanisering.

Humanisering er kunsten at forfine AI-assisteret skrivning til højkvalitetsindhold, der ikke kan detekteres, og som afspejler ægte menneskelige nuancer. Det handler om at tage den rå effektivitet af AI og lægge det sammen med kreativiteten, stemmen og det unikke perspektiv, som kun en person kan levere.

Denne tilgang er afgørende for alle, der bruger AI-værktøjer ansvarligt:

- Studerende, der bruger AI til brainstorming, men skriver deres egne endelige essays.

- Indholdsskabere, der er afhængige af AI til indledende outline og research.

- SEO-specialister, der skal producere store mængder indhold uden at blive straffet.

At fokusere på humanisering handler ikke om at forsøge at snyde systemet. Det handler om at sikre, at systemet ikke uretfærdigt snyder dig for anerkendelse for dine unikke bidrag og omhyggelige redigering.

Bevæge sig ud over gætværk

Målet her er at navigere effektivt i dette nye landskab. For at gøre det har du brug for en praktisk, gentagelig metode til at komme forbi Originality.AI og andre detektorer uden at ødelægge kvaliteten af dit arbejde. Dette betyder at lære, hvordan disse detektorer tænker, hvad de leder efter, og præcis hvordan du redigerer din tekst for at undgå deres algoritmiske snubletråde.

Denne guide leverer det klare køreplan. Vi vil opdele de specifikke mekanikker i AI-detektion, demonstrere handlingsvenlige manuelle redigeringsteknikker og introducere workflows, der hjælper dig med at producere autentisk, effektivt indhold. Tænk på det som din praktiske guide til at sikre, at dit arbejde bedømmes på dets fortjeneste, ikke på de værktøjer, du brugte til at skabe det.

Hvordan AI-detektorer faktisk virker

Hvis du vil komme forbi AI-detektion, skal du først forstå din modstander. AI-detektorer er ikke magi—de er bare meget sofistikerede mønstergenkendelsesværktøjer. De er blevet trænet på enorme biblioteker af tekst og lærer at opdage de subtile, statistiske fingeraftryk, som maskingenereret skrivning efterlader.

Disse værktøjer bekymrer sig ikke om, hvorvidt din skrivning er god eller dårlig, sand eller falsk. De jager simpelthen tegn. For at gøre dette analyserer tjenester som Originality.ai eller GPTZero to centrale sproglige træk: perpleksitet og burstiness. At få en fornemmelse af disse to begreber er forskellen mellem blindt at bytte ord og redigere med et formål.

Forudsigeligheds-problemet: Perpleksitet

Perpleksitet er bare et flot ord for, hvor forudsigelig din skrivning er. Du kan tænke på det som en "overraskelses"-score. Menneskelig skrivning er naturligvis lidt kaotisk og overraskende. Vi bruger mærkelige analogier, blander almindelige ord med obskure og holder generelt tingene interessante.

AI-modeller er imidlertid bygget til at vælge det statistisk mest sandsynlige næste ord. Dette får deres output til at lyde logisk og grammatisk rent, men det er også utroligt sikkert. Ordvalgene er forventede, hvilket resulterer i en lav perpleksitetsscore—et massivt rødt flag for enhver detektor.

Praktisk eksempel: En AI kan generere: "Den økonomiske nedgang havde en betydelig negativ indvirkning på de globale finansielle markeder." Det er teknisk perfekt, men kedeligt. Et menneske kunne skrive: "Økonomiens styrtdyk sendte chokbølger gennem de globale markeder og efterlod investorer i panik efter beskyttelse." Den anden version er langt mindre forudsigelig og har en meget højere perpleksitet.

Skrivningens rytme: Burstiness

Burstiness handler om rytmen og strukturen i dine sætninger. Mennesker skriver i udbrud. Vi følger en lang, snoet sætning med en kort, kontant for at lægge vægt. Dette skaber en naturlig kadence, som maskiner har svært ved at efterligne.

AI-genereret tekst lyder derimod ofte monoton. Sætningerne har tendens til at være af lignende længde og struktur, hvilket skaber et ensformigt, robotagtigt flow. Denne mangel på variation, eller lav burstiness, er et andet dødt giveaway for detektionssoftware.

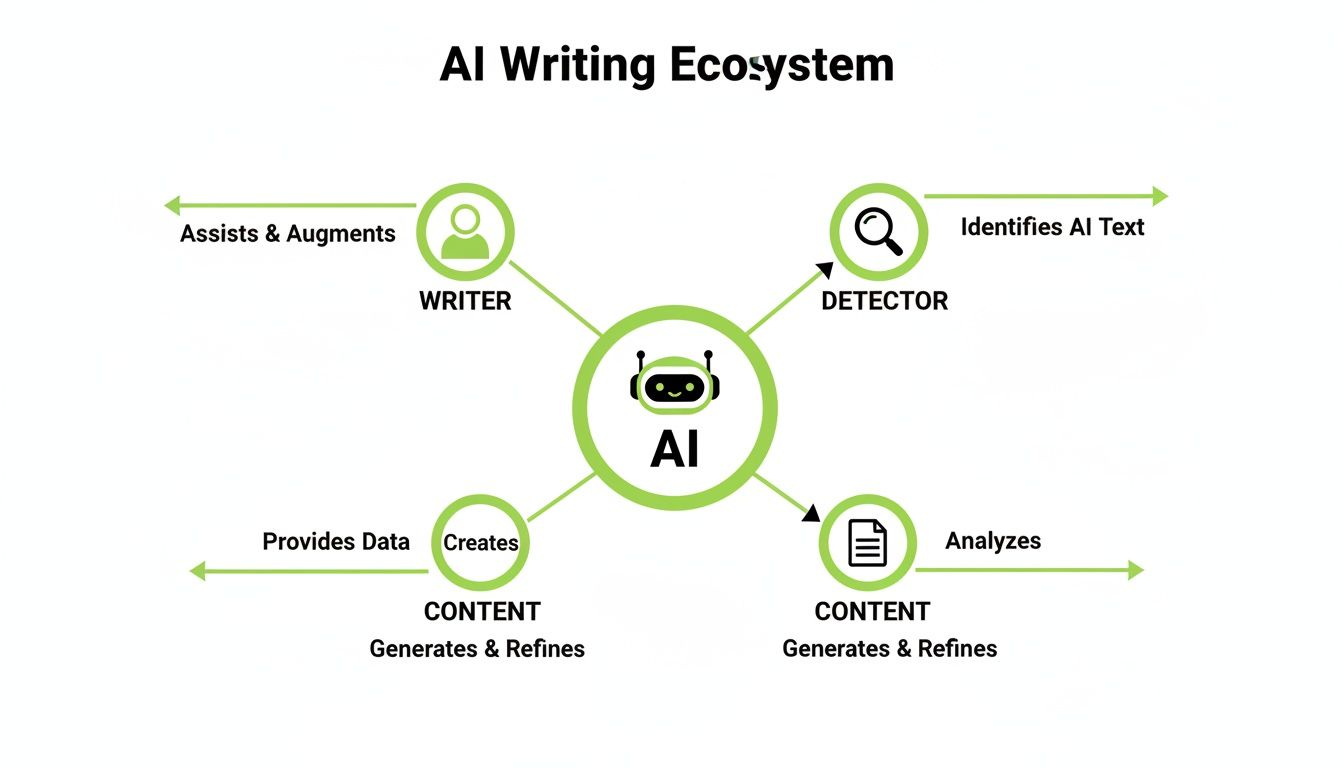

Diagrammet nedenfor kortlægger hele dette økosystem og viser, hvordan AI-forfattere, menneskelige redaktører og detektionsværktøjer alle interagerer.

Som du kan se, er mønstrene i indholdet centrale for hele dette spil og påvirker alt fra skabelse til detektion.

Hvorfor detektorer ikke er idiotsikre

Her er pointen: forståelse af disse mønstre er din fordel, fordi AI-detektorer er notorisk upålidelige. Mellem 2023 og 2025 blev disse værktøjer en fast bestanddel i akademia og forlagsverdenen, men deres nøjagtighed er stadig et enormt problem.

I et 2026 benchmark af 30 store detektorer formåede kun to at identificere 100% af både menneskelig og AI-tekst korrekt. Mange populære værktøjer fangede kun 44–56% af AI-indhold, mens de stadig markerede ægte menneskelig skrivning som maskingenereret. Dette gab mellem deres påstande og virkeligheden er, hvad der gør "omgå Originality AI" workflows så nødvendige for mange forfattere.

Denne ufuldkommenhed betyder, at selv dit eget originale arbejde eller stærkt redigerede AI-udkast kan blive uretfærdigt markeret. At udforske, hvordan man navigerer i dette, er afgørende, og du kan lære mere ved at tjekke vores guide om, hvorvidt udetekterbar AI virkelig virker.

For at hjælpe dig med at begynde at redigere med et klarere mål, her er en direkte sammenligning af de mønstre, detektorer leder efter, versus kendetegnene ved autentisk menneskelig skrivning.

AI-skrivemønstre vs. menneskelige skrivemønstre

Denne tabel opdeler de kerneforskellige, som AI-detektorer er trænet til at opdage. Brug den som en mental tjekliste, når du redigerer et AI-udkast.

| Karakteristik | Typisk AI-genereret tekst | Autentisk menneskelig skrivning |

|---|---|---|

| Perpleksitet | Lav og forudsigelig. Bruger almindelige, højfrekvente ord og sætninger. | Høj og varieret. Blander simpelt og komplekst ordforråd, bruger idiomer og skaber overraskelse. |

| Burstiness | Lav og ensartet. Sætningslængder og -strukturer er konsekvent ens. | Høj og dynamisk. Varierer mellem lange, beskrivende sætninger og korte, slagkraftige. |

| Ordforråd | Gentager ofte specifikke "AI-favoriserede" ord (f.eks. "dykke ned", "omhyggelig", "udnytte"). | Bruger et rigere, mere mangfoldigt ordforråd, herunder slang, jargon og personlige anekdoter. |

| Flow & tone | Overdrevent formelt, objektivt og mangler en tydelig personlig stemme eller følelse. | Kan være samtaleagtig, overbevisende eller følelsesmæssig. Indeholder en unik forfatterstemme. |

Ved at fokusere dine redigeringer på at transformere AI-mønstrene i den midterste kolonne til de menneskelige mønstre til højre, går du fra simpel omformulering til ægte humanisering. Du ændrer ikke bare ord; du ændrer fundamentalt den statistiske fundament af teksten.

Få hænderne snavsede: Manuelle redigeringer til at humanisere AI-indhold

At vide, hvad AI-detektorer leder efter, er én ting. Faktisk at smøge ærmerne op for at afmontere disse mønstre er, hvor det rigtige arbejde begynder. Sådan transformerer du robotagtig, forudsigelig tekst til noget med et ægte menneskeligt hjerteslag.

Vi går ud over generiske råd som "tilføj din personlige stemme". I stedet fokuserer vi på gentagelige, taktiske metoder, du kan bruge lige nu for at gøre dit indhold usynligt for platforme som Originality AI.

At mestre disse hands-on-færdigheder giver dig total kontrol over det endelige udkast. Du kan bevare kernebeskeden, mens du fuldstændig ændrer den underliggende struktur, der udløser detektion, og sikrer, at dit AI-assisterede arbejde aldrig bliver uretfærdigt straffet.

Mester sætningsfusion og -spaltning

En af de hurtigste måder at forbedre "burstiness" på—den naturlige variation i sætningslængde—er en teknik, jeg kalder sætningsfusion og -spaltning. Det er en simpel idé: find afsnit, hvor alle sætningerne er omtrent lige lange, og begynd at blande tingene.

AI elsker en stabil rytme af mellemstore, deklarative sætninger. Dit job er at bryde den rytme.

- Fusion (kombinere sætninger): Led efter korte, relaterede sætninger. Flet dem ved hjælp af konjunktioner (og, men, så), semikolon eller ved at gøre den ene til en underordnet sætning.

- Spaltning (opdele sætninger): Find de lange, komplekse sætninger og hak dem i to eller flere kortere, mere slagkraftige udsagn for effekt.

Sådan ser det ud i praksis:

AI-genereret tekst:

Virksomheden lancerede en ny marketingkampagne. Kampagnen var beregnet til at øge brandbevidstheden. Den rettede sig mod en yngre målgruppe med sociale medie-annoncer. Resultaterne af kampagnen var succesfulde.

Humaniseret med fusion & spaltning:

Med det formål at øge brandbevidstheden lancerede virksomheden en ny marketingkampagne. Den viste sig at være en succes og rettede sig mod en yngre målgruppe med sociale medie-annoncer.

Ser du, hvordan vi kombinerede fire hakkende sætninger til to mere dynamiske? Den simple redigering får teksten til straks at føles mindre robotagtig og forbedrer dens flow.

Udfør en aktiv stemme-overhaling

AI-modeller læner sig ofte på den passive stemme, fordi den lyder formel og objektiv. Problemet? Det får også skrivning til at føles svag, fjern og akademisk. En aktiv stemme-overhaling er din chance for at spore de passive konstruktioner op og vende dem til noget mere direkte og engagerende.

Tricket er at finde sætninger, hvor subjektet bliver handlet med, i stedet for at udføre handlingen. Hold øje med sætninger som "blev gjort af" eller "anses for at være".

Passivt AI-eksempel:

Rapporten blev skrevet af forskningsteamet, og resultaterne blev præsenteret af projektlederen.

Aktiv stemme-overhaling:

Forskningsteamet skrev rapporten, og projektlederen præsenterede resultaterne.

Dette lille skift får skrivningen til at føles mere selvsikker og er meget lettere for en læser at følge. Det erstatter den stive tone, der er almindelig i AI-udkast, med en mere direkte, menneskelig stil. For et dybere indblik i dette, tjek vores fulde guide om, hvordan du humaniserer AI-genereret tekst.

Væv idiomer og analogier ind

AI-genereret tekst er næsten altid smertefuldt bogstaveligt. Det undgår talemåder, idiomer og analogier, fordi de er vanskelige at bruge korrekt. For en menneskelig redaktør er dette en gylden mulighed.

At strø nogle få kulturelt relevante idiomer eller en klog analogi ind er en fantastisk måde at indsprøjte personlighed på og øge tekstens "perpleksitet"—dens uforudsigelighed. En AI ville aldrig komme med en sætning som "det er ikke raketvidenskab" eller "lad os ikke gå udenom".

Handlingsvenligt eksempel: I stedet for at AI siger "Opgaven var meget vanskelig", kunne du skrive "At få den server online igen var som at forsøge at sømme gelé til væggen." Dette skaber et mindeværdigt mentalt billede og tilføjer et lag af originalitet, som detektorer bare ikke er trænet til at forvente.

Et ord til advarsel: overdriv det ikke. For mange idiomer kan få din skrivning til at lyde smaltet. Men en eller to velplacerede sætninger pr. sektion kan være utroligt effektive.

Forenkle og specificer dit sprog

AI har en dårlig vane med at bruge overdrevent formelle ord, når et enklere ville gøre det. Den vil sige "anvende" i stedet for "bruge" eller "påbegynde" i stedet for "starte". Den elsker også vage generaliseringer.

Forenkle og specificer-metoden har to dele:

- Forenkle: Spor unødvendigt komplekse ord op og byt dem ud med deres enklere, mere almindelige synonymer.

- Specificer: Erstat vage udsagn med konkrete detaljer, hårde tal eller specifikke eksempler.

AI's vage sprog:

Den nye software giver en mangfoldighed af fordele for virksomheder og forbedrer den operationelle effektivitet væsentligt.

Forenklet & specificeret tekst:

Den nye software hjælper virksomheder med at skære projektleveringstider med op til 30%. Den automatiserer daglige timesedler og markerer budgetoverskridelser i realtid.

Ved at erstatte "mangfoldighed af fordele" med en specifik statistik (30%) og forklare præcis, hvordan den forbedrer effektiviteten, gør du teksten mere troværdig, værdifuld og menneskelig. Når du kombinerer disse manuelle teknikker, skaber du et lagdelt forsvar mod detektion og forvandler et generisk AI-udkast til et poleret, autentisk stykke indhold.

Brug AI-humanisere til hastighed og skalering

Manuel redigering er guldstandarden for at forfine et AI-udkast, men lad os være ærlige—det tager lang tid. Når du står over for en stram deadline eller har et bjerg af indhold at komme igennem, er det simpelthen ikke praktisk at bruge timer på at massere hver sætning.

Det er præcis her, AI-humaniseringsværktøjer kommer ind. De bygger perfekt bro mellem et råt AI-udkast og poleret, menneskeligt lydende indhold, der er klar til at publicere.

For alle, der skaber indhold i bulk, er disse værktøjer en livredder. Forestil dig en indholdsmarketingmedarbejder, der skal lave fem solide SEO-blogindlæg på en enkelt dag. At omskrive hver enkelt manuelt ville være et mareridt. En moderne, accelereret workflow er den eneste måde at få det gjort på.

Denne tilgang lader dig holde tempoet uden at ofre de subtile detaljer, der er nødvendige for at omgå Originality AI og andre avancerede detektorer. Det er en smart strategi for alle, der skal publicere selvsikkert og hurtigt.

Den moderne humaniser-workflow

En effektiv workflow ved hjælp af en humaniser er overraskende simpel. Den kan forvandle et redigeringsarbejde på flere timer til en opgave, der tager bare få minutter.

Her er et praktisk trin-for-trin eksempel:

- Få dit første udkast: Start med at få en LLM som ChatGPT eller Claude til at generere et solidt udkast baseret på din outline og research. Lad os sige, du skriver en produktbeskrivelse.

- Indsæt og analyser: Kopier hele den AI-genererede beskrivelse og indsæt den i et humaniseringsværktøj. AI-udkastet kunne sige: "Vores nye CRM er en robust løsning designet til at optimere kundeinteraktioner og strømline salgsprocesser."

- Humaniser teksten: Med et enkelt klik går værktøjet i gang med at omskrive indholdet. Det kunne producere: "Træt af at jonglere kunde-e-mails og salgsnotater? Vores nye CRM forenkler alt, så du kan fokusere på at opbygge relationer og lukke aftaler hurtigere."

- Hurtig gennemgang: Det sidste trin er en hurtig gennemgang af dig. Tjek, at den nye tekst stemmer overens med dit brands stemme, og tilføj eventuelle endelige personlige detaljer. Hele processen tager mindre end et minut.

Denne proces er en massiv accelerator. Den frigør dig til at fokusere på overordnet strategi og endelig polering i stedet for at blive hængende i kedelige redigeringer på sætningsniveau.

Den virkelige magi ved en AI-humaniser er dens evne til automatisk at efterligne menneskelige skrivemønstre. Den varierer intelligent sætningslængde, diversificerer ordvalg og justerer rytmen for at slette de forudsigelige, robotagtige signaturer, som AI-detektorer er trænet til at opdage.

Det er mere end bare omformulering

Det er virkelig vigtigt at forstå, at en god humaniser gør langt mere end et grundlæggende omformuleringsværktøj. En simpel omformulering bytter bare ord for synonymer, hvilket ofte resulterer i kluntet, unaturlig formulering.

En ægte humaniser analyserer derimod teksten på et meget dybere niveau. Hvis du er nysgerrig på mekanikken, kan du dykke dybere ned i, hvordan et AI-humaniseringsværktøj faktisk virker.

Disse platforme er trænet på massive datasæt af ægte menneskelig skrivning, så de forstår nuancerne af stil, tone og rytme. De justerer specifikt tekstens perpleksitet og burstiness—præcis de målinger, som AI-detektorer bruger til deres analyse. Resultatet er indhold, der bevarer den oprindelige betydning, men er statistisk umuligt at skelne fra noget, en person skrev fra bunden.

Dette er utroligt nyttigt for enhver opgave, der kræver en hurtig gennemløbstid uden at ofre autenticitet. For eksempel, hvis du bruger AI-drevne LinkedIn post-generatorer, kan det at køre outputtet gennem en humaniser være det sidste trin for at sikre, at indlæggene lyder ægte personlige og engagerende, ikke formelagtige. Ved at gøre disse værktøjer til en del af din workflow kan du skalere dit indholdsoutput uden at rejse røde flag.

Hvordan du tjekker, om dine humaniseringsindsatser faktisk virkede

Så du har brugt tid på omhyggeligt at redigere dit AI-udkast, eller måske har du kørt det gennem et humaniseringsværktøj. Hvordan ved du, om du faktisk lykkedes? Du har brug for bevis.

Bare at krydse fingre og håbe, at dit indhold vil bestå, er et enormt gamble. En endnu større fejl, jeg ser folk lave, er at stole på en enkelt AI-detektor for den endelige dom. Det er en opskrift på katastrofe.

Forskellige detektorer bruger lidt forskellige algoritmer og træningsdata. Dette betyder, at ét værktøj måske giver dig grønt lys, mens et andet markerer dit arbejde som 100% AI-genereret. For selvsikkert at komme forbi detektorer som Originality.ai har du brug for en meget smartere, datadrevet tilgang. Den eneste rigtige løsning er en multi-checker teststrategi.

Denne proces tager angsten og gætværket ud af ligningen. Den giver dig kolde, hårde data til at bekræfte, at dine humaniseringsindsatser lykkedes, før du publicerer eller afleverer din opgave.

Opbygning af din test-gauntlet

Kerneidéen er simpel: læg ikke al din tro på én mening. Kør i stedet din endelige, polerede tekst gennem en lille gauntlet af mindst tre velrenommerede og forskellige AI-checkere. Denne triangulationsmetode giver dig et meget mere pålideligt billede af, hvordan forskellige systemer vil opfatte dit indhold.

Her er en solid startopstilling til din test-gauntlet:

- Originality.ai: Du skal teste mod det værktøj, du specifikt forsøger at omgå. Dets analyse er kendt for at være strengere, så at bestå her er et meget stærkt signal.

- GPTZero: Dette er en populær og meget brugt detektor, især i akademiske kredse. Den giver dig en god baseline for generelle detektionsevner.

- ZeroGPT: En anden gratis og nem at bruge mulighed, der giver et nyttigt tredje datapunkt til enten at bekræfte eller stille spørgsmålstegn ved dine andre resultater.

Ved at krydsreferere disse værktøjer beskytter du dig selv mod særhederne og potentielle falske positiver fra enhver enkelt platform. Tænk på det som at få en anden medicinsk mening—du vil bekræfte diagnosen, før du handler.

Hvordan du læser dine testresultater

Når du har dine scores, hvad betyder de egentlig? Det er ret sjældent at få identiske resultater over hele linjen. Du vil næsten helt sikkert se en vis variation, og at lære, hvordan man fortolker disse nogle gange modstridende scores, er den virkelige nøgle.

Handlingsvenlig indsigt: Målet er ikke nødvendigvis en perfekt 0% AI-score overalt, selvom det selvfølgelig er ideelt. Det virkelige mål er konsekvent at falde under en lav-risiko tærskel på tværs af alle de detektorer, du bruger. Et sikkert mål er at få en score under 10% AI-sandsynlighed på hver enkelt platform.

Hvis to ud af tre checkere giver dig en meget lav AI-score (som under 10%), mens en markerer den lidt højere (f.eks. 30-40%), er du sandsynligvis i en sikker zone.

Hvis dog selv ét værktøj markerer dit indhold som 80% eller 90% AI, er det et stort rødt flag. Det betyder, at et signifikant mønster blev detekteret, og du bør absolut gå tilbage til den del af din tekst for en anden redigeringsrunde.

I bestræbelserne på at gøre AI-indhold udetekterbart bruger nogle mennesker også et specialiseret AI-bypasser-værktøj designet til at omskrive tekst specifikt for at undgå disse systemer. Uanset hvilken metode du bruger, er denne multi-check validering det sidste, væsentlige trin for at sikre, at din workflow er effektiv, og at dit indhold virkelig er klar.

At gå på den etiske line af AI-skrivning

At bruge værktøjer til at humanisere et AI-udkast går på en fin linje mellem smart effektivitet og åbenlys snyd. At vide præcis, hvor den linje trækkes, er nøglen til at beskytte dit akademiske eller professionelle omdømme. Den virkelige forskel kommer ned til din hensigt og hvem der virkelig ejer det endelige arbejde.

Det er én ting at udnytte AI som en assistent til at brainstorme idéer, knuse writer's block eller skitsere et råt første udkast. I det scenarie er AI bare et værktøj, ikke anderledes end en tesaurus eller en grammatikkontrol. Det endelige stykke er stadig fundamentalt dit—formet af dine indsigter, kritisk tænkning og grundig redigering.

Akademisk integritet og professionelle standarder

Linjen krydses, når du bruger AI til at generere et komplet arbejde og derefter udgiver det som dit eget. Det er bare en højteknologisk form for plagiat, helt enkelt.

Hvert universitet har en streng æreskodeks, og hver udgiver har indholdsretningslinjer. At overtræde dem kan medføre alvorlige konsekvenser, fra en strygekarakter til at blive fyret eller stå over for juridiske problemer.

Før du bruger et AI-værktøj til en bedømt opgave eller en professionel publikation, skal du absolut:

- Tjek din institutions politik: Mange universiteter har nu specifikke regler for AI. At hævde, at du ikke vidste det, vil ikke redde dig.

- Forstå udgiverretningslinjer: Velrenommerede publikationer kræver ofte, at du oplyser enhver AI-assistance og vil afvise indhold, der ikke er væsentligt originalt.

- Prioriter din egen stemme: Det endelige arbejde skal afspejle dine tanker og analytiske færdigheder. Hvis du ikke kunne stå op og forsvare idéerne som dine egne, er du gået for langt.

Ansvarlig brug vs. åbenlys misbrug

Målet med "humanisering" bør være at sikre, at dit ægte forfinet, AI-assisterede arbejde ikke uretfærdigt bliver markeret af fejlbehæftede detektorer. Det handler om at få kredit for dit eget intellektuelle arbejde, ikke om at narre nogen til at tro, at en maskines arbejde er dit.

Når du bruger AI ansvarligt, er du forfatteren; AI'en er bare co-piloten.

Praktisk indsigt: Dette etiske puslespil sidder i hjertet af vores nuværende tech-øjeblik. Fokus bør altid være på at bruge AI til at forbedre menneskelig kreativitet og intellekt, ikke for at omgå personlig integritet og ansvarlighed.

Globale statistikker om AI-misbrug viser, at detektions- og bypass-værktøjer er låst i et konstant våbenkapløb. Mens detektorer er nødvendige for at bremse misbrug, kan deres gætværk-natur uretfærdigt straffe den ærlige brug af værktøjer som ChatGPT. Det er her, tjenester som humantext.pro kommer ind—de fokuserer på at forbedre tekstens læsbarhed og bevare din oprindelige hensigt, ikke bare råt manipulere ord for at narre en maskine. Dette hjælper dig med at forblive på den rigtige side af institutionelle politikker.

Du kan finde flere indsigter om den alarmerende vækst af AI-drevet svindel på sumsub.com.

I sidste ende er ansvaret dit. Brug AI til at forstærke dine evner, faktjek hver eneste påstand og indsprøjt hvert stykke med dit unikke perspektiv. Det er den eneste etiske—og bæredygtige—vej fremad.

Almindelige spørgsmål om AI-detektion

At navigere i verdenen af AI-indhold og detektion kan føles som at gå gennem et minefelt. Lad os rydde op i nogle af de mest almindelige spørgsmål, folk har, når de forsøger at få deres arbejde forbi værktøjer som Originality AI.

Er AI-detektorer som Originality AI nogensinde 100% nøjagtige?

Absolut ikke. AI-detektorer er ikke, og var aldrig designet til at være 100% ufejlbarlige. Uafhængige tests har konsekvent vist, at de har nogle alvorlige begrænsninger.

Disse værktøjer kan og markerer ofte fuldstændig menneskeligt skrevet indhold som AI-genereret. Dette kaldes en falsk positiv, og det er et enormt problem. På den anden side kan de også gå glip af maskinskrevet tekst, især hvis den er blevet redigeret. Nøjagtigheden svinger voldsomt afhængigt af den AI-model, der skrev teksten, og hvor meget et menneske har forfinet den. Dette er præcis, hvorfor du aldrig skal stole på en enkelt detektors score som den endelige dom.

Er det uetisk at omgå AI-detektion?

Dette er det store spørgsmål, og svaret kommer ned til én ting: hensigt. Etikken ved at omgå AI-detektion afhænger helt af, hvorfor du gør det og de regler, du spiller efter.

Hvis du genererer et helt essay med AI og sætter dit navn på det og indsender det som din egen originale tanke—det er krystalklar akademisk uærlighed. Ingen gråzone der.

Men hvad nu hvis du bruger AI som en samarbejdspartner? Til brainstorming, skitsering eller at få et råt første udkast på siden, som du derefter væsentligt omskriver med dine egne idéer, analyser og stemme? Det er en legitim og stadig mere almindelig workflow for professionelle overalt.

Handlingsvenligt råd: Den gyldne regel er enkel: følg de specifikke retningslinjer for din institution eller udgiver. Humaniseringsværktøjer er beregnet til at sikre, at dit endelige, menneskeligt forfinet arbejde ikke uretfærdigt bliver straffet af en fejlbehæftet detektor, ikke for at hjælpe dig med at snyde.

Hvad er den bedste måde at gøre AI-tekst udetekterbar på?

Der er ingen tryllestav, og en lagdelt tilgang er altid dit bedste bud. Men hvis jeg skulle vælge den mest kraftfulde teknik, er det dette: variér din sætningsstruktur og -længde.

AI-modeller har tendens til at falde i en monoton, forudsigelig rytme. De producerer sætninger, der alle er omtrent lige lange og strukturerede, hvilket føles robotagtigt.

Ved bevidst at bryde de lange, snoede sætninger op og kombinere korte, kontante, introducerer du et mere dynamisk, naturligt flow. Denne variation er, hvad eksperter kalder "burstiness", og det er et nøglesignal, AI-detektorer leder efter. Mester denne ene færdighed, og du er godt på vej til at forstyrre netop de mønstre, disse værktøjer er trænet til at opdage.

Klar til at se, hvor nemt det er at polere dit AI-assisterede indhold? humantext.pro kan transformere et robotagtigt udkast til naturlig, menneskeligt lydende tekst på sekunder. Prøv vores AI-humaniser gratis og se forskellen selv.

Klar til at transformere dit AI-genererede indhold til naturlig, menneskelig skrivning? Humantext.pro forfiner din tekst øjeblikkeligt og sikrer at den læses naturligt mens den omgår AI-detektorer. Prøv vores gratis AI-humaniserer i dag →

Relaterede Artikler

AI Writing Assistance: Master Ethical Content Creation

Master AI writing assistance: learn workflows, best practices, & ethical use to create high-quality, human-sounding content that truly works.

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.