AI humanizer tanpa batas kata: Panduan Praktis untuk Memanusiakan Konten Panjang

AI humanizer tanpa batas kata: Pelajari alur kerja praktis untuk mengubah konten panjang menjadi tulisan yang menarik dan terdengar alami tanpa batasan.

Mari kita jujur: AI humanizer tanpa batas kata yang sesungguhnya adalah sebuah mitos. Anda tidak akan menemukan tombol ajaib yang dapat memanusiakan naskah 100.000 kata dengan sempurna dalam sekali proses. Sebagian besar alat memiliki batasan karakter atau kata, memaksa Anda memasukkan disertasi atau e-book Anda dalam potongan-potongan kecil yang menjengkelkan.

Menangani Humanisasi Konten Berskala Besar

Entah Anda seorang mahasiswa pascasarjana yang bergulat dengan disertasi 10.000 kata, profesional SEO yang mengelola belasan artikel, atau peneliti yang menyusun makalah akademis yang padat — masalahnya selalu sama. Anda duduk di atas tumpukan teks yang dihasilkan AI yang harus terdengar benar-benar manusiawi — bukan hanya untuk menghindari detektor AI yang semakin canggih, tetapi juga untuk benar-benar terhubung dengan pembaca Anda.

Rutinitas salin-tempel biasa, memproses 300 atau 500 kata sekaligus, bukan sekadar membosankan. Ini adalah pembunuh produktivitas. Kerja manual ini mengundang kesalahan, mengaburkan nada tulisan, dan membakar waktu berjam-jam yang seharusnya Anda habiskan untuk strategi dan penyempurnaan. Bagi siapa pun yang membuat konten dalam skala besar, ini adalah hambatan serius.

Ketika Anda berurusan dengan konten panjang, tantangannya melampaui sekadar jumlah kata. Perjuangan sesungguhnya adalah menjaga integritas karya dari awal hingga akhir.

Tantangan Memanusiakan Konten AI yang Panjang

| Tantangan | Dampak pada Pekerjaan Anda | Solusi Strategis |

|---|---|---|

| Kehilangan Konteks | Alat tidak menangkap narasi keseluruhan, menghasilkan penulisan ulang yang generik atau tidak relevan. | Proses konten dalam bagian-bagian yang logis dan mandiri (misalnya, bab, argumen utama) untuk memberikan konteks yang cukup. |

| Fragmentasi Narasi | Alur antar paragraf terputus, menciptakan pengalaman membaca yang terputus-putus dan mengganggu. | Tumpang-tindihkan potongan Anda sedikit dan tinjau transisi secara manual untuk memastikan alur yang halus dan koheren. |

| Inkonsistensi Nada | Dokumen Anda akhirnya terdengar seperti ditulis oleh sebuah komite, dengan nada dan gaya yang berubah-ubah. | Tetapkan panduan gaya yang jelas atau nada referensi untuk humanizer dan edit secara manual untuk konsistensi setelah pemrosesan. |

| Ketidakefisienan Waktu yang Ekstrem | Kerja manual memecah dan merakit ulang teks mengalahkan tujuan penggunaan AI untuk kecepatan. | Terapkan "metode chunking" yang sistematis untuk menyederhanakan proses pemecahan dan perakitan ulang, mengubahnya menjadi alur kerja yang dapat diprediksi. |

Hambatan-hambatan ini menunjukkan mengapa alat sederhana saja tidak cukup; Anda membutuhkan proses yang lebih cerdas.

Mengapa Alat Standar Tidak Memadai

Sebagian besar AI humanizer dirancang untuk tugas-tugas cepat: email, caption media sosial, atau paragraf pendek. Batasan pemrosesan mereka adalah realitas praktis, terkait dengan biaya server dan kompleksitas luar biasa dari menulis ulang teks sambil mempertahankan makna intinya.

Ketika Anda mencoba memaksakan dokumen besar melalui alat-alat ini, keterbatasannya menjadi sangat jelas:

- Kebutaan Konteks: Alat yang hanya melihat potongan kecil dari karya Anda tidak dapat memahami alur narasi, argumen, atau istilah khusus yang telah Anda bangun. Ini seperti meminta seseorang mendeskripsikan sebuah film setelah hanya menonton klip 30 detik.

- Alur yang Terputus: Memproses bab demi bab sering menghancurkan jembatan logis antar ide. Anda berakhir dengan kumpulan paragraf yang tidak cukup saling terhubung, membuat pembaca harus bekerja terlalu keras.

- Jebakan Kerja Manual: Upaya yang diperlukan untuk memotong, memproses, dan menyatukan kembali dokumen besar sangatlah besar. Ini sepenuhnya merusak efisiensi yang seharusnya AI berikan.

Tantangan sesungguhnya bukan sekadar lolos dari detektor; ini tentang mempertahankan jiwa dan koherensi sebuah karya panjang. Dokumen yang mendapat skor 100% manusia tetapi terbaca seperti kumpulan yang berantakan adalah kegagalan total.

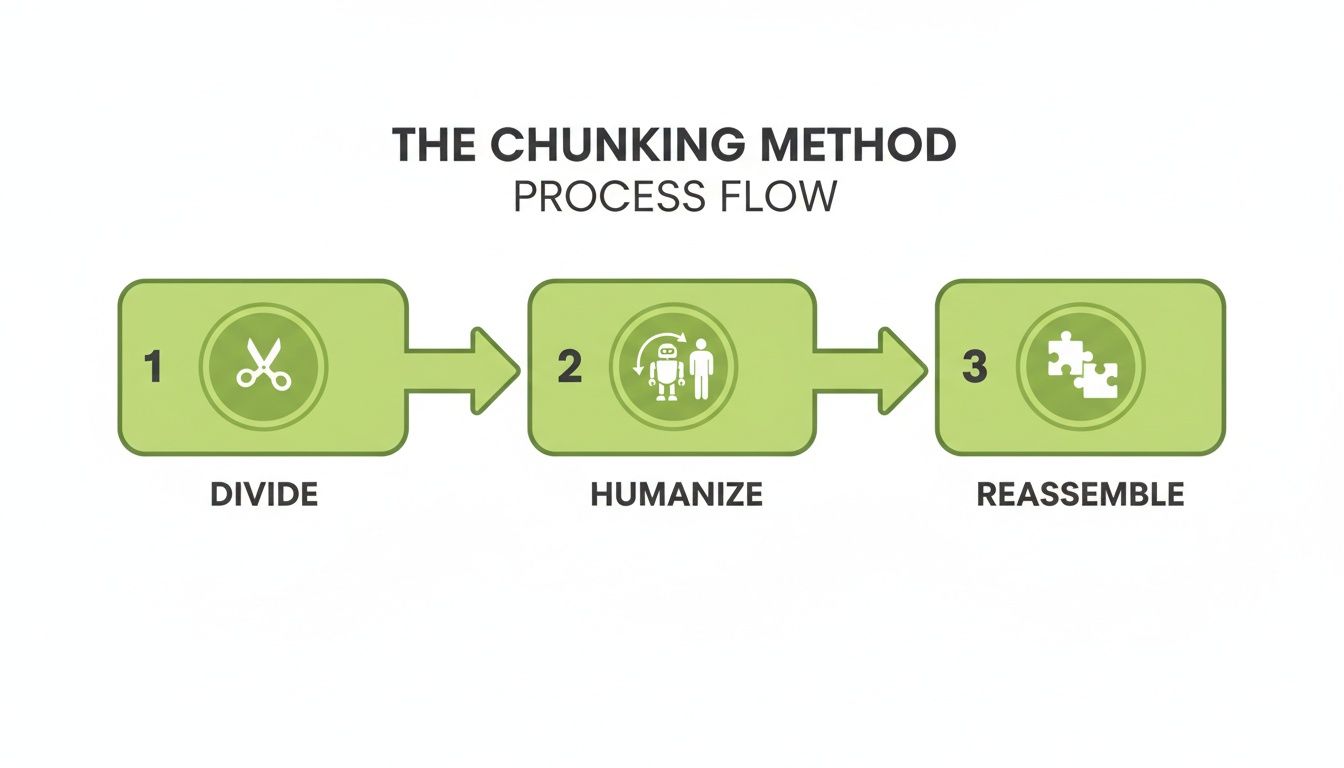

Di sinilah memiliki alur kerja yang strategis membuat semua perbedaan. Alih-alih mencari AI humanizer tanpa batas kata yang mitos, solusi sebenarnya adalah menjadi metodis. Strategi paling efektif yang saya temukan adalah 'metode chunking' — sistem untuk memecah, memanusiakan, dan merakit ulang dokumen besar secara cerdas untuk menjaga kualitas. Ini mengubah tugas yang menakutkan menjadi proses yang dapat dikelola dan diulang.

Untuk pembahasan lebih mendalam tentang berbagai alat dan keunggulannya, lihat panduan kami tentang pilihan AI humanizer terbaik yang tersedia untuk berbagai jenis konten.

Metode Chunking untuk Humanisasi yang Sempurna

Jadi, Anda sedang menghadapi dokumen yang sangat besar — disertasi, e-book, mungkin artikel pilar yang ribuan kata panjangnya. Mencoba memanusiakan semuanya sekaligus itu seperti mencoba mendidihkan lautan. Tidak efisien dan sering merusak alat yang Anda gunakan.

Sebaliknya, Anda membutuhkan pendekatan yang lebih cerdas. Kami menyebutnya metode chunking. Ini tentang memecah gunung teks itu menjadi bagian-bagian yang dapat dikelola dan logis.

Bayangkan ini seperti arsitek yang merancang bangunan, bukan kru pembongkar yang asal menghancurkan dinding. Anda ingin membagi dokumen Anda sepanjang garis struktur alaminya untuk menjaga konteks dan alur tetap utuh.

Berikut panduan praktis cara memilih potongan Anda:

- Untuk makalah penelitian: Saya membaginya berdasarkan bagian-bagian intinya — Pendahuluan, Tinjauan Pustaka, Metodologi, Hasil, dan Kesimpulan. Setiap bagian adalah argumen yang mandiri, sempurna untuk diproses satu per satu.

- Untuk artikel blog yang panjang: Subjudul H2 adalah sahabat terbaik Anda. Mereka sudah menandakan pergeseran topik, menjadikannya titik pemisahan yang paling alami.

- Untuk e-book atau novel: Yang ini mudah. Gunakan bab-bab. Setiap bab memiliki alur cerita mininya sendiri, menjadikannya unit ideal untuk dimasukkan ke humanizer.

Strategi ini memastikan bahwa ketika Anda memproses sebuah bagian, AI memiliki cukup teks di sekitarnya untuk memahami poin spesifik yang Anda sampaikan di bagian tersebut, yang menghasilkan output yang jauh lebih baik dan lebih relevan.

Menemukan Ukuran Potongan yang Tepat

Ukuran potongan yang sempurna adalah soal keseimbangan. Anda membutuhkan cukup teks untuk menjaga integritas narasi, tetapi tidak terlalu banyak sehingga membebani alat.

Sebagian besar humanizer, termasuk HumanText.pro, menawarkan batas uji coba gratis yang cukup besar, biasanya sekitar 500 kata. Dari pengalaman saya, ini adalah titik ideal. Cukup besar untuk mencakup satu ide lengkap atau beberapa paragraf detail tanpa kehilangan alur argumen.

Beginilah tampilan antarmuka alat humanisasi standar — Anda cukup menempelkan salah satu potongan Anda ke kotak input.

Tata letak yang bersih dan sederhana sangat penting. Ketika Anda memproses puluhan potongan, hal terakhir yang Anda inginkan adalah alur kerja yang rumit.

Menyatukan Kembali Konten yang Telah Dimanusiakan

Setelah semua potongan diproses, saatnya untuk merakit ulang. Dan tidak, ini bukan sekadar pekerjaan salin-tempel. Di sinilah Anda mengenakan topi editor dan menghaluskan sambungan di mana bagian-bagian berbeda bertemu.

Fokuslah pada penciptaan transisi yang mulus. Terkadang, humanizer mungkin mengakhiri satu potongan dengan kalimat penutup yang bagus, tetapi potongan berikutnya seharusnya melanjutkan pemikiran yang sama. Anda perlu masuk dan menyesuaikan kalimat-kalimat tersebut secara manual untuk menjembatani celahnya.

Contoh Praktis:

- Transisi Asli (Janggal): "...dan itulah mengapa panel surya efisien." [Akhir Potongan 1] "Energi panas bumi menawarkan opsi berkelanjutan lainnya." [Awal Potongan 2]

- Transisi yang Diperbaiki (Mulus): "...dan itulah mengapa panel surya efisien." [Akhir Potongan 1] "Meskipun tenaga surya adalah pilihan populer, energi panas bumi menawarkan opsi berkelanjutan lainnya." [Awal Potongan 2]

Tips Pro: Baca seluruh dokumen yang telah dirakit dengan keras dari awal hingga akhir. Ini adalah cara terbaik untuk menangkap pergeseran nada atau gaya yang canggung yang mungkin menyusup di antara potongan-potongan. Tujuan Anda adalah suara yang terpadu yang terasa sepenuhnya disengaja.

Memahami jumlah kata adalah bagian besar dari mengoptimalkan proses ini. Untuk mempelajari lebih lanjut, lihat panduan kami tentang seberapa panjang 500 kata sebenarnya. Ini akan mengubah cara Anda menguasai strategi chunking.

Mari kita praktis. Bagaimana ini sebenarnya bekerja?

Bayangkan Anda memiliki artikel padat 3.000 kata yang dihasilkan AI tentang perencanaan kota berkelanjutan. Faktanya ada, tetapi membosankan — kaku, robotik, dan berteriak "AI" ke setiap detektor di pasaran. Misi kita adalah mengubahnya menjadi sesuatu yang menarik dan, yang terpenting, manusiawi.

Langkah pertama sederhana: pecah menjadi potongan. Saya akan memecah artikel 3.000 kata itu menjadi enam bagian yang dapat dikelola, masing-masing 500 kata. Triknya adalah membuat potongan yang logis. Saya biasanya memotong artikel tepat di subjudul H2. Ini menjaga argumen inti setiap bagian tetap utuh, mencegah humanizer kehilangan konteks dan mengacaukan ide-ide Anda.

Pemrosesan dan Pemeriksaan Kualitas

Dengan enam potongan siap, saya memulai pekerjaan sesungguhnya. Saya mengambil bagian 500 kata pertama, memasukkannya ke antarmuka HumanText.pro, dan menekan "Humanize." Hanya butuh beberapa detik.

Tetapi sebelum melompat ke potongan berikutnya, saya melakukan pemeriksaan kualitas cepat pada hasilnya. Ini adalah langkah yang tidak bisa ditawar bagi saya.

Berikut daftar periksa mini saya untuk setiap bagian:

- Integritas Pesan: Apakah penulisan ulang mempertahankan fakta dan argumen asli? Misalnya, jika teks asli menyatakan "pengurangan emisi 25%," teks yang dimanusiakan tidak bisa hanya mengatakan "pengurangan yang signifikan."

- Konsistensi Nada: Apakah teks baru masih terdengar profesional dan informatif? Tujuannya adalah membuatnya terdengar lebih baik, bukan seperti ditulis oleh orang yang sama sekali berbeda.

Saya cukup mengulangi proses ini untuk keenam potongan, menyimpan setiap output yang telah dimanusiakan dalam dokumen baru. Ini pendekatan yang metodis, tetapi menjamin setiap bagian mendapat perhatian yang dibutuhkan sebelum perakitan akhir.

Seluruh alur kerja ini — pecah, manusiakan, rakit — adalah kunci untuk menangani konten panjang secara efektif.

Memecah tugas besar menjadi langkah-langkah yang lebih kecil dan terkontrol seperti ini adalah cara Anda menjaga kontrol kualitas dan mendapatkan draf akhir yang dipoles dan mulus.

Perakitan Ulang dan Polesan Akhir

Setelah semua potongan dimanusiakan, saatnya menyatukannya kembali. Saya merakit bagian-bagian dalam urutan aslinya. Bagian ini lebih dari sekadar salin-tempel; saya mencari sambungan antar potongan, menghaluskan transisi yang canggung untuk memastikan narasi mengalir secara alami.

Selanjutnya, saya menjalankan artikel 3.000 kata lengkap melalui detektor AI. Saya perlu melihat skor manusia yang tinggi di seluruh dokumen, bukan hanya di bagian-bagian terpisah.

Tetapi langkah akhir yang paling kritis adalah pembacaan manusia yang sederhana. Saya selalu membaca seluruh artikel dengan keras. Ini cara terbaik untuk menangkap frasa aneh atau kalimat yang mengganggu yang mungkin terlewat oleh perangkat lunak. Inilah polesan yang membedakan konten yang bagus dari konten yang benar-benar hebat.

Pemeriksaan akhir ini sangat penting. Bagaimanapun, akurasi alat-alat terbaik berkisar antara 65-90%, jadi verifikasi manusia adalah jaring pengaman utama Anda. Ini memastikan konten tidak hanya lolos pemindaian tetapi juga benar-benar terhubung dengan orang nyata.

Jika Anda menangani banyak konten, meningkatkan ke paket berbayar HumanText.pro adalah keputusan yang mudah. Ini menghilangkan batas kata dan membuat seluruh alur kerja lebih cepat dan efisien. Untuk tips lebih lanjut, lihat panduan kami tentang bagaimana https://humantext.pro/blog/chat-gpt-humanizer dapat meningkatkan proses Anda. Anda juga dapat mengintegrasikan alur kerja ini dengan alat AI untuk kalender konten terbaik untuk mengelola seluruh pipeline konten Anda dari pembuatan hingga publikasi.

Strategi Lanjutan untuk Otomatisasi dan Skala

Jika Anda menjalankan agensi konten, mengelola sejumlah situs SEO, atau sekadar memiliki tumpukan teks yang harus diproses, proses chunking manual adalah beban yang nyata. Menyalin, menempel, dan merakit ulang teks secara manual adalah hambatan serius yang mengikis keunggulan kecepatan yang Anda peroleh dari penggunaan AI.

Ketika Anda menangani puluhan artikel per minggu, proses manual yang "cepat" itu bertambah. Untuk benar-benar membuat ini berhasil dalam volume besar, Anda harus melampaui browser dan merangkul otomatisasi.

Di sinilah API (application programming interface) menjadi sahabat terbaik Anda. Bayangkan ini sebagai jalur langsung dari sistem Anda ke AI humanizer seperti HumanText.pro, tanpa perlu klik manusia. Alih-alih memberi makan mesin satu bagian kecil pada satu waktu, Anda dapat membangun pipeline yang rapi yang mengotomatiskan seluruh urutan.

Membangun Pipeline Humanisasi Otomatis

Mengatur alur kerja otomatis terdengar lebih mengintimidasi daripada kenyataannya. Ide intinya sederhana: buat sistem yang dapat mengambil dokumen panjang, memotongnya menjadi potongan berukuran sempurna, mengirim masing-masing ke API humanizer, dan kemudian menyatukan teks yang telah diproses dengan rapi.

Anda tidak perlu menjadi pengembang untuk melakukan ini. Ini bisa dilakukan dengan skrip sederhana atau bahkan platform tanpa kode seperti Zapier atau Make. Bayangkan alur kerja di mana memasukkan artikel draf AI baru ke folder Google Drive secara otomatis memulai seluruh proses humanisasi di belakang layar.

Berikut tampilannya dalam praktik:

- Pemicu: File baru ditambahkan ke folder Google Drive tertentu.

- Tindakan 1 (Chunking Otomatis): Alur kerja Zapier atau Make.com secara otomatis memecah dokumen menjadi potongan teks 500 kata.

- Tindakan 2 (Panggilan API): Alur kerja mengirim setiap potongan, satu per satu, ke endpoint API HumanText.pro.

- Tindakan 3 (Perakitan Ulang): Skrip mengumpulkan semua output yang telah dimanusiakan dan membuat dokumen baru di folder Google Drive lain, siap untuk tinjauan akhir.

Membangun pipeline seperti ini adalah kunci untuk menskalakan operasi konten Anda. Alur kerja yang dulu membutuhkan satu jam kerja manual dapat diselesaikan dalam hitungan menit, membebaskan tim Anda untuk fokus pada strategi, penyuntingan, dan tugas kreatif.

Ketika Anda mempertimbangkan sumber konten ini, seperti generator siaran pers AI yang canggih, Anda dapat melihat mengapa memiliki proses humanisasi yang terstruktur di bagian belakang sangat penting.

Mengelola Biaya dan Kualitas dalam Skala Besar

Meskipun otomatisasi adalah pengubah permainan untuk efisiensi, ini memang membawa beberapa hal baru yang perlu diperhatikan. Ketika Anda beroperasi dalam volume besar, Anda harus cerdas dalam mengelola biaya dan mempertahankan kualitas.

Manajemen Biaya: Sebagian besar akses API berbasis bayar-sesuai-penggunaan, biasanya ditagih per karakter atau kata. Sebelum Anda mengaktifkan otomatisasi penuh, lakukan perhitungan kasar. Perkirakan volume bulanan Anda dan modelkan potensi biaya agar tidak ada kejutan. Sebaiknya juga atur peringatan untuk memantau penggunaan Anda.

Jaminan Kualitas: Otomatisasi cepat, tetapi tidak sempurna. Sentuhan manusia terakhir tidak bisa ditawar. Bangun pemeriksaan kualitas cepat di akhir pipeline Anda. Setelah dokumen dirakit ulang, minta seseorang memberikan pembacaan akhir untuk menghaluskan transisi yang canggung antar potongan atau memperbaiki frasa aneh yang mungkin terlewat oleh mesin. Polesan akhir ini memastikan konten berskala besar Anda tetap memenuhi standar tinggi Anda.

Menghindari Jebakan Umum dalam Humanisasi AI

Ketika Anda memproses dokumen panjang bagian demi bagian, Anda mengundang beberapa masalah halus yang dapat menyabotase produk akhir jika Anda tidak memperhatikan. Bahkan alur kerja AI humanizer tanpa batas kata yang paling rapi pun membutuhkan mata yang tajam untuk menangkap kesalahan-kesalahan umum ini. Dua pelaku utama adalah inkonsistensi nada dan kehilangan konteks — keduanya dapat sepenuhnya merusak kredibilitas konten Anda.

Inkonsistensi nada sangat mengganggu pembaca. Bayangkan satu bab e-book Anda terdengar seperti makalah akademis yang kaku, tetapi bab berikutnya terbaca seperti posting blog yang santai dan mengobrol. Ini terjadi ketika humanizer, bekerja pada potongan-potongan yang terisolasi, membuat pilihan gaya yang berbeda untuk setiap bagian. Anda berakhir dengan tulisan yang berantakan.

Kemudian ada kehilangan konteks. Ini ketika alat tidak dapat melihat gambaran besar. Mungkin melewatkan nuansa penting, tema berulang, atau terminologi khusus yang telah Anda bangun dengan hati-hati di bagian-bagian sebelumnya. Ini menghasilkan penulisan ulang yang generik, atau bahkan kontradiktif. Humanizer mungkin menyederhanakan istilah di satu potongan tetapi membiarkannya sangat teknis di potongan lain, membuat pembaca Anda benar-benar bingung.

Penyuntingan Koherensi yang Esensial

Untuk memperbaiki semua ini, Anda mutlak harus melakukan "penyuntingan koherensi" khusus setelah menyatukan potongan-potongan yang telah dimanusiakan. Ini adalah kesempatan Anda untuk menyatukan suara dokumen dan menghaluskan semua transisi yang kasar. Ini adalah langkah yang tidak bisa ditawar.

Berikut daftar periksa yang dapat ditindaklanjuti untuk penyuntingan koherensi Anda:

- Satukan Suara dan Nada: Baca paragraf pertama dari setiap bagian utama. Apakah terdengar seperti ditulis oleh orang yang sama? Jika tidak, sesuaikan pilihan kata. Contoh: Ganti "memanfaatkan" di satu bagian dengan "menggunakan" jika sisa dokumen lebih kasual.

- Haluskan Transisi: Periksa kalimat pertama dari setiap paragraf yang mengikuti jeda bagian. Apakah terhubung dengan ide sebelumnya? Jika tidak, tambahkan frasa sederhana. Contoh: Ubah "Data menunjukkan tren" menjadi "Melanjutkan poin sebelumnya, data juga menunjukkan tren."

- Periksa Terminologi Kunci: Gunakan fungsi pencarian pengolah kata Anda (Ctrl+F atau Cmd+F) untuk menemukan istilah-istilah kunci. Apakah Anda memperkenalkan akronim seperti "SEO" di awal? Pastikan Anda tidak mengeja "Search Engine Optimization" lagi di bab selanjutnya.

Penyuntingan koherensi ini jauh lebih dari sekadar proofreading. Ini tentang menenun kembali benang-benang individual menjadi satu permadani yang mulus. Inilah satu langkah yang mengangkat kumpulan paragraf yang ditulis dengan baik menjadi dokumen yang benar-benar kohesif dan berdampak.

Tinjauan Manusia Terakhir

Secanggih apapun alat Anda, tidak ada yang bisa menggantikan tinjauan manusia terakhir. Pembacaan terakhir ini adalah tempat Anda menangkap kesalahan halus dan menambahkan lapisan polesan terakhir yang tidak dapat direplikasi oleh otomatisasi. Ini adalah kesempatan Anda untuk menyuntikkan kepribadian, memeriksa ulang fakta, dan memastikan konten benar-benar terhubung dengan audiens Anda.

Untuk agensi yang menskalakan penulisan web, seluruh proses ini adalah penyelamat. Anda dapat menempelkan konten mentah, mendapatkan skor AI secara instan, dan memanusiakannya dalam hitungan detik, mempertahankan makna inti sambil menambahkan lapisan keaslian yang penting. Di sinilah HumanText.pro benar-benar bersinar, menggunakan model linguistik yang dilatih pada lebih dari 1,2 juta sampel untuk meniru tulisan alami — Anda bahkan tidak perlu mendaftar untuk uji coba. Para freelancer memberi tahu kami bahwa ini mengubah AI yang dipoles menjadi postingan yang menarik yang lolos setiap pemeriksaan, membantu mereka mendapatkan proyek tanpa menimbulkan kecurigaan. Anda dapat menemukan informasi lebih lanjut tentang metode untuk menangani deteksi AI di papergen.ai.

Pertanyaan Umum tentang Memanusiakan Konten Panjang

Ketika Anda menghadapi tumpukan teks AI, beberapa pertanyaan selalu muncul. Wajar untuk bertanya-tanya tentang logistik, dampak, dan keamanan prosesnya. Mari kita bahas beberapa pertanyaan paling umum yang kami dengar dari pengguna yang menangani proyek besar.

Bisakah Metode Ini Benar-Benar Bekerja untuk Buku atau Disertasi?

Tentu saja. Inilah tepatnya tujuan strategi chunking dirancang. Anda tidak akan menempelkan seluruh naskah 80.000 kata ke dalam alat sekaligus — itu akan menjadi kekacauan. Sebaliknya, Anda memecahnya.

Wawasan Praktis: Untuk disertasi, perlakukan setiap bab (Pendahuluan, Tinjauan Pustaka, Metodologi, dll.) sebagai proyek terpisah. Manusiakan semua bagian dalam Bab 1 terlebih dahulu, lakukan penyuntingan koherensi pada bab tersebut, dan baru kemudian lanjut ke Bab 2. Ini mengompartemenkan pekerjaan dan mencegah kewalahan. Untuk buku, gunakan pendekatan bab demi bab yang sama.

Apakah Humanisasi Bertahap Akan Merusak SEO Saya?

Justru sebaliknya — ini seharusnya memberikan dorongan serius. Mesin pencari semakin pintar setiap hari, dan mereka sudah sangat mahir mendeteksi konten yang robotik dan tidak membantu. Ketika Anda memanusiakan teks Anda, bahkan secara bertahap, produk akhirnya lebih alami dan menarik. Itu adalah kemenangan besar untuk SEO.

Selama Anda menyusun kembali artikel secara logis dan mempertahankan fokus kata kunci, proses ini membuat konten Anda lebih baik untuk orang nyata. Dan apa yang baik untuk orang sekarang juga baik untuk Google.

Aturan emas SEO modern adalah memberikan nilai nyata kepada pembaca Anda. Konten yang dimanusiakan secara inheren lebih bernilai karena lebih jelas, lebih menarik, dan terasa autentik.

Pada akhirnya, pendekatan ini menempatkan Anda tepat sejalan dengan apa yang dirancang untuk dihargai oleh algoritma pencarian.

Bagaimana HumanText.pro Melindungi Dokumen Sensitif Saya?

Kami memahami. Menyerahkan penelitian akademis yang sensitif atau rencana bisnis rahasia adalah hal yang serius. Itulah mengapa kami membangun HumanText.pro dengan kebijakan privasi yang ketat: kami tidak menyimpan, membagikan, atau menggunakan konten Anda untuk apa pun, terutama tidak untuk melatih model kami.

Begitu Anda memproses teks dan menutup sesi, teks tersebut hilang dari sisi kami. Ini berlaku untuk semua orang, baik Anda menggunakan uji coba gratis atau paket berbayar. Informasi milik Anda tetap sepenuhnya rahasia, aman, dan — yang terpenting — milik Anda. Selalu.

Siap berhenti khawatir tentang batas kata dan mulai membuat konten yang terhubung? HumanText.pro memberi Anda alur kerja yang jelas dan efisien untuk memanusiakan teks dengan panjang berapa pun. Ubah draf AI itu menjadi tulisan berkualitas tinggi dan terdengar alami yang benar-benar ingin dibaca oleh audiens Anda.

Kunjungi https://humantext.pro untuk memulai secara gratis.

Siap mengubah konten yang dihasilkan AI menjadi tulisan yang alami dan manusiawi? Humantext.pro menyempurnakan teks Anda secara instan, memastikan terbaca alami sambil melewati detektor AI. Coba humanizer AI gratis kami hari ini →

Artikel Terkait

AI Writing Assistance: Master Ethical Content Creation

Master AI writing assistance: learn workflows, best practices, & ethical use to create high-quality, human-sounding content that truly works.

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.