AI-humanizer zonder woordlimiet: Een praktische gids voor het humaniseren van lange content

AI-humanizer zonder woordlimiet: Leer praktische workflows om lange content om te zetten in boeiende, natuurlijk klinkende tekst zonder beperkingen.

Laten we eerlijk zijn: een echte AI-humanizer zonder woordlimiet is een beetje een mythe. Er bestaat geen magische knop die een manuscript van 100.000 woorden in één keer feilloos humaniseert. De meeste tools hebben teken- of woordlimieten, waardoor u uw scriptie of e-book in kleine, frustrerende stukjes moet invoeren.

Omgaan met grootschalige content-humanisering

Of u nu een masterstudent bent die worstelt met een scriptie van 10.000 woorden, een SEO-professional die een dozijn artikelen jongleert, of een onderzoeker die een compact academisch paper opstelt – het probleem is altijd hetzelfde. U zit op een berg AI-gegenereerde tekst die echt menselijk moet klinken – niet alleen om de steeds slimmere AI-detectoren van vandaag te doorstaan, maar om daadwerkelijk een connectie te maken met uw lezers.

De gebruikelijke copy-paste-routine, waarbij u telkens 300 of 500 woorden verwerkt, is meer dan alleen vervelend. Het is een echte workflow-killer. Dit handmatige werk nodigt uit tot fouten, verwatert uw toon en vreet uren die u beter kunt besteden aan strategie en fijnschaven. Voor iedereen die content op schaal produceert, is dit een groot knelpunt.

Wanneer u met lange content werkt, gaan de uitdagingen verder dan simpele woordaantallen. De echte strijd is het bewaren van de integriteit van het werk van begin tot eind.

Uitdagingen bij het humaniseren van lange AI-content

| Uitdaging | Impact op uw werk | Strategische oplossing |

|---|---|---|

| Verlies van context | De tool mist het overkoepelende verhaal, wat leidt tot generieke of irrelevante herschrijvingen. | Verwerk content in logische, op zichzelf staande secties (bijv. hoofdstukken, kernargumenten) om voldoende context te bieden. |

| Narratieve fragmentatie | De flow tussen alinea's breekt af, wat een onsamenhangend en schokkend leesgevoel creëert. | Laat uw tekstblokken enigszins overlappen en controleer overgangen handmatig om een vloeiende, coherente leesflow te garanderen. |

| Tonale inconsistentie | Uw document klinkt uiteindelijk alsof het door een comité is geschreven, met wisselende tonen en stijlen. | Stel een duidelijke stijlgids of referentietoon op voor de humanizer en bewerk na verwerking handmatig voor consistentie. |

| Extreme tijdsinefficiëntie | Het handmatige werk van het splitsen en weer samenvoegen van tekst maakt het doel van AI voor snelheid zinloos. | Gebruik een systematische "chunking-methode" die het opsplitsings- en herassemblageproces stroomlijnt en omzet in een voorspelbare workflow. |

Deze obstakels benadrukken waarom een eenvoudige tool niet genoeg is; u heeft een slimmer proces nodig.

Waarom standaardtools tekortschieten

De meeste AI-humanizers zijn ontworpen voor snelle taken: e-mails, social media-bijschriften of korte alinea's. Hun verwerkingslimieten zijn een praktische realiteit, verbonden aan serverkosten en de enorme complexiteit van het herschrijven van tekst met behoud van de kernbetekenis.

Wanneer u een groot document door deze tools probeert te persen, worden de beperkingen pijnlijk duidelijk:

- Contextblindheid: Een tool die slechts een klein stukje van uw werk ziet, kan de verhaallijn, argumenten of vaktermen die u heeft opgebouwd niet bevatten. Het is alsof u iemand vraagt een film te beschrijven nadat ze slechts een clip van 30 seconden hebben gezien.

- Gebroken flow: Hoofdstuk voor hoofdstuk verwerken verbreekt vaak de logische bruggen tussen ideeën. U blijft achter met een verzameling alinea's die niet echt met elkaar communiceren, waardoor de lezer te hard moet werken.

- De val van handmatig werk: De moeite die het kost om een groot document op te knippen, te verwerken en weer samen te voegen is enorm. Het ondermijnt volledig de efficiëntie die AI in eerste instantie zou moeten bieden.

De echte uitdaging is niet alleen het doorstaan van een detector; het is het bewaren van de ziel en samenhang van een lang stuk tekst. Een document dat 100% menselijk scoort maar leest als een warrige puinhoop is een totale mislukking.

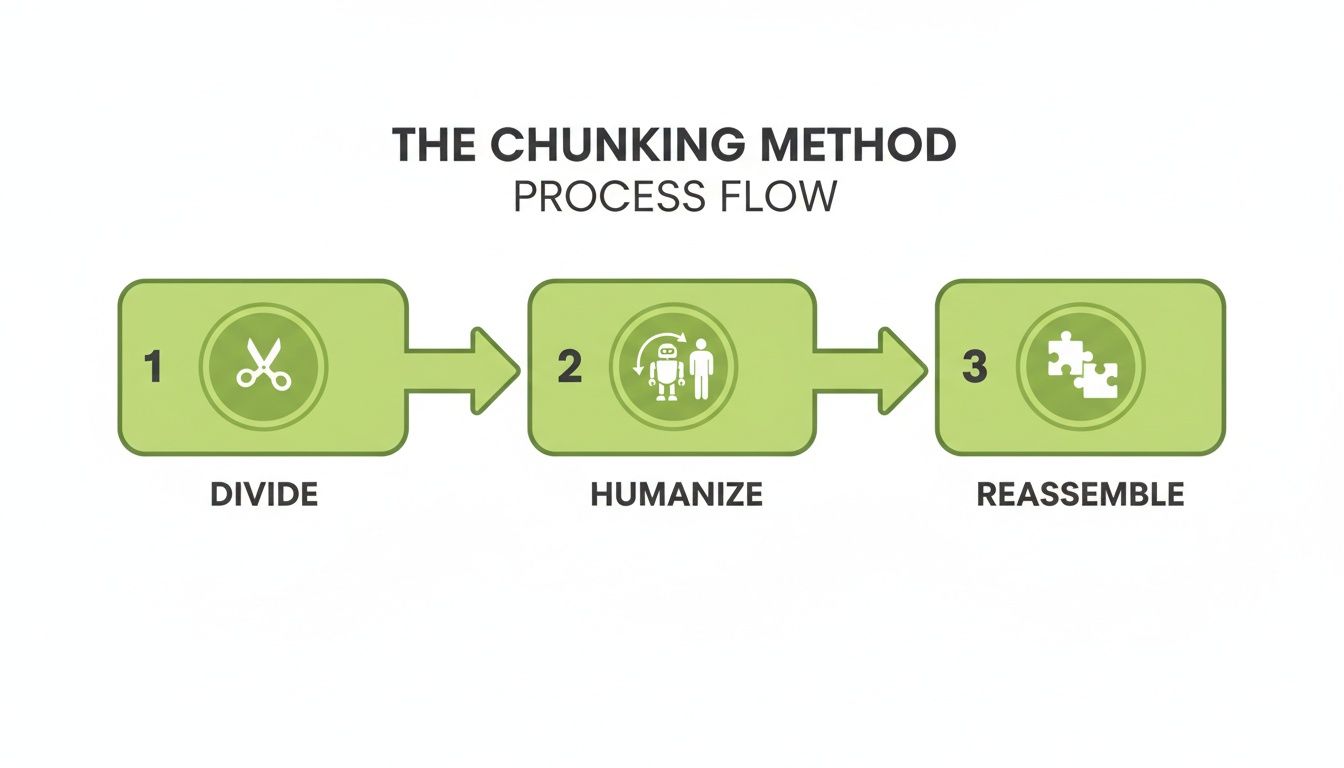

Hier maakt een strategische workflow het verschil. In plaats van te zoeken naar een mythische AI-humanizer zonder woordlimiet, is de echte oplossing om methodisch te werk te gaan. De meest effectieve strategie die ik heb gevonden is de 'chunking-methode' – een systeem om grote documenten intelligent op te delen, te humaniseren en weer samen te stellen met behoud van kwaliteit. Het transformeert een ontmoedigende taak in een beheersbaar, herhaalbaar proces.

Voor een diepere duik in verschillende tools en hun sterke punten, bekijk onze gids over de best AI humanizer opties beschikbaar voor verschillende soorten content.

De chunking-methode voor feilloze humanisering

U staart dus naar een enorm document – een scriptie, een e-book, misschien een pillar page van duizenden woorden. Het hele ding in één keer proberen te humaniseren is alsof u de oceaan probeert te koken. Het is inefficiënt en breekt vaak de tool die u gebruikt.

In plaats daarvan heeft u een slimmere aanpak nodig. We noemen het de chunking-methode. Het draait allemaal om het opdelen van die berg tekst in beheersbare, logische stukken.

Denk eraan als een architect die een gebouw plant, niet als een sloopploeg die willekeurig muren omver werpt. U wilt uw document verdelen langs de natuurlijke structuurlijnen om de context en flow intact te houden.

Hier is een praktische uiteenzetting van hoe u uw blokken kiest:

- Voor een onderzoekspaper: Ik splits het op in de kernsecties – Inleiding, Literatuuroverzicht, Methodologie, Resultaten en Conclusie. Elk deel is een op zichzelf staand argument, perfect voor verwerking per stuk.

- Voor een lang blogartikel: De H2-tussenkoppen zijn uw beste vrienden. Ze signaleren al een onderwerpswissel, waardoor ze de meest natuurlijke breekpunten zijn.

- Voor een e-book of roman: Dit is makkelijk. Gebruik de hoofdstukken. Elk hoofdstuk heeft zijn eigen mini-verhaallijn, dus het is de ideale eenheid om in een humanizer te voeren.

Deze strategie zorgt ervoor dat wanneer u een stuk verwerkt, de AI genoeg omringende tekst heeft om het specifieke punt te begrijpen dat u in dat deel maakt, wat leidt tot veel betere, relevantere resultaten.

De ideale blokgrootte vinden

De perfecte blokgrootte is een evenwichtsoefening. U heeft genoeg tekst nodig om de narratieve integriteit te bewaren, maar niet zoveel dat u de tool overweldigt.

De meeste humanizers, waaronder HumanText.pro, bieden een royale gratis proefversielimiet van doorgaans ongeveer 500 woorden. In mijn ervaring is dit de sweet spot. Het is groot genoeg om een compleet idee of een paar gedetailleerde alinea's te behandelen zonder de rode draad van het argument kwijt te raken.

Zo ziet een standaard humaniseringsinterface eruit – u plakt een van uw blokken direct in het invoerveld.

De overzichtelijke, eenvoudige lay-out is cruciaal. Wanneer u tientallen blokken verwerkt, wilt u absoluut geen ingewikkelde workflow.

Gehumaniseerde content weer samenvoegen

Zodra al uw blokken zijn verwerkt, is het tijd voor herassemblage. En nee, dit is niet gewoon kopiëren en plakken. Dit is het moment waarop u uw redacteurspet opzet en de naden gladstrijkt waar de verschillende stukken samenkomen.

Concentreer u op naadloze overgangen. Soms eindigt een humanizer een blok met een mooie, afsluitende zin, maar het volgende blok is bedoeld om diezelfde gedachte voort te zetten. U moet ingrijpen en die zinnen handmatig aanpassen om het gat te overbruggen.

Praktisch voorbeeld:

- Originele overgang (onhandig): "...en daarom zijn zonnepanelen efficiënt." [Einde van Blok 1] "Geothermische energie biedt een andere duurzame optie." [Begin van Blok 2]

- Verbeterde overgang (vloeiend): "...en daarom zijn zonnepanelen efficiënt." [Einde van Blok 1] "Hoewel zonne-energie een populaire keuze is, biedt geothermische energie een andere duurzame optie." [Begin van Blok 2]

Professionele tip: Lees het volledige, samengestelde document hardop voor van begin tot eind. Dit is de beste manier om onhandige verschuivingen in toon of stijl op te vangen die mogelijk tussen de blokken zijn ingeslopen. Uw doel is een uniforme stem die volledig opzettelijk aanvoelt.

Gevoel krijgen voor woordaantallen is een groot deel van het optimaliseren van dit proces. Bekijk voor meer informatie onze gids over how long 500 words really is. Het is een game-changer voor het perfectioneren van uw chunking-strategie.

Laten we praktisch worden. Hoe werkt dit eigenlijk?

Stel u voor dat u een compact artikel van 3.000 woorden heeft dat een AI heeft uitgeproduceerd over duurzame stadsplanning. De feiten kloppen, maar het is slaapverwekkend – stijf, robotachtig en het schreeuwt "AI" naar elke detector op de markt. Onze missie is om het om te vormen tot iets boeiends en, bovenal, menselijks.

De eerste stap is simpel: opdelen in blokken. Ik zou dat beest van 3.000 woorden opsplitsen in zes beheersbare stukken van 500 woorden. De truc is om logische snedes te maken. Ik splits artikelen meestal precies bij de H2-tussenkoppen. Dit houdt het kernargument van elke sectie intact en voorkomt dat de humanizer de context verliest en uw ideeën door elkaar gooit.

Verwerking en kwaliteitscontroles

Met mijn zes blokken klaar om te gaan, begin ik het echte werk. Ik neem de eerste sectie van 500 woorden, plak die in de HumanText.pro-interface en klik op "Humanize". Het duurt maar een paar seconden.

Maar voordat ik naar het volgende blok spring, doe ik een snelle kwaliteitscontrole op het resultaat. Dit is voor mij een niet-onderhandelbare stap.

Hier is mijn mini-checklist voor elk stuk:

- Inhoudelijke integriteit: Heeft de herschrijving de originele feiten en argumenten behouden? Als de oorspronkelijke tekst bijvoorbeeld "een reductie van 25% in emissies" noemde, mag de gehumaniseerde tekst niet simpelweg "een aanzienlijke reductie" zeggen.

- Tonconsistentie: Klinkt de nieuwe tekst nog steeds professioneel en informatief? Het doel is om het beter te laten klinken, niet alsof het door een compleet ander persoon is geschreven.

Ik herhaal dit proces gewoon voor alle zes de blokken en sla elke gehumaniseerde output op in een nieuw document. Het is een methodische aanpak, maar het garandeert dat elk deel de aandacht krijgt die het nodig heeft voordat de definitieve assemblage plaatsvindt.

Deze volledige workflow – verdelen, humaniseren, samenvoegen – is de sleutel tot effectief omgaan met lange content.

Een grote taak opdelen in kleinere, gecontroleerde stappen zoals deze is hoe u kwaliteitscontrole handhaaft en eindigt met een gepolijst, naadloos eindconcept.

Herassemblage en laatste fijnschaving

Zodra alle blokken zijn gehumaniseerd, is het tijd om ze weer samen te voegen. Ik assembleer de secties in hun oorspronkelijke volgorde. Dit deel is meer dan een simpele kopieer-en-plak-klus; ik zoek naar de naden tussen de blokken en werk onhandige overgangen bij zodat het verhaal natuurlijk stroomt.

Vervolgens laat ik het volledige artikel van 3.000 woorden door een AI-detector lopen. Ik moet een hoge menselijke score zien over het hele document, niet alleen in geïsoleerde delen.

Maar de meest kritieke laatste stap is een eenvoudige menselijke lezing. Ik lees het hele artikel altijd hardop voor. Het is de beste manier om vreemde formuleringen of schokkende zinnen op te vangen die software mogelijk mist. Dit is de afwerking die goede content onderscheidt van werkelijk geweldige content.

Deze laatste controle is essentieel. De beste tools hebben immers een detectienauwkeurigheid van 65-90%, dus die menselijke verificatie is uw ultieme vangnet. Het zorgt ervoor dat de content niet alleen een scan doorstaat, maar daadwerkelijk verbinding maakt met een echt persoon.

Als u veel content verwerkt, is upgraden naar een betaald HumanText.pro-plan een no-brainer. Het elimineert woordlimieten en maakt de hele workflow sneller en efficiënter. Bekijk voor meer tips onze gids over hoe een https://humantext.pro/blog/chat-gpt-humanizer uw proces naar een hoger niveau kan tillen. U kunt deze workflow ook integreren met toonaangevende AI-contentkalender-tools om uw volledige contentpijplijn te beheren van creatie tot publicatie.

Geavanceerde strategieën voor automatisering en schaalvergroting

Als u een contentagentschap runt, een vloot SEO-sites beheert, of gewoon een berg tekst te verwerken heeft, is het handmatige chunking-proces een echte rem. Handmatig kopiëren, plakken en samenvoegen van tekst is een serieus knelpunt dat het snelheidsvoordeel ondermijnt dat u door het gebruik van AI had behaald.

Wanneer u tientallen artikelen per week verwerkt, telt dat "snelle" handmatige proces behoorlijk op. Om dit echt op grote schaal te laten werken, moet u voorbij de browser gaan en automatisering omarmen.

Hier wordt een API (Application Programming Interface) uw nieuwe beste vriend. Zie het als een directe lijn van uw systemen naar een AI-humanizer zoals HumanText.pro, zonder menselijke klikken. In plaats van de machine één klein stukje tegelijk te voeden, kunt u een gestroomlijnde pipeline bouwen die de hele reeks automatiseert.

Een geautomatiseerde humaniseringspipeline bouwen

Het opzetten van een geautomatiseerde workflow klinkt intimiderender dan het is. Het kernidee is simpel: creëer een systeem dat een lang document kan pakken, het in perfect gedimensioneerde blokken kan snijden, elk ervan naar de API van de humanizer kan sturen en vervolgens de verwerkte tekst netjes weer kan samenvoegen.

U hoeft geen ontwikkelaar te zijn om dit voor elkaar te krijgen. Dit kan gedaan worden met eenvoudige scripts of zelfs no-code platforms zoals Zapier of Make. Stel u een workflow voor waarbij het plaatsen van een nieuw AI-opgesteld artikel in een Google Drive-map automatisch het volledige humaniseringsproces op de achtergrond start.

Zo ziet dat er in de praktijk uit:

- Trigger: Een nieuw bestand wordt toegevoegd aan een specifieke Google Drive-map.

- Actie 1 (Automatisch chunking): Een Zapier- of Make.com-workflow splitst het document automatisch op in tekstblokken van 500 woorden.

- Actie 2 (API-aanroepen): De workflow stuurt elk blok één voor één naar het HumanText.pro API-eindpunt.

- Actie 3 (Herassemblage): Het script verzamelt alle gehumaniseerde outputs en creëert een nieuw document in een andere Google Drive-map, klaar voor definitieve review.

Het bouwen van zo'n pipeline is de sleutel tot het opschalen van uw contentoperaties. Een workflow die ooit een uur handmatig werk kostte, kan in minuten worden afgerond, waardoor uw team zich kan richten op strategie, redactie en creatieve taken.

Wanneer u de bron van dergelijke content bekijkt, zoals een krachtige AI-persbericht-generator, kunt u zien waarom een gestroomlijnd humaniseringsproces aan de achterkant zo cruciaal is.

Kosten en kwaliteit op schaal beheren

Hoewel automatisering een game-changer is voor efficiëntie, brengt het ook een paar nieuwe aandachtspunten met zich mee. Wanneer u op volume opereert, moet u slim omgaan met kosten en kwaliteitsbehoud.

Kostenbeheer: De meeste API-toegang werkt op pay-as-you-go-basis, doorgaans gefactureerd per teken of woord. Voordat u volledige automatisering inschakelt, maak een ruwe berekening. Schat uw maandelijkse volume in en modelleer de potentiële kosten zodat er geen verrassingen zijn. Het is ook verstandig om waarschuwingen in te stellen om uw verbruik te monitoren.

Kwaliteitsborging: Automatisering is snel, maar niet perfect. Een laatste menselijke controle is onmisbaar. Bouw een snelle kwaliteitscheck in aan het einde van uw pipeline. Nadat het document is samengesteld, moet iemand het een laatste keer doorlezen om onhandige overgangen tussen blokken glad te strijken of vreemde formuleringen te corrigeren die de machine mogelijk heeft gemist. Deze laatste fijnschaving zorgt ervoor dat uw opgeschaalde content nog steeds aan uw hoge standaarden voldoet.

Veelvoorkomende valkuilen bij AI-humanisering vermijden

Wanneer u een lang document stuk voor stuk verwerkt, nodigt u een paar subtiele problemen uit die het eindproduct kunnen saboteren als u niet oplet. Zelfs de slimste AI-humanizer zonder woordlimiet-workflow heeft een scherp oog nodig om deze veelgemaakte fouten op te vangen. De twee grootste boosdoeners zijn tonale inconsistentie en contextverlies – beide kunnen de geloofwaardigheid van uw content volledig ondermijnen.

Tonale inconsistentie is schokkend voor een lezer. Stel u voor dat het ene hoofdstuk van uw e-book klinkt als een stijf academisch paper, maar het volgende leest als een casual, vlotte blogpost. Dit gebeurt wanneer de humanizer, werkend aan geïsoleerde blokken, voor elk stuk verschillende stilistische keuzes maakt. U zit opgescheept met een onsamenhangend zootje.

Dan is er contextverlies. Dit is wanneer de tool simpelweg het grote geheel niet kan zien. Het kan cruciale nuances, terugkerende thema's of gespecialiseerde terminologie missen die u zorgvuldig in eerdere secties heeft vastgelegd. Dit leidt tot generieke, of zelfs tegenstrijdige, herschrijvingen. Een humanizer kan een term in het ene blok vereenvoudigen maar het in een ander zeer technisch laten, waardoor uw lezer compleet in verwarring raakt.

De essentiële cohesiebewerking

Om dit allemaal op te lossen, moet u absoluut een speciale "cohesiebewerking" uitvoeren nadat u uw gehumaniseerde blokken weer heeft samengevoegd. Dit is uw kans om de stem van het document te uniformeren en eventuele schokkerige overgangen glad te strijken. Het is een niet-onderhandelbare stap.

Hier is een praktische checklist voor uw cohesiebewerking:

- Stem en toon uniformeren: Lees de eerste alinea van elke grote sectie. Klinken ze alsof ze door dezelfde persoon zijn geschreven? Zo niet, pas de woordkeuze aan. Voorbeeld: Vervang "benutten" in de ene sectie door "gebruiken" als de rest van het document informeler is.

- Overgangen gladstrijken: Scan de eerste zin van elke alinea die volgt op een sectiewissel. Sluit die aan op het vorige idee? Zo niet, voeg een eenvoudige verbindingszin toe. Voorbeeld: Verander "De data toont een trend" naar "Voortbouwend op het vorige punt toont de data ook een trend."

- Sleuteltermen controleren: Gebruik de zoekfunctie van uw tekstverwerker (Ctrl+F of Cmd+F) om sleuteltermen te vinden. Heeft u aan het begin een afkorting als "SEO" geïntroduceerd? Zorg ervoor dat u in een later hoofdstuk niet opnieuw "Search Engine Optimization" uitschrijft.

Deze cohesiebewerking is zoveel meer dan alleen proeflezen. Het gaat erom individuele draden weer tot één enkel, naadloos tapijt te weven. Het is de ene stap die een verzameling goed geschreven alinea's verheft tot een werkelijk samenhangend, impactvol document.

De definitieve menselijke review

Hoe geavanceerd uw tools ook zijn, niets kan een definitieve menselijke review vervangen. Deze laatste lezing is waar u subtiele fouten vangt en de laatste laag afwerking toevoegt die automatisering simpelweg niet kan repliceren. Het is uw kans om persoonlijkheid in te brengen, feiten dubbel te controleren en ervoor te zorgen dat de content echt verbinding maakt met uw publiek.

Voor bureaus die webteksten opschalen, is dit hele proces een uitkomst. U kunt ruwe content plakken, direct een AI-score krijgen en tekst in seconden humaniseren, waarbij de kernbetekenis behouden blijft terwijl die cruciale laag authenticiteit wordt toegevoegd. Hier blinkt HumanText.pro echt uit, met taalkundige modellen getraind op meer dan 1,2 miljoen tekstvoorbeelden om natuurlijk schrijven na te bootsen – u hoeft zich niet eens aan te melden voor een proefversie. Freelancers hebben ons verteld dat het gepolijste AI omzet in boeiende berichten die elke controle doorstaan, en hen helpt opdrachten binnen te halen zonder rode vlaggen op te roepen. Meer informatie vindt u op bypassing AI detection with these methods on papergen.ai.

Veelgestelde vragen over het humaniseren van lange content

Wanneer u naar een berg AI-tekst staart, duiken er altijd een paar vragen op. Het is natuurlijk om u af te vragen over de logistiek, de impact en de beveiliging van het proces. Laten we een aantal van de meest voorkomende vragen beantwoorden die we horen van gebruikers die grote projecten aanpakken.

Kan deze methode echt werken voor een boek of scriptie?

Absoluut. Dit is precies waarvoor de chunking-strategie is ontworpen. U gaat niet een heel manuscript van 80.000 woorden in één keer in een tool plakken – dat zou chaos zijn. In plaats daarvan splitst u het op.

Praktisch advies: Behandel bij een scriptie elk hoofdstuk (Inleiding, Literatuuroverzicht, Methodologie, enz.) als een apart project. Humaniseer eerst alle secties binnen Hoofdstuk 1, voer een cohesiebewerking uit op dat hoofdstuk, en ga pas dan door naar Hoofdstuk 2. Dit compartimentaliseert het werk en voorkomt overweldiging. Gebruik voor een boek dezelfde hoofdstuk-voor-hoofdstuk-aanpak.

Schaadt het in batches humaniseren mijn SEO?

Het tegenovergestelde – het zou uw SEO een serieuze boost moeten geven. Zoekmachines worden elke dag slimmer en ze zijn heel goed geworden in het herkennen van robotachtige, weinig behulpzame content. Wanneer u uw tekst humaniseert, zelfs in stukken, is het eindproduct natuurlijker en boeiender. Dat is een grote winst voor SEO.

Zolang u het artikel logisch weer samenvoegt en uw keyword-focus behoudt, maakt het proces uw content beter voor echte mensen. En wat goed is voor mensen is nu ook goed voor Google.

De gouden regel van moderne SEO is echte waarde bieden aan uw lezers. Gehumaniseerde content is inherent waardevoller omdat het helderder, boeiender en authentieker aanvoelt.

Uiteindelijk plaatst deze aanpak u precies in lijn met wat zoekalgoritmen zijn gebouwd om te belonen.

Hoe beschermt HumanText.pro mijn gevoelige documenten?

We begrijpen het. Het overhandigen van gevoelig academisch onderzoek of vertrouwelijke bedrijfsplannen is een grote stap. Daarom hebben we HumanText.pro gebouwd met een strikt privacy-first-beleid: we slaan uw content niet op, delen deze niet en gebruiken deze nergens voor, zeker niet voor het trainen van onze modellen.

Op het moment dat u uw tekst verwerkt en de sessie sluit, is het van onze kant verdwenen. Dit geldt voor iedereen, of u nu een gratis proefversie of een betaald plan gebruikt. Uw eigendomsinformatie blijft volledig vertrouwelijk, veilig en – het allerbelangrijkste – van u. Altijd.

Klaar om te stoppen met zorgen maken over woordlimieten en content te gaan creëren die echt aanspreekt? HumanText.pro geeft u een duidelijke, efficiënte workflow voor het humaniseren van tekst van elke lengte. Verander uw AI-concepten in hoogwaardige teksten die uw publiek echt wil lezen.

Bezoek https://humantext.pro om gratis te beginnen.

Klaar om je AI-gegenereerde content om te zetten in natuurlijk, menselijk geschreven tekst? Humantext.pro verfijnt je tekst direct en zorgt ervoor dat deze natuurlijk leest terwijl AI-detectoren worden omzeild. Probeer onze gratis AI-humanizer vandaag →

Gerelateerde Artikelen

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.