Uw gids voor het ethisch gebruiken van een anti-AI-detector

Ontdek hoe een anti-AI-detector werkt, waarom AI-detectie gebrekkig is en hoe u ethisch ondetecteerbare AI-ondersteunde content voor uw projecten kunt maken.

Een anti-AI-detector is geen dubieus hackingtool. Het is simpelweg software die is ontworpen om AI-gegenereerde tekst te nemen en aan te passen zodat het leest alsof het door een mens is geschreven, waardoor het onzichtbaar wordt voor detectiesoftware. Deze tools worden vaak AI-humanizers genoemd, en hun taak is om content te herschrijven door de zinstructuur, woordenschat en het ritme te veranderen om een natuurlijke, menselijke stem na te bootsen.

Het kat-en-muisspel van AI-contentcreatie

Welkom bij de nieuwe realiteit van digitaal schrijven: een eindeloze achtervolging tussen AI-contentgeneratoren en de detectoren die zijn gebouwd om ze op te sporen. Zie het als een high-tech kat-en-muisspel. Elke keer dat een nieuw AI-schrijfmodel uitkomt, is een slimmere detector niet ver achter. En direct op zijn hielen? Een nog betere anti-AI-detector. Deze cyclus is de centrale uitdaging voor schrijvers vandaag.

Laten we eerlijk zijn – studenten, marketeers en creatievelingen gebruiken allemaal AI. Het is fantastisch om vooruit te komen, ideeën te brainstormen en eerste concepten te maken. De wrijving begint wanneer die AI-ondersteunde content moet worden ingediend voor een cijfer of online moet worden gepubliceerd. Om geloofwaardig te zijn, moet het echt aanvoelen. Het probleem is dat ruwe AI-tekst vaak subtiele "vingerafdrukken" achterlaat, zoals voorspelbare zinspatronen en een robotachtig gebrek aan stijl, die detectoren zijn gebouwd om te vinden.

De bloeiende detectiemarkt

De omvang van dit heen en weer is enorm. Miljoenen artikelen, essays en rapporten worden dagelijks gescand door tools die rechtstreeks zijn geïntegreerd in academische platforms en contentsystemen. Dit heeft een goudkoorts veroorzaakt, waardoor een enorme industrie is ontstaan die zich richt op het opsporen van machinaal geschreven tekst.

Hoe groot is deze markt? Volgens één analyse werd de wereldwijde AI-detectormarkt gewaardeerd op 453,2 miljoen USD en zal naar verwachting exploderen tot 5.226,4 miljoen USD tegen 2033. Dat weerspiegelt een verbazingwekkende samengestelde jaarlijkse groei van 31,6%. U kunt meer leren over deze marktprognoses en hun impact.

Deze financiële boom creëert een krachtige prikkel voor detectoren om nog agressiever te worden, wat op zijn beurt de vraag naar effectieve humanisatietools aanwakkert.

Een pad naar authenticiteit vinden

Het doel hier is niet alleen om een stuk software te "verslaan". Het gaat erom een nuttig maar gebrekkig AI-concept te nemen en het te verfijnen tot iets dat echte menselijke gedachten en persoonlijkheid weerspiegelt. Dit is precies waar tools die zijn ontworpen om tekst te humaniseren van pas komen, waardoor de kloof wordt overbrugd tussen machine-achtige efficiëntie en menselijke creativiteit.

Zo ziet een typische anti-AI-detector-interface eruit, gebouwd voor eenvoud en snelheid.

De hele workflow is ontworpen om schoon en intuïtief te zijn: u plakt uw tekst, analyseert deze en humaniseert deze met één klik. Dit is gebouwd voor schrijvers die betrouwbare resultaten nodig hebben zonder een ingewikkeld proces. Uiteindelijk gaat de uitdaging niet alleen om het behalen van een voldoende; het gaat om het terugwinnen van de natuurlijke stem in uw schrijven.

Hoe AI-detectoren hun digitale vingerafdrukken herkennen

Om AI-detectoren te omzeilen, moet u eerst begrijpen waar ze eigenlijk naar zoeken. Zie AI-gegenereerde tekst als een subtiele maar consistente "taalkundige vingerafdruk". Het is onzichtbaar voor een gewone lezer, maar het bestaat uit voorspelbare patronen die gespecialiseerde algoritmen zijn getraind om te herkennen.

Deze tools zijn geen magie. Het zijn alleen hooggespecialiseerde patroonherkenningssystemen. Ze analyseren tekst op basis van een paar kernprincipes die bijna altijd machinaal schrijven van menselijk schrijven scheiden. Zodra u deze principes begrijpt, zult u precies zien waar AI-gegenereerde content tekortschiet – en waarom het humaniseren ervan zo goed werkt.

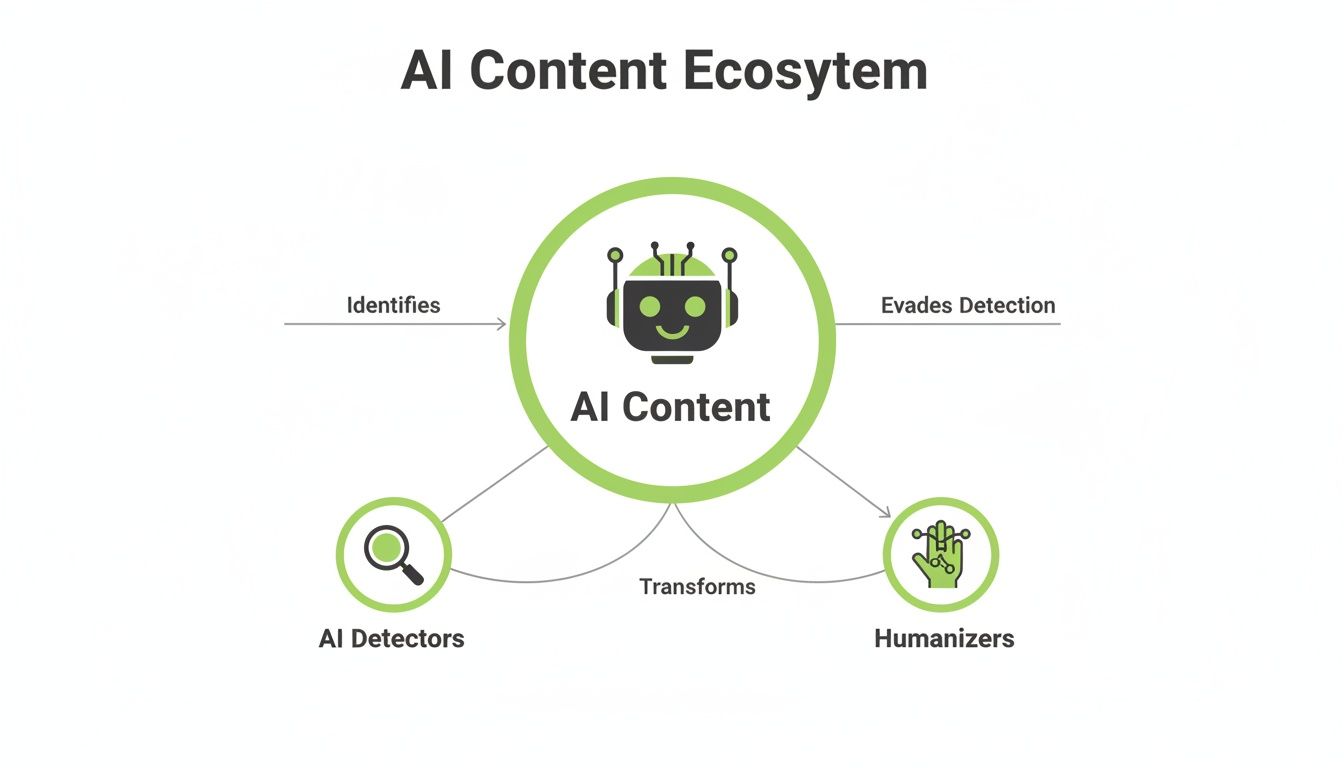

Deze kaart toont de duw-en-trekrelatie tussen AI-content, de detectoren die zijn gebouwd om het op te sporen, en de humanizers die zijn ontworpen om het niet-detecteerbaar te maken.

Dit hele ecosysteem draait om een centraal kat-en-muisspel: AI genereert tekst, detectoren onderzoeken het en humanizers verfijnen het.

De jacht op voorspelbaarheid (lage perplexiteit)

Een van de grootste aanwijzingen voor AI-content is hoe voorspelbaar het is. In de kern zijn AI-modellen expert-gokkers. Ze zijn getraind om het statistisch meest waarschijnlijke volgende woord te kiezen, keer op keer. Dit creëert tekst die soepel en logisch is, maar vaak elke echte vonk of originaliteit mist.

In technische termen wordt dit gemeten door perplexiteit. Een lage perplexiteitsscore betekent dat de tekst zeer voorspelbaar is, zoals een muzikant die alleen dezelfde drie akkoorden in dezelfde volgorde speelt. Menselijk schrijven daarentegen is van nature chaotischer. Het heeft een hogere perplexiteit omdat we onverwachte woorden, vreemde formuleringen en creatieve zinsstructuren gebruiken.

- Praktisch voorbeeld: Een AI zou de zin "De lucht is..." kunnen aanvullen met "blauw." Het is het meest voorkomende, statistisch veilige antwoord. Een menselijke schrijver, die streeft naar een meer evocatieve toon, zou kunnen kiezen voor "een gekneusd paars" of "de kleur van oude televisieruis." Deze minder voorspelbare keuzes verhogen de perplexiteit.

Detectoren zijn gebouwd om precies deze kwaliteit te analyseren. Als een stuk schrijven een beetje te perfect is en de woordkeuzes altijd de meest voor de hand liggende zijn, wordt er een alarmsignaal afgegeven. Het is een klassiek teken dat een machine achter het toetsenbord zat.

Analyse van zinsvariatie (burstiness)

Een andere belangrijke maatstaf is burstiness. Menselijk schrijven vloeit van nature op en neer. We schrijven misschien een paar korte, pakkende zinnen en volgen ze dan op met een langere, meer complexe. Deze variatie in zinslengte en -structuur creëert een dynamisch, boeiend ritme.

AI-modellen? Niet zo veel. Ze hebben de neiging om zinnen van zeer uniforme lengte en complexiteit te produceren. Hun output is vaak stabiel en monotoon, zonder de "bursts" van creativiteit die in menselijk proza worden gevonden. Een AI-detector meet deze consistentie; als de tekst te vlak is, wordt deze eerder gemarkeerd.

- Uitvoerbaar inzicht: Ga na het genereren van AI-tekst door en breek opzettelijk het ritme. Combineer twee korte zinnen tot een langere met een voegwoord zoals "maar" of "terwijl". Verdeel vervolgens een lange, complexe zin in twee of drie korte, impactvolle zinnen. Deze enkele bewerkingsdoorgang kan de burstiness dramatisch verhogen.

Een effectieve anti-AI-detectortool wisselt niet alleen een paar woorden uit. Het herstructureert zinnen intelligent, introduceert gevarieerde ritmes en doorbreekt die robotachtige uniformiteit om zowel perplexiteit als burstiness te verhogen, waardoor de tekst statistisch niet te onderscheiden is van iets dat een persoon schreef.

Deze detectiewapenwedloop is aangewakkerd door de enorme hoeveelheid AI-content die er is. ChatGPT's marktdominantie heeft bijvoorbeeld een enorme, uniforme dataset gecreëerd waarop detectoren kunnen trainen. In een recent jaar had ChatGPT een ongelooflijk 60,2% van het wereldwijde AI-toolmarktaandeel.

Dit heeft geleid tot een toename van detectie, waarbij platforms zoals Turnitin 200 miljoen studentenwerkstukken in één jaar hebben beoordeeld en 11% daarvan hebben gemarkeerd voor significant AI-gebruik. U kunt meer gegevens over AI-toolgebruik en de impact ervan bekijken op Statista.com.

Veelvoorkomende AI-detectiemethoden in één oogopslag

Hoe identificeren detectoren deze digitale vingerafdrukken eigenlijk? Ze gebruiken verschillende methoden, en hoewel de technologie ingewikkeld wordt, vallen de basisbenaderingen in een paar hoofdcategorieën.

Deze tabel splitst de meest voorkomende technieken op hoog niveau op.

| Detectiemethode | Wat wordt geanalyseerd | Eenvoudige analogie |

|---|---|---|

| Statistische analyse | Voorspelbaarheid (perplexiteit), zinsvariatie (burstiness) en woordfrequentie. | Een muziekrecensent die analyseert of een nummer te eenvoudig en repetitief is om door een ervaren componist te zijn geschreven. |

| Classificator-gebaseerde modellen | Complexe, gecombineerde patronen geleerd uit miljoenen menselijke vs. AI-schrijfvoorbeelden. | Een hoogopgeleide kunstexpert die een vervalsing kan herkennen door duizenden kleine, subtiele penseelstreken op te merken die niet "juist" aanvoelen. |

| Forensische analyse | Verborgen metadata of digitale artefacten achtergelaten door een specifiek AI-model. | Een detective die op een plaats delict naar vingerafdrukken zoekt. |

| Watermerken | Onzichtbare signalen of patronen die direct in de output van de AI zijn ingebed door de makers. | Een verborgen watermerk op een bankbiljet dat alleen zichtbaar is onder een speciaal licht. |

Elke methode heeft zijn sterke punten, maar ze delen allemaal een gemeenschappelijke kwetsbaarheid: ze vertrouwen op patronen. En patronen kunnen opzettelijk worden verstoord. Door deze technieken te begrijpen, wordt het veel duidelijker hoe tools zoals ZeroGPT hun doelen vinden.

Als u geïnteresseerd bent in een diepere blik op het omzeilen van een specifieke tool, bekijk dan onze gids over hoe u ZeroGPT-detectie kunt omzeilen.

Waarom AI-detectorscores misleidend kunnen zijn

De score van een AI-detector kan aanvoelen als een definitief oordeel, maar het is verre van onfeilbaar. Deze tools werken op basis van waarschijnlijkheden, niet zekerheden, wat betekent dat hun oordelen vaak slechts geïnformeerde gissingen zijn. Er volledig op vertrouwen is als een weer-app vertrouwen die maar soms gelijk heeft – u krijgt misschien zonneschijn, of u wordt misschien in een storm gevangen.

Deze ingebouwde onzekerheid leidt tot een significant en verontrustend probleem: fout-positieven. Een fout-positief treedt op wanneer tekst die volledig door een mens is geschreven, ten onrechte wordt gemarkeerd als gegenereerd door AI. Dit is geen zeldzame fout; het is een veelvoorkomend gebrek dat ernstige gevolgen kan hebben voor studenten, schrijvers en professionals die plotseling hun authentieke werk onterecht in twijfel getrokken zien.

Wanneer menselijk schrijven robotachtig lijkt

Dus waarom wordt perfect menselijk werk verward met AI? De redenen liggen vaak in schrijfstijlen die simpelweg niet overeenkomen met wat de detector als "normaal" beschouwt. Elke strategie om met deze tools om te gaan, moet rekening houden met hun inherente vooroordelen.

Bijvoorbeeld, niet-moedertaalsprekers van het Engels leren de taal vaak op een zeer gestructureerde, formele manier. Hun schrijven zou van nature een lagere "perplexiteit" en "burstiness" kunnen hebben – precies de eigenschappen die detectoren zijn getraind om met machines te associëren. Evenzo wordt schrijvers in technische of academische gebieden geleerd om direct en nauwkeurig te zijn, een stijl die gemakkelijk de rechtlijnigheid van AI-gegenereerde tekst kan nabootsen.

Hier zijn een paar scenario's waarin menselijke schrijvers een hoog risico lopen op een fout-positief:

- Formeel academisch schrijven: Essays die strikte structurele regels volgen en formele taal gebruiken.

- Technische documentatie: Handleidingen of rapporten waarbij duidelijkheid voorrang heeft op stilistische flair.

- Niet-moedertaalsprekers: Personen wier zinconstructie grammaticaal perfect maar minder gevarieerd kan zijn.

Een "100% Mens"-score is geen garantie voor kwaliteit, net zoals een "90% AI"-score geen definitief bewijs is van machinegeneratie. Deze scores zijn slechts datapunten, en ze moeten met gezonde scepsis worden behandeld, niet met blind vertrouwen.

De omvang van het probleem

De explosieve groei van AI-detectoren in het onderwijs is een enorm weksignaal. In één enkel academisch jaar heeft Turnitin 200 miljoen werkstukken onderzocht en 11% daarvan gemarkeerd – dat zijn 22 miljoen documenten – als meer dan 20% AI-gegenereerde content bevatten. Hoewel dit de omvang van detectie benadrukt, onderstreept het ook de immense druk op studenten en het zeer hoge foutenrisico wanneer miljoenen werkstukken automatisch worden gescand.

Wanneer u met zulke grote aantallen werkt, kan zelfs een klein foutenpercentage duizenden individuen treffen. Een student kan worden geconfronteerd met beschuldigingen van academische oneerlijkheid, of een professionele schrijver kan het vertrouwen van een klant verliezen, allemaal gebaseerd op een gebrekkige algoritmische score.

Fout-negatieven: De AI die erdoorheen glipt

Aan de andere kant van de medaille zijn fout-negatieven, waarbij AI-gegenereerde content met succes een detector misleidt en een "menselijke" score krijgt. Naarmate taalmodellen geavanceerder worden, verbetert hun vermogen om menselijk schrijven na te bootsen, waardoor ze veel moeilijker te vangen zijn. Dit geldt vooral voor content die licht is bewerkt of door een AI-humanizer is geleid.

Het bestaan van zowel fout-positieven als fout-negatieven onthult een kritieke waarheid: AI-detectoren zijn simpelweg niet betrouwbaar genoeg om de enige rechter te zijn van de oorsprong van een tekst. Ze kunnen een nuttig hulpmiddel zijn voor initiële analyse, maar hun scores mogen nooit menselijk oordeel overschrijven. Voor degenen die willen begrijpen hoe humanizers werken om deze problemen te bestrijden, kunt u meer leren over of ondetecteerbare AI echt werkt in onze gedetailleerde gids. Deze context is cruciaal voor iedereen die AI-ondersteunde schrijftools verantwoord gebruikt.

Uitvoerbare strategieën voor het humaniseren van AI-content

Weten waarom AI-detectoren uw content markeren is de helft van de strijd. Weten hoe u het moet oplossen is waar het echte werk begint. Robotachtige, voorspelbare AI-tekst transformeren in iets dat ademt met menselijke persoonlijkheid is geen magie – het gaat om het toepassen van specifieke, hands-on schrijftechnieken.

Dit is het draaiboek voor het omzetten van een steriel eerste concept in overtuigende, authentieke content die daadwerkelijk contact maakt met lezers en langs detectoren zeilt.

Deze handmatige strategieën zijn de allereerste basis van hoe een effectieve anti-AI-detectortool werkt. Zodra u ze begrijpt, zult u de complexe taalkundige aanpassingen waarderen die humanizers automatisch toepassen, waardoor u uren moeizame bewerking bespaart.

Beheers zinsstructuur en flow

Het verraadteken nummer één van AI-schrijven is het monotone ritme. AI-modellen zijn getraind op uniformiteit, dus ze spugen vaak zinnen van vergelijkbare lengte en structuur uit, de ene na de andere. Uw eerste taak is om dat patroon te doorbreken en een natuurlijke cadans te introduceren.

Dit is waar u zich richt op het verhogen van burstiness. Mix het. Schrijf een korte, pakkende zin. Volg het met een lange, vloeiende die meerdere zinsdelen bevat. Die variatie is het kenmerk van menselijke expressie.

Voorheen (AI-gegenereerd):

"De implementatie van nieuwe softwaresystemen kan aanzienlijke uitdagingen opleveren voor organisaties. Medewerkers hebben vaak uitgebreide training nodig om zich aan te passen aan de nieuwe workflows. Dit proces kan tijdrovend zijn en kan de initiële productiviteitsniveaus beïnvloeden."

Nadien (Gehumaniseerd):

"Nieuwe software uitrollen is zwaar. Medewerkers staan voor een steile leercurve, en die aanpassingsperiode vreet aan de productiviteit – het is gewoon onderdeel van het proces."

De "nadien"-versie combineert ideeën, laat de formele taal achterwege en varieert de zinslengte, waardoor een veel boeiendere en menselijker flow wordt gecreëerd.

Injecteer uw unieke stem en persoonlijkheid

AI-modellen hebben geen meningen, persoonlijke ervaringen of gevoel voor humor. Ze kunnen ze alleen nabootsen op basis van trainingsgegevens. Om een tekst echt te humaniseren, moet u het doordrenken met uw eigen unieke perspectief. Dit is een kritieke stap die geen machine ooit volledig kan repliceren.

Zo doet u het:

- Voeg persoonlijke anekdotes toe: Deel een kort, relevant verhaal. Beginnen met "Ik herinner me een tijd toen..." signaleert onmiddellijk een menselijke touch. In plaats van bijvoorbeeld te zeggen dat AI de workflow verbetert, beschrijf een specifiek project waarbij het uw onderzoekstijd halveerde.

- Gebruik specifieke, concrete voorbeelden: In plaats van "verschillende factoren" te zeggen, som ze op. Verankerd abstracte concepten in realistische scenario's die uw publiek begrijpt.

- Integreer uitdrukkingen en spreektaal: Gebruik zinnen zoals "de kogel door de kerk jagen" of "een zegen in vermomming". Deze zijn vaak te genuanceerd voor AI om correct en natuurlijk te gebruiken.

Interessant is dat veel van de principes voor het humaniseren van AI-content overlappen met algemene best practices voor goed schrijven. Door u te richten op stem en authenticiteit, omzeilt u niet alleen detectoren; u wordt een betere schrijver. Voor een diepere duik, verken deze strategieën voor het creëren van boeiende content.

Diversifieer uw woordenschat en formulering

AI-modellen hebben een lijst met "favoriete woorden". Ze leunen zwaar op bepaalde formele en generieke termen omdat ze statistisch gebruikelijk zijn in de gegevens waarop ze zijn getraind. Uw doel is om deze repetitieve woorden te herkennen en ze te verwisselen voor interessantere, minder voorspelbare alternatieven.

Zie het als kruiden toevoegen aan een flauw gerecht. Laat de saaie werkwoorden en bijvoeglijke naamwoorden achter voor dynamischere.

| Veelvoorkomend AI-woord | Gehumaniseerd alternatief |

|---|---|

| Bovendien | Daarbovenop / Plus |

| Bijgevolg | Als gevolg daarvan / Dus |

| Cruciaal / Vitaal | Belangrijk / Een must |

| Tot slot | Om af te ronden / Uiteindelijk |

De beste anti-AI-detectortechnieken richten zich op het minder perfect maken van tekst. Menselijk schrijven zit vol eigenaardigheden, enigszins ongebruikelijke woordkeuzes en opzettelijke stilistische afwijkingen. Omarm een beetje imperfectie om echte authenticiteit te bereiken.

Factcheck en voeg kritisch inzicht toe

Ten slotte, vertrouw nooit blindelings de informatie die een AI u geeft. Taalmodellen staan erom bekend te "hallucineren", vol vertrouwen dingen te beweren die volkomen onjuist zijn. De belangrijkste humaniseringsstap is om elke claim, statistiek en datapunt handmatig te verifiëren.

Maar stop niet bij alleen nauwkeurigheid. Ga dieper door uw eigen kritische analyse toe te voegen.

- Vraag de output van de AI in twijfel: Klopt deze conclusie eigenlijk? Is er een ander perspectief om te overwegen?

- Voeg uw eigen analyse toe: Leg uit waarom een bepaald feit belangrijk is of wat de implicaties ervan zijn. Als een AI bijvoorbeeld stelt dat een markt met 10% zal groeien, voeg dan uw analyse toe over welke specifieke segmenten die groei zullen stimuleren.

- Verbind uiteenlopende ideeën: Trek verbindingen tussen punten die de AI te lineair was om te maken.

Deze laag menselijke intelligentie en kritisch denken is uw ultieme verdediging tegen detectie. Het tilt de content van een eenvoudige samenvatting van informatie naar een waardevol, inzichtelijk stuk dat onmiskenbaar van u is.

Het ethische doolhof van AI-humanizers navigeren

De kracht van een anti-AI-detector-tool roept een kritieke vraag op: waar ligt de verantwoordelijkheid? Enerzijds zijn deze tools fantastisch voor het polijsten van concepten en het doorbreken van schrijfblokkades. Anderzijds kunnen ze een kortere weg zijn naar academische oneerlijkheid. Het is cruciaal om een duidelijke grens te trekken.

Zie een AI-humanizer minder als een toverstaf die werk uit het niets creëert en meer als een ongelooflijk geavanceerde spellingchecker. De echte taak is om tekst te polijsten, te verduidelijken en te verheffen die u al heeft geconceptualiseerd en gestructureerd. De kernideeën, argumenten en inzichten moeten bij u beginnen.

AI als lanceerplatform, niet als parachute

De meest verantwoordelijke manier om AI-humanizers te benaderen is door AI-gegenereerde tekst te behandelen als een startpunt – een lanceerplatform voor uw eigen denken. AI is briljant in het uitspuwen van een generiek, fundamenteel concept. Het kan complexe onderwerpen in seconden samenvatten of belangrijke punten schetsen, waardoor u veel tijd bespaart.

Maar die initiële output is slechts ruw materiaal. Uw taak is om erop voort te bouwen, de aannames ervan uit te dagen en uw unieke perspectief en analyse te injecteren.

De ethische grens wordt overschreden op het moment dat de bijdrage van AI uw eigen bijdrage overstijgt. Als het uiteindelijke werk niet uw kritisch denken, persoonlijke stem en intellectuele inspanning weerspiegelt, gebruikt u niet langer een tool – u delegeert uw verantwoordelijkheid.

Deze onderscheiding is alles. Een AI gebruiken om te helpen bij het opstellen van een outline of een lastig concept uit te leggen is gewoon slim. Maar een licht herformuleerde AI-essay als uw eigen inleveren? Dat ondermijnt volledig de academische en professionele integriteit.

De pijlers van verantwoord gebruik

Om aan de juiste kant van de ethische kloof te blijven, houd u aan deze leidende principes. Ze helpen u AI-humanizers te gebruiken om uw werk te verbeteren zonder uw integriteit in gevaar te brengen.

- U bent de auteur: Het uiteindelijke stuk moet een product zijn van uw intellectuele arbeid. AI kan helpen met zinsstructuur en woordkeuze, maar de analyse, bewijsvoering en conclusies moeten van u zijn.

- Oorspronkelijk denken is koning: Gebruik AI om een schrijfblokkade te overwinnen, niet een denkblokkade. Het doel is om uw ideeën effectiever te articuleren, niet om de machine de ideeën voor u te laten hebben.

- Factchecking is niet onderhandelbaar: U bent 100% verantwoordelijk voor de nauwkeurigheid van elke claim in uw werk. AI-modellen kunnen dingen verzinnen en doen dat ook, dus u moet elke statistiek, datum en feit zelf verifiëren.

Een kader voor ethische toepassing

Hoe ziet dit er dus uit in de echte wereld? Laten we een paar scenario's overwegen voor ethisch gebruik van een anti-AI-detector-tool.

Ethisch gebruiksscenario: Een studente gebruikt ChatGPT om een samenvatting te genereren van drie verschillende economische theorieën voor een essay. Ze schrijft vervolgens haar eigen analyse waarin ze ze vergelijkt en contrasteert. Ten slotte gebruikt ze een AI-humanizer om haar proza te verfijnen, zodat het natuurlijk vloeit en menselijk klinkt. Hier diende de AI als onderzoeksassistent, maar het kritische denken was volledig van haar.

Onethisch gebruiksscenario: Een marketeer genereert een hele blogpost met een AI-tool, wisselt een paar woorden uit en laat het door een humanizer lopen om detectoren te omzeilen voordat het als originele content wordt gepubliceerd. Dit is in feite plagiaat, aangezien het intellectuele kernwerk door de machine werd gedaan, niet door de persoon.

Door deze mindset aan te nemen, kunt u deze krachtige tools met vertrouwen gebruiken om een efficiëntere en gepolijstere schrijver te worden, terwijl u uw integriteit intact houdt.

De praktische toepassing: Een anti-AI-detector in actie

Alle theorie is geweldig, maar laten we zien hoe dit in de echte wereld werkt. Dit is waar we van abstracte concepten naar een hands-on blik gaan op hoe een tool een vlakke, AI-gegenereerde paragraaf kan transformeren in iets dat echt menselijk aanvoelt. Het hele proces is gebouwd voor snelheid en eenvoud.

Laten we beginnen met een stuk tekst rechtstreeks van een AI. Het is schoon, grammaticaal correct en brengt het punt over. Maar het is ook een beetje... levenloos. Het heeft dat voorspelbare ritme en veilige woordkeuze die AI-detectoren zijn getraind om van een kilometer afstand te herkennen. Dit is precies het soort schrijven dat wordt gemarkeerd vanwege zijn robotachtige structuur en lage perplexiteit.

Van robotachtig naar realistisch in drie eenvoudige stappen

Met een tool zoals humantext.pro is de workflow ongelooflijk eenvoudig. Het idee is om dat AI-concept te nemen, de technologie zijn machine-achtige kenmerken te laten identificeren en het vervolgens te herschrijven om volledig natuurlijk te klinken – allemaal zonder de kernboodschap te veranderen.

Hier is de uitsplitsing in slechts drie stappen:

- Plakken en analyseren: U begint door uw ruwe AI-tekst rechtstreeks in de tool te plakken. Het voert een snelle scan uit en geeft u meestal een score die aangeeft hoe waarschijnlijk het is dat het door detectoren wordt gemarkeerd.

- Humaniseer met één klik: Dit is de magische knop. U drukt op "Humaniseer" en het algoritme gaat aan het werk. Het wisselt niet alleen woorden uit; het herstructureert zinnen, varieert de woordenschat en past de algehele flow aan om het minder voorspelbaar te maken.

- Beoordelen en gaan: In seconden krijgt u de herschreven versie. De output is klaar voor gebruik, net genoeg aangepast om de subtiele eigenaardigheden en nuances van menselijk schrijven aan te nemen.

Deze afbeelding geeft u een perfecte voor-en-na-momentopname, die laat zien hoe een hoge AI-detectiescore wordt omgedraaid naar een menselijke.

De echte conclusie hier is de dramatische verschuiving in het DNA van de tekst. De gehumaniseerde versie heeft meer variatie in zinslengte en gebruikt minder voorkomende woordcombinaties, waardoor het statistisch bijna identiek is aan iets dat een persoon zou schrijven. Om dieper in de technologie te duiken die dit mogelijk maakt, bekijk onze volledige gids over de AI-contenthumanizer.

Verder dan één tool

De voordelen zijn duidelijk: het is snel, gemakkelijk en het werkt. Dit laat zien hoe deze tools kunnen schuiven in een efficiënt en ethisch schrijfproces. Hoewel we ons hier richten op humanizers, is het vermeldenswaard dat ze deel uitmaken van een veel groter ecosysteem van verschillende AI-contenttools die zijn ontworpen voor allerlei creatieve behoeften.

Door de vervelende delen van het bewerken af te handelen, geeft een AI-humanizer u de tijd terug om u te concentreren op wat echt belangrijk is: de ideeën, de argumenten en de unieke inzichten die alleen een mens kan brengen. Het is een slimme manier om AI-ondersteunde concepten te polijsten tot echt authentiek werk.

Uw vragen over AI-detectoren, beantwoord

De wereld van AI-schrijven en -detectie zit vol grijze gebieden. Als u zich een beetje verloren voelt, bent u niet alleen. Laten we enkele van de meest voorkomende vragen die we horen ophelderen.

Kunnen AI-detectoren ooit 100 procent nauwkeurig zijn?

Absoluut niet. Het is onmogelijk voor een AI-detector om 100% nauwkeurigheid te bereiken. Deze tools zijn gebouwd op waarschijnlijkheden en statistische patronen, niet op definitief bewijs. Ze maken een geïnformeerde gok, niet een definitief oordeel.

Dit betekent dat ze altijd een foutmarge zullen hebben, wat leidt tot zowel fout-positieven (menselijk schrijven als AI markeren) als fout-negatieven (AI-gegenereerde tekst missen). Dingen zoals uw persoonlijke schrijfstijl, de complexiteit van het onderwerp of zelfs het specifieke gebruikte AI-model kunnen een detector misleiden.

Zie een detectiescore als een suggestie, niet als een vonnis. Het is één datapunt dat een menselijke beoordeling vereist, niet een definitief oordeel. Een anti-AI-detector helpt simpelweg het statistische profiel van de tekst te verschuiven om meer te lijken op de patronen die mensen van nature creëren.

Is het onethisch om een anti-AI-detectortool te gebruiken?

De ethiek komt neer op één eenvoudig ding: uw intentie.

Gebruikt u een tool om een AI-ondersteund concept te polijsten, het beter te laten vloeien en meer als u te laten klinken? Dat is gewoon slim bewerken. Het is niet anders dan het gebruik van een geavanceerde grammaticachecker om uw werk te verfijnen.

Maar als uw doel is om 100% AI-gegenereerd werk als uw eigen originele gedachte door te geven – vooral op school of op het werk – heeft u een grens overschreden. De ethische benadering is om AI te gebruiken als medewerker, niet als ghostwriter. U levert de ideeën, u heeft het laatste woord en u neemt de verantwoordelijkheid voor het eindproduct.

Hoe omzeilen AI-humanizers eigenlijk detectie?

AI-humanizers werken door in wezen het detectieproces reverse-engineeren. Ze weten waar detectoren naar zoeken en ontmantelen die patronen systematisch.

Ze beginnen door het ritme van de tekst te verstoren, zinslengte en -structuren te variëren om meer "burstiness" te creëren – die licht onvoorspelbare cadans van menselijk schrijven. Ze wisselen ook veelvoorkomende, hoogwaarschijnlijke AI-woordkeuzes uit voor minder voorspelbare woordenschat, wat de "perplexiteit" van de tekst verlaagt.

Kortom, ze nemen een stuk schrijven dat statistisch te perfect is en introduceren de subtiele, organische chaos die menselijke expressie definieert, allemaal zonder de kernbetekenis te veranderen.

Klaar om uw AI-concepten om te zetten in authentieke, gepolijste content die langs detectoren zeilt? Met humantext.pro kunt u uw tekst met één klik humaniseren, zodat het natuurlijk klinkt en klaar is voor uw publiek. Probeer het nu en zie zelf het verschil.

Klaar om je AI-gegenereerde content om te zetten in natuurlijk, menselijk geschreven tekst? Humantext.pro verfijnt je tekst direct en zorgt ervoor dat deze natuurlijk leest terwijl AI-detectoren worden omzeild. Probeer onze gratis AI-humanizer vandaag →

Gerelateerde Artikelen

AI Writing Assistance: Master Ethical Content Creation

Master AI writing assistance: learn workflows, best practices, & ethical use to create high-quality, human-sounding content that truly works.

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.