Hoe Originality AI te omzeilen en uw content te humaniseren

Leer hoe je Originality AI omzeilt met bewezen technieken. Onze gids toont je hoe je AI-tekst humaniseert om detectie te vermijden en ervoor te zorgen dat je content slaagt.

De meest effectieve manier om met een tool zoals Originality.AI om te gaan, is door je tekst te "humaniseren". Dit betekent dat je een AI-gegenereerd concept neemt en het grondig herschrijft om gevarieerde zinsstructuren te introduceren, uniek vocabulaire op te nemen en je eigen persoonlijke inzichten toe te voegen. Het is een proces van handmatig bewerken voor nuance en flow of, in sommige gevallen, het gebruik van een AI-humanizer tool om de schrijfpatronen automatisch te herwerken die detectoren zijn getraind om te markeren.

De realiteit van gebrekkige AI-detectie

Laten we duidelijk zijn: AI-gegenereerde content is een enorm voordeel voor schrijvers, marketeers en studenten. Maar het komt met een groot nadeel—gebrekkige AI-detectoren. Deze tools zijn ontworpen om machinaal geschreven tekst te herkennen, maar ze eindigen vaak met het straffen van legitiem, AI-ondersteund werk.

Stel je een drukke marketeer voor die een AI-assistent gebruikt om een eerste concept voor een blogpost te maken. Ze besteden uren aan het bewerken ervan, waarbij ze hun eigen expertise en merkstem verweven, alleen om te zien dat het wordt gemarkeerd als 100% AI. Plotseling loopt dat artikel het risico om te worden verlaagd door zoekmachines. Scenario's zoals dit gebeuren elke dag.

Het probleem is dat deze detectoren niet waarheid, kwaliteit of waarde meten. Ze meten patronen. Ze zoeken naar de voorspelbare zinsstructuren en veelvoorkomende woordkeuzes die grote taalmodellen de neiging hebben om te produceren. Dit creëert een frustrerende val waarin zelfs sterk bewerkte, hoogwaardige content een vals positief kan triggeren, waardoor je harde werk in gevaar komt.

Waarom "humanisering" een noodzakelijke vaardigheid is

Deze gids gaat niet over het bevorderen van academische oneerlijkheid of het produceren van spam. Het gaat om een cruciale strategie voor moderne schrijvers: humanisering.

Humanisering is de kunst van het verfijnen van AI-ondersteund schrijven tot hoogwaardige, niet-detecteerbare content die echte menselijke nuances weerspiegelt. Het gaat erom de rauwe efficiëntie van AI te nemen en het te overlagen met de creativiteit, stem en unieke perspectief dat alleen een persoon kan bieden.

Deze aanpak is essentieel voor iedereen die AI-tools verantwoordelijk gebruikt:

- Studenten die AI gebruiken voor brainstormen maar hun eigen definitieve essays schrijven.

- Content creators die vertrouwen op AI voor initiële outlines en onderzoek.

- SEO-specialisten die grote volumes content moeten produceren zonder gestraft te worden.

Focussen op humanisering gaat niet over proberen het systeem te misleiden. Het gaat erom ervoor te zorgen dat het systeem je niet oneerlijk bedriegt om krediet voor je unieke bijdragen en zorgvuldige bewerking.

Verder gaan dan giswerk

Het doel hier is om dit nieuwe landschap effectief te navigeren. Om dat te doen, heb je een praktische, herhaalbare methode nodig om langs Originality.AI en andere detectoren te komen zonder de kwaliteit van je werk te vernietigen. Dit betekent leren hoe deze detectoren denken, waar ze naar zoeken en precies hoe je je tekst bewerkt om hun algoritmische struikeldraden te vermijden.

Deze gids biedt die duidelijke routekaart. We zullen de specifieke mechanica van AI-detectie uitwerken, uitvoerbare handmatige bewerkingstechnieken demonstreren en workflows introduceren die je helpen authentieke, effectieve content te produceren. Zie het als je praktische gids om ervoor te zorgen dat je werk wordt beoordeeld op zijn verdiensten, niet op de tools die je hebt gebruikt om het te maken.

Hoe AI-detectoren eigenlijk werken

Als je langs AI-detectie wilt komen, moet je eerst je tegenstander begrijpen. AI-detectoren zijn geen magie—het zijn gewoon zeer geavanceerde patroonherkenningstools. Ze zijn getraind op enorme bibliotheken van tekst en leren de subtiele, statistische vingerafdrukken te herkennen die machinaal gegenereerd schrijven achterlaat.

Deze tools geven niet om of je schrijven goed of slecht, waar of onwaar is. Ze jagen gewoon op signalen. Om dit te doen, analyseren diensten zoals Originality.ai of GPTZero twee centrale linguïstische kenmerken: perplexiteit en burstiness. Een gevoel krijgen voor deze twee concepten is het verschil tussen blind woorden verwisselen en doelgericht bewerken.

Het voorspelbaarheidsprobleem: Perplexiteit

Perplexiteit is gewoon een chic woord voor hoe voorspelbaar je schrijven is. Je kunt het zien als een "verrassings"-score. Menselijk schrijven is van nature een beetje chaotisch en verrassend. We gebruiken vreemde analogieën, mixen veelvoorkomende woorden met obscure en houden de zaken over het algemeen interessant.

AI-modellen zijn echter gebouwd om het statistisch meest waarschijnlijke volgende woord te kiezen. Dit laat hun output logisch en grammaticaal schoon klinken, maar het is ook ongelooflijk veilig. De woordkeuzes zijn verwacht, wat resulteert in een lage perplexiteitscore—een massief rood vlaggetje voor elke detector.

Praktisch voorbeeld: Een AI kan genereren: "De economische neergang had een aanzienlijk negatief effect op de mondiale financiële markten." Het is technisch perfect maar saai. Een mens zou kunnen schrijven: "De economische duikvlucht stuurde schokgolven door de mondiale markten, waardoor investeerders op zoek gingen naar dekking." De tweede versie is veel minder voorspelbaar en heeft een veel hogere perplexiteit.

Het ritme van schrijven: Burstiness

Burstiness draait allemaal om het ritme en de structuur van je zinnen. Mensen schrijven in uitbarstingen. We volgen een lange, kronkelende zin met een korte, pakkende voor nadruk. Dit creëert een natuurlijke cadans die machines moeilijk kunnen nabootsen.

AI-gegenereerde tekst klinkt daarentegen vaak eentonig. De zinnen zijn meestal van vergelijkbare lengte en structuur, wat een uniforme, robotachtige flow creëert. Dit gebrek aan variatie, of lage burstiness, is nog een duidelijk signaal voor detectiesoftware.

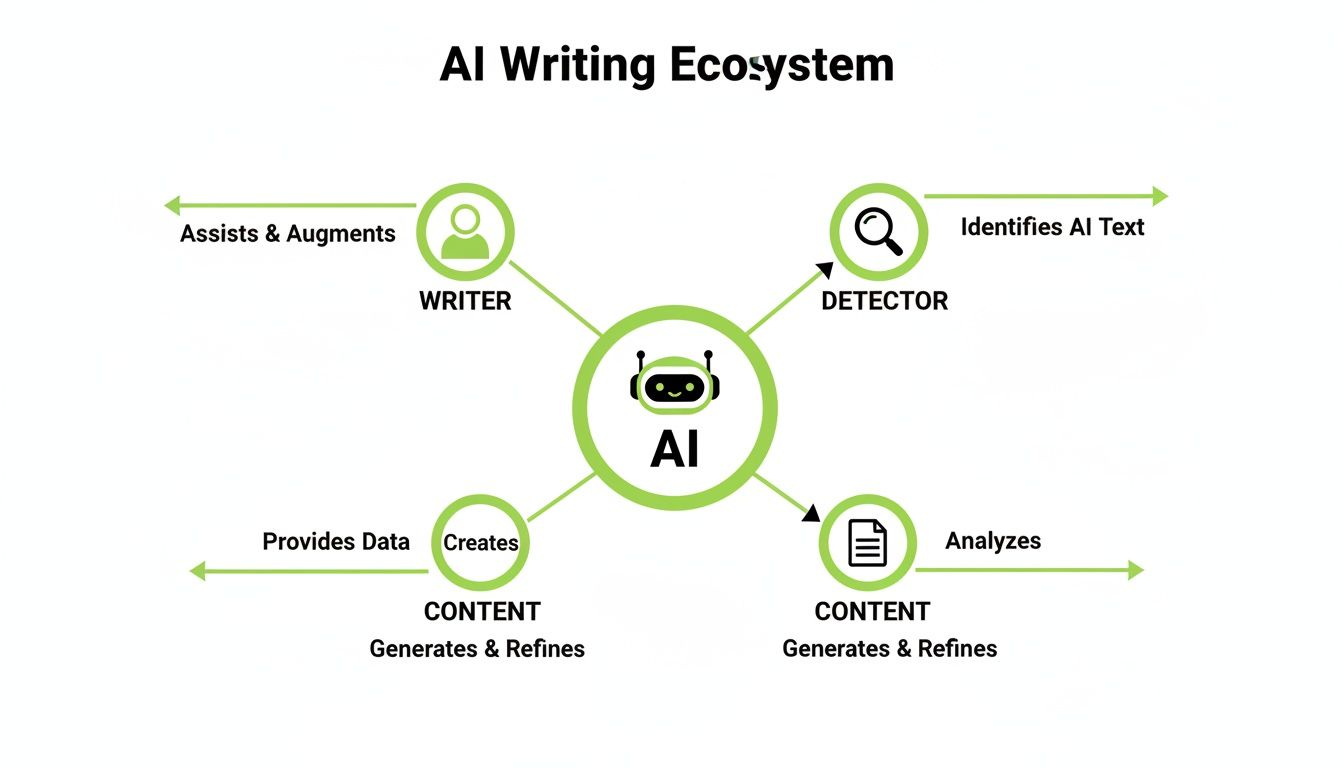

Het diagram hieronder brengt dit hele ecosysteem in kaart en toont hoe AI-schrijvers, menselijke editors en detectietools allemaal interacteren.

Zoals je kunt zien, zijn de patronen in de content centraal in dit hele spel en beïnvloeden ze alles van creatie tot detectie.

Waarom detectoren niet onfeilbaar zijn

Hier is de clou: het begrijpen van deze patronen is je voordeel omdat AI-detectoren notoir onbetrouwbaar zijn. Tussen 2023 en 2025 werden deze tools een hoofdbestanddeel in de academische wereld en publicaties, maar hun nauwkeurigheid is nog steeds een enorm probleem.

In een 2026 benchmark van 30 grote detectoren slaagden slechts twee erin om correct 100% van zowel menselijke als AI-tekst te identificeren. Veel populaire tools vingen slechts 44–56% van AI-content terwijl ze nog steeds echt menselijk schrijven als machinaal gegenereerd markeerden. Deze kloof tussen hun claims en realiteit is wat "Originality AI omzeilen" workflows zo noodzakelijk maakt voor veel schrijvers.

Deze onvolmaaktheid betekent dat zelfs je eigen originele werk, of sterk bewerkte AI-concepten, oneerlijk gemarkeerd kunnen worden. Onderzoeken hoe hiermee om te gaan is cruciaal, en je kunt meer leren door onze gids te bekijken over of niet-detecteerbare AI echt werkt.

Om je te helpen met een duidelijker doel te bewerken, hier is een directe vergelijking van de patronen waar detectoren naar zoeken versus de kenmerken van authentiek menselijk schrijven.

AI-schrijfpatronen vs. menselijke schrijfpatronen

Deze tabel splitst de kernverschillen uit waar AI-detectoren op zijn getraind om te herkennen. Gebruik het als een mentale checklist wanneer je een AI-concept bewerkt.

| Kenmerk | Typische AI-gegenereerde tekst | Authentiek menselijk schrijven |

|---|---|---|

| Perplexiteit | Laag en voorspelbaar. Gebruikt veelvoorkomende, hoogfrequente woorden en zinnen. | Hoog en gevarieerd. Mengt eenvoudig en complex vocabulaire, gebruikt idiomen en creëert verrassing. |

| Burstiness | Laag en uniform. Zinslengtes en -structuren zijn consistent vergelijkbaar. | Hoog en dynamisch. Varieert tussen lange, beschrijvende zinnen en korte, impactvolle. |

| Vocabulaire | Herhaalt vaak specifieke "AI-favoriete" woorden (bijv. "verdiepen", "nauwgezet", "benutten"). | Gebruikt een rijker, diverser vocabulaire, inclusief slang, jargon en persoonlijke anekdotes. |

| Flow & toon | Overdreven formeel, objectief en mist een duidelijke persoonlijke stem of emotie. | Kan conversationeel, overtuigend of emotioneel zijn. Bevat een unieke auteursstem. |

Door je bewerkingen te richten op het transformeren van de AI-patronen in de middelste kolom naar de menselijke patronen rechts, ga je van simpel parafraseren naar echte humanisering. Je verandert niet alleen woorden; je verandert fundamenteel de statistische basis van de tekst.

Je handen vuil maken: Handmatige bewerkingen om AI-content te humaniseren

Weten waar AI-detectoren naar zoeken is één ding. Echt je mouwen opstropen om die patronen te ontmantelen is waar het echte werk begint. Zo transformeer je robotachtige, voorspelbare tekst in iets met een echte menselijke hartslag.

We gaan verder dan generiek advies zoals "voeg je persoonlijke stem toe". In plaats daarvan richten we ons op herhaalbare, tactische methoden die je nu kunt gebruiken om je content onzichtbaar te maken voor platforms zoals Originality AI.

Het beheersen van deze hands-on vaardigheden geeft je totale controle over het definitieve concept. Je kunt de kernboodschap behouden terwijl je de onderliggende structuur die detectie triggert volledig verandert, zodat je AI-ondersteund werk nooit oneerlijk wordt gestraft.

Beheers zinfusie en -splitsing

Een van de snelste manieren om "burstiness" te verbeteren—die natuurlijke variatie in zinslengte—is een techniek die ik zinfusie en -splitsing noem. Het is een eenvoudig idee: vind alinea's waar alle zinnen ongeveer dezelfde lengte hebben en begin dingen te mixen.

AI houdt van een gestaag ritme van middelgrote, stellende zinnen. Jouw taak is om dat ritme te doorbreken.

- Fusie (zinnen combineren): Zoek naar korte, gerelateerde zinnen. Voeg ze samen met voegwoorden (en, maar, dus), puntkomma's of door er één om te zetten in een bijzin.

- Splitsing (zinnen splitsen): Vind die lange, complexe zinnen en hak ze in twee of meer kortere, pakkende uitspraken voor impact.

Zo ziet dat er in de praktijk uit:

AI-gegenereerde tekst:

Het bedrijf lanceerde een nieuwe marketingcampagne. De campagne was bedoeld om merkbekendheid te vergroten. Het richtte zich op een jongere doelgroep met social media-advertenties. De resultaten van de campagne waren succesvol.

Gehumaniseerd met fusie & splitsing:

Met als doel de merkbekendheid te vergroten, lanceerde het bedrijf een nieuwe marketingcampagne. Het bleek een succes, gericht op een jongere doelgroep met social media-advertenties.

Zie je hoe we vier hakkende zinnen in twee dynamischere hebben gecombineerd? Die eenvoudige bewerking laat de tekst onmiddellijk minder robotachtig aanvoelen en verbetert de flow.

Voer een actieve stem-overhaul uit

AI-modellen leunen vaak op de passieve stem omdat het formeel en objectief klinkt. Het probleem? Het laat schrijven ook zwak, afstandelijk en academisch aanvoelen. Een actieve stem-overhaul is je kans om die passieve constructies op te sporen en ze om te draaien naar iets directer en boeiender.

De truc is om zinnen te vinden waar het onderwerp wordt behandeld, in plaats van de actie uit te voeren. Let op zinnen zoals "werd gedaan door" of "wordt beschouwd als".

Passief AI-voorbeeld:

Het rapport werd geschreven door het onderzoeksteam, en de bevindingen werden gepresenteerd door de projectmanager.

Actieve stem-overhaul:

Het onderzoeksteam schreef het rapport, en de projectmanager presenteerde de bevindingen.

Deze kleine verschuiving laat het schrijven zelfverzekerder aanvoelen en is veel gemakkelijker voor een lezer om te volgen. Het vervangt de stijve toon die gebruikelijk is in AI-concepten door een directere, menselijkere stijl. Voor een dieper inzicht, bekijk onze volledige gids over hoe je AI-gegenereerde tekst humaniseert.

Weef idiomen en analogieën in

AI-gegenereerde tekst is bijna altijd pijnlijk letterlijk. Het vermijdt beeldspraak, idiomen en analogieën omdat ze lastig correct te gebruiken zijn. Voor een menselijke editor is dit een gouden kans.

Een paar cultureel relevante idiomen of een slimme analogie strooien is een fantastische manier om persoonlijkheid in te brengen en de "perplexiteit" van de tekst te verhogen—zijn onvoorspelbaarheid. Een AI zou nooit met een zin zoals "het is geen rocket science" of "laten we er niet omheen draaien" komen.

Uitvoerbaar voorbeeld: In plaats van dat de AI zegt "De taak was erg moeilijk", zou je kunnen schrijven "Die server weer online krijgen was als proberen pudding tegen de muur te spijkeren." Dit creëert een gedenkwaardig mentaal beeld en voegt een laag originaliteit toe die detectoren gewoon niet zijn getraind om te verwachten.

Een woord van waarschuwing: overdrijf het niet. Te veel idiomen kunnen je schrijven kazig laten klinken. Maar één of twee goed geplaatste zinnen per sectie kunnen ongelooflijk effectief zijn.

Vereenvoudig en specificeer je taal

AI heeft een slechte gewoonte om overdreven formele woorden te gebruiken wanneer een eenvoudiger woord zou volstaan. Het zal "benutten" zeggen in plaats van "gebruiken", of "aanvangen" in plaats van "beginnen". Het houdt ook van vage algemeenheden.

De vereenvoudigen en specificeren methode heeft twee delen:

- Vereenvoudigen: Spoor onnodig complexe woorden op en wissel ze voor hun eenvoudigere, meer voorkomende synoniemen.

- Specificeren: Vervang vage verklaringen door concrete details, harde cijfers of specifieke voorbeelden.

AI's vage taal:

De nieuwe software biedt een veelheid aan voordelen voor bedrijven, waardoor de operationele efficiëntie aanzienlijk wordt verbeterd.

Vereenvoudigde & gespecificeerde tekst:

De nieuwe software helpt bedrijven projectlevertijden met wel 30% te verkorten. Het automatiseert dagelijkse urenbriefjes en markeert budgetoverschrijdingen in real-time.

Door "veelheid aan voordelen" te vervangen door een specifieke statistiek (30%) en precies uit te leggen hoe het de efficiëntie verbetert, maak je de tekst geloofwaardiger, waardevoller en menselijker. Wanneer je deze handmatige technieken combineert, creëer je een gelaagde verdediging tegen detectie en transformeer je een generiek AI-concept in een gepolijst, authentiek stuk content.

AI-humanizers gebruiken voor snelheid en schaal

Handmatig bewerken is de gouden standaard voor het verfijnen van een AI-concept, maar laten we eerlijk zijn—het kost veel tijd. Wanneer je een strakke deadline hebt of een berg content moet verwerken, is het gewoon niet praktisch om uren te besteden aan het masseren van elke zin.

Dit is precies waar AI-humanizer tools binnenkomen. Ze overbruggen perfect de kloof tussen een rauw AI-concept en gepolijste, menselijk klinkende content die klaar is om te publiceren.

Voor iedereen die content in bulk maakt, zijn deze tools een levensredder. Stel je een content marketeer voor die vijf solide SEO-blogposts op één dag moet maken. Elk handmatig herschrijven zou een nachtmerrie zijn. Een moderne, versnelde workflow is de enige manier om het te klaren.

Deze aanpak stelt je in staat het tempo bij te houden zonder de subtiele touches op te offeren die nodig zijn om Originality AI te omzeilen en andere geavanceerde detectoren. Het is een slimme strategie voor iedereen die zelfverzekerd en snel moet publiceren.

De moderne humanizer workflow

Een efficiënte workflow met een humanizer is verrassend eenvoudig. Het kan een meerdere uren durende bewerkingssleur veranderen in een taak die slechts een paar minuten duurt.

Hier is een praktisch stapsgewijs voorbeeld:

- Haal je eerste concept op: Begin met het laten genereren van een solide concept op basis van je outline en onderzoek door een LLM zoals ChatGPT of Claude. Laten we zeggen dat je een productbeschrijving schrijft.

- Plak en analyseer: Kopieer de volledige AI-gegenereerde beschrijving en plak deze in een humanizer tool. Het AI-concept zou kunnen zeggen: "Ons nieuwe CRM is een robuuste oplossing ontworpen om klantinteracties te optimaliseren en verkoopprocessen te stroomlijnen."

- Humaniseer de tekst: Met één klik gaat de tool aan het werk om de content te herschrijven. Het zou kunnen produceren: "Moe van het jongleren met klant-e-mails en verkoopnotities? Ons nieuwe CRM vereenvoudigt alles, zodat je je kunt concentreren op het opbouwen van relaties en sneller deals sluiten."

- Snelle review: De laatste stap is een snelle controle door jou. Controleer of de nieuwe tekst aansluit bij de stem van je merk en voeg eventuele definitieve persoonlijke touches toe. Het hele proces duurt minder dan een minuut.

Dit proces is een enorme versneller. Het bevrijdt je om je te concentreren op strategie op groot niveau en definitieve afwerking in plaats van vast te lopen in vervelende bewerkingen op zinsniveau.

De echte magie van een AI-humanizer is zijn vermogen om menselijke schrijfpatronen automatisch na te bootsen. Het varieert intelligent de zinslengte, diversifieert woordkeuze en past het ritme aan om de voorspelbare, robotachtige kenmerken te wissen die AI-detectoren zijn getraind om te herkennen.

Het is meer dan alleen parafraseren

Het is echt belangrijk om te begrijpen dat een goede humanizer veel meer doet dan een basis parafraseringstool. Een eenvoudige parafraser verwisselt alleen woorden voor synoniemen, wat vaak resulteert in onhandige, onnatuurlijke formuleringen.

Een echte humanizer daarentegen analyseert de tekst op een veel dieper niveau. Als je nieuwsgierig bent naar de mechanica, kun je dieper ingaan op hoe een AI-humanizer tool eigenlijk werkt.

Deze platforms zijn getraind op enorme datasets van echt menselijk schrijven, dus ze begrijpen de nuances van stijl, toon en ritme. Ze passen specifiek de perplexiteit en burstiness van de tekst aan—precies de metrieken die AI-detectoren gebruiken voor hun analyse. Het resultaat is content die de oorspronkelijke betekenis behoudt maar statistisch niet te onderscheiden is van iets dat een persoon vanaf nul heeft geschreven.

Dit is ongelooflijk nuttig voor elke taak die een snelle doorlooptijd vereist zonder authenticiteit op te offeren. Als je bijvoorbeeld AI-aangedreven LinkedIn post generators gebruikt, kan het door een humanizer laten lopen van de output de laatste stap zijn om ervoor te zorgen dat de posts echt persoonlijk en boeiend klinken, niet formulerend. Door deze tools onderdeel te maken van je workflow, kun je je content output opschalen zonder rode vlaggen te hijsen.

Hoe te controleren of je humanisatie-inspanningen echt werkten

Dus je hebt tijd besteed aan het zorgvuldig bewerken van je AI-concept, of misschien heb je het door een humanizer tool laten lopen. Hoe weet je of je echt bent geslaagd? Je hebt bewijs nodig.

Gewoon je vingers kruisen en hopen dat je content zal slagen is een enorm risico. Een nog grotere fout die ik mensen zie maken is vertrouwen op één enkele AI-detector voor het definitieve oordeel. Dat is een recept voor ramp.

Verschillende detectoren gebruiken enigszins verschillende algoritmes en trainingsdata. Dit betekent dat één tool je groen licht zou kunnen geven terwijl een andere je werk markeert als 100% AI-gegenereerd. Om detectoren zoals Originality.ai zelfverzekerd te omzeilen, heb je een veel slimmere, data-gedreven aanpak nodig. De enige echte oplossing is een multi-checker teststrategie.

Dit proces neemt de angst en giswerk uit de vergelijking. Het geeft je harde data om te bevestigen dat je humanisatie-inspanningen hebben geloond voordat je publiceert of je opdracht inlevert.

Je testparcours bouwen

Het kernidee is eenvoudig: vertrouw niet al je vertrouwen aan één mening. Laat in plaats daarvan je definitieve, gepolijste tekst door een klein parcours van minstens drie gerenommeerde en verschillende AI-checkers lopen. Deze triangulatiemethod geeft je een veel betrouwbaarder beeld van hoe verschillende systemen je content zullen waarnemen.

Hier is een solide startopstelling voor je testparcours:

- Originality.ai: Je moet testen tegen de tool die je specifiek probeert te omzeilen. De analyse staat bekend als strenger, dus hier slagen is een zeer sterk signaal.

- GPTZero: Dit is een populaire en veel gebruikte detector, vooral in academische kringen. Het geeft je een goede basislijn voor algemene detectiecapaciteiten.

- ZeroGPT: Een andere gratis en gemakkelijk te gebruiken optie die een nuttig derde datapunt biedt om je andere resultaten te bevestigen of te bevragen.

Door deze tools kruislings te raadplegen, bescherm je jezelf tegen de eigenaardigheden en potentiële valse positieven van elk afzonderlijk platform. Zie het als het krijgen van een tweede medische mening—je wilt de diagnose bevestigen voordat je handelt.

Hoe je testresultaten te lezen

Zodra je je scores hebt, wat betekenen ze eigenlijk? Het is vrij zeldzaam om identieke resultaten over de hele linie te krijgen. Je zult bijna zeker enige variatie zien, en leren hoe je deze soms tegenstrijdige scores moet interpreteren is de echte sleutel.

Uitvoerbaar inzicht: Het doel is niet noodzakelijk een perfecte 0% AI-score overal, hoewel dat natuurlijk ideaal is. Het echte doel is om consistent onder een lage-risico drempel te vallen over alle detectoren die je gebruikt. Een veilig doel is om een score onder 10% AI-waarschijnlijkheid op elk afzonderlijk platform te krijgen.

Als twee van de drie checkers je een zeer lage AI-score geven (zoals onder 10%) terwijl één het iets hoger markeert (zeg 30-40%), ben je waarschijnlijk in een veilige zone.

Als echter zelfs één tool je content markeert als 80% of 90% AI, is dat een grote rode vlag. Het betekent dat een significant patroon werd gedetecteerd, en je moet absoluut terug naar dat deel van je tekst voor nog een bewerkingsronde.

In het streven om AI-content niet-detecteerbaar te maken, gebruiken sommige mensen ook een gespecialiseerde AI-bypasser tool ontworpen om tekst specifiek te herschrijven om deze systemen te omzeilen. Ongeacht welke methode je gebruikt, is deze multi-check validatie de laatste, essentiële stap om ervoor te zorgen dat je workflow effectief is en je content echt klaar is.

Op het ethische koord van AI-schrijven wandelen

Het gebruik van tools om een AI-concept te humaniseren loopt een dunne lijn tussen slimme efficiëntie en regelrechte fraude. Precies weten waar die lijn wordt getrokken is de sleutel tot het beschermen van je academische of professionele reputatie. Het echte verschil komt neer op je intentie en wie echt eigenaar is van het definitieve werk.

Het is één ding om AI te gebruiken als assistent om ideeën te brainstormen, writers block te doorbreken of een ruw eerste concept te schetsen. In dat scenario is AI gewoon een tool, niet anders dan een thesaurus of een grammaticachecker. Het definitieve stuk is nog steeds fundamenteel van jou—gevormd door jouw inzichten, kritisch denken en zware bewerking.

Academische integriteit en professionele standaarden

De lijn wordt overschreden wanneer je AI gebruikt om een compleet stuk werk te genereren en het dan als je eigen presenteert. Dat is gewoon een hightech vorm van plagiaat, simpel gezegd.

Elke universiteit heeft een strikte erecode, en elke uitgever heeft contentrichtlijnen. Het schenden ervan kan ernstige gevolgen hebben, van een onvoldoende tot ontslag of juridische problemen.

Voordat je een AI-tool gebruikt voor een beoordeelde opdracht of een professionele publicatie, moet je absoluut:

- Controleer het beleid van je instelling: Veel universiteiten hebben nu specifieke regels voor AI. Beweren dat je het niet wist zal je niet redden.

- Begrijp de richtlijnen van de uitgever: Gerenommeerde publicaties eisen vaak dat je AI-assistentie openbaart en zullen content afwijzen die niet substantieel origineel is.

- Prioriteer je eigen stem: Het definitieve werk moet jouw gedachten en analytische vaardigheden weerspiegelen. Als je niet zou kunnen opstaan en de ideeën als je eigen zou kunnen verdedigen, ben je te ver gegaan.

Verantwoord gebruik vs. regelrechte misbruik

Het doel van "humaniseren" zou moeten zijn om ervoor te zorgen dat je echt verfijnd, AI-ondersteund werk niet oneerlijk wordt gemarkeerd door gebrekkige detectoren. Het gaat erom krediet te krijgen voor je eigen intellectuele arbeid, niet over iemand misleiden om te denken dat het werk van een machine van jou is.

Wanneer je AI verantwoordelijk gebruikt, ben jij de auteur; de AI is gewoon de co-piloot.

Praktisch inzicht: Deze ethische puzzel zit in het hart van ons huidige tech-moment. De focus moet altijd liggen op het gebruik van AI om menselijke creativiteit en intellect te verbeteren, niet om persoonlijke integriteit en verantwoordelijkheid te omzeilen.

Globale statistieken over AI-misbruik laten zien dat detectie- en bypass-tools in een constante wapenwedloop zitten. Hoewel detectoren nodig zijn om misbruik in te dammen, kan hun gokwerk-natuur het eerlijke gebruik van tools zoals ChatGPT onterecht straffen. Dit is waar diensten zoals humantext.pro binnenkomen—ze richten zich op het verbeteren van de leesbaarheid van de tekst en het behouden van je oorspronkelijke intentie, niet alleen ruw manipuleren van woorden om een machine te misleiden. Dit helpt je aan de juiste kant van institutionele beleidsregels te blijven.

Je kunt meer inzichten vinden over de alarmerende groei van AI-gedreven fraude op sumsub.com.

Uiteindelijk ligt de verantwoordelijkheid bij jou. Gebruik AI om je capaciteiten te vergroten, fact-check elke claim en injiceer elk stuk met je unieke perspectief. Dat is de enige ethische—en duurzame—weg vooruit.

Veelgestelde vragen over AI-detectie

Navigeren in de wereld van AI-content en detectie kan aanvoelen als door een mijnenveld lopen. Laten we enkele van de meest voorkomende vragen ophelderen die mensen hebben wanneer ze proberen hun werk langs tools zoals Originality AI te krijgen.

Zijn AI-detectoren zoals Originality AI ooit 100% nauwkeurig?

Absoluut niet. AI-detectoren zijn niet, en waren nooit ontworpen om 100% onfeilbaar te zijn. Onafhankelijke tests hebben consistent aangetoond dat ze enkele ernstige beperkingen hebben.

Deze tools kunnen en markeren vaak volledig menselijk geschreven content als AI-gegenereerd. Dit wordt een vals positief genoemd en is een enorm probleem. Aan de andere kant kunnen ze ook machinaal geschreven tekst missen, vooral als het is bewerkt. De nauwkeurigheid slingert wild, afhankelijk van het AI-model dat de tekst schreef en hoeveel een mens het heeft verfijnd. Dit is precies waarom je nooit de score van één enkele detector als het definitieve oordeel moet vertrouwen.

Is het onethisch om AI-detectie te omzeilen?

Dit is de grote vraag, en het antwoord komt neer op één ding: intentie. De ethiek van het omzeilen van AI-detectie hangt volledig af van waarom je het doet en de regels waar je naar speelt.

Als je een volledig essay met AI genereert en je naam erop plakt, het inleveren als je eigen originele gedachte—dat is glashelder academische oneerlijkheid. Geen grijs gebied daar.

Maar wat als je AI gebruikt als medewerker? Voor brainstormen, outlines of het krijgen van een ruw eerste concept op de pagina, dat je vervolgens substantieel herschrijft met je eigen ideeën, analyse en stem? Dat is een legitieme en steeds gebruikelijkere workflow voor professionals overal.

Uitvoerbaar advies: De gouden regel is eenvoudig: volg de specifieke richtlijnen van je instelling of uitgever. Humanisatietools zijn bedoeld om ervoor te zorgen dat je definitieve, menselijk verfijnde werk niet oneerlijk wordt gestraft door een gebrekkige detector, niet om je te helpen vals te spelen.

Wat is de beste manier om AI-tekst niet-detecteerbaar te maken?

Er is geen wondermiddel, en een gelaagde aanpak is altijd je beste weddenschap. Maar als ik de meest krachtige techniek zou moeten kiezen, is het dit: varieer je zinsstructuur en -lengte.

AI-modellen hebben de neiging om in een monotoon, voorspelbaar ritme te vallen. Ze produceren zinnen die allemaal ongeveer dezelfde lengte en structuur hebben, wat robotachtig aanvoelt.

Door bewust die lange, kronkelende zinnen op te breken en korte, pakkende te combineren, introduceer je een dynamischere, natuurlijkere flow. Deze variatie is wat experts "burstiness" noemen, en het is een belangrijk signaal waar AI-detectoren naar zoeken. Beheers deze ene vaardigheid, en je bent goed op weg om de patronen te verstoren die deze tools zijn getraind om te herkennen.

Klaar om te zien hoe gemakkelijk het is om je AI-ondersteunde content te polijsten? humantext.pro kan een robotachtig concept in natuurlijke, menselijk klinkende tekst in seconden transformeren. Probeer onze AI-humanizer gratis en zie het verschil zelf.

Klaar om je AI-gegenereerde content om te zetten in natuurlijk, menselijk geschreven tekst? Humantext.pro verfijnt je tekst direct en zorgt ervoor dat deze natuurlijk leest terwijl AI-detectoren worden omzeild. Probeer onze gratis AI-humanizer vandaag →

Gerelateerde Artikelen

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.