AI-humaniserer uten ordgrense: En praktisk guide til humanisering av langt innhold

AI-humaniserer uten ordgrense: Lær praktiske arbeidsflyter for å forvandle langt innhold til engasjerende, menneskelignende prosa uten begrensninger.

La oss være ærlige: en ekte AI-humaniserer uten ordgrense er litt av en myte. Du kommer ikke til å finne en magisk knapp som feilfritt humaniserer et 100 000 ord langt manuskript i ett stykke. De fleste verktøy har tegn- eller ordtak som tvinger deg til å mate inn avhandlingen eller e-boken din i små, frustrerende biter.

Håndtere storskala innholdshumanisering

Enten du er en masterstudent som sliter med en avhandling på 10 000 ord, en SEO-spesialist som sjonglerer et dusin artikler, eller en forsker som skriver en tett akademisk rapport — problemet er alltid det samme. Du sitter på et fjell av AI-generert tekst som må høres genuint menneskelig ut — ikke bare for å unngå dagens stadig smartere AI-detektorer, men for å faktisk nå frem til leserne dine.

Den vanlige kopier-og-lim-rutinen, med å klippe ut 300 eller 500 ord om gangen, er mer enn bare kjedelig. Det er en produktivitetsdøder. Denne manuelle slitingen inviterer til feil, ødelegger tonen din og brenner gjennom timer du burde brukt på strategi og finjustering. For alle som lager innhold i stor skala er det en betydelig flaskehals.

Når du jobber med langt innhold, strekker utfordringene seg langt utover enkle ordtellinger. Den virkelige kampen handler om å bevare verkets integritet fra begynnelse til slutt.

Utfordringer med å humanisere langt AI-innhold

| Utfordring | Innvirkning på arbeidet ditt | Strategisk løsning |

|---|---|---|

| Tap av kontekst | Verktøyet bommer på det overordnede narrativet, noe som fører til generiske eller irrelevante omskrivninger. | Behandle innhold i logiske, selvstendige seksjoner (f.eks. kapitler, hovedargumenter) for å gi tilstrekkelig kontekst. |

| Narrativ fragmentering | Flyten mellom avsnitt bryter sammen og skaper en usammenhengende og hakkete leseopplevelse. | Overlapp bitene dine litt og gjennomgå overganger manuelt for å sikre en jevn, sammenhengende flyt. |

| Tonal inkonsistens | Dokumentet ditt ender opp med å høres ut som om det ble skrevet av en komité, med skiftende toner og stiler. | Etabler en tydelig stilguide eller referansetone for humanisereren og rediger manuelt for konsistens etter behandling. |

| Ekstrem tidsineffektivitet | Det manuelle arbeidet med å dele opp og sette sammen tekst gjør hele poenget med å bruke AI for hastighet meningsløst. | Adopter en systematisk "chunking-metode" som effektiviserer oppdeling- og sammensettingsprosessen og gjør den til en forutsigbar arbeidsflyt. |

Disse hindringene viser hvorfor et enkelt verktøy ikke er nok — du trenger en smartere prosess.

Hvorfor standardverktøy kommer til kort

De fleste AI-humaniserere er designet for raske oppgaver: e-poster, bildetekster for sosiale medier eller korte avsnitt. Behandlingsgrensene deres er en praktisk realitet knyttet til serverkostnader og den enorme kompleksiteten ved å skrive om tekst mens kjernebudskapet bevares.

Når du prøver å tvinge et stort dokument gjennom disse verktøyene, blir begrensningene smertelig tydelige:

- Kontekstblindhet: Et verktøy som bare ser en liten del av arbeidet ditt kan ikke gripe de narrative trådene, argumentene eller spesialiserte begrepene du har etablert. Det er som å be noen beskrive en film etter å bare ha sett et 30 sekunders klipp.

- Brutt flyt: Å behandle kapittel for kapittel knuser ofte de logiske broene mellom ideer. Du sitter igjen med en samling avsnitt som ikke helt snakker med hverandre, noe som tvinger leseren til å jobbe altfor hardt.

- Den manuelle arbeidsfellen: Innsatsen det krever å klippe opp, behandle og sy sammen et stort dokument igjen er enorm. Det undergraver fullstendig effektiviteten AI skal gi i utgangspunktet.

Den virkelige utfordringen handler ikke bare om å bestå en detektor — det handler om å bevare sjelen og sammenhengen i et langt stykke. Et dokument som scorer 100 % menneskelig men leser som et rotete kaos er en total fiasko.

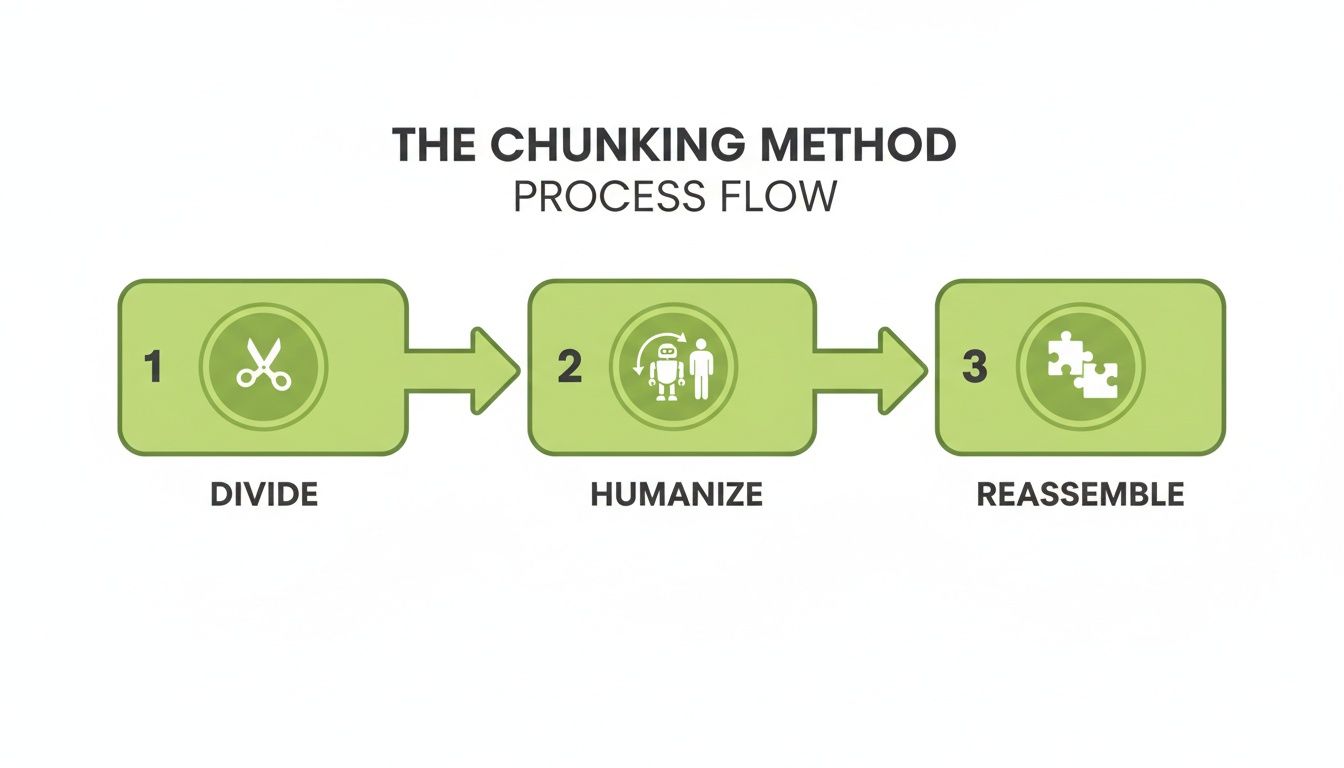

Det er her en strategisk arbeidsflyt utgjør hele forskjellen. I stedet for å jakte på en mytisk AI-humaniserer uten ordgrense er den virkelige løsningen å være metodisk. Den mest effektive strategien jeg har funnet er "chunking-metoden" — et system for intelligent oppdeling, humanisering og sammensetting av store dokumenter for å opprettholde kvaliteten. Det forvandler en overveldende oppgave til en håndterbar, repeterbar prosess.

For en dypere gjennomgang av ulike verktøy og deres styrker, sjekk ut guiden vår om de beste AI-humanisererne tilgjengelig for ulike typer innhold.

Chunking-metoden for feilfri humanisering

Så du stirrer ned et massivt dokument — en avhandling, en e-bok, kanskje en pilarsside som er tusenvis av ord lang. Å prøve å humanisere hele greia på en gang er som å prøve å koke havet. Det er ineffektivt og bryter ofte verktøyet du bruker.

I stedet trenger du en smartere tilnærming. Vi kaller det chunking-metoden. Det handler rett og slett om å bryte ned det fjellet av tekst i håndterbare, logiske biter.

Tenk på det som en arkitekt som planlegger en bygning, ikke et rivningsteam som tilfeldig slår ned vegger. Du vil dele opp dokumentet ditt langs de naturlige strukturelle linjene for å bevare kontekst og flyt.

Her er en praktisk gjennomgang av hvordan du velger bitene dine:

- For en forskningsrapport: Jeg deler den opp etter kjerneseksjonene — Innledning, Litteraturgjennomgang, Metode, Resultater og Konklusjon. Hver del er et selvstendig argument, perfekt for å behandle én om gangen.

- For et langt blogginnlegg: H2-underoverskriftene er dine beste venner. De signaliserer allerede et temaskifte, noe som gjør dem til de mest naturlige bruddpunktene.

- For en e-bok eller roman: Denne er enkel. Bruk kapitlene. Hvert kapittel har sin egen lille fortellerbue, så det er den ideelle enheten å mate inn i en humaniserer.

Denne strategien sikrer at når du behandler en bit, har AI-en nok omgivende tekst til å forstå det spesifikke poenget du gjør i den seksjonen, noe som fører til mye bedre og mer relevante resultater.

Finne den optimale bitstørrelsen

Den perfekte bitstørrelsen er en balansegang. Du trenger nok tekst til å bevare den narrative integriteten, men ikke så mye at du overvelder verktøyet.

De fleste humaniserere, inkludert HumanText.pro, tilbyr en sjenerøs gratis prøvegrense på vanligvis rundt 500 ord. Etter min erfaring er dette det optimale. Det er stort nok til å dekke en komplett idé eller noen detaljerte avsnitt uten å miste tråden i argumentet.

Slik ser et standard humaniseringsverktøys grensesnitt ut — du limer rett og slett inn en av bitene dine i inndatafeltet.

Den rene, enkle layouten er avgjørende. Når du behandler dusinvis av biter, er det siste du vil ha en komplisert arbeidsflyt.

Sette sammen det humaniserte innholdet igjen

Når alle bitene dine er behandlet, er det tid for sammensetting. Og nei, dette er ikke bare en kopier-og-lim-jobb. Her tar du på deg redaktørhatten og jevner ut sømmene der de ulike delene møtes.

Fokuser på å skape sømløse overganger. Noen ganger kan en humaniserer avslutte en bit med en fin, avsluttende setning, men neste bit skal fortsette den samme tanken. Da må du hoppe inn og manuelt justere setningene for å bygge bro over gapet.

Praktisk eksempel:

- Opprinnelig overgang (klønete): "...og det er derfor solcellepaneler er effektive." [Slutt på bit 1] "Geotermisk energi tilbyr nok et bærekraftig alternativ." [Start på bit 2]

- Forbedret overgang (jevn): "...og det er derfor solcellepaneler er effektive." [Slutt på bit 1] "Selv om solenergi er et populært valg, tilbyr geotermisk energi nok et bærekraftig alternativ." [Start på bit 2]

Proffstips: Les hele det sammensatte dokumentet høyt fra begynnelse til slutt. Det er den aller beste måten å fange opp ubekvemme skift i tone eller stil som kan ha sneket seg inn mellom bitene. Målet ditt er en enhetlig stemme som føles helt bevisst.

Å få en følelse for ordtellinger er en stor del av å optimalisere denne prosessen. Lær mer i guiden vår om hvor langt 500 ord egentlig er. Det er en virkelig game changer for å mestre chunking-strategien din.

La oss bli praktiske. Hvordan fungerer dette egentlig?

Se for deg at du har en tett artikkel på 3 000 ord som en AI har spyttet ut om bærekraftig byplanlegging. Fakta er der, men den er en søvndyssende affære — stiv, robotaktig og skriker "AI" til hver eneste detektor på markedet. Oppdraget vårt er å forvandle den til noe engasjerende og, viktigst av alt, menneskelig.

Første trekk er enkelt: del den opp. Jeg ville brutt den 3 000 ord lange kolossen ned i seks håndterbare deler på 500 ord hver. Trikset er å gjøre logiske kutt. Jeg pleier å dele artikler rett ved H2-underoverskriftene. Det bevarer kjerneargumentet i hver seksjon og forhindrer at humanisereren mister konteksten og roter til ideene dine.

Behandling og kvalitetskontroller

Med mine seks biter klare starter det virkelige arbeidet. Jeg tar den første 500-ords seksjonen, limer den inn i HumanText.pro-grensesnittet og klikker "Humanize". Det tar bare noen sekunder.

Men før jeg hopper til neste bit, gjør jeg en rask kvalitetskontroll av resultatet. Dette er et ikke-forhandlingsbart steg for meg.

Her er min mini-sjekkliste for hver del:

- Budskapets integritet: Bevarte omskrivningen de opprinnelige faktaene og argumentene? Hvis originalteksten for eksempel sa "en reduksjon på 25 % i utslipp", kan den humaniserte teksten ikke bare si "en betydelig reduksjon".

- Tonal konsistens: Høres den nye teksten fortsatt profesjonell og informativ ut? Målet er å få den til å høres bedre ut, ikke som om den ble skrevet av en helt annen person.

Jeg gjentar rett og slett denne prosessen for alle seks biter og lagrer hvert humanisert resultat i et nytt dokument. Det er en metodisk tilnærming, men den garanterer at hver del får oppmerksomheten den trenger før den endelige sammensettingen.

Hele denne arbeidsflyten — del opp, humaniser, sett sammen — er nøkkelen til å håndtere langt innhold effektivt.

Å bryte en stor oppgave ned i mindre, kontrollerte steg som dette er hvordan du opprettholder kvalitetskontroll og ender opp med et polert, sømløst sluttresultat.

Sammensetting og endelig polering

Når alle bitene er humanisert, er det tid for å sy dem sammen igjen. Jeg setter sammen seksjonene i sin opprinnelige rekkefølge. Denne delen er mer enn en enkel kopier-og-lim-jobb — jeg leter etter sømmene mellom bitene og jevner ut ubekvemme overganger for å sikre at fortellingen flyter naturlig.

Deretter kjører jeg hele artikkelen på 3 000 ord gjennom en AI-detektor. Jeg trenger å se en høy menneskelig score for hele dokumentet, ikke bare i isolerte deler.

Men det mest kritiske siste steget er en enkel menneskelig gjennomlesning. Jeg leser alltid hele artikkelen høyt. Det er den beste måten å fange rare fraser eller skurrende setninger som programvare kan overse. Det er poleringen som skiller godt innhold fra virkelig fantastisk innhold.

Denne sluttkontrollen er essensiell. De beste verktøyene har tross alt en deteksjonsnøyaktighet som varierer mellom 65-90 %, så den menneskelige verifiseringen er ditt ultimate sikkerhetsnett. Det sikrer at innholdet ikke bare består en skanning, men faktisk når frem til en ekte person.

Hvis du håndterer mye innhold, er det en selvfølge å oppgradere til en betalt HumanText.pro-plan. Det fjerner ordgrensene og gjør hele arbeidsflyten raskere og mer effektiv. For flere tips, sjekk ut guiden vår om hvordan en https://humantext.pro/blog/chat-gpt-humanizer kan løfte prosessen din. Du kan også integrere denne arbeidsflyten med ledende AI-verktøy for innholdskalendere for å administrere hele innholdspipelinen din fra skapelse til publisering.

Avanserte strategier for automatisering og skalering

Hvis du driver et innholdsbyrå, håndterer en flåte av SEO-sider eller rett og slett har et fjell av tekst å komme gjennom, er den manuelle chunking-prosessen et reelt hinder. Å manuelt kopiere, lime og sette sammen tekst er en alvorlig flaskehals som spiser opp hastighetsfordelen du fikk fra å bruke AI i utgangspunktet.

Når du håndterer dusinvis av artikler i uken, legger den "raske" manuelle prosessen seg opp. For å virkelig få dette til å fungere i volum, må du gå utover nettleseren og omfavne automatisering.

Det er her et API (application programming interface) blir din nye beste venn. Tenk på det som en direktelinje fra systemene dine til en AI-humaniserer som HumanText.pro, uten menneskelig klikking. I stedet for å mate maskinen med en liten bit om gangen, kan du bygge en smidig pipeline som automatiserer hele sekvensen.

Bygge en automatisert humaniseringspipeline

Å sette opp en automatisert arbeidsflyt høres mer skremmende ut enn det er. Kjerneideen er enkel: lag et system som kan ta et langt dokument, skjære det i perfekt store biter, sende hver enkelt til humanisererens API, og deretter sette den behandlede teksten pent sammen igjen.

Du trenger ikke å være utvikler for å få dette til. Det kan gjøres med enkle skript eller til og med no-code-plattformer som Zapier eller Make. Se for deg en arbeidsflyt der det å legge en ny AI-skrevet artikkel i en Google Drive-mappe automatisk setter i gang hele humaniseringsprosessen i bakgrunnen.

Slik ser det ut i praksis:

- Trigger: En ny fil legges til i en spesifikk Google Drive-mappe.

- Handling 1 (automatisk oppdeling): En Zapier- eller Make.com-arbeidsflyt deler automatisk dokumentet opp i tekstbiter på 500 ord.

- Handling 2 (API-kall): Arbeidsflyten sender hver bit, én om gangen, til HumanText.pro sitt API-endepunkt.

- Handling 3 (sammensetting): Skriptet samler alle de humaniserte resultatene og oppretter et nytt dokument i en annen Google Drive-mappe, klart for endelig gjennomgang.

Å bygge en pipeline som dette er nøkkelen til å skalere innholdsoperasjonene dine. En arbeidsflyt som en gang tok en time med manuelt arbeid kan fullføres på minutter, og frigjør teamet ditt til å fokusere på strategi, redigering og kreative oppgaver.

Når du tenker på kilden til dette innholdet, som en kraftig AI-generator for pressemeldinger, ser du hvorfor en strømlinjeformet humaniseringsprosess i bakkant er så avgjørende.

Håndtere kostnader og kvalitet i stor skala

Mens automatisering er en game changer for effektivitet, bringer den med seg et par nye ting å holde øye med. Når du opererer i volum, må du være smart med å håndtere kostnader og opprettholde kvalitet.

Kostnadsstyring: De fleste API-tilganger er pay-as-you-go, vanligvis fakturert per tegn eller ord. Før du slår på full automatisering, gjør noen raske beregninger. Estimer det månedlige volumet ditt og modeller de potensielle kostnadene slik at det ikke kommer noen overraskelser. Det er også lurt å sette opp varsler for å overvåke bruken din.

Kvalitetssikring: Automatisering er raskt, men det er ikke perfekt. En endelig menneskelig gjennomgang er ikke til forhandling. Bygg inn en rask kvalitetskontroll på slutten av pipelinen din. Etter at dokumentet er satt sammen, bør noen gi det en siste gjennomlesning for å jevne ut ubekvemme overganger mellom biter eller fikse merkelige formuleringer maskinen kan ha oversett. Denne endelige poleringen sikrer at det oppskalerte innholdet ditt fortsatt møter dine høye standarder.

Unngå vanlige fallgruver ved AI-humanisering

Når du behandler et langt dokument del for del, inviterer du til noen subtile problemer som kan sabotere sluttproduktet hvis du ikke er oppmerksom. Selv den glatteste arbeidsflyten med en AI-humaniserer uten ordgrense trenger et skarpt øye for å fange disse vanlige feilene. De to største synderne er tonal inkonsistens og konteksttap — begge kan fullstendig undergrave innholdets troverdighet.

Tonal inkonsistens er skurrende for en leser. Se for deg at ett kapittel i e-boken din høres ut som en stiv akademisk rapport, mens det neste leser som et avslappet, pludrete blogginnlegg. Dette skjer når humanisereren, som jobber med isolerte biter, tar forskjellige stilistiske valg for hver del. Du sitter igjen med et usammenhengende rot.

Så er det konteksttap. Dette er når verktøyet rett og slett ikke kan se helheten. Det kan bomme på avgjørende nyanser, gjennomgående temaer eller spesialisert terminologi du nøye har etablert i tidligere seksjoner. Det fører til generiske, eller til og med motstridende, omskrivninger. En humaniserer kan forenkle et begrep i én bit men la det være svært teknisk i en annen, noe som etterlater leseren fullstendig forvirret.

Den essensielle sammenhengsredigeringen

For å fikse alt dette, må du absolutt utføre en dedikert "sammenhengsredigering" etter at du har satt de humaniserte bitene sammen igjen. Det er sjansen din til å samle dokumentets stemme og jevne ut eventuelle grove overganger. Det er et ikke-forhandlingsbart steg.

Her er en handlingsrettet sjekkliste for sammenhengsredigeringen din:

- Samle stemme og tone: Les det første avsnittet i hver større seksjon. Høres de ut som om de ble skrevet av samme person? Hvis ikke, juster ordvalgene. Eksempel: Bytt ut "benytte" i en seksjon med "bruke" hvis resten av dokumentet er mer uformelt.

- Jevne ut overganger: Skann den første setningen i hvert avsnitt som følger et seksjonsbrudd. Knytter den an til forrige idé? Hvis ikke, legg til en enkel frase. Eksempel: Endre "Dataene viser en trend" til "Med utgangspunkt i forrige punkt viser dataene også en trend."

- Sjekk nøkkelterminologi: Bruk tekstbehandlerens søkefunksjon (Ctrl+F eller Cmd+F) for å finne nøkkelbegreper. Introduserte du en forkortelse som "SEO" i begynnelsen? Sørg for at du ikke skriver ut "søkemotoroptimalisering" igjen i et senere kapittel.

Denne sammenhengsredigeringen er så mye mer enn bare korrekturlesing. Det handler om å veve individuelle tråder tilbake til en enkel, sømløs vev. Det er det steget som hever en samling velskrevne avsnitt til et virkelig sammenhengende, slagkraftig dokument.

Den endelige menneskelige gjennomgangen

Uansett hvor sofistikerte verktøyene dine er, kan ingenting erstatte en endelig menneskelig gjennomgang. Denne siste gjennomlesningen er der du fanger de subtile feilene og legger til det siste laget med polering som automatisering rett og slett ikke kan gjenskape. Det er din mulighet til å tilføre personlighet, dobbelsjekke fakta og forsikre deg om at innholdet virkelig når frem til publikummet ditt.

For byråer som skalerer nettinnhold er hele denne prosessen en livredder. Du kan lime inn råinnhold, få en umiddelbar AI-score og humanisere det på sekunder, samtidig som kjernebudskapet bevares og det avgjørende laget av autentisitet legges til. Det er her HumanText.pro virkelig skinner, med lingvistiske modeller trent på over 1,2 millioner eksempler for å etterligne naturlig skriving — du trenger ikke engang å registrere deg for en prøveperiode. Frilansere har fortalt oss at det forvandler polert AI til engasjerende innlegg som seiler gjennom hver kontroll og hjelper dem med å lande oppdrag uten å vekke mistanke. Du kan finne mer informasjon om metoder for å gjøre AI-tekst mer menneskelig på papergen.ai.

Vanlige spørsmål om humanisering av langt innhold

Når du stirrer på et fjell av AI-tekst, dukker det alltid opp noen spørsmål. Det er naturlig å lure på logistikken, påvirkningen og sikkerheten i prosessen. La oss ta for oss noen av de vanligste spørsmålene vi hører fra brukere som tar fatt på store prosjekter.

Kan denne metoden virkelig fungere for en bok eller avhandling?

Absolutt. Det er akkurat dette chunking-strategien er designet for. Du kommer ikke til å lime inn et helt manuskript på 80 000 ord i et verktøy på en gang — det ville vært kaos. I stedet bryter du det ned.

Praktisk tips: For en avhandling, behandle hvert kapittel (Innledning, Litteraturgjennomgang, Metode, osv.) som et separat prosjekt. Humaniser alle seksjonene i Kapittel 1 først, utfør en sammenhengsredigering av det kapittelet, og gå deretter videre til Kapittel 2. Dette avgrenser arbeidet og forhindrer at du blir overveldet. For en bok, bruk den samme kapittel-for-kapittel-tilnærmingen.

Vil humanisering i omganger skade SEO-en min?

Tvert imot — det burde gi den et skikkelig løft. Søkemotorer blir smartere for hver dag og har blitt svært gode til å oppdage robotaktig, lite hjelpsomt innhold. Når du humaniserer teksten din, selv i deler, blir sluttproduktet mer naturlig og engasjerende. Det er en stor seier for SEO.

Så lenge du setter artikkelen sammen logisk og bevarer nøkkelordsfokuset ditt, gjør prosessen innholdet ditt bedre for virkelige mennesker. Og det som er bra for mennesker er nå det som er bra for Google.

Den gyldne regelen for moderne SEO er å levere reell verdi til leserne dine. Humanisert innhold er iboende mer verdifullt fordi det er tydeligere, mer engasjerende og føles autentisk.

Til syvende og sist plasserer denne tilnærmingen deg helt i tråd med det søkealgoritmer er bygget for å belønne.

Hvordan beskytter HumanText.pro mine sensitive dokumenter?

Vi forstår. Å overlevere sensitiv akademisk forskning eller konfidensielle forretningsplaner er en stor sak. Det er derfor vi har bygget HumanText.pro med en streng personvernerklæring: vi lagrer ikke, deler ikke eller bruker innholdet ditt til noe, og spesielt ikke til å trene modellene våre.

I det øyeblikket du behandler teksten din og lukker økten, er den borte fra vår side. Dette gjelder alle, enten du er på en gratis prøveperiode eller en betalt plan. Din proprietære informasjon forblir helt konfidensiell, sikker og — viktigst av alt — din. Alltid.

Klar til å slutte å bekymre deg for ordgrenser og begynne å lage innhold som virkelig når frem? HumanText.pro gir deg en tydelig, effektiv arbeidsflyt for å humanisere tekst i enhver lengde. Forvandle AI-utkastene dine til uoppdagelig, høykvalitets skriving som publikummet ditt faktisk vil lese.

Besøk https://humantext.pro for å komme i gang gratis.

Klar til å transformere ditt AI-genererte innhold til naturlig, menneskelig tekst? Humantext.pro forfiner teksten din umiddelbart og sørger for at den høres naturlig ut og omgår AI-detektorer. Prøv vår gratis AI-humaniserer →

Relaterte Artikler

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.