Din guide til å bruke en anti-AI-detektor etisk

Oppdag hvordan en anti-AI-detektor fungerer, hvorfor AI-deteksjon er mangelfull, og hvordan du etisk kan lage uoppdagelig AI-assistert innhold til prosjektene dine.

En anti-AI-detektor er ikke et skummel hackingverktøy. Det er ganske enkelt programvare designet for å ta AI-generert tekst og justere den slik at den leser som om den ble skrevet av et menneske, noe som gjør den usynlig for deteksjonsprogramvare. Disse verktøyene kalles ofte AI-humaniserere, og deres jobb er å skrive om innhold ved å endre setningsstrukturen, ordforrådet og rytmen for å etterligne en naturlig, menneskelig stemme.

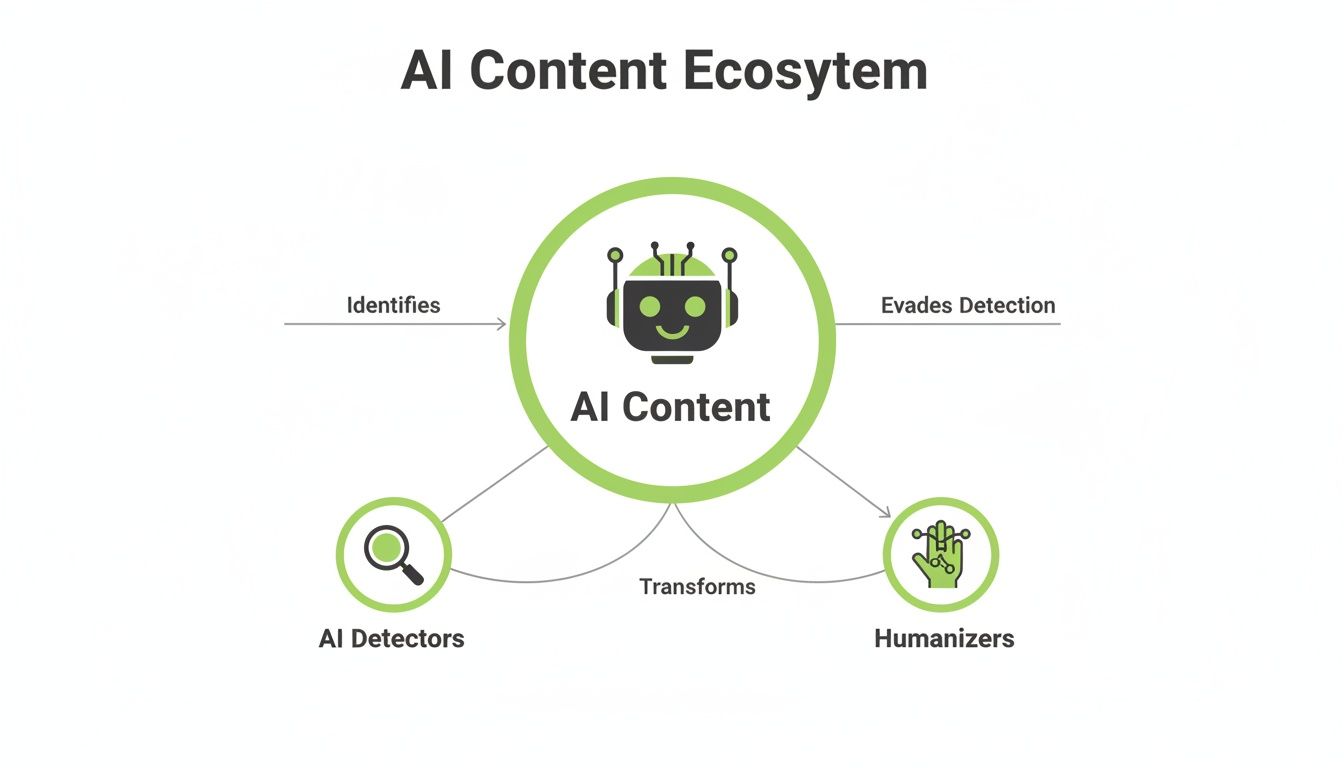

Katt-og-mus-leken i AI-innholdsproduksjon

Velkommen til den nye virkeligheten for digital skriving: en endeløs jakt mellom AI-innholdsgeneratorer og detektorene bygget for å snuse dem opp. Tenk på det som et høyteknologisk katt-og-mus-spill. Hver gang en ny AI-skrivemodell kommer ut, er en smartere detektor ikke langt unna. Og rett i hælene på den? En enda bedre anti-AI-detektor. Denne syklusen er den sentrale utfordringen for skribenter i dag.

La oss være ærlige – studenter, markedsførere og skapere bruker alle AI. Det er fantastisk for å komme i gang, brainstorme ideer og slå ut førsteutkast. Friksjonen starter når det AI-assisterte innholdet må leveres inn for karakter eller publiseres online. For å være troverdig må det føles ekte. Problemet er at rå AI-tekst ofte etterlater seg subtile "fingeravtrykk", som forutsigbare setningsstrukturer og en robotisk mangel på stil, som detektorer er bygget for å finne.

Det blomstrende deteksjonsmarkedet

Skalaen på denne frem-og-tilbake er massiv. Millioner av artikler, essays og rapporter skannes daglig av verktøy som er plugget direkte inn i akademiske plattformer og innholdssystemer. Dette har sparket i gang et gullrush og skapt en enorm industri fokusert på å oppdage maskinskrevet tekst.

Hvor stort er dette markedet egentlig? Ifølge én analyse ble det globale AI-detektormarkedet verdsatt til 453,2 millioner USD og forventes å eksplodere til 5 226,4 millioner USD innen 2033. Det reflekterer en sjokkerende sammensatt årlig vekstrate på 31,6%. Du kan lære mer om disse markedsprognosene og deres påvirkning.

Denne finansielle boomen skaper et kraftig insentiv for detektorer til å bli enda mer aggressive, noe som igjen driver etterspørselen etter effektive humaniseringsverktøy.

Å finne en vei til autentisitet

Målet her handler ikke bare om å "slå" en programvare. Det handler om å ta et nyttig, men feilfylt AI-utkast og foredle det til noe som gjenspeiler ekte menneskelig tanke og personlighet. Dette er akkurat hvor verktøy designet for å humanisere tekst kommer inn, og bygger broen mellom maskinlignende effektivitet og menneskelig kreativitet.

Her er hvordan et typisk anti-AI-detektorgrensesnitt ser ut, bygget for enkelhet og hastighet.

Hele arbeidsflyten er designet for å være ren og intuitiv: du limer inn teksten din, analyserer den og humaniserer den med ett klikk. Dette er bygget for skribenter som trenger pålitelige resultater uten en komplisert prosess. På slutten av dagen handler utfordringen ikke bare om å få en godkjent poengsum; det handler om å gjenvinne den naturlige stemmen i skrivingen din.

Hvordan AI-detektorer oppdager sine digitale fingeravtrykk

For å komme rundt AI-detektorer må du først forstå hva de faktisk leter etter. Tenk på AI-generert tekst som å ha et subtilt, men konsistent "språklig fingeravtrykk". Det er usynlig for en tilfeldig leser, men det er laget av forutsigbare mønstre som spesialiserte algoritmer er trent til å oppdage.

Disse verktøyene er ikke magi. De er bare svært sofistikerte mønstergjenkjenningssystemer. De analyserer tekst basert på et par kjerneprinsipper som nesten alltid skiller maskinskriving fra menneskelig skriving. Når du først får disse prinsippene, vil du se nøyaktig hvor AI-generert innhold kommer til kort – og hvorfor humanisering av det fungerer så bra.

Dette kartet viser push-and-pull-forholdet mellom AI-innhold, detektorene bygget for å snuse det opp og humanisererne designet for å gjøre det uoppdagelig.

Hele dette økosystemet dreier seg om et sentralt katt-og-mus-spill: AI genererer tekst, detektorer gransker den og humaniserere forelder den.

Jakten på forutsigbarhet (lav perpeksitet)

En av de største avsløringene av AI-innhold er hvor forutsigbart det er. I kjernen er AI-modeller ekspertgjettere. De er trent til å velge det mest statistisk sannsynlige neste ordet, om og om igjen. Dette skaper tekst som er glatt og logisk, men ofte mangler ekte gnist eller originalitet.

I tekniske termer måles dette med perpeksitet. En lav perpeksitetspoengsum betyr at teksten er veldig forutsigbar, som en musiker som bare spiller de samme tre akkordene i samme rekkefølge. Menneskelig skriving, på den andre siden, er naturlig mer kaotisk. Den har en høyere perpeksitet fordi vi bruker uventede ord, merkelig frasering og kreative setningsstrukturer.

- Praktisk eksempel: En AI kan fullføre setningen "Himmelen er..." med "blå". Det er det vanligste, statistisk tryggeste svaret. En menneskelig skribent, som sikter mot en mer suggestiv tone, kan velge "et blåmerket lilla" eller "fargen på gammel TV-statikk". Disse mindre forutsigbare valgene øker perpeksiteten.

Detektorer er bygget for å analysere akkurat denne kvaliteten. Hvis et skrevet stykke er litt for perfekt og ordvalgene alltid er de mest åpenbare, reiser det et rødt flagg. Det er et klassisk tegn på at en maskin var bak tastaturet.

Analysere setningsvariasjon (burstiness)

Et annet nøkkeltall er burstiness. Menneskelig skriving ebber og flyter naturlig. Vi kan skrive noen korte, slagkraftige setninger og deretter følge dem opp med en lengre, mer kompleks. Denne variasjonen i setningslengde og struktur skaper en dynamisk, engasjerende rytme.

AI-modeller? Ikke så mye. De har en tendens til å produsere setninger av svært ensartet lengde og kompleksitet. Deres output er ofte jevn og monoton, mangler "burstene" av kreativitet funnet i menneskelig prosa. En AI-detektor måler denne konsistensen; hvis teksten er for flat, er det mer sannsynlig at den blir flagget.

- Handlingsbar innsikt: Etter å ha generert AI-tekst, gå gjennom og med vilje bryt opp rytmen. Kombiner to korte setninger til en lengre med en konjunksjon som "men" eller "mens". Ta deretter en lang, kompleks setning og del den opp i to eller tre korte, slagkraftige. Dette enkle redigeringspasset kan dramatisk øke burstiness.

Et effektivt anti-AI-detektorverktøy bytter ikke bare ut noen få ord. Det omstrukturerer intelligent setninger, introduserer varierte rytmer og bryter opp den robotiske ensartetheten for å øke både perpeksitet og burstiness, noe som gjør teksten statistisk umulig å skille fra noe en person skrev.

Dette deteksjonsvapenkappløpet har blitt drevet av den rene volumet AI-innhold der ute. ChatGPT's markedsdominans, for eksempel, har skapt et massivt, ensartet datasett for detektorer å trene på. I et nylig år hadde ChatGPT utrolige 60,2% av den globale AI-verktøymarkedsandelen.

Dette har ført til en økning i deteksjon, med plattformer som Turnitin som gjennomgår 200 millioner studentoppgaver på ett enkelt år og flagger 11% av dem for betydelig AI-bruk. Du kan dykke dypere inn i mer data om AI-verktøybruk og dens påvirkning på Statista.com.

Vanlige AI-deteksjonsmetoder i korthet

Så hvordan peker detektorer faktisk ut disse digitale fingeravtrykkene? De bruker flere metoder, og mens teknologien blir komplisert, faller de grunnleggende fremgangsmåtene i noen hovedkategorier.

Denne tabellen bryter ned de vanligste teknikkene på et høyt nivå.

| Deteksjonsmetode | Hva den analyserer | Enkel analogi |

|---|---|---|

| Statistisk analyse | Forutsigbarhet (Perpeksitet), setningsvariasjon (Burstiness) og ordfrekvens. | En musikkritiker som analyserer om en sang er for enkel og repetitiv til å være skrevet av en erfaren komponist. |

| Klassifiseringsbaserte modeller | Komplekse, kombinerte mønstre lært fra millioner av menneskelige vs. AI-skriveprøver. | En høyt trent kunstekspert som kan oppdage en forfalskning ved å legge merke til tusenvis av små, subtile penselstrøk som ikke "føles" riktig. |

| Forensisk analyse | Skjult metadata eller digitale artefakter etterlatt av en spesifikk AI-modell. | En detektiv som støver etter fingeravtrykk på et åsted. |

| Vannmerking | Usynlige signaler eller mønstre innebygd direkte i AI-ens output av skaperne. | Et skjult vannmerke på en seddel som bare er synlig under et spesielt lys. |

Hver metode har sine styrker, men de deler alle en felles sårbarhet: de er avhengige av mønstre. Og mønstre kan med vilje forstyrres. Ved å forstå disse teknikkene blir det mye klarere hvordan verktøy som ZeroGPT finner sine mål.

Hvis du er interessert i et dypere blikk på å komme forbi et spesifikt verktøy, sjekk ut vår guide om hvordan du omgår ZeroGPT-deteksjon.

Hvorfor AI-detektorpoeng kan være misvisende

En AI-detektors poengsum kan føles som en endelig dom, men den er langt fra ufeilbarlig. Disse verktøyene opererer på sannsynligheter, ikke sikkerhet, noe som betyr at deres vurderinger ofte bare er utdannede gjettninger. Å stole på dem fullstendig er som å stole på en værapp som bare har rett noen ganger – du kan få solskinn, eller du kan bli fanget i en storm.

Denne innebygde usikkerheten fører til et betydelig og urovekkende problem: falske positive. En falsk positiv skjer når tekst skrevet helt av et menneske feilaktig blir flagget som generert av AI. Dette er ikke en sjelden feil; det er en vanlig mangel som kan ha alvorlige konsekvenser for studenter, skribenter og fagfolk som plutselig finner sitt autentiske arbeid urettferdig stilt spørsmål ved.

Når menneskelig skriving ser robotisk ut

Så hvorfor blir perfekt menneskelig arbeid misforstått som AI? Årsakene ligger ofte i skrivestiler som rett og slett ikke matcher hva detektoren anser som "normalt". Enhver strategi for å navigere disse verktøyene må ta hensyn til deres iboende fordommer.

For eksempel lærer ikke-morsmålstalere av engelsk ofte språket på en veldig strukturert, formell måte. Deres skriving kan naturlig ha lavere "perpeksitet" og "burstiness" – akkurat de egenskapene detektorer er trent til å assosiere med maskiner. Tilsvarende undervises skribenter i tekniske eller akademiske felt til å være direkte og presise, en stil som lett kan etterligne den enkle naturen til AI-generert tekst.

Her er noen scenarier hvor menneskelige skribenter har høy risiko for å få en falsk positiv:

- Formell akademisk skriving: Essays som følger strenge strukturelle regler og bruker formelt språk.

- Teknisk dokumentasjon: Manualer eller rapporter hvor klarhet prioriteres over stilistisk flair.

- Ikke-morsmålstalere: Individer hvis setningskonstruksjon kan være grammatisk perfekt, men mindre variert.

En "100% menneskelig" poengsum er ikke en garanti for kvalitet, akkurat som en "90% AI" poengsum ikke er definitivt bevis på maskingenerering. Disse poengene er bare datapunkter, og de bør behandles med sunn skepsis, ikke blind tro.

Problemets skala

Den eksplosive veksten av AI-detektorer i utdanning er en massiv vekkerklokke. I løpet av ett enkelt akademisk år gransket Turnitin 200 millioner oppgaver og flagget 11% av dem – det er 22 millioner dokumenter – som inneholder mer enn 20% AI-generert innhold. Selv om dette fremhever deteksjonens skala, understreker det også det enorme presset på studenter og den skyhøye potensialet for feil når millioner av oppgaver skannes automatisk.

Når du har å gjøre med tall så store, kan selv en liten feilrate påvirke tusenvis av individer. En student kan møte anklager om akademisk uærlighet, eller en profesjonell skribent kan miste en kundes tillit, alt basert på en feilfylt algoritmisk poengsum.

Falske negative: AI-en som slipper gjennom

På den andre siden av mynten er falske negative, hvor AI-generert innhold lykkes i å lure en detektor og får en "menneskelig" poengsum. Når språkmodeller blir mer sofistikerte, forbedres deres evne til å etterligne menneskelig skriving, noe som gjør dem mye vanskeligere å fange. Dette gjelder spesielt for innhold som har blitt lett redigert eller passert gjennom en AI-humaniserer.

Eksistensen av både falske positive og falske negative avslører en kritisk sannhet: AI-detektorer er rett og slett ikke pålitelige nok til å være den eneste dommeren av en teksts opprinnelse. De kan være et nyttig verktøy for innledende analyse, men deres poeng bør aldri, noensinne overstyre menneskelig vurdering. For de som vil forstå hvordan humaniserere fungerer for å bekjempe disse problemene, kan du lære mer om hvorvidt uoppdagelig AI virkelig fungerer i vår detaljerte guide. Denne konteksten er avgjørende for alle som bruker AI-assisterte skriveverktøy ansvarlig.

Handlingsbare strategier for å humanisere AI-innhold

Å vite hvorfor AI-detektorer flagger innholdet ditt er halve kampen. Å vite hvordan man fikser det er hvor det virkelige arbeidet begynner. Å transformere robotisk, forutsigbar AI-tekst til noe som puster med menneskelig personlighet er ikke magi – det handler om å anvende spesifikke, praktiske skriveteknikker.

Dette er spillboken for å forvandle et sterilt førsteutkast til overbevisende, autentisk innhold som faktisk kobler til lesere og seiler forbi detektorer.

Disse manuelle strategiene er selve grunnlaget for hvordan et effektivt anti-AI-detektorverktøy fungerer. Når du først forstår dem, vil du sette pris på de komplekse språklige justeringene som humaniserere bruker automatisk, noe som sparer deg timer med kjedelig redigering.

Mestre setningsstruktur og flyt

Det nummer én avsløringen av AI-skriving er dens monotone rytme. AI-modeller er trent på ensartethet, så de spytter ofte ut setninger av lignende lengde og struktur, en etter en. Din første jobb er å knuse det mønsteret og introdusere en naturlig kadense.

Dette er hvor du fokuserer på å øke burstiness. Bland det opp. Skriv en kort, slagkraftig setning. Følg den med en lang, flytende som inneholder flere ledd. Den variasjonen er kjennetegnet på menneskelig uttrykk.

Før (AI-generert):

"Implementeringen av nye programvaresystemer kan presentere betydelige utfordringer for organisasjoner. Ansatte krever ofte omfattende opplæring for å tilpasse seg de nye arbeidsflytene. Denne prosessen kan være tidkrevende og kan påvirke innledende produktivitetsnivåer."

Etter (Humanisert):

"Å rulle ut ny programvare er tøft. Ansatte står overfor en bratt læringskurve, og den tilpasningsperioden spiser inn i produktiviteten – det er bare en del av prosessen."

Versionen "etter" kombinerer ideer, dumper det formelle språket og varierer setningslengden, noe som skaper en langt mer engasjerende og menneskelig flyt.

Injiser din unike stemme og personlighet

AI-modeller har ikke meninger, personlige erfaringer eller en følelse for humor. De kan bare etterligne dem basert på treningsdata. For å virkelig humanisere et tekststykke må du gjennomsyre det med ditt eget unike perspektiv. Dette er et kritisk steg som ingen maskin noensinne helt kan replikere.

Her er hvordan du gjør det:

- Legg til personlige anekdoter: Del en kort, relevant historie. Å begynne med "Jeg husker en gang da..." signaliserer umiddelbart en menneskelig touch. For eksempel, i stedet for å si at AI forbedrer arbeidsflyten, beskriv et spesifikt prosjekt hvor det kuttet forskningstiden din i to.

- Bruk spesifikke, konkrete eksempler: I stedet for å si "forskjellige faktorer", list dem opp. Forankre abstrakte konsepter i virkelige scenarier som publikummet ditt får.

- Inkorporer idiomer og dagligdagse uttrykk: Bruk fraser som "bite i det sure eplet" eller "en velsignelse i forkledning". Disse er ofte for nyanserte for AI å bruke korrekt og naturlig.

Interessant nok overlapper mange av prinsippene for å humanisere AI-innhold med generelle beste praksiser for å skrive godt. Ved å fokusere på stemme og autentisitet omgår du ikke bare detektorer; du blir en bedre skribent. For et dypere dykk, utforsk disse strategiene for å lage engasjerende innhold.

Diversifiser ordforrådet og fraseringen din

AI-modeller har en liste med "favorittord". De lener seg tungt på visse formelle og generiske termer fordi de er statistisk vanlige i dataene de ble trent på. Ditt mål er å oppdage disse repetitive ordene og bytte dem ut med mer interessante, mindre forutsigbare alternativer.

Tenk på det som å legge til krydder i en intetsiggende rett. Dump de kjedelige verbene og adjektivene for mer dynamiske.

| Vanlig AI-ord | Humanisert alternativ |

|---|---|

| Videre | I tillegg til det / Pluss |

| Følgelig | Som et resultat / Så |

| Avgjørende / Vitalt | Nøkkel / Et must |

| Til slutt | For å avrunde / På slutten av dagen |

De beste anti-AI-detektorteknikkene fokuserer på å gjøre tekst mindre perfekt. Menneskelig skriving er fylt med særegenheter, litt uvanlige ordvalg og bevisste stilistiske avvik. Omfavn litt uperfeksjon for å oppnå ekte autentisitet.

Faktasjekk og legg til kritisk innsikt

Til slutt, stol aldri blindt på informasjonen en AI gir deg. Språkmodeller er kjent for å "hallusinere", selvsikkert påstå ting som er helt gale. Det enkelt viktigste humaniseringstrinnet er å manuelt verifisere hver eneste påstand, statistikk og datapunkt.

Men ikke stopp bare med å være nøyaktig. Gå dypere ved å legge til din egen kritiske analyse.

- Stille spørsmål ved AI-ens output: Gir denne konklusjonen faktisk mening? Er det et annet perspektiv å vurdere?

- Legg til din egen analyse: Forklar hvorfor et bestemt faktum betyr noe eller hva implikasjonene er. For eksempel, hvis en AI sier at et marked vil vokse med 10%, legg til din analyse om hvilke spesifikke segmenter som vil drive den veksten.

- Koble disparate ideer: Trekk forbindelser mellom punkter som AI-en var for lineær til å lage.

Dette laget av menneskelig intelligens og kritisk tenkning er ditt ultimate forsvar mot deteksjon. Det løfter innholdet fra en enkel oppsummering av informasjon til et verdifullt, innsiktsfullt stykke som er utvilsomt ditt.

Å navigere den etiske labyrinten av AI-humaniserere

Kraften til et anti-AI-detektor-verktøy reiser et kritisk spørsmål: hvor ligger ansvaret? På den ene siden er disse verktøyene fantastiske for å polere utkast og knuse gjennom skriveblokkering. På den andre siden kan de være en snarvei til akademisk uærlighet. Det er avgjørende å trekke en fast linje.

Tenk på en AI-humaniserer mindre som en tryllestav som skaper arbeid fra intet og mer som en utrolig avansert stavekontroll. Dens virkelige jobb er å polere, avklare og løfte tekst som du allerede har konseptualisert og strukturert. Kjerneidéene, argumentene og innsiktene må begynne med deg.

AI som en lanseringsrampe, ikke en fallskjerm

Den mest ansvarsfulle måten å nærme seg AI-humaniserere på er ved å behandle AI-generert tekst som et utgangspunkt – en lanseringsrampe for din egen tenkning. AI er strålende til å spy ut et generisk, grunnleggende utkast. Den kan oppsummere komplekse emner eller skissere nøkkelpunkter på sekunder, noe som sparer deg for masse tid.

Men den innledende outputen er bare råmateriale. Din jobb er å bygge på den, utfordre dens antakelser og injisere ditt unike perspektiv og analyse.

Den etiske linjen krysses i samme øyeblikk som AI-ens bidrag oppveier ditt eget. Hvis det endelige arbeidet ikke gjenspeiler din kritiske tenkning, personlige stemme og intellektuelle innsats, bruker du ikke lenger et verktøy – du delegerer ditt ansvar.

Denne distinksjonen er alt. Å bruke en AI til å hjelpe med å utarbeide en disposisjon eller forklare et knepent konsept er bare smart. Men å sende inn en lett omformulert AI-oppgave som din egen? Det undergraver fullstendig akademisk og profesjonell integritet.

Pilarene for ansvarlig bruk

For å holde deg på riktig side av den etiske skillelinjen, hold deg til disse veiledende prinsippene. De vil hjelpe deg med å bruke AI-humaniserere for å forbedre arbeidet ditt uten å kompromittere din integritet.

- Du er forfatteren: Det endelige stykket må være et produkt av ditt intellektuelle arbeid. AI kan hjelpe med setningsstruktur og ordvalg, men analysen, bevisene og konklusjonene må være dine.

- Originaltanke er konge: Bruk AI til å overvinne en skriveblokkering, ikke en tankeblokkering. Målet er å artikulere dine ideer mer effektivt, ikke å la maskinen ha ideene for deg.

- Faktasjekking er ikke-forhandlingsbar: Du er 100% ansvarlig for nøyaktigheten av hver påstand i arbeidet ditt. AI-modeller kan og finner opp ting, så du må verifisere hver statistikk, dato og faktum på egen hånd.

Et rammeverk for etisk anvendelse

Så hvordan ser dette ut i den virkelige verden? La oss vurdere et par scenarier for å etisk bruke et anti-AI-detektor-verktøy.

Etisk bruk: En student bruker ChatGPT til å generere en oppsummering av tre forskjellige økonomiske teorier for en oppgave. Hun skriver deretter sin egen analyse som sammenligner og kontrasterer dem. Til slutt bruker hun en AI-humaniserer for å foredle prosaen sin og sikre at den flyter naturlig og høres menneskelig ut. Her tjente AI-en som en forskningsassistent, men den kritiske tenkningen var helt hennes.

Uetisk bruk: En markedsfører genererer et helt blogginnlegg med et AI-verktøy, bytter ut noen ord og kjører det gjennom en humaniserer for å omgå detektorer før hun publiserer det som originalt innhold. Dette er i bunn og grunn plagiat, siden det grunnleggende intellektuelle arbeidet ble gjort av maskinen, ikke personen.

Ved å adoptere dette tankegangen kan du med selvtillit bruke disse kraftige verktøyene til å bli en mer effektiv og polert skribent, alt mens du holder din integritet intakt.

Den praktiske anvendelsen: En anti-AI-detektor i aksjon

All teorien er flott, men la oss se hvordan dette fungerer i den virkelige verden. Dette er hvor vi går fra abstrakte konsepter til et praktisk blikk på hvordan et verktøy kan transformere et flatt, AI-generert avsnitt til noe som føles genuint menneskelig. Hele prosessen er bygget for hastighet og enkelhet.

La oss starte med et tekststykke rett fra en AI. Det er rent, grammatisk korrekt og får frem poenget. Men det er også litt... livløst. Det har den forutsigbare rytmen og trygge ordvalget som AI-detektorer er trent til å oppdage på lang avstand. Dette er akkurat den typen skriving som blir flagget for sin robotiske struktur og lave perpeksitet.

Fra robotisk til realistisk i tre enkle trinn

Med et verktøy som HumanText.pro er arbeidsflyten utrolig enkel. Tanken er å ta det AI-utkastet, la teknologien peke ut dens maskinlignende trekk og deretter skrive det om for å høres helt naturlig ut – alt uten å endre kjernehudskapet.

Her er nedbrytningen i bare tre trinn:

- Lim inn og analyser: Du sparker i gang ved å lime inn din rå AI-tekst rett inn i verktøyet. Det kjører en rask skanning og gir deg vanligvis en poengsum som viser hvor sannsynlig det er å bli flagget av detektorer.

- Humaniser med ett klikk: Dette er den magiske knappen. Du trykker på "Humaniser", og algoritmen går i gang. Det handler ikke bare om å bytte ord; det handler om å omstrukturere setninger, variere ordforrådet og justere den generelle flyten for å gjøre det mindre forutsigbart.

- Gjennomgå og kjør: På sekunder får du den omskrevne versjonen. Outputen er klar til bruk, justert akkurat nok til å adoptere de subtile særegenhetene og nyansene av menneskelig skriving.

Dette bildet gir deg et perfekt før-og-etter-øyeblikksbilde, som viser hvordan en høy AI-deteksjonspoengsum blir snudd til en menneskelig.

Den virkelige lærdommen her er den dramatiske endringen i tekstens DNA. Den humaniserte versjonen har mer variasjon i setningslengde og bruker mindre vanlige ordkombinasjoner, noe som gjør den statistisk nesten identisk med noe en person ville skrive. For å dykke dypere inn i teknologien som gjør dette mulig, sjekk ut vår fullstendige guide om AI-innholdshumanisereren.

Utover et enkelt verktøy

Fordelene er klare: det er raskt, enkelt og det fungerer. Dette viser hvordan disse verktøyene kan gli inn i en effektiv og etisk skriveprosess. Mens vi er fokusert på humaniserere her, er det verdt å huske at de er en del av et mye større økosystem av ulike AI-innholdsverktøy designet for alle slags kreative behov.

Ved å håndtere de kjedelige delene av redigering gir en AI-humaniserer deg tilbake tiden til å fokusere på det som virkelig betyr noe: ideene, argumentene og de unike innsiktene som bare et menneske kan bringe. Det er en smart måte å polere AI-assisterte utkast til virkelig autentisk arbeid.

Dine spørsmål om AI-detektorer, besvart

Verdenen av AI-skriving og deteksjon er full av gråsoner. Hvis du føler deg litt fortapt, er du ikke alene. La oss rydde opp i noen av de vanligste spørsmålene vi hører.

Kan AI-detektorer noen gang være 100 prosent nøyaktige?

Absolutt ikke. Det er umulig for noen AI-detektor å oppnå 100% nøyaktighet. Disse verktøyene er bygget på sannsynligheter og statistiske mønstre, ikke definitivt bevis. De gjør en utdannet gjetting, ikke leverer en dom.

Dette betyr at de alltid vil ha en feilmargin, noe som fører til både falske positive (flagge menneskelig skriving som AI) og falske negative (gå glipp av AI-generert tekst). Ting som din personlige skrivestil, emnets kompleksitet eller til og med den spesifikke AI-modellen som brukes kan kaste en detektor ut av balanse.

Tenk på en deteksjonspoengsum som et forslag, ikke en dom. Det er et datapunkt som krever menneskelig gjennomgang, ikke en endelig vurdering. En anti-AI-detektor hjelper ganske enkelt med å forskyve tekstens statistiske profil for å se mer ut som mønstrene mennesker naturlig skaper.

Er det uetisk å bruke et anti-AI-detektorverktøy?

Etikken koker ned til én enkel ting: din intensjon.

Bruker du et verktøy til å polere et AI-assistert utkast, få det til å flyte bedre og høres mer ut som deg? Det er bare smart redigering. Det er ikke forskjellig fra å bruke en sofistikert grammatikkontroll for å foredle arbeidet ditt.

Men hvis målet ditt er å sende inn 100% AI-generert arbeid som din egen originaltanke – spesielt på skolen eller på jobben – har du krysset en linje. Den etiske tilnærmingen er å bruke AI som en medarbeider, ikke en spøkelsesskribent. Du leverer ideene, du har det siste ordet og du tar ansvar for det ferdige produktet.

Hvordan omgår AI-humaniserere faktisk deteksjon?

AI-humaniserere fungerer ved å i prinsippet reversere deteksjonsprosessen. De vet hva detektorer leter etter og systematisk demonterer disse mønstrene.

De begynner med å rote med tekstens rytme, variere setningslengder og strukturer for å skape mer "burstiness" – den litt uforutsigbare kadensen av menneskelig skriving. De bytter også ut vanlige, høysannsynlighet AI-ordvalg mot mindre forutsigbart ordforråd, noe som senker tekstens "perpeksitet".

Kort sagt tar de et tekststykke som er statistisk for perfekt og introduserer det subtile, organiske kaoset som definerer menneskelig uttrykk, alt uten å endre kjernebetydningen.

Klar til å forvandle dine AI-utkast til autentisk, polert innhold som seiler forbi detektorer? Med HumanText.pro kan du humanisere teksten din med ett enkelt klikk, noe som sikrer at den høres naturlig ut og er klar for publikummet ditt. Prøv det nå og se forskjellen selv.

Klar til å transformere ditt AI-genererte innhold til naturlig, menneskelig tekst? Humantext.pro forfiner teksten din umiddelbart og sørger for at den høres naturlig ut og omgår AI-detektorer. Prøv vår gratis AI-humaniserer →

Relaterte Artikler

AI Writing Assistance: Master Ethical Content Creation

Master AI writing assistance: learn workflows, best practices, & ethical use to create high-quality, human-sounding content that truly works.

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.