Oppdag hvordan du omgår Copyleaks: Etiske tips for innhold av høyere kvalitet

Oppdag etiske skriveteknikker av høy kvalitet som hjelper deg med å omgå Copyleaks og forbedre innholdets originalitet, lesbarhet og engasjement.

La oss være klare: når vi snakker om hvordan man "omgår Copyleaks," snakker vi ikke om juks. Det virkelige målet er å forfine og humanisere AI-assistert innhold slik at det gjenspeiler din unike stemme og unngår den frustrerende fellen med en falsk positiv.

Dette handler om å bevege seg forbi grunnleggende parafrasering. Det handler om å dykke inn i setningsstrukturer, diversifisere vokabularet ditt og injisere ditt personlige perspektiv. Når du gjør dette, gjør du ikke bare innholdet uoppdagelig—du gjør det genuint bedre.

Hvorfor 'Omgå Copyleaks' er mer enn bare juks

Det er utrolig frustrerende å legge ned innsats i et prosjekt, bare for å se en AI-detektor slenge en "100% AI-generert" etikett på det. Denne følelsen er altfor vanlig for forfattere og studenter som bruker AI som en brainstorming-partner eller en førsteutkast-assistent, ikke som en ghostwriter.

Uttrykket "omgå Copyleaks" kan høres skummelt ut, men for mange handler det om et praktisk behov: å unngå fallgruvene til oversensitive deteksjonsverktøy. Disse plattformene er programmert for å oppdage mønstre, men noen ganger er deres vurdering feil.

Algoritmene deres flagger ofte innhold for trekk som er kjennetegn på rå AI-output:

- Forutsigbare setningsstrukturer: AI-modeller faller ofte inn i en rytmisk kjede og produserer setninger av lignende lengde og konstruksjon. For eksempel kan en AI generere et avsnitt der hver setning er mellom 10-15 ord lang, noe som skaper en monoton flyt som detektorer kan oppdage på lang avstand.

- Sterilt vokabular: Uten en menneskelig touch kan AI-skriving føles litt kjedelig. Den har en tendens til å holde seg til vanlige ord og styre unna unike fraser eller idiomer. En handlingsbar innsikt er å søke etter generiske adjektiver som "viktig" eller "effektiv" og erstatte dem med mer beskrivende ord som "avgjørende," "uunnværlig" eller "transformerende."

- Feilfri, enhetlig grammatikk: Selv om den er grammatisk perfekt, mangler rå AI-tekst ofte de subtile ufullkommenhetene og stilistiske særegenhetene som gjør menneskelig skriving autentisk.

Denne guiden omformer hele prosessen som en etisk redigeringsstrategi. Det handler ikke om å lure programvare; det handler om å løfte ditt eget arbeid. Ved å lære å humanisere dine AI-assisterte utkast, gjør du dem mer engasjerende, mer autentiske og—som en direkte følge—uoppdagelige fordi de fundamentalt er dine egne. For en dypere gjennomgang, sjekk ut våre strategier for å lage uoppdagelig AI.

Økningen av falske positiver

Etter hvert som deteksjonsverktøy har blitt rullet ut på universiteter og forlagshus, prøver et stort antall mennesker nå å "omgå" dem—ikke for å jukse, men for å sikre at deres legitime, AI-assisterte arbeid ikke blir feilbedømt. Da Turnitin lanserte sin AI-deteksjon i april 2023, avslørte deres egen testing at "grensetilfelle"-essays kunne bli feilklassifisert nesten halvparten av gangene.

Denne virkeligheten har næret en massiv interesse for humaniseringsplattformer som HumanText.pro. Folk trenger en måte å gjenvinne arbeidet sitt fra feilaktige algoritmer.

For bedre å forstå hvorfor dette skjer, hjelper det å se hva disse detektorene ser etter. De sammenligner tekst mot en statistisk modell av hva AI vanligvis produserer.

AI-tekstsignaler vs menneskelige skriveegenskaper

Denne tabellen bryter ned de vanlige mønstrene som AI-detektorer som Copyleaks flagger sammenlignet med egenskapene som definerer autentisk menneskelig skriving.

| AI-generert tekstsignal | Autentisk menneskelig skriveegenskaper | Hvorfor det betyr noe for deteksjon |

|---|---|---|

| Ensartet setningslengde | Varierte setningsstrukturer—korte, konsise setninger blandet med lengre, komplekse. | Forutsigbar rytme er et stort rødt flagg for AI. Variasjon føles naturlig for menneskelige lesere og skannere. |

| Lav perpleksitet | Høyere perpleksitet, med uventede ordvalg, idiomer og unike fraser. | Perpleksitet måler tilfeldighet. AI-tekst er statistisk forutsigbar; menneskelig språk er mindre slik. |

| Perfekt, enkel grammatikk | Sporadiske stilistiske fragmenter, kompleks tegnsetting (som tankestrek) og en distinkt personlig stemme. | Mennesker bøyer grammatikkregler for effekt. AI spiller det vanligvis trygt, noe som resulterer i en robotisk følelse. |

| Generisk vokabular | Spesifikt, nyansert vokabular, inkludert sjargong, analogier og personlige anekdoter. | Menneskelige forfattere trekker fra personlig erfaring, noe som beriker ordvalget deres langt utover en standard AI-modell. |

| Mangel på personlig tone | En klar, konsistent stemme som formidler følelser, meninger og personlighet. | AI sliter med å forfalske genuint perspektiv. En sterk, autentisk tone er vanskelig for detektorer å merke som maskingenerert. |

Denne sammenligningen viser at det ikke handler om én enkelt faktor, men en kombinasjon av egenskaper. Ved å fokusere på å flytte teksten din fra venstre kolonne til høyre, unngår du ikke bare en detektor—du blir en bedre redaktør av AI-assistert innhold.

Kjerneproblemet er at selv om AI-detektorer blir mer avanserte, opererer de fortsatt på statistiske sannsynligheter. De forstår ikke kontekst eller intensjon; de ser bare mønstre. Dette er hvorfor en menneskelig touch fortsatt er det mest kraftfulle verktøyet i skrivearsenalets ditt.

Til syvende og sist er målet å produsere arbeid som ubestridelig er ditt. Ved å fokusere på å legge til unike innsikter, variere skrivstilen din og polere det endelige utkastet, omgår du ikke bare et verktøy—du mestrer kunsten av moderne, AI-assistert skriving.

Hvorfor grunnleggende parafrasering mislykkes med moderne AI-detektorer

Hvis du tror at det å bytte ut noen synonymer eller kjøre teksten din gjennom en grunnleggende "spinner" er nok til å fly under radaren til Copyleaks, er det på tide med en realitetssjekk. Disse gammeldagse triksene er fullstendig gjennomsiktige for moderne AI-detektorer, som er bygget for å se langt utover enkle ordendringer.

Disse verktøyene skanner ikke bare etter kopierte fraser lenger. De analyserer de dype, underliggende statistiske mønstrene som gir AI-generert innhold sin signatur robotiske følelse. Det er som å prøve å kamuflere en robot ved å sette en annen hatt på den—de stive, mekaniske bevegelsene røper den hver eneste gang.

Utover enkle ordbytter

Dagens detektorer analyserer selve rytmen og flyten i skrivingen din. De har blitt trent på massive biblioteker av menneskelig og AI-tekst, og lært å oppdage de subtile men konsistente fingeravtrykkene som maskiner etterlater seg.

De fokuserer på kjernemetrikker du kanskje ikke engang tenker på:

- Perpleksitet: Dette er en fancy betegnelse for hvor forutsigbar teksten din er. Menneskelig skriving er ofte overraskende; vi bruker uventede ordvalg og fraser. AI, på den annen side, har en tendens til å velge det statistisk mest sannsynlige ordet, noe som gjør outputen jevn men til syvende og sist forutsigbar.

- Burstiness: Dette refererer til variasjonen i setningslengde og struktur. Mennesker skriver naturlig med en blanding av korte, konsise setninger og lengre, mer beskrivende. AI-modeller faller ofte inn i en monoton rytme av setninger med lignende lengder, noe som er et dødt give-away for en detektor.

En enkel parafrase kan endre ordene på siden, men den fikser sjelden den underliggende strukturelle forutsigbarheten.

En virkelig parafrasering som mislykkes

La oss se på et raskt eksempel på hvordan en parafrasert setning fortsatt kan skrike "robot."

Original AI-tekst: Spredningen av digitale teknologier har fundamentalt endret kommunikasjonslandskapet og skapt nye muligheter for global tilkobling.

Grunnleggende parafrasert tekst: Spredningen av digitale verktøy har i utgangspunktet endret hvordan vi kommuniserer, og skaper nye måter for folk over hele verden å koble til.

Sikker, ordene er forskjellige, men kjernestrukturen og den forutsigbare flyten er fortsatt der. Den andre setningen mangler fortsatt nyansen og den naturlige kompleksiteten til noe en person ville skrive. En avansert detektor ser rett gjennom dette. Målet er ikke bare å finne en ny måte å si noe på, men å fullstendig revurdere hvordan det blir sagt.

Dette er nøyaktig hvorfor en mer gjennomtenkt, strukturell tilnærming er ikke-forhandlingsbar for å komme forbi Copyleaks. Benchmark-tester viser konsekvent at grove triks som synonymbytte bare ikke holder. Enkel parafrasering har vist seg å redusere AI-deteksjonspoeng til omtrent 28,7%. I sterk kontrast kan en ordentlig justert AI-humaniseringsarbeidsflyt—som adresserer disse dypere strukturelle problemene—treffe en suksessrate nærmere 95%.

Til syvende og sist betyr det å finne ut om uoppdagelig AI fungerer å bevege seg forbi overfladiske redigeringer. Ekte humanisering handler om å bryte opp disse forutsigbare mønstrene og injisere en unik, autentisk stemme i teksten.

En praktisk arbeidsflyt for å gjøre AI-innhold til ditt eget

Glem de generiske rådene. Hvis du vil lage innhold som føles genuint menneskelig, trenger du en hands-on, flerlagsprosess. Dette handler ikke om enkle redigeringer; det handler om å fundamentalt revurdere hvordan AI-generert tekst er bygget. Målet er å bryte dens monotone, forutsigbare rytme og transformere den til noe dynamisk og autentisk.

Denne arbeidsflyten handler ikke bare om å justere ord for å komme forbi en detektor som Copyleaks. Det er en ekte strategi for å infundere din unike stemme, variere setningskompleksitet og forvandle robotiske avsnitt til noe som faktisk høres ut som deg.

Omformulere monotone avsnittstrukturer

AI-modeller er trent til å være logiske, noe som ofte betyr at de faller inn i repeterende avsnittsmønstre. Du ser det hele tiden: en temasetning, tre støttepunkter og et ryddig sammendrag. Din første jobb er å sprenge den rigide formelen.

Handlingsbar innsikt: Se etter et avsnitt med en listelignende struktur. I stedet for bare å redigere setningene, prøv å kombinere to punkter til en enkelt, mer kompleks setning eller trekke et punkt ut for å stå alene for vekt. Dette forstyrrer den forutsigbare takten som AI-detektorer er trent til å fange.

Her er et perfekt eksempel på hva jeg mener:

Før (AI-generert):

"Digital markedsføring er viktig for moderne bedrifter. Det lar bedrifter nå et bredere publikum. Det gir også målbare resultater gjennom analyser. Til slutt er det mer kostnadseffektivt enn tradisjonell reklame."

Strukturelt er det greit. Men det er smertefullt robotisk.

Etter (humanisert):

"I dagens marked er det å ignorere digital markedsføring som å åpne en butikk, men ikke fortelle noen hvor den er. Det handler ikke bare om å nå et bredere publikum eller få bedre analyser—det handler om overlevelse. I tillegg er det ofte langt mer kostnadseffektivt enn gammeldagse trykte annonser."

Ser du forskjellen? Den menneskelige versjonen bruker en analogi, knuser ideer sammen og har en mye mer naturlig, samtalepreget flyt. Den fullstendig knuser den rigide "Punkt 1, Punkt 2, Punkt 3"-strukturen.

Injiser din unike stemme og anekdoter

Ditt mest kraftfulle våpen mot AI-deteksjon er deg. AI har ingen livserfaringer, ingen sterke meninger og ingen morsomme historier fra fjorårets konferanse. Å legge til disse elementene er den raskeste måten å gjøre innholdet ubestridelig ditt.

Praktisk eksempel: Hvis du skriver om prosjektstyringsverktøy, ikke bare list opp funksjonene. Legg til en setning som, "Jeg administrerte en gang et prosjekt der vi mistet en frist rett og slett fordi oppgaver ikke var synlige for hele teamet—et problem som et verktøy som Asana ville ha løst umiddelbart." Denne personlige touchen er noe en AI ikke kan generere.

I stedet for bare å spy ut fakta, prøv å veve inn:

- Personlige historier: En kort, relevant anekdote kan vekke liv i et tørt emne.

- Sterke meninger: Ikke vær redd for å ta et standpunkt. AI er bygget for å være nøytral; en klar mening er et massivt menneskelig signal.

- Spesifikke eksempler: Bytt ut AI-ens generiske eksempler med svært spesifikke, virkelige scenarier den aldri ville komme på selv.

Dette er et skjermbilde fra HumanText.pro-hjemmesiden, som handler om å transformere AI-tekst til menneskelignende innhold. Legg merke til hvor rent grensesnittet er—det er designet for en enkel input-output-prosess, noe som forsterker hvordan et verktøy som dette enkelt kan passe inn i redigeringsarbeidsflyten din.

Variere setningslengde og kompleksitet

En av de største avsløringene av AI-skriving er dens rytmiske konsistens. Denne egenskapen er kjent som lav burstiness. Menneskelig skriving, på den annen side, er over hele kartet. Vi bruker korte, konsise utsagn. Så følger vi dem opp med lange, flytende setninger som forklarer en kompleks idé.

For å få denne effekten må du aktivt redigere utkastet ditt med setningsvariasjon i tankene.

- Finn en lang, kompleks setning og del den opp i to eller tre kortere for effekt.

- Oppdage en serie korte, hakkete setninger og kombiner dem ved hjelp av konjunksjoner for å skape en mer sofistikert tanke.

Før (AI-generert):

"Systemet ble implementert for å øke effektiviteten. Målet var å redusere manuelle feil. Det var også ment å effektivisere driften."

Etter (humanisert):

"Systemets kjerneformål? Å øke effektiviteten. Ved å kutte ned på manuelle feil var det designet for å helt effektivisere vår daglige drift."

Den redigerte versjonen starter med et spørsmålsfragment og kombinerer to ideer til en enkelt, mer dynamisk setning. Dette skaper en rytme som føles mye mer menneskelig. Denne prosessen er absolutt sentral for enhver effektiv strategi for å omgå AI-deteksjon. Ved å fokusere på disse dype strukturelle og stilistiske endringene lurer du ikke bare en detektor; du skaper bedre, mer engasjerende innhold.

Å bruke AI-humaniseringsverktøy på riktig måte

AI-humaniseringsverktøy kan være utrolige allierte i skrivearbeidsflyten din, men la oss være klare: de er ikke magiske knapper. Jeg liker å tenke på dem mindre som en ett-klikks-løsning og mer som en sofistikert co-pilot som hjelper meg med å navigere de siste, vanskelige delene av redigeringsprosessen.

Disse plattformene bruker noen ganske avanserte lingvistiske modeller for å analysere og omarbeide AI-utkast. Deres hovedjobb er å jevne ut de robotiske rytmene, forutsigbare setningsstrukturer og andre avslørende mønstre som detektorer som Copyleaks er designet for å fange.

Nøkkelen til å få gode resultater er å behandle humanisereren som det første trinnet i din endelige polering, ikke det siste. Det er et partnerskap. Du mater den med et anstendig utkast, algoritmen omstrukturerer og forfiner det, og så trer du tilbake inn for å legge til den siste, uerstattelige menneskelige touchen.

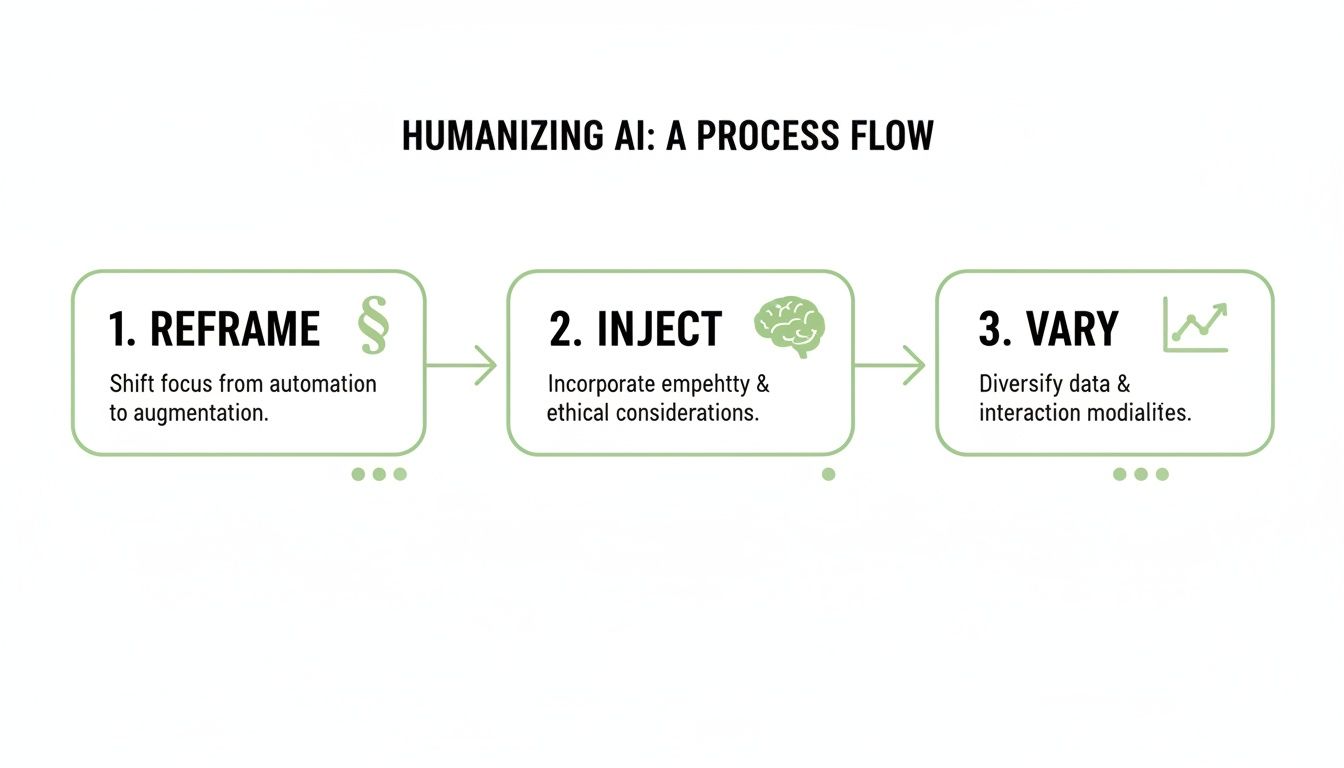

Denne enkle visualiseringen bryter ned hva den prosessen faktisk ser ut som.

Som du kan se, handler det om mye mer enn bare å bytte ut ord. Ekte humanisering kommer fra å omstrukturere kjerneideene, injisere personlig innsikt og skape en variert, interessant stil.

Forberede utkastet ditt for humanisereren

Du har hørt det før: søppel inn, søppel ut. Dette kunne ikke vært mer sant her. Kvaliteten på din opprinnelige AI-genererte tekst former direkte hva humanisereren kan gjøre med den. Før du engang tenker på å lime inn innholdet ditt i et verktøy som HumanText.pro, bruk fem minutter på å forberede det.

Først, skann raskt etter eventuelle åpenbare faktafeil eller virkelig klønete fraser. AI kan fortsatt få ting feil, og det er ingen vits i å be en humaniserer om å polere en setning som er faktisk feil. Å rydde opp dette først lar verktøyet fokusere på sin egentlige jobb: å forbedre flyten og det naturlige språket.

Neste, bryt opp disse massive, tette avsnittene. Seriøst, bare å trykke på "Enter"-tasten noen ganger gir verktøyet mye bedre råmateriale å jobbe med. Det er en liten innsats som fører til et mer nyansert og lesbart sluttprodukt.

Utføre den siste manuelle poleringen

Okei, humanisereren har gjort sin magi. Nå er det din tur. Det du har nå er et mye forbedret førsteutkast, men det mangler fortsatt din unike signatur. Det er her du løfter teksten fra bare "uoppdagelig" til genuint overbevisende.

Mitt nummer ett-tips? Les hele greia høyt. Det føles litt rart først, men det er den enkelt mest effektive måten å fange fraser som fortsatt høres litt off ut. Hvis du snubler mens du leser en setning, vil publikummet ditt definitivt slite med den.

Det virkelige målet med denne endelige poleringen er ikke bare å omgå Copyleaks; det er å få teksten til å høres ut som om den kom fra deg. Vev inn en personlig anekdote, en sterk mening eller en unik analogi som bare du kunne komme på. Det er det ultimate menneskelige fingeravtrykket.

En sjekkliste for å evaluere outputen

Når du har lagt til din personlige stil, kjør teksten gjennom en rask kvalitetskontroll. Ikke bare se etter AI-mønstre—evaluer den som et skrivingstykke. Her er en enkel sjekkliste jeg bruker for min endelige gjennomgang.

- Har den fortsatt riktig tone? Innholdet bør samsvare med formålet, enten det er en formell akademisk artikkel eller et uformelt blogginnlegg. Sørg for at humanisereren ikke ved et uhell gjorde din seriøse essay høres for pratsom ut.

- Er alle fakta fortsatt korrekte? Endret verktøyet utilsiktet nøkkelfakta, navn eller tall? Jeg dobbeltsjekker alltid hvert datapunkt for å sikre at ingenting ble vridd i omskrivingen.

- Er meningen fortsatt krystallklar? Noen ganger kan omstrukturering av setninger gjøre vannet grumset. Hvis en setning har blitt forvirrende, omskriv den for klarhet.

- Har jeg lagt til min unike stemme? Dette er det viktigste trinnet. Ditt perspektiv er det som gjør innholdet virkelig menneskelig. Har du satt ditt eget stempel på det?

Hvor går den etiske grensen med AI-skriving?

I eksplosjonen av AI-verktøy er det lett å føle at du er i et moralsk gråområde. Når går bruken av AI som en smart assistent over grensen til akademisk uærlighet eller feilaktig fremstilling?

La oss ta tak i dette med en gang. Svaret koker ned til to ting: intensjon og gjennomføring.

Å bruke en AI til å brainstorme en oversikt, polere en klønete setning eller foreslå et bedre ord er bare en avansert form for redigering. Det er virkelig ikke annerledes enn å åpne en synonymordbok eller kjøre teksten din gjennom en grammatikksjekker. Du bruker et verktøy til å forbedre ditt eget arbeid.

Den etiske grensen blir krysset når AI-en slutter å være et verktøy og begynner å være en erstatning for din egen tenkning. Å sende inn en essay som var 100% maskingenerert, uten noen betydelig input eller original tanke fra deg, skifter fra assistanse til rent bedrag. Dette er det de fleste universiteters integritetspolicyer er designet for å forhindre.

Målet er forstørrelse, ikke bedrag

Tenk på AI som en hyperintelligent samarbeidspartner, ikke en ghostwriter. Dens jobb er å forbedre ferdighetene dine, ikke å dekke over mangel på dem.

Når du nærmer deg AI med dette tankesett, blir det etiske bildet mye klarere. Målet er ikke å lure en detektor som Copyleaks; det er å produsere et endelig arbeid som er en genuin refleksjon av din kunnskap og din unike stemme.

Kjerneprinsippet er enkelt: det endelige arbeidet må være vesentlig ditt eget. Hvis den AI-assisterte teksten virkelig representerer dine ideer og perspektiv—bare uttrykt klarere—er du på solid etisk grunn.

Denne forskjellen er avgjørende i alle typer skriving. For eksempel, når man utforsker AI-sosiale medier-innholdsproduksjon, er målet å produsere autentisk, engasjerende materiale, selv med en maskins hjelp. Prinsippene om originalitet og å eie din stemme gjelder overalt.

Praktiske retningslinjer for å holde seg etisk

For å sikre at du holder deg på riktig side av akademiske og profesjonelle standarder, hjelper det å sette noen personlige grunnregler. Disse tipsene vil hjelpe deg med å bruke AI-skriveverktøy som en etisk partner.

- Bruk AI for idégenerering, ikke skapelse. Praktisk eksempel: Prompt en AI med "Generer fem potensielle blogginnlegg-titler om etikken i AI innen markedsføring." Bruk disse titlene til å inspirere din egen unike vinkel, i stedet for å be den skrive hele artikkelen.

- Fokuser på å forfine dine egne utkast. Dette er en game-changer. Lim inn setninger eller avsnitt du allerede har skrevet i et AI-verktøy og be om tilbakemelding. Prompt det til å "gjøre dette høres mer profesjonelt ut" eller "forenkle denne komplekse ideen." Dette holder kjernetankene dine helt intakte.

- Legg alltid til din unike innsikt. Den mest menneskelige delen av hvilken som helst tekst er personlig perspektiv. Vev inn dine egne meninger, erfaringer eller spesifikke eksempler som en AI aldri kunne komme på. Dette er din ultimate etiske sikring.

- Faktasjekk alt. AI-modeller er beryktede for å finne på ting, et fenomen kjent som "hallusinasjon". Ved å verifisere hver statistikk, sitat og påstand tar du fullt eierskap av innholdets nøyaktighet—en hjørnestein i akademisk og profesjonelt ansvar.

Til syvende og sist handler det om å navigere i dette nye landskapet ved å opprettholde din intellektuelle ærlighet. Det virkelige målet er å gjøre ditt AI-assisterte arbeid til en bedre, skarpere versjon av din egen tenkning, ikke en erstatning for den.

Vanlige spørsmål om humanisering for Copyleaks

Selv med en solid arbeidsflyt dukker noen praktiske spørsmål alltid opp når du prøver å få AI-generert tekst over målstreken. La oss ta tak i de vanligste jeg hører, rydde opp i prosessen og holde fast ved de etiske strategiene vi har snakket om.

Kan Copyleaks faktisk oppdage modeller som ChatGPT-4 og Google Gemini?

Absolutt. Copyleaks og andre toppdetektorer er i en konstant tilstand av evolusjon. De er spesifikt trent til å plukke opp de statistiske fingeravtrykkene etterlatt av de nyeste store språkmodellene, inkludert GPT-4, Gemini og Claude.

De ser på ting som setningsforutsigbarhet (det eksperter kaller perpleksitet) og enhetligheten i setningsstrukturer (kjent som burstiness). Dette er nøyaktig hvorfor det å bare kjøre teksten din gjennom et grunnleggende paraфraseringsverktøy er en oppskrift på fiasko. Du må fundamentalt endre tekstens DNA—dens struktur, rytme og stemme—ikke bare bytte ut noen ord.

Er bruk av et AI-humaniseringsverktøy å betrakte som juks?

Dette er den store, og svaret kommer ned til intensjon og de spesifikke reglene du opererer under. Hvis du bruker en humaniserer til å forfine et utkast du allerede har jobbet med, jevne ut språket og hjelpe til med å injisere din egen stil, er det virkelig bare et avansert redigeringsverktøy. Tenk på det som en superlаdet grammatikksjekker.

Den etiske grensen blir krysset når verktøyet blir en erstatning for din egen kritiske tenkning og innsats, ikke et supplement til den. Hvis du prøver å levere arbeid som ikke er vesentlig ditt eller du bryter en klar akademisk integritetspolicy, da ja, det er juks.

Hva er den enkelt beste måten å få AI-tekst til å høres menneskelig ut?

Alle ser etter en sølvkule, men det handler mindre om en enkelt "teknikk" og mer om et tankesettskifte. Selv om det er en god start å mikse opp setningslengder og vokabular, er det mest kraftfulle du kan gjøre å injisere ditt genuine, ikke-promptbare perspektiv.

AI-modeller er mønstergjenkjenningsmaskiner; de har ingen levde erfaringer, ingen særegne meninger og ingen unike minner. Å legge til disse er den raskeste måten å bryte den robotiske formen. Prøv å legge til bare en av disse:

- Et spesifikt, virkelig eksempel fra din egen kunnskap.

- En rask, relevant personlig historie som beviser et poeng.

- En sterk, unik mening som en AI aldri ville komme på selv.

Disse er elementene som gjør skrivingen din. Tenk på AI-deteksjonsverdenen som et katt-og-mus-spill mellom cybersikkerhetseksperter og hackere. Hvilket statisk triks som helst for å "omgå" en detektor er midlertidig av natur. Den eneste bærekraftige strategien er å fokusere på å skape genuint menneskelignende innhold ved å blande dine autentiske ideer med varierte skrivestrukturer. Ofte er det her dedikerte humaniseringsplattformer kan gi deg en fordel, siden de tilpasser seg de siste deteksjonsoppdateringene. Du kan oppdage flere AI-statistikker og trender for å få en bedre følelse av dette dynamiske miljøet.

Klar til å forvandle AI-utkastene dine til innhold som høres autentisk menneskelig ut? HumanText.pro bruker avansert lingvistisk modellering for å hjelpe deg med å omskrive robotisk tekst og produsere arbeid av høy kvalitet som leser naturlig og består deteksjon. Prøv det og se forskjellen selv på https://humantext.pro.

Klar til å transformere ditt AI-genererte innhold til naturlig, menneskelig tekst? Humantext.pro forfiner teksten din umiddelbart og sørger for at den høres naturlig ut og omgår AI-detektorer. Prøv vår gratis AI-humaniserer →

Relaterte Artikler

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.