Din Guide till Att Använda en Anti-AI-Detektor Etiskt

Upptäck hur en anti-AI-detektor fungerar, varför AI-detektering är bristfällig och hur du etiskt skapar odetekterbart AI-assisterat innehåll för dina projekt.

En anti-AI-detektor är inte något skumt hackningsverktyg. Det är helt enkelt programvara utformad för att ta AI-genererad text och justera den så att den läses som om den skrevs av en människa, vilket gör den osynlig för detekteringsprogramvara. Dessa verktyg kallas ofta AI-humaniserare, och deras uppgift är att skriva om innehåll genom att ändra meningsstrukturen, ordförrådet och rytmen för att efterlikna en naturlig, mänsklig röst.

Katt-och-råtta-leken i AI-innehållsskapande

Välkommen till den nya verkligheten för digitalt skrivande: en oändlig jakt mellan AI-innehållsgeneratorer och de detektorer som byggts för att sniffa upp dem. Se det som ett högteknologiskt katt-och-råtta-spel. Varje gång en ny AI-skrivmodell kommer ut är en smartare detektor inte långt efter. Och tätt i hälarna på den? En ännu bättre anti-AI-detektor. Denna cykel är den centrala utmaningen för skribenter idag.

Låt oss vara ärliga – studenter, marknadsförare och skapare använder alla AI. Det är fantastiskt för att komma loss, brainstorma idéer och slå ut första utkast. Friktionen börjar när det AI-assisterade innehållet behöver lämnas in för betygsättning eller publiceras online. För att vara trovärdigt måste det kännas genuint. Problemet är att rå AI-text ofta lämnar efter sig subtila "fingeravtryck", som förutsägbara meningmönster och en robotisk brist på stil, som detektorer är byggda för att hitta.

Den blomstrande detekteringsmarknaden

Skalan på detta fram och tillbaka är massiv. Miljontals artiklar, uppsatser och rapporter skannas dagligen av verktyg som är direkt inkopplade i akademiska plattformar och innehållssystem. Detta har startat en guldrush och skapat en enorm industri fokuserad på att upptäcka maskinskriven text.

Hur stor är denna marknad egentligen? Enligt en analys värderades den globala AI-detektormarknaden till 453,2 miljoner USD och förväntas explodera till 5 226,4 miljoner USD år 2033. Det återspeglar en häpnadsväckande sammansatt årlig tillväxttakt på 31,6%. Du kan läsa mer om dessa marknadsprognoser och deras påverkan.

Denna finansiella boom skapar ett kraftfullt incitament för detektorer att bli ännu mer aggressiva, vilket i sin tur driver efterfrågan på effektiva humaniseringsverktyg.

Att hitta en väg till autenticitet

Målet här handlar inte bara om att "slå" en programvara. Det handlar om att ta ett användbart men bristfälligt AI-utkast och förfina det till något som återspeglar verklig mänsklig tanke och personlighet. Detta är precis där verktyg utformade för att humanisera text kommer in, och bygger bron mellan maskinliknande effektivitet och mänsklig kreativitet.

Här är hur ett typiskt anti-AI-detektorgränssnitt ser ut, byggt för enkelhet och hastighet.

Hela arbetsflödet är utformat för att vara rent och intuitivt: du klistrar in din text, analyserar den och humaniserar den med ett klick. Detta är byggt för skribenter som behöver tillförlitliga resultat utan en komplicerad process. I slutändan handlar utmaningen inte bara om att få ett godkänt betyg; det handlar om att återta den naturliga rösten i ditt skrivande.

Hur AI-detektorer upptäcker sina digitala fingeravtryck

För att komma runt AI-detektorer måste du först förstå vad de faktiskt letar efter. Tänk på AI-genererad text som att ha ett subtilt men konsekvent "språkligt fingeravtryck". Det är osynligt för en tillfällig läsare, men det är gjort av förutsägbara mönster som specialiserade algoritmer är tränade att upptäcka.

Dessa verktyg är inte magi. De är bara mycket sofistikerade mönsterigenkänningssystem. De analyserar text baserat på ett par grundprinciper som nästan alltid separerar maskinskrivning från mänskligt skrivande. När du väl förstår dessa principer kommer du att se exakt var AI-genererat innehåll faller kort – och varför humanisering av det fungerar så bra.

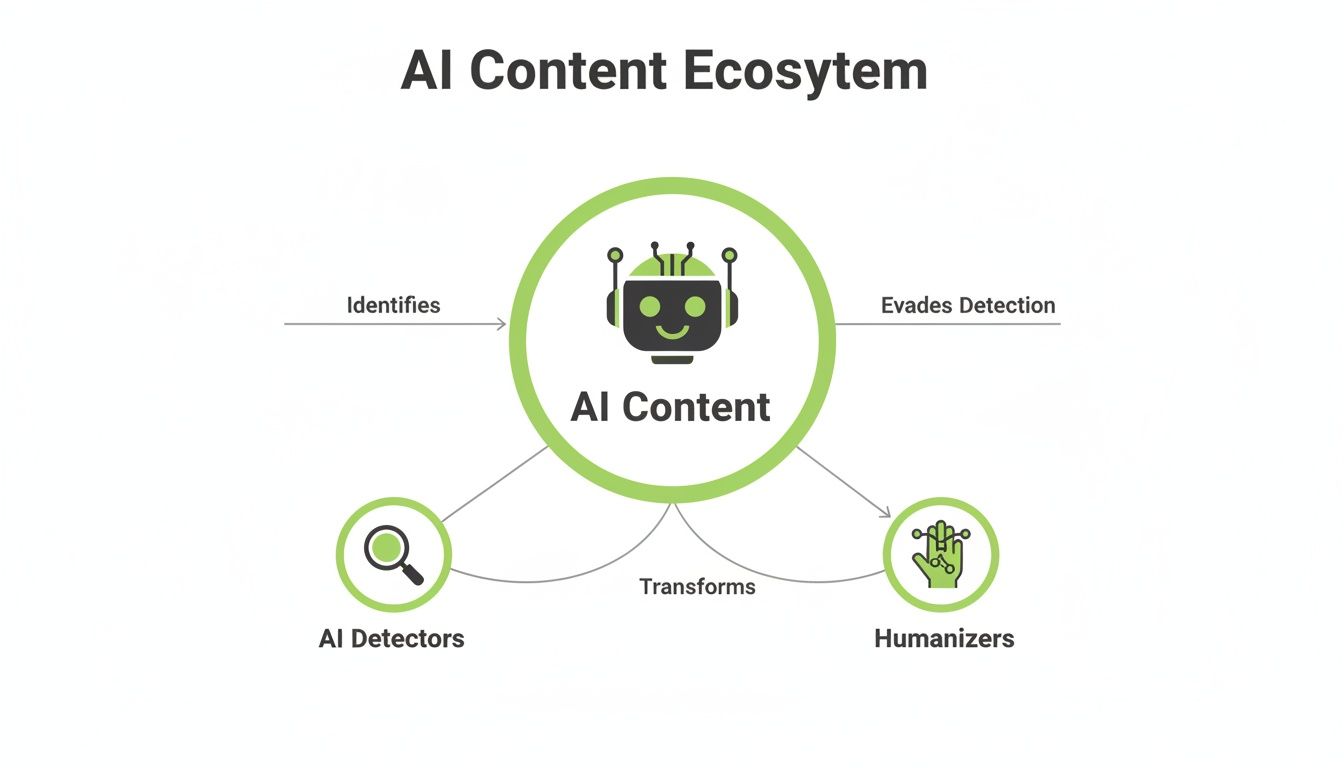

Denna karta visar push-and-pull-relationen mellan AI-innehåll, detektorerna byggda för att sniffa upp det och humaniserarna utformade för att göra det odetekterbart.

Hela detta ekosystem kretsar kring ett centralt katt-och-råtta-spel: AI genererar text, detektorer granskar den och humaniserare förfinar den.

Jakten på förutsägbarhet (låg perplexitet)

En av de största avslöjandena av AI-innehåll är hur förutsägbart det är. I sin kärna är AI-modeller expertgissare. De är tränade att välja det mest statistiskt troliga nästa ordet, om och om igen. Detta skapar text som är smidig och logisk men ofta saknar verklig gnista eller originalitet.

I tekniska termer mäts detta med perplexitet. En låg perplexitetspoäng betyder att texten är mycket förutsägbar, som en musiker som bara spelar samma tre ackord i samma ordning. Mänskligt skrivande, å andra sidan, är naturligt mer kaotiskt. Det har en högre perplexitet eftersom vi använder oväntade ord, konstig frasering och kreativa meningsstrukturer.

- Praktiskt exempel: En AI kan slutföra meningen "Himlen är..." med "blå". Det är det vanligaste, statistiskt säkraste svaret. En mänsklig skribent, som siktar på en mer suggestiv ton, kan välja "ett blåmärkt lila" eller "färgen på gammal TV-statik". Dessa mindre förutsägbara val ökar perplexiteten.

Detektorer är byggda för att analysera just denna kvalitet. Om ett skrivet stycke är lite för perfekt och dess ordval alltid är de mest uppenbara, höjer det en röd flagga. Det är ett klassiskt tecken på att en maskin var bakom tangentbordet.

Analysera meningsvariation (burstighet)

Ett annat nyckeltal är burstighet. Mänskligt skrivande ebbar och flödar naturligt. Vi kan skriva några korta, slagkraftiga meningar och sedan följa upp dem med en längre, mer komplex. Denna variation i meningslängd och struktur skapar en dynamisk, engagerande rytm.

AI-modeller? Inte så mycket. De tenderar att producera meningar av mycket enhetlig längd och komplexitet. Deras output är ofta stadig och monoton, saknar de "burst" av kreativitet som finns i mänsklig prosa. En AI-detektor mäter denna konsistens; om texten är för platt är det mer troligt att den flaggas.

- Handlingsbar insikt: Efter att ha genererat AI-text, gå igenom och avsiktligt bryt upp rytmen. Kombinera två korta meningar till en längre med en konjunktion som "men" eller "medan". Ta sedan en lång, komplex mening och dela upp den i två eller tre korta, slagkraftiga. Denna enda redigeringsomgång kan dramatiskt öka burstigheten.

Ett effektivt anti-AI-detektorverktyg byter inte bara ut några ord. Det omstrukturerar intelligent meningar, introducerar varierande rytmer och bryter upp den robotiska enhetligheten för att öka både perplexitet och burstighet, vilket gör texten statistiskt omöjlig att skilja från något en person skrev.

Detta detektionsvapenkapploppp har drivits av den rena volymen AI-innehåll där ute. ChatGPT:s marknadsdominans, till exempel, har skapat en massiv, enhetlig dataset för detektorer att träna på. Under ett nyligen år hade ChatGPT otroliga 60,2% av den globala AI-verktygsmarknadsandelen.

Detta har lett till en ökning av detektering, med plattformar som Turnitin som granskar 200 miljoner studentuppsatser på ett enda år och flaggar 11% av dem för betydande AI-användning. Du kan dyka djupare in i mer data om AI-verktygsanvändning och dess påverkan på Statista.com.

Vanliga AI-detekteringsmetoder i korthet

Så hur pekar detektorer faktiskt ut dessa digitala fingeravtryck? De använder flera metoder, och medan tekniken blir komplicerad, faller de grundläggande tillvägagångssätten i några huvudkategorier.

Denna tabell bryter ner de vanligaste teknikerna på en hög nivå.

| Detekteringsmetod | Vad den analyserar | Enkel analogi |

|---|---|---|

| Statistisk analys | Förutsägbarhet (Perplexitet), meningsvariation (Burstighet) och ordfrekvens. | En musikkritiker som analyserar om en låt är för enkel och repetitiv för att vara skriven av en erfaren kompositör. |

| Klassificeringsbaserade modeller | Komplexa, kombinerade mönster lärda från miljontals mänskliga vs. AI-skrivprover. | En högt tränad konstexpert som kan upptäcka en förfalskning genom att notera tusentals små, subtila penseldrag som inte "känns" rätt. |

| Forensisk analys | Dold metadata eller digitala artefakter som lämnats av en specifik AI-modell. | En detektiv som dammar efter fingeravtryck på en brottsplats. |

| Vattenmärkning | Osynliga signaler eller mönster inbäddade direkt i AI:ns output av dess skapare. | En dold vattenstämpel på en sedel som bara är synlig under ett speciellt ljus. |

Varje metod har sina styrkor, men de delar alla en gemensam sårbarhet: de förlitar sig på mönster. Och mönster kan avsiktligt störas. Genom att förstå dessa tekniker blir det mycket tydligare hur verktyg som ZeroGPT hittar sina mål.

Om du är intresserad av en djupare titt på att komma förbi ett specifikt verktyg, kolla in vår guide om hur man kringgår ZeroGPT-detektering.

Varför AI-detektorpoäng kan vara vilseledande

En AI-detektors poäng kan kännas som en slutgiltig dom, men den är långt ifrån ofelbar. Dessa verktyg fungerar på sannolikheter, inte säkerheter, vilket betyder att deras bedömningar ofta bara är utbildade gissningar. Att förlita sig på dem helt är som att lita på en väderapp som bara har rätt ibland – du kan få solsken, eller du kan bli fast i ett oväder.

Denna inbyggda osäkerhet leder till ett betydande och oroande problem: falska positiva. En falsk positiv händer när text skriven helt av en människa felaktigt flaggas som genererad av AI. Detta är inte någon sällsynt bugg; det är en vanlig brist som kan ha allvarliga konsekvenser för studenter, skribenter och yrkesverksamma som plötsligt finner sitt autentiska arbete orättvist ifrågasatt.

När mänskligt skrivande ser robotiskt ut

Så varför misstolkas perfekt mänskligt arbete för AI? Orsakerna ligger ofta i skrivstilstilar som helt enkelt inte matchar vad detektorn anser vara "normalt". Varje strategi för att navigera dessa verktyg måste ta hänsyn till deras inneboende fördomar.

Till exempel lär sig icke-modersmålstalare av engelska ofta språket på ett mycket strukturerat, formellt sätt. Deras skrivande kan naturligt ha lägre "perplexitet" och "burstighet" – precis de egenskaper som detektorer är tränade att associera med maskiner. På samma sätt undervisas skribenter inom tekniska eller akademiska områden att vara direkta och precisa, en stil som lätt kan efterlikna den enkla naturen hos AI-genererad text.

Här är några scenarier där mänskliga skribenter löper hög risk att få en falsk positiv:

- Formellt akademiskt skrivande: Uppsatser som följer strikta strukturella regler och använder formellt språk.

- Teknisk dokumentation: Manualer eller rapporter där tydlighet prioriteras över stilistisk flärd.

- Icke-modersmålstalare: Individer vars meningsuppbyggnad kan vara grammatiskt perfekt men mindre varierad.

En "100% mänsklig" poäng är inte en garanti för kvalitet, precis som en "90% AI" poäng inte är definitivt bevis på maskingenerering. Dessa poäng är bara datapunkter, och de bör behandlas med hälsosam skepsis, inte blind tilltro.

Problemets skala

Den explosiva tillväxten av AI-detektorer i utbildning är en massiv väckarklocka. Under ett enda akademiskt år granskade Turnitin 200 miljoner uppsatser och flaggade 11% av dem – det är 22 miljoner dokument – som innehållande mer än 20% AI-genererat innehåll. Även om detta belyser detekteringens skala, understryker det också det enorma trycket på studenter och den skyhöga potentialen för fel när miljontals uppsatser skannas automatiskt.

När du har att göra med siffror så stora kan även en liten felfrekvens påverka tusentals individer. En student kan möta anklagelser om akademisk oärlighet, eller en professionell skribent kan förlora en klients förtroende, allt baserat på en bristfällig algoritmisk poäng.

Falska negativa: AI:n som slinker igenom

På andra sidan myntet finns falska negativa, där AI-genererat innehåll framgångsrikt lurar en detektor och får en "mänsklig" poäng. När språkmodeller blir mer sofistikerade förbättras deras förmåga att efterlikna mänskligt skrivande, vilket gör dem mycket svårare att fånga. Detta gäller särskilt för innehåll som har redigerats lätt eller passerat genom en AI-humaniserare.

Existensen av både falska positiva och falska negativa avslöjar en kritisk sanning: AI-detektorer är helt enkelt inte tillförlitliga nog för att vara den enda domaren av en texts ursprung. De kan vara ett användbart verktyg för initial analys, men deras poäng bör aldrig, någonsin åsidosätta mänsklig bedömning. För de som vill förstå hur humaniserare fungerar för att bekämpa dessa problem kan du läsa mer om huruvida odetekterbar AI verkligen fungerar i vår detaljerade guide. Detta sammanhang är avgörande för alla som använder AI-assisterade skrivverktyg ansvarsfullt.

Handlingsbara strategier för att humanisera AI-innehåll

Att veta varför AI-detektorer flaggar ditt innehåll är halva striden. Att veta hur man fixar det är där det verkliga arbetet börjar. Att omvandla robotisk, förutsägbar AI-text till något som andas med mänsklig personlighet är inte magi – det handlar om att tillämpa specifika, praktiska skrivtekniker.

Detta är spelboken för att förvandla ett sterilt första utkast till övertygande, autentiskt innehåll som faktiskt kopplar till läsare och seglar förbi detektorer.

Dessa manuella strategier är själva grunden för hur ett effektivt anti-AI-detektorverktyg fungerar. När du väl förstår dem kommer du att uppskatta de komplexa språkliga justeringar som humaniserare tillämpar automatiskt, vilket sparar dig timmar av tråkig redigering.

Bemästra meningsstruktur och flöde

Det nummer ett avslöjandet av AI-skrivning är dess monotona rytm. AI-modeller är tränade på enhetlighet, så de spottar ofta ut meningar av liknande längd och struktur, en efter en. Ditt första jobb är att krossa det mönstret och introducera en naturlig kadens.

Detta är där du fokuserar på att öka burstighet. Blanda upp det. Skriv en kort, slagkraftig mening. Följ den med en lång, flödande som innehåller flera bisatser. Den variationen är kännetecknet för mänskligt uttryck.

Före (AI-genererad):

"Implementeringen av nya mjukvarusystem kan presentera betydande utmaningar för organisationer. Anställda kräver ofta omfattande utbildning för att anpassa sig till de nya arbetsflödena. Denna process kan vara tidskrävande och kan påverka initiala produktivitetsnivåer."

Efter (Humaniserad):

"Att rulla ut ny mjukvara är tufft. Anställda står inför en brant inlärningskurva, och den anpassningsperioden äter in i produktiviteten – det är bara en del av processen."

Versionen "efter" kombinerar idéer, dumpar det formella språket och varierar meningslängden, vilket skapar ett mycket mer engagerande och mänskligt flöde.

Injicera din unika röst och personlighet

AI-modeller har inte åsikter, personliga erfarenheter eller en känsla för humor. De kan bara efterlikna dem baserat på träningsdata. För att verkligen humanisera ett textstycke måste du genomsyra det med ditt eget unika perspektiv. Detta är ett kritiskt steg som ingen maskin någonsin helt kan replikera.

Här är hur du gör det:

- Lägg till personliga anekdoter: Dela en kort, relevant historia. Att börja med "Jag minns en tid när..." signalerar omedelbart en mänsklig touch. Till exempel, istället för att säga att AI förbättrar arbetsflödet, beskriv ett specifikt projekt där det skar din researchtid i hälften.

- Använd specifika, konkreta exempel: Istället för att säga "olika faktorer", lista dem. Förankra abstrakta koncept i verkliga scenarier som din publik förstår.

- Inkorporera idiom och vardagliga uttryck: Använd fraser som "bita i det sura äpplet" eller "en välsignelse i förklädd". Dessa är ofta för nyanserade för AI att använda korrekt och naturligt.

Intressant nog överlappar många av principerna för att humanisera AI-innehåll med allmänna bästa praxis för att skriva bra. Genom att fokusera på röst och autenticitet kringgår du inte bara detektorer; du blir en bättre skribent. För en djupare dykning, utforska dessa strategier för att skapa engagerande innehåll.

Diversifiera ditt ordförråd och frasering

AI-modeller har en lista med "favoritord". De lutar sig tungt på vissa formella och generiska termer eftersom de är statistiskt vanliga i data de tränades på. Ditt mål är att upptäcka dessa repetitiva ord och byta ut dem mot mer intressanta, mindre förutsägbara alternativ.

Tänk på det som att lägga till kryddor i en intetsägande rätt. Dumpa de tråkiga verben och adjektiven för mer dynamiska.

| Vanligt AI-ord | Humaniserat alternativ |

|---|---|

| Dessutom | Utöver det / Plus |

| Följaktligen | Som ett resultat / Så |

| Avgörande / Vitalt | Nyckel / Ett måste |

| Sammanfattningsvis | För att runda av / I slutändan |

De bästa anti-AI-detektorsteknikerna fokuserar på att göra text mindre perfekt. Mänskligt skrivande är fyllt med egenheter, något ovanliga ordval och avsiktliga stilistiska avvikelser. Omfamna lite imperfektion för att uppnå äkta autenticitet.

Faktakolla och lägg till kritisk insikt

Sluligen, lita aldrig blint på informationen en AI ger dig. Språkmodeller är kända för att "hallucinera", självsäkert påstå saker som är helt fel. Det enskilt viktigaste humaniseringssteget är att manuellt verifiera varje enskilt påstående, statistik och datapunkt.

Men stanna inte bara vid att vara noggrann. Gå djupare genom att lägga till din egen kritiska analys.

- Ifrågasätt AI:ns output: Är denna slutsats verkligen meningsfull? Finns det ett annat perspektiv att överväga?

- Lägg till din egen analys: Förklara varför ett visst faktum spelar roll eller vad dess implikationer är. Till exempel, om en AI säger att en marknad kommer att växa med 10%, lägg till din analys om vilka specifika segment som kommer att driva den tillväxten.

- Koppla disparata idéer: Dra kopplingar mellan punkter som AI:n var för linjär för att göra.

Detta lager av mänsklig intelligens och kritiskt tänkande är ditt ultimata försvar mot detektering. Det lyfter innehållet från en enkel sammanfattning av information till ett värdefullt, insiktsfullt stycke som är obestridligen ditt.

Att navigera det etiska labyrinten av AI-humaniserare

Kraften i ett anti-AI-detektor-verktyg väcker en kritisk fråga: var ligger ansvaret? Å ena sidan är dessa verktyg fantastiska för att polera utkast och krossa igenom skrivarblockering. Å andra sidan kan de vara en genväg till akademisk oärlighet. Det är avgörande att dra en fast linje.

Tänk på en AI-humaniserare mindre som en trollstav som skapar arbete ur tomma intet och mer som en otroligt avancerad stavningskontroll. Dess verkliga jobb är att polera, förtydliga och lyfta text som du redan har konceptualiserat och strukturerat. Kärnidéerna, argumenten och insikterna måste börja med dig.

AI som en startplattform, inte en fallskärm

Det mest ansvarsfulla sättet att närma sig AI-humaniserare är att behandla AI-genererad text som en startpunkt – en startplattform för ditt eget tänkande. AI är briljant på att spottas ut ett generiskt, grundläggande utkast. Den kan sammanfatta komplexa ämnen eller skissera nyckelpunkter på sekunder, vilket sparar dig en massa tid.

Men den initiala outputen är bara råmaterial. Ditt jobb är att bygga på den, utmana dess antaganden och injicera ditt unika perspektiv och analys.

Den etiska linjen korsas i samma ögonblick som AI:ns bidrag överväger ditt eget. Om det slutliga arbetet inte återspeglar ditt kritiska tänkande, personliga röst och intellektuella ansträngning, använder du inte längre ett verktyg – du delegerar ditt ansvar.

Denna skillnad är allt. Att använda en AI för att hjälpa till att utarbeta en disposition eller förklara ett knepigt koncept är bara smart. Men att skicka in en lätt omformulerad AI-uppsats som din egen? Det undergräver helt akademisk och professionell integritet.

Pelarna för ansvarsfull användning

För att hålla dig på rätt sida av den etiska skiljelinjen, håll dig till dessa vägledande principer. De kommer att hjälpa dig att använda AI-humaniserare för att förbättra ditt arbete utan att kompromissa med din integritet.

- Du är författaren: Det slutliga stycket måste vara en produkt av din intellektuella arbete. AI kan hjälpa med meningsstruktur och ordval, men analysen, bevisen och slutsatserna måste vara dina.

- Originaltanke är kung: Använd AI för att övervinna en skrivblockering, inte en tankeblockering. Målet är att artikulera dina idéer mer effektivt, inte att låta maskinen ha idéerna åt dig.

- Faktakontroll är icke-förhandlingsbar: Du är 100% ansvarig för noggrannheten i varje påstående i ditt arbete. AI-modeller kan och gör upp saker, så du måste verifiera varje statistik, datum och faktum på egen hand.

Ett ramverk för etisk tillämpning

Så hur ser detta ut i verkligheten? Låt oss överväga ett par scenarier för att etiskt använda ett anti-AI-detektor-verktyg.

Etisk användning: En student använder ChatGPT för att generera en sammanfattning av tre olika ekonomiska teorier för en uppsats. Hon skriver sedan sin egen analys som jämför och kontrasterar dem. Slutligen använder hon en AI-humaniserare för att förfina sin prosa och säkerställa att den flödar naturligt och låter mänsklig. Här tjänade AI:n som en forskningsassistent, men det kritiska tänkandet var helt hennes.

Oetisk användning: En marknadsförare genererar ett helt blogginlägg med ett AI-verktyg, byter ut några ord och kör det genom en humaniserare för att kringgå detektorer innan den publicerar det som originalinnehåll. Detta är i princip plagiat, eftersom det grundläggande intellektuella arbetet gjordes av maskinen, inte personen.

Genom att anta detta tankesätt kan du med självförtroende använda dessa kraftfulla verktyg för att bli en mer effektiv och polerad skribent, allt medan du håller din integritet intakt.

Den praktiska tillämpningen: En anti-AI-detektor i aktion

All teori är bra, men låt oss se hur detta fungerar i verkligheten. Detta är där vi går från abstrakta koncept till en praktisk titt på hur ett verktyg kan omvandla ett platt, AI-genererat stycke till något som känns genuint mänskligt. Hela processen är byggd för hastighet och enkelhet.

Låt oss börja med ett textstycke direkt från en AI. Det är rent, grammatiskt korrekt och får fram poängen. Men det är också lite... livlöst. Det har den förutsägbara rytmen och säkra ordvalet som AI-detektorer är tränade att upptäcka på en mils avstånd. Detta är exakt den typ av skrivande som flaggas för sin robotiska struktur och låga perplexitet.

Från robotisk till realistisk i tre enkla steg

Med ett verktyg som HumanText.pro är arbetsflödet otroligt enkelt. Tanken är att ta det AI-utkastet, låta teknologin peka ut dess maskinliknande drag och sedan skriva om det för att låta helt naturligt – allt utan att ändra kärnbudskapet.

Här är uppdelningen i bara tre steg:

- Klistra in och analysera: Du sparkar igång genom att klistra in din råa AI-text direkt i verktyget. Det kör en snabb skanning och ger dig vanligtvis en poäng som visar hur troligt det är att flaggas av detektorer.

- Humanisera med ett klick: Detta är den magiska knappen. Du trycker på "Humanisera", och algoritmen går till jobbet. Det handlar inte bara om att byta ord; det handlar om att omstrukturera meningar, variera ordförrådet och justera det övergripande flödet för att göra det mindre förutsägbart.

- Granska och kör: På sekunder får du den omskrivna versionen. Outputen är redo att användas, justerad precis tillräckligt för att anta de subtila egenheter och nyanser av mänskligt skrivande.

Denna bild ger dig en perfekt före-och-efter-ögonblicksbild, som visar hur en hög AI-detekteringspoäng vänds till en mänsklig.

Den verkliga lärdomen här är den dramatiska förändringen i textens DNA. Den humaniserade versionen har mer variation i meningslängd och använder mindre vanliga ordkombinationer, vilket gör den statistiskt nästan identisk med något en person skulle skriva. För att dyka djupare in i tekniken som gör detta möjligt, kolla in vår fullständiga guide om AI-innehållshumaniseraren.

Bortom ett enda verktyg

Fördelarna är tydliga: det är snabbt, enkelt och det fungerar. Detta visar hur dessa verktyg kan glida in i en effektiv och etisk skrivprocess. Medan vi är fokuserade på humaniserare här är det värt att komma ihåg att de är en del av ett mycket större ekosystem av olika AI-innehållsverktyg utformade för alla typer av kreativa behov.

Genom att hantera de tråkiga delarna av redigering ger en AI-humaniserare dig tillbaka tiden att fokusera på vad som verkligen spelar roll: idéerna, argumenten och de unika insikter som bara en människa kan ta med. Det är ett smart sätt att polera AI-assisterade utkast till verkligt autentiskt arbete.

Dina frågor om AI-detektorer, besvarade

Världen av AI-skrivande och detektering är full av gråzoner. Om du känner dig lite vilsen är du inte ensam. Låt oss reda ut några av de vanligaste frågorna vi hör.

Kan AI-detektorer någonsin vara 100 procent korrekta?

Absolut inte. Det är omöjligt för någon AI-detektor att uppnå 100% noggrannhet. Dessa verktyg är byggda på sannolikheter och statistiska mönster, inte definitivt bevis. De gör en utbildad gissning, inte levererar en dom.

Detta betyder att de alltid kommer att ha en felmarginal, vilket leder till både falska positiva (flagga mänskligt skrivande som AI) och falska negativa (missa AI-genererad text). Saker som din personliga skrivstil, ämnets komplexitet eller till och med den specifika AI-modellen som används kan kasta en detektor ur balans.

Tänk på en detekteringspoäng som ett förslag, inte en dom. Det är en datapunkt som kräver mänsklig granskning, inte en slutgiltig bedömning. En anti-AI-detektor hjälper helt enkelt att förskjuta textens statistiska profil för att se mer ut som de mönster människor naturligt skapar.

Är det oetiskt att använda ett anti-AI-detektorverktyg?

Etiken kokar ner till en enkel sak: din avsikt.

Använder du ett verktyg för att polera ett AI-assisterat utkast, få det att flöda bättre och låta mer som dig? Det är bara smart redigering. Det är inte annorlunda än att använda en sofistikerad grammatikkontroll för att förfina ditt arbete.

Men om ditt mål är att skicka in 100% AI-genererat arbete som din egen originaltanke – särskilt i skolan eller på jobbet – har du korsat en linje. Det etiska tillvägagångssättet är att använda AI som en medarbetare, inte en spökskribent. Du levererar idéerna, du har det sista ordet och du tar ansvar för den färdiga produkten.

Hur kringgår AI-humaniserare faktiskt detektering?

AI-humaniserare fungerar genom att i princip reverse-engineera detekteringsprocessen. De vet vad detektorer letar efter och systematiskt demonterar dessa mönster.

De börjar med att bråka med textens rytm, variera meningslängder och strukturer för att skapa mer "burstighet" – den något oförutsägbara kadensen av mänskligt skrivande. De byter också ut vanliga, högprobabilitet AI-ordval mot mindre förutsägbart ordförråd, vilket sänker textens "perplexitet".

Kortfattat tar de ett textstycke som är statistiskt för perfekt och introducerar det subtila, organiska kaoset som definierar mänskligt uttryck, allt utan att ändra kärnbetydelsen.

Redo att förvandla dina AI-utkast till autentiskt, polerat innehåll som seglar förbi detektorer? Med HumanText.pro kan du humanisera din text med ett enda klick, vilket säkerställer att den låter naturlig och är redo för din publik. Prova det nu och se skillnaden själv.

Redo att förvandla ditt AI-genererade innehåll till naturligt, mänskligt skrivande? Humantext.pro förfinar din text omedelbart och säkerställer att den läses naturligt samtidigt som den kringgår AI-detektorer. Prova vår gratis AI-humaniserare idag →

Relaterade artiklar

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.