AI文本人性化工具无字数限制:长篇内容人性化实用指南

AI文本人性化工具无字数限制:学习实用的工作流程,将长篇内容无限制地转化为引人入胜、自然流畅的文章。

坦白说:真正无字数限制的AI文本人性化工具多少是个传说。您不会找到一个能一键完美人性化100,000字手稿的魔法按钮。大多数工具都有字符或字数上限,迫使您将论文或电子书分成小块逐一处理,既繁琐又令人沮丧。

处理大规模内容人性化

无论您是在为10,000字的论文苦恼的研究生,还是同时管理多篇文章的SEO专家,又或是正在撰写高密度学术论文的研究人员,问题始终相同。您手上有大量AI生成的文本需要变得真正像人类写的——不仅仅是为了应对如今更智能的AI检测工具,更是为了真正与读者产生共鸣。

常规的复制粘贴流程,每次处理300或500个字,不仅仅是枯燥乏味。它是工作流程的杀手。这种手动操作容易引入错误、搅乱文风,并浪费本应用于策略制定和精细打磨的宝贵时间。对于大规模创作内容的人来说,这是一个严重的瓶颈。

处理长篇内容时,挑战远不止简单的字数问题。真正的难题在于从头到尾保持作品的完整性。

长篇AI内容人性化的挑战

| 挑战 | 对您工作的影响 | 战略解决方案 |

|---|---|---|

| 上下文丢失 | 工具遗漏整体叙事脉络,导致泛化或不相关的改写。 | 按照逻辑上自成一体的段落(如章节、主要论点)来处理内容,以提供充足的上下文。 |

| 叙事断裂 | 段落之间的衔接崩塌,造成支离破碎、阅读体验不连贯。 | 让分块之间略有重叠,并手动审查过渡部分以确保流畅连贯的衔接。 |

| 语气不一致 | 您的文档最终读起来像是由一个委员会写的,语气和风格不断切换。 | 为人性化工具设定清晰的风格指南或参考语气,处理后手动编辑以保持一致性。 |

| 极端的时间低效 | 手动拆分和重新组装文本的劳动完全违背了使用AI提升速度的初衷。 | 采用系统化的“分块方法”来简化拆分和重组过程,将其转化为可预测的工作流程。 |

这些障碍表明,仅靠一个简单的工具是不够的;您需要一个更智能的流程。

为什么标准工具力不从心

大多数AI人性化工具是为快速任务设计的:电子邮件、社交媒体标题或短段落。它们的处理限制是一个实际的现实,与服务器成本以及在保持文本核心含义的同时进行改写的巨大复杂性有关。

当您试图将大型文档强行塞入这些工具时,局限性变得尤为明显:

- 上下文盲区: 一个只能看到您作品一小部分的工具,无法把握您已经建立的叙事线索、论点或专业术语。这就像让人只看了30秒的片段就要描述一部电影。

- 断裂的衔接: 逐章处理常常会打碎思想之间的逻辑桥梁。留下的是一堆互不关联的段落,让读者费力理解。

- 手工劳动陷阱: 将大文档切碎、处理、再拼接回来所需的工作量是巨大的。它完全抵消了AI本应带来的效率提升。

真正的挑战不仅仅是通过检测器;而是保留长篇文章的灵魂和连贯性。一篇人类评分达到**100%**但读起来像一团乱麻的文档是完全失败的。

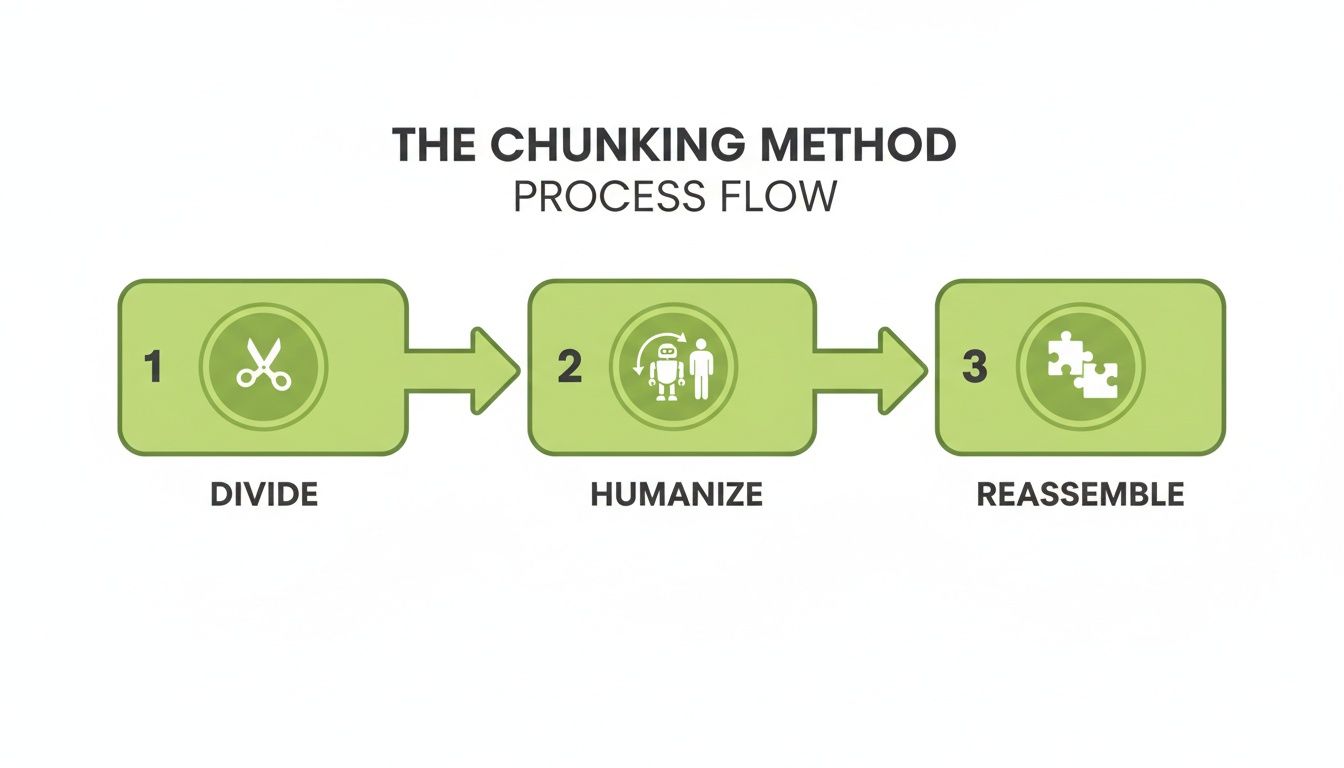

正是在这里,拥有一个战略性的工作流程能产生巨大的差异。与其寻找传说中的无字数限制AI人性化工具,真正的解决方案是采用方法论。我发现的最有效策略是“分块方法”——一个智能地拆解、人性化和重组大型文档以保持质量的系统。它将一项令人望而生畏的任务转变为可管理、可重复的流程。

要深入了解不同工具及其优势,请查看我们关于各类内容可用的最佳AI人性化工具选项的指南。

完美人性化的分块方法

假设您面前有一份庞大的文档——论文、电子书,或者一篇几千字的支柱页面。试图一次性人性化整个文档就像试图把大海煮沸。这既低效,又经常把您使用的工具搞崩溃。

相反,您需要一个更智能的方法。我们称之为分块方法。核心就是将文本的大山分解成可管理的、合乎逻辑的小块。

把自己想象成一个规划建筑的建筑师,而不是随意拆墙的拆迁队。您需要沿着文档的自然结构线进行分割,以保持上下文和流畅性。

以下是选择分块方式的实用指南:

- 研究论文: 按核心章节来拆分——引言、文献综述、方法论、结果和结论。每个部分都是独立的论证单元,非常适合逐一处理。

- 长篇博客文章: H2小标题是您最好的帮手。它们本身已经标示了话题的转换,是最自然的分割点。

- 电子书或小说: 这很简单。按章节来。每个章节都有自己的叙事小弧线,是输入人性化工具的理想单位。

这种策略确保在处理每个片段时,AI拥有足够的上下文来理解该部分所要表达的具体观点,从而产生更好、更相关的输出。

找到分块大小的最佳平衡点

完美的分块大小是一种平衡艺术。您需要足够多的文本来保持叙事完整性,但又不能多到让工具不堪重负。

包括HumanText.pro在内的大多数人性化工具提供约500字的慷慨免费试用额度。根据我的经验,这就是最佳平衡点。它足以涵盖一个完整的想法或几个详细的段落,而不会丢失论证的主线。

这就是标准人性化工具界面的样子——您只需将其中一个分块粘贴到输入框中即可。

简洁清晰的布局至关重要。当您处理几十个分块时,最不需要的就是复杂的工作流程。

将人性化后的内容重新拼接

所有分块处理完毕后,就到了重新组装的时候。不,这不仅仅是复制粘贴的工作。这时您需要戴上编辑的帽子,打磨不同片段连接处的接缝。

重点关注创建无缝过渡。有时,人性化工具可能用一个漂亮的总结性句子结束了一个分块,但下一个分块本应延续同一个思路。您需要手动调整这些句子来弥合间隙。

实操示例:

- 原始过渡(生硬): "……这就是为什么太阳能电池板是高效的。" [分块1结束] "地热能提供了另一种可持续选择。" [分块2开始]

- 改进的过渡(流畅): "……这就是为什么太阳能电池板是高效的。" [分块1结束] *"**虽然太阳能是一种热门选择,*但地热能提供了另一种可持续选择。" [分块2开始]

专业提示: 从头到尾大声朗读整篇重组后的文档。这是捕捉分块之间可能悄然出现的语气或风格不协调的最佳方法。您的目标是一种感觉完全出自同一人之手的统一声音。

对字数有感觉是优化这一流程的重要组成部分。要了解更多,请查看我们关于500字到底有多长的指南。这对于掌握您的分块策略将是一个极大的帮助。

让我们来看看实际操作。具体怎么做呢?

假设您有一篇关于可持续城市规划的、由AI生成的密集3,000字文章。事实都在,但读起来索然无味——生硬、机械,在每一个检测器面前都大喊"AI"。我们的任务是将其转变为引人入胜的,最重要的是,像人类写的内容。

第一步很简单:分块。将这个3,000字的庞然大物分成六个可管理的500字片段。关键是进行合乎逻辑的切割。我通常在H2小标题处分割文章。这样可以保持每个部分的核心论点完整,防止人性化工具丢失上下文、搅乱您的想法。

处理与质量检查

准备好六个分块后,我开始真正的工作。取第一个500字的段落,粘贴到HumanText.pro界面中,点击“人性化”。只需几秒钟。

但在跳到下一个分块之前,我会对输出进行快速质量检查。这对我来说是不可妥协的步骤。

每个片段的迷你检查清单:

- 信息完整性: 改写是否保留了原始事实和论点?例如,如果原文说“排放减少25%”,人性化后的文本不能只说“显著减少”。

- 语气一致性: 新文本是否仍然听起来专业且信息丰富?目标是让它听起来更好,而不是像完全不同的人写的。

对所有六个分块重复此过程,将每个人性化后的输出保存在新文档中。这是一种有条不紊的方法,但它保证了在最终组装之前每个部分都得到应有的关注。

这整个工作流程——分割、人性化、重组——就是有效处理长篇内容的关键。

像这样将巨大的任务分解为更小的、可控的步骤,是您保持质量控制并最终得到精致、无缝最终稿的方法。

重组与最终润色

所有分块人性化后,就到了重新拼接的时候。我按原始顺序重新组装各个部分。这不仅仅是简单的复制粘贴;我在查找分块之间的接缝,消除任何生硬的过渡,确保叙事自然流畅。

接下来,我将完整的3,000字文章通过AI检测器运行。我需要看到整篇文档而非孤立部分的高人类评分。

但最关键的最终步骤是简单的人工通读。我总是大声朗读整篇文章。这是捕捉软件可能遗漏的奇怪表述或突兀句子的最佳方式。正是这种润色将好内容与真正优秀的内容区分开来。

这个最终检查至关重要。毕竟,最好的工具的检测准确率也只在**65-90%**的范围内,所以人工验证是您的终极安全网。它确保内容不仅通过扫描,而且真正与真实读者产生共鸣。

如果您要处理大量内容,升级到HumanText.pro付费方案是理所当然的选择。它消除了字数限制,使整个工作流程更快、更高效。更多技巧请查看我们关于 https://humantext.pro/blog/chat-gpt-humanizer 如何提升您的流程的指南。您还可以将此工作流程与顶级AI内容日历工具集成,管理从创作到发布的整个内容管道。

自动化与规模化的进阶策略

如果您在运营一家内容代理机构、管理大量SEO网站,或者仅仅是有海量文本需要处理,手动分块流程确实令人头疼。手动复制、粘贴和重组文本是一个严重的瓶颈,它蚕食了您使用AI所获得的速度优势。

当您每周处理几十篇文章时,那个"快速"的手动流程会不断累积。要真正在大批量工作中取得成效,您必须超越浏览器,拥抱自动化。

这就是API(应用程序编程接口)成为您新的得力助手的地方。把它想象成从您的系统到HumanText.pro等AI人性化工具的直通线路,无需人工点击。您可以构建一个精巧的流水线来自动化整个序列,而不是每次只喂给机器一小段文本。

构建自动化人性化流水线

设置自动化工作流程听起来比实际操作更令人生畏。核心思路很简单:创建一个系统,可以获取长文档、将其切成完美大小的分块、将每个分块发送到人性化工具的API、然后整齐地将处理后的文本拼回来。

您不需要是开发者也能做到。这可以通过简单的脚本甚至Zapier或Make等无代码平台来实现。想象一下,将一篇新的AI草稿文章放入Google Drive文件夹后,整个人性化过程就会在后台自动启动。

实际操作如下:

- 触发器: 一个新文件被添加到特定的Google Drive文件夹中。

- 动作1(自动分块): Zapier或Make.com工作流程自动将文档分割成500字的文本分块。

- 动作2(API调用): 工作流程将每个分块逐一发送到HumanText.pro API端点。

- 动作3(重组): 脚本收集所有人性化后的输出,在另一个Google Drive文件夹中创建一个新文档,等待最终审查。

构建这样的流水线是扩展您内容运营的关键。曾经需要一小时手工劳动的工作流程可以在几分钟内完成,让您的团队专注于战略、编辑和创意任务。

当您考虑到这些内容的来源,比如强大的AI新闻稿生成器,就能理解为什么在后端拥有一个精简的人性化流程如此重要。

在规模化运营中管理成本和质量

虽然自动化在效率方面是颠覆性的,但它确实带来了一些需要关注的新问题。当您大批量运营时,必须明智地管理成本并保持质量。

成本管理: 大多数API访问采用按需付费模式,通常按字符或字数计费。在全面开启自动化之前,先做一些粗略计算。估算您的月度处理量并建模潜在成本,以免出现意外。设置使用量监控警报也是个好主意。

质量保证: 自动化速度快,但并不完美。最终的人工把关是不可妥协的。在流水线末端加入一个快速质量检查环节。文档重组后,让人进行最终通读,消除分块之间的生硬过渡或修正机器可能遗漏的奇怪措辞。这最后的润色确保您大规模生产的内容仍然达到高标准。

避免AI人性化中的常见陷阱

当您逐块处理长文档时,如果不注意,一些微妙的问题会暗中破坏最终成品。即使是最精巧的无字数限制AI人性化工具工作流程也需要敏锐的眼光来发现这些常见错误。两个最大的罪魁祸首是语气不一致和上下文丢失——两者都可能完全损害您内容的可信度。

语气不一致对读者来说非常刺耳。想象一下,您电子书的一章读起来像一篇死板的学术论文,而下一章却像一篇随性的闲聊博客。当人性化工具在处理孤立的分块时,对每个片段做出不同的风格选择,就会出现这种情况。留下的是一堆不连贯的混乱。

然后是上下文丢失。这发生在工具无法看到全貌的时候。它可能会遗漏您在前面部分精心建立的关键细微差别、反复出现的主题或专业术语。这导致泛化的,甚至自相矛盾的改写。人性化工具可能在一个分块中简化了一个术语,却在另一个分块中保持高度专业化,让读者完全困惑。

必不可少的一致性编辑

要解决这一切,您必须在将人性化后的分块拼接回来后进行专门的"一致性编辑"。这是您统一文档声音、消除粗糙过渡的机会。这是一个不可妥协的步骤。

以下是一致性编辑的可操作检查清单:

- 统一声音和语气: 阅读每个主要部分的第一段。它们听起来像是同一个人写的吗?如果不是,调整用词。示例: 如果文档其余部分更加口语化,将某个部分的“运用”替换为“使用”。

- 打磨过渡: 检查段落分隔后每个段落的第一句话。它与前一个想法衔接吗?如果不是,添加一个简单的衔接短语。示例: 将“数据显示了一个趋势”改为“承接上述观点,数据也显示了一个趋势”。

- 检查关键术语: 使用文字处理器的搜索功能(Ctrl+F或Cmd+F)查找关键术语。您在开头引入了缩略词"SEO"吗?确保在后面的章节中没有再次拼写为"Search Engine Optimization"。

这种一致性编辑远不止是校对。它是将一根根独立的线重新编织成一幅完整无缝的织锦。正是这一步将一系列写得不错的段落提升为一份真正连贯、有影响力的文档。

最终的人工审阅

无论您的工具多么精密,都无法取代最终的人工审阅。这最后一遍通读是您捕捉自动化无法复制的细微错误并添加最终润色层的机会。这是注入个性、复核事实、确保内容与受众真正产生共鸣的时刻。

对于规模化制作网页文案的代理机构来说,整个流程堪称救星。您可以粘贴原始内容、即时获得AI评分、几秒钟内完成人性化,保留核心含义的同时增添关键的真实感层次。这正是HumanText.pro大放异彩的地方,它使用基于超过120万个样本训练的语言模型来模拟自然写作——您甚至不需要注册试用。自由职业者告诉我们,它能将精致的AI文本转化为通过所有检测的引人入胜的帖子,帮助他们顺利获取客户。更多信息请查看在papergen.ai上了解这些方法。

关于长篇内容人性化的常见问题

面对一座AI文本的大山,几个问题总会浮现。对流程的操作细节、影响和安全性感到好奇是自然的。让我们来回答用户在处理大型项目时最常问的问题。

这种方法真的适用于书籍或论文吗?

当然可以。这正是分块策略的设计目的。您不会一次性将整部80,000字的手稿粘贴到工具中——那只会造成混乱。取而代之,您要分解它。

实操建议: 对于论文,将每一章(引言、文献综述、方法论等)视为独立的项目。先人性化第一章中的所有部分,对该章进行一致性编辑,然后才进入第二章。这将工作分区化,防止感到不堪重负。对于书籍,使用同样的逐章方法。

分批人性化会损害SEO吗?

恰恰相反——它应该大幅提升SEO。搜索引擎每天都在变得更加智能,它们已经非常擅长识别机械化的、无益的内容。当您人性化文本时,即使是分块处理,最终产品也更加自然、更加引人入胜。这对SEO来说是巨大的胜利。

只要您将文章按逻辑重新组装并保持关键词焦点,这个过程就会让您的内容对真实读者更好。而对读者好的,现在就是对Google好的。

现代SEO的黄金法则是为读者提供真正的价值。人性化的内容本质上更有价值,因为它更清晰、更引人入胜、更有真实感。

最终,这种方法使您与搜索算法所设计要奖励的方向完全一致。

HumanText.pro如何保护我的敏感文档?

我们理解。交付敏感的学术研究或机密商业计划是一件大事。这就是为什么我们以严格的隐私优先政策构建了HumanText.pro:我们不存储、不共享、不使用您的内容做任何事情,尤其不用于训练我们的模型。

您处理完文本并关闭会话的那一刻,数据就从我们这端消失了。这适用于所有人,无论您使用的是免费试用还是付费方案。您的专有信息始终完全保密、安全,最重要的是——永远属于您。

准备好不再为字数限制烦恼,开始创作能与读者产生共鸣的内容了吗?HumanText.pro为您提供一套清晰、高效的工作流程,将任意长度的文本进行人性化处理。将AI草稿转化为读者真正愿意阅读的高质量文章。

访问 https://humantext.pro 免费开始使用。

准备好将AI生成的内容转化为自然、人性化的文字了吗? Humantext.pro 能即时优化您的文本,确保阅读自然流畅,同时绕过AI检测器。 立即免费试用我们的AI人性化工具 →

相关文章

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.