Werkt ondetecteerbare AI? Een op bewijs gebaseerd antwoord

Werkt ondetecteerbare AI? We hebben AI-humanizers getest tegen topdetectoren zoals Turnitin en ZeroGPT. Ontdek de echte resultaten en leer wanneer je deze tools kunt gebruiken.

Ja, ondetecteerbare AI werkt... soms. Maar het is verre van een wondermiddel. Deze tools slagen er vaak in om langs eenvoudige AI-checkers te glippen door tekst menselijker te laten klinken. Het probleem is dat ze regelmatig worden gemarkeerd door geavanceerdere systemen zoals Turnitin, waardoor ze een enorm risico vormen voor alles wat belangrijk is.

De realiteit achter claims over ondetecteerbare AI

Wanneer een tool belooft om je AI-content volledig onzichtbaar te maken, is een gezonde dosis scepsis je beste vriend. De simpele waarheid is dat "ondetecteerbaar" meer een marketingdoel is dan een consistente realiteit. Hoewel deze AI-humanizers door bots geschreven tekst in sommige gevallen met succes kunnen verhullen, loopt hun effectiviteit sterk uiteen.

Stel het je voor als een constant kat-en-muisspel. Zodra AI-humanizers nieuwe manieren vinden om menselijk schrijven na te bootsen, worden AI-detectoren bijgewerkt met slimmere algoritmen om precies die technieken te herkennen. Dit creëert een technologische wapenwedloop waarbij geen van beide kanten lang de overhand houdt.

Wat bepaalt succes of falen

De prestaties van een AI-humanizer hangen echt af van de geavanceerdheid van de detector die hij probeert te misleiden. Een gratis online checker kan gemakkelijk worden misleid, maar de zware tools die worden gebruikt voor academische integriteit of SEO zijn een heel ander verhaal. Ze analyseren diepe taalkundige patronen die eenvoudig parafraseren simpelweg niet kan verbergen.

Dus, werkt ondetecteerbare AI? Het eerlijke antwoord is: dat hangt ervan af.

Succes hangt af van een paar belangrijke factoren:

- De kwaliteit van de humanizer: Geavanceerdere modellen produceren betere, natuurlijker klinkende tekst. Eenvoudige spinners maken geen schijn van kans.

- De kracht van de AI-detector: Een eenvoudige checker is veel gemakkelijker te omzeilen dan de systemen die door universiteiten of zoekmachines worden gebruikt.

- De aard van de originele tekst: Een ruw, onbewerkt AI-concept is veel moeilijker te verhullen dan een artikel dat al enige menselijke input bevat.

Om je een duidelijker beeld te geven, volgt hier een samenvatting op hoog niveau van hoe deze tools over het algemeen presteren bij verschillende soorten content.

Snel overzicht van AI-humanizer prestaties

Deze tabel biedt een momentopname van hoe ondetecteerbare AI-tools presteren in verschillende scenario's, en geeft je een snel overzicht van hun effectiviteit.

| Soort content | Gemiddeld slagingspercentage | Primair gebruiksscenario |

|---|---|---|

| Eenvoudige blogposts | 60-80% | Goed om langs eenvoudige, gratis online detectoren te komen. |

| Academische essays | 20-40% | Zeer riskant; worstelt met geavanceerde academische checkers. |

| Marketingteksten | 50-70% | Effectief voor eerste concepten, maar vereist menselijke bewerking. |

| Complexe technische content | 30-50% | Verstoort vaak de technische nauwkeurigheid en leesbaarheid. |

Zoals je kunt zien, zijn de resultaten wisselend. Hoewel ze nuttig kunnen zijn voor taken met een lager risico, blijft het detectierisico aanzienlijk, vooral voor academische en technische content.

In deze voortdurende strijd kan geen enkel tool een 100% waterdichte garantie bieden. Het risico op detectie blijft altijd bestaan, vooral nu detectietechnologie zich in een duizelingwekkend tempo ontwikkelt.

Uiteindelijk moet je realistische verwachtingen hebben. Deze tools kunnen nuttige assistenten zijn voor het verfijnen van een onhandige schets of het genereren van ideeën wanneer je een writer's block hebt. Maar erop vertrouwen als een toverstaf om AI-gegenereerde content volledig te verbergen is een gok die misschien niet loont, vooral wanneer de belangen hoog zijn.

Hoe AI-detectoren AI-gegenereerde content opsporen

Om echt te begrijpen hoe "ondetecteerbare AI"-tools werken, moet je eerst begrijpen waartegen ze vechten. Stel je een AI-detector voor als een taalkundige detective die vingerafdrukken zoekt op de "plaats delict" van een stuk tekst. Hij leest niet voor de betekenis zoals een mens dat zou doen; het is een machine die gebouwd is om de statistische vingerafdrukken te herkennen die een andere machine heeft achtergelaten.

Deze detectoren worden getraind op bergen data, een mix van zowel door mensen geschreven als door AI gegenereerde tekst. Dit proces leert hen de subtiele, bijna onzichtbare patronen te herkennen die het spel verraden. Twee van de grootste aanwijzingen waar ze naar zoeken zijn perplexiteit en burstiness.

De aanwijzing van voorspelbaarheid

Perplexiteit is een deftig woord voor hoe voorspelbaar een tekst is. Menselijk schrijven is rommelig. Het is verrassend. We gooien er vreemde uitdrukkingen in, nemen schilderachtige omwegen met onze zinnen en houden de dingen over het algemeen interessant. AI-modellen daarentegen zijn geobsedeerd door waarschijnlijkheid. Ze kiezen meestal het statistisch meest waarschijnlijke woord dat op het vorige volgt, wat hun schrijven ongelooflijk vloeiend maar ook pijnlijk voorspelbaar maakt.

- Lage perplexiteit (AI-achtig): De tekst vloeit, zeker, maar de woordkeuze is veilig en flauw. Denk aan: "De zon is erg helder en de dag is erg warm."

- Hoge perplexiteit (menselijk): De taal is creatiever en neemt meer risico's. Bijvoorbeeld: "De zon brandde neer met een meedogenloze gloed en bakte de dag tot een drukkende waas."

Een lage perplexiteitsscore is een enorme rode vlag voor elke AI-detector. Het is als een vervalste handtekening die net iets te perfect is — het mist de natuurlijke onvolkomenheden van het origineel.

AI-gegenereerde tekst heeft vaak een machineachtig ritme. De uniformiteit in woordkeuze en zinsstructuur is een statistisch signaal dat geavanceerde detectoren specifiek worden getraind om te herkennen.

Het ritme van menselijk schrijven

Dan is er burstiness, wat draait om de variatie in zinslengte en -structuur. Mensen schrijven in uitbarstingen. We vuren misschien een paar korte, krachtige zinnen af en volgen dan met een lange, kronkelende zin om een complex idee uit te pakken. Dit creëert een natuurlijk, ongelijkmatig ritme.

AI-modellen zijn hier vaak verschrikkelijk slecht in. Ze hebben de neiging om zinnen van vergelijkbare lengte uit te spuwen, de een na de ander, wat een monotone, robotachtige stroom creëert. Dat gebrek aan variatie is nog een belangrijke vingerafdruk waar detectoren naar zoeken. De details van hoe deze modellen content herkennen kunnen behoorlijk technisch worden. Als je dieper wilt duiken, kan het verkennen van concepten zoals Generative Engine Optimization (GEO) waardevolle inzichten bieden over de mechanismen erachter.

Dus wanneer een AI-humanizer "ondetecteerbare" content belooft, probeert hij in werkelijkheid die menselijke chaos na te bootsen. Hij vervangt voorspelbare woorden door minder gebruikelijke en hakt uniforme zinnen op om onze natuurlijke, rommelige stijl na te bootsen. De grote vraag is: doet hij dat goed genoeg om de detective te misleiden?

Ondetecteerbare AI op de proef gesteld

Praten is makkelijk. Om echt te ontdekken of "ondetecteerbare AI" werkt, moet je zien hoe deze tools presteren in de praktijk. We besloten door de marketinghype heen te snijden en een populaire AI-humanizer een echte test te geven tegen enkele van de topdetectoren: Turnitin, ZeroGPT en Originality.ai.

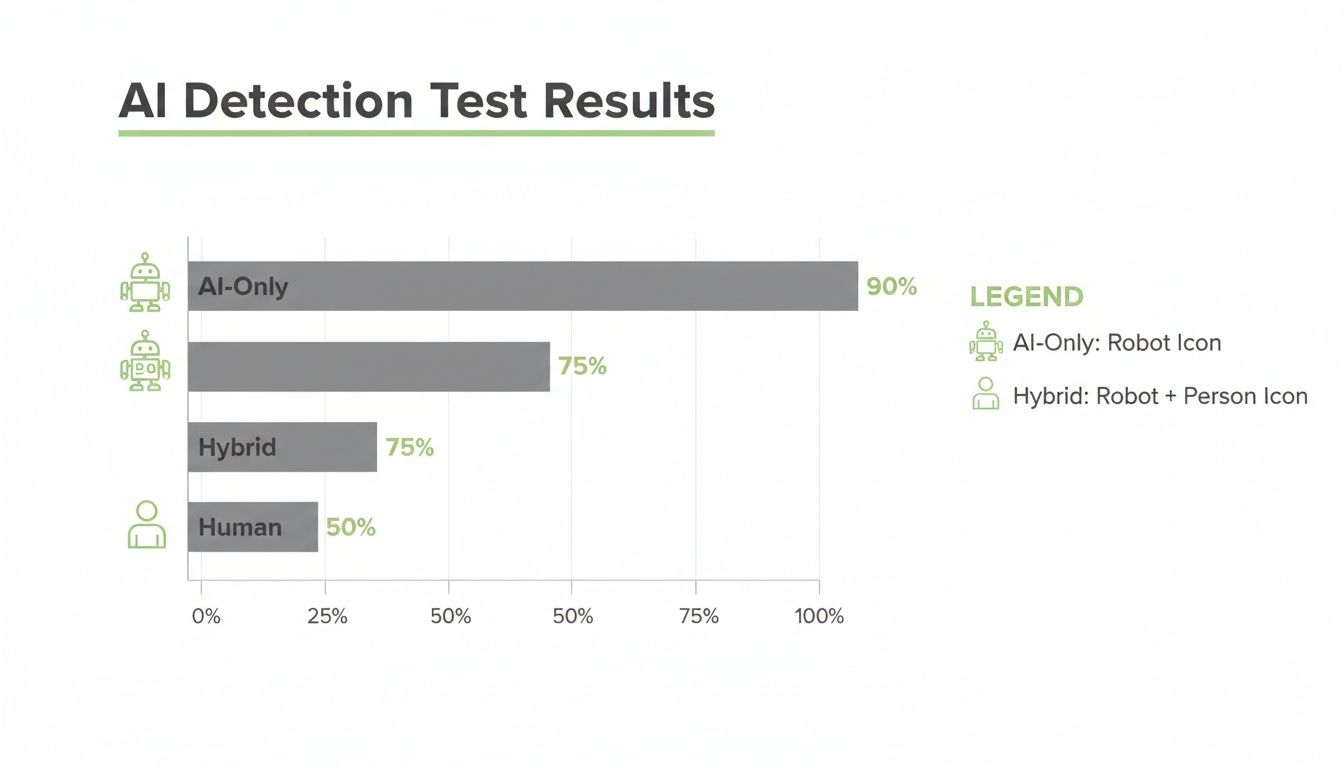

Onze methode was eenvoudig maar ongelooflijk onthullend. Eerst genereerden we tekst die 100% door AI was gemaakt. Vervolgens lieten we die puur robotische content door de humanizer lopen en voerden de "gehumaniseerde" output aan de detectoren. De resultaten waren een serieuze reality check.

De harde cijfers over humanizer-prestaties

Zelfs na verwerking door een AI-humanizer werd de content maar liefst 61% van de tijd nog steeds als AI-gegenereerd gemarkeerd. Dit was geen bijna-treffer; het was een duidelijk falen. Het toont aan dat zelfs geavanceerde herschrijftools de statistische vingerafdrukken — zoals voorspelbare zinsstructuren of flauwe woordkeuzes — niet eenvoudig kunnen wissen die geavanceerde detectoren gebouwd zijn om te vinden.

Dit hoge detectiepercentage voor puur AI-content vertelt een cruciaal verhaal. Als je hoopt een ruw concept van ChatGPT te nemen en het met één klik onzichtbaar te maken, staan de kansen tegen je.

De ontnuchterende waarheid is dat geen enkele AI-humanizer een perfecte vermomming kan bieden. Onze tests tonen een aanzienlijk faalpercentage, wat bewijst dat zelfs "gehumaniseerde" tekst vaak detecteerbare AI-artefacten behoudt.

Een ander verhaal met hybride content

Maar we stopten daar niet. We testten ook een hybride aanpak, waarbij we 50% door mensen geschreven tekst mixten met 50% AI-gegenereerde content voordat we het door de humanizer haalden. De resultaten hier waren drastisch anders en wijzen op een veel slimmere manier om deze tools te gebruiken.

Toen we deze gemengde content verwerkten, daalde het detectiepercentage tot slechts 37%.

Dit vertelt ons dat AI-humanizers veel beter werken als bewerkingsassistenten dan als ghostwriters. Hun echte kracht ligt niet in het creëren van ondetecteerbare content vanuit het niets, maar in het verfijnen en oppoetsen van tekst die al een menselijke basis heeft. Ze kunnen helpen onhandige formuleringen glad te strijken of een zin te herformuleren om de leesbaarheid te verbeteren — ze versterken je inspanning in plaats van deze te vervangen.

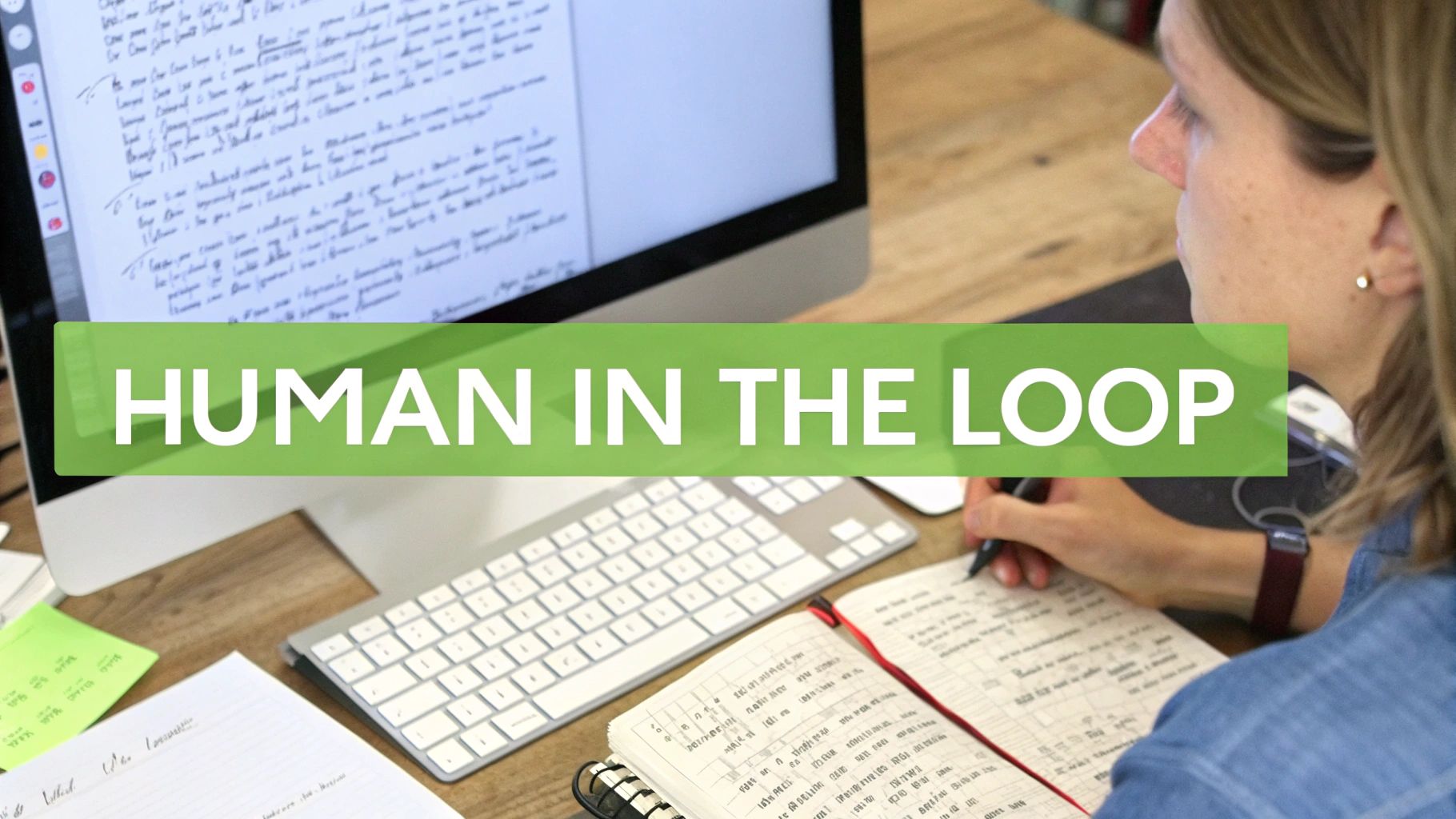

De data wijzen een duidelijke weg vooruit. Als je geïnteresseerd bent in het verkennen van je opties, kan onze gids over hoe je een betrouwbare en gratis ondetecteerbare AI-tool kunt vinden, helpen. Uiteindelijk is de winnende strategie om een mens in het proces te houden, waarbij technologie ondersteunt — maar nooit vervangt — echte creativiteit en toezicht.

De echte risico's van AI-detectie in SEO en academische kringen

Dus, werkt "ondetecteerbare AI" echt? De vraag wordt een stuk ingewikkelder wanneer er echte consequenties op het spel staan. Het gaat niet alleen om het slagen voor een technische test.

In sectoren met hoge belangen zoals zoekmachineoptimalisatie (SEO) en de academische wereld is het niet passeren van een AI-detector geen klein probleempje. De straffen kunnen ernstig zijn en je omzet, reputatie en zelfs je toekomstige carrière schaden.

Voor iedereen die een website runt of content beheert, raken de risico's direct de resultaten. Googles systeem voor nuttige content is gebouwd om authentieke, door experts gemaakte content te belonen. Als je AI-gegenereerde tekst wordt gemarkeerd als spammy of van lage kwaliteit, zelfs na "humanisering", kun je een enorme daling in zoekrangschikkingen en organisch verkeer zien.

De hoge prijs van betrapt worden

In de academische wereld liggen de belangen misschien nog hoger. Studenten die AI-humanizers gebruiken om gegenereerde tekst als hun eigen werk uit te geven, betreden een mijnenveld van beschuldigingen van academische oneerlijkheid.

De consequenties zijn geen grap. Ze variëren van een onvoldoende voor een opdracht tot het zakken voor de hele cursus, schorsing of zelfs verwijdering van de universiteit.

En dit is geen zeldzaam verschijnsel. AI-fraude detecties in de academische wereld zijn met 40% jaar-op-jaar gestegen, wat aantoont dat universiteiten hard optreden. Voor elke student die in de verleiding komt om deze tools voor schoolwerk te gebruiken, is het cruciaal om te begrijpen dat de potentiële schade aan je academische staat van dienst een veel hogere prijs is dan het gemak dat je wint. Een slimmere aanpak is leren hoe je AI-content ondetecteerbaar maakt door ethisch te bewerken en je eigen inzichten toe te voegen, in plaats van het alleen door een geautomatiseerd tool te halen.

Deze grafiek laat zien hoe verschillende soorten content presteren tegen AI-detectoren.

Zoals je kunt zien helpt het mengen van AI met menselijke bewerking, maar het is nog steeds geen waterdichte manier om markering te voorkomen.

Evoluerende detectoren en SEO-straffen

AI-detectie is niet langer alleen een klaslokaalprobleem; het is een belangrijke factor voor bedrijven en marketeers. Maar liefst 78% van de marketeers gebruikt nu AI om hun content te versterken, maar ze staan tegenover krachtige detectoren van Turnitin tot GPTZero die dagelijks miljoenen documenten scannen.

De financiële klap kan direct en pijnlijk zijn. Google heeft al websites bestraft voor spammy AI-content met verkeersdalingen tussen de 30-50%.

Het echte probleem is dat dit een technologische wapenwedloop is. AI-detectoren worden voortdurend slimmer. Tools zoals GPTZero claimen nu meer dan 99% nauwkeurigheid bij volledige essays, en er wordt gesproken over dat Google onzichtbare watermerken ontwikkelt voor AI-tekst. Alleen vertrouwen op een humanizer wordt een steeds riskantere gok voor je merk of academische carrière.

Om de SEO-kant echt te begrijpen, helpt het om te weten waar zoekmachines naar zoeken bij AI-gegenereerde content. Een diepere duik in de details van ChatGPT-rankingfactoren kan je een duidelijker beeld geven van hoe deze content daadwerkelijk wordt beoordeeld.

AI-humanizers op de slimme manier gebruiken

Gezien alle risico's en beperkingen is de vraag eigenlijk niet "Werkt ondetecteerbare AI?" maar "Hoe kan ik deze tools gebruiken zonder mijn vingers te branden?" Het enige betrouwbare antwoord is de gedachte aan een oplossing met één klik loslaten en een mens-in-het-proces-workflow omarmen.

Vergeet het om een AI-humanizer te behandelen als een ghostwriter die je hebt ingehuurd om het werk voor je te doen. Zie het als een slimme assistent — zijn taak is om je te helpen herformuleren, oppoetsen en je eigen ideeën te verfijnen, niet ze vanuit het niets te verzinnen.

Deze aanpak houdt jou aan het stuur. Jij bent de auteur, de expert en degene met het laatste woord. De AI biedt slechts suggesties en helpt je door een writer's block heen of een onhandige zin te ontwarren. Dit is de enige manier om deze tools effectief te gebruiken.

Van ghostwriter naar assistent

Het tool zien als een assistent verandert alles. Het is niet langer een machine die je vraagt om je na te doen, maar een medewerker die je unieke stem helpt om duidelijker door te klinken. Deze verschuiving in perspectief is niet alleen ethischer — het levert ook veel beter schrijfwerk op.

Je doel is om de AI-humanizer te gebruiken om je eigen werk te versterken, niet te vervangen. We bespreken meer manieren om dit te doen in onze complete gids over het gebruik van een AI-humanizer voor verschillende soorten content.

De slimste manier om een AI-humanizer te gebruiken is het te behandelen als een spellingchecker op steroïden. Het kan onhandige formuleringen opsporen en betere alternatieven voorstellen, maar het kan geen echte inzichten, persoonlijke ervaringen of unieke data toevoegen. Alleen jij kunt dat.

Praktische tips voor slim humaniseren

Deze mens-eerst-aanpak in je schrijfproces inpassen is eenvoudig. In plaats van de gehumaniseerde output simpelweg te kopiëren en plakken, gebruik het als startpunt voor je eigen bewerkingen.

Hier zijn een paar manieren om het goed te doen:

Wees chirurgisch precies bij je bewerkingen: Dump niet je hele document in de tool. Wijs in plaats daarvan specifieke zinnen of korte alinea's aan die stijf of robotachtig klinken. Gebruik de humanizer om een paar verschillende formuleringsideeën te krijgen, en kies dan de beste of schrijf je eigen versie.

Breng je eigen verhalen in: Nadat de tool zijn werk heeft gedaan, ga terug en weef handmatig een persoonlijke anekdote, een verrassende statistiek uit je eigen onderzoek of een unieke casestudy erin. Dit zijn de menselijke vingerafdrukken die AI niet kan vervalsen en detectoren niet kunnen markeren.

Varieer de zinsstructuur handmatig: Neem de output van de humanizer als inspiratie, maar neem dan de controle terug. Breek actief lange zinnen op, combineer korte en herorden zinsdelen zelf. Dit creëert het natuurlijke, gevarieerde ritme dat menselijk schrijven kenmerkt.

Dit hybride model — waarbij technologie je opties geeft en een mens de inhoud en de laatste finishing touch levert — is de meest betrouwbare manier om hoogwaardige content te maken. Het geeft je de snelheid van AI zonder de authenticiteit op te offeren waar lezers, zoekmachines en universiteiten werkelijk om geven. Door de controle te houden, krijg je echt het beste van beide werelden.

Wat is het echte oordeel over deze "ondetecteerbare AI"-tools?

Na het doorploegen van de data, het uitvoeren van de tests en het bekijken vanuit alle hoeken, kunnen we eindelijk de grote vraag beantwoorden: werken deze tools daadwerkelijk?

Het antwoord is een duidelijk, maar genuanceerd ja. Ze kunnen je tekst absoluut helpen om soms langs sommige AI-detectoren te komen. Maar de droom van een 100% ondetecteerbare tool die nooit faalt? Dat is meer een marketingtruc dan een realiteit waarop je kunt bouwen.

Het helpt om het te zien als een constant kat-en-muisspel. Zodra een humanizer beter wordt in het nabootsen van menselijk schrijven, worden de detectoren slimmer in het herkennen van de trucs. Geen enkel tool kan een permanente, ijzersterke garantie beloven dat je nooit wordt gemarkeerd. Daarom komt de vraag of je er een moet gebruiken neer op een simpele vraag: wat staat er op het spel?

Wanneer ze gebruiken (en wanneer hard weglopen)

Denk bij het gebruik van deze tools in termen van risico. Sommige schrijftaken hebben een laag risico, terwijl andere een project, een cijfer of zelfs je reputatie kunnen maken of breken.

Scenario's met laag risico: Ga ervoor. Gebruik ze voor brainstormsessies, het bedenken van een paar ideeën voor social media posts of het maken van een ruw eerste concept om op gang te komen. In deze situaties zijn het fantastische tijdbesparers, en als de output wordt gemarkeerd, wat maakt het uit? Er zijn geen echte consequenties.

Scenario's met hoog risico: Blijf weg. Voor kritische zakelijke content, belangrijke SEO-artikelen, academische papers of professionele rapporten is het risico simpelweg te hoog. De potentiële schade van markering — of het nu een klap voor je zoekrangschikkingen is of een serieuze slag voor je academische integriteit — is veel kostbaarder dan de tijd die je zou besparen.

Het oordeel is vrij duidelijk: ondetecteerbare AI-tools werken het best als co-piloot, niet als autopiloot.

De enige echt betrouwbare strategie is om een mens aan het roer te houden. Gebruik AI om je workflow te versnellen, maar zorg er altijd voor dat het eindproduct is gefilterd door je eigen expertise, gevormd door je unieke stem en goedgekeurd door je kritisch oordeel.

Zo krijg je het beste van beide werelden. Je kunt profiteren van de efficiëntie van AI zonder het vertrouwen, de geloofwaardigheid en de waarde op te geven die alleen een echt mens kan bieden.

Veelgestelde vragen

De wereld van AI-humanizers induiken kan zeker wat vragen oproepen. We hebben heldere, directe antwoorden samengesteld op de meest gestelde vragen, om je te helpen met zowel de praktische als ethische kanten van het gebruik van deze tools.

Kan Turnitin gehumaniseerde AI-content detecteren?

Het korte antwoord is ja, dat kan het vaak. Hoewel een eenvoudige humanizer een simpele, gratis online checker voor de gek kan houden, is een geavanceerd systeem als Turnitin een heel ander verhaal. Het gebruikt geavanceerde taalkundige analyse die veel verder gaat dan het controleren van onhandige formuleringen.

Turnitin zoekt naar de subtiele statistische vingerafdrukken die AI-modellen achterlaten — dingen als voorspelbare zinsstructuren of een minder dan menselijke variatie in woordkeuze. Zelfs na "humanisering" kunnen deze patronen blijven bestaan. Geen enkel tool kan een 100% garantie bieden om zo'n krachtig systeem te omzeilen, dus erop vertrouwen voor een academische paper is een serieuze gok.

Is het gebruik van AI-humanizers ethisch?

Dit is een goede vraag, en het antwoord komt neer op één ding: de intentie. Ben je eerlijk over hoe je de tool gebruikt?

Een humanizer gebruiken om je eigen ruwe concept op te poetsen, een onhandige zin te ontwarren of door een writer's block te komen is prima. Zie het als een supercharged grammaticacontrole of thesaurus. Het is een ethische manier om je te helpen je eigen ideeën duidelijker uit te drukken.

Je overschrijdt de grens wanneer je het gebruikt om volledig door AI gegenereerd werk als je eigen werk te presenteren, vooral in een school- of werkomgeving. Dat is een verkeerde voorstelling van waar het werk vandaan komt en schendt vrijwel zeker het beleid voor academische integriteit of de contentrichtlijnen van je bedrijf.

Wat zijn de beste alternatieven?

In plaats van te zoeken naar een magische knop om detectie te omzeilen, is de meest effectieve strategie om een echt persoon terug te brengen in het proces. Deze "mens-in-het-proces"-aanpak is je beste kans op echte, kwalitatieve content.

Zo ziet dat er in de praktijk uit:

- Handmatig herschrijven: Behandel de AI-output als een rommig eerste concept. Ga er dan doorheen en herschrijf het volledig in je eigen stem en stijl.

- Breng persoonlijke inzichten in: Voeg je eigen verhalen, unieke voorbeelden uit je ervaring of originele data toe. Dit is iets wat AI simpelweg niet kan verzinnen.

- Focus op de flow: Breek zinnen handmatig op. Combineer korte, krachtige zinnen met langere, meer beschrijvende om een natuurlijk ritme te creëren dat geautomatiseerde tools moeilijk kunnen repliceren.

Deze methoden verlagen niet alleen je detectierisico — ze leiden tot veel beter, waardevoller schrijfwerk.

Benieuwd hoe een eersteklas AI-humanizer je schrijfproces ethisch kan versnellen? Probeer Humantext.pro om je concepten om te zetten in natuurlijke, boeiende tekst die je unieke stem behoudt en detectoren passeert met tot 99% succes. Begin gratis.

Klaar om je AI-gegenereerde content om te zetten in natuurlijk, menselijk geschreven tekst? Humantext.pro verfijnt je tekst direct en zorgt ervoor dat deze natuurlijk leest terwijl AI-detectoren worden omzeild. Probeer onze gratis AI-humanizer vandaag →

Gerelateerde Artikelen

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.