Uw complete gids om AI-content ondetecteerbaar te maken

Leer hoe u AI-gegenereerde content verantwoord maakt met transparantie en detectorvriendelijke methoden. Ontdek richtlijnen voor betrouwbare AI-resultaten.

Om AI-gegenereerde content echt ondetecteerbaar te maken, moet u meer doen dan alleen een paar woorden vervangen. U moet het robotachtige DNA fundamenteel omvormen tot iets dat leest, aanvoelt en vloeit alsof het door een mens is geschreven. Dit betekent dat u uw handen vuil moet maken met een strategisch bewerkingsproces — zinnen variëren, een echte stem injecteren en woorden met intentie kiezen.

Het is een proces dat versneld kan worden met tools zoals HumanText.pro, maar het doel is altijd hetzelfde: die steriele eerste versie transformeren in content die niet alleen detectoren doorstaat, maar ook echt een connectie maakt met de lezer.

Waarom AI-content wordt gemarkeerd en wat u eraan kunt doen

Heeft u ooit tijd besteed aan het begeleiden van een AI om een concept te produceren, om het vervolgens onmiddellijk te zien markeren door een detector? Het is een frustrerend veelvoorkomende ervaring. Voor studenten die navigeren door regels voor academische integriteit of marketeers die zien hoe hun content begraven wordt door zoekmachines, kan AI-detectie aanvoelen als een groot obstakel.

De waarheid is dat zelfs de meest geavanceerde AI-modellen hun "verklikkertjes" hebben. Ze neigen naar overdreven uniforme zinslengte, voorspelbare woordenschat en een formele, bijna steriele toon die het natuurlijke ritme van menselijk schrijven mist. AI-detectoren zijn specifiek gebouwd om deze kenmerken op te sporen.

De gevolgen in de echte wereld

Als uw content wordt gemarkeerd, is dat niet alleen een technisch falen — het heeft echte, tastbare gevolgen. Een blogger kan bijvoorbeeld zien dat zijn artikelen worden bestraft door zoekmachines die een authentieke gebruikerservaring prioriteren. Een student kan lastige vragen krijgen over academische integriteit, zelfs als hij AI alleen ethisch heeft gebruikt voor brainstormen of het maken van een outline.

Dit staat er vaak op het spel:

- Beschadigde geloofwaardigheid: Niets tast het vertrouwen van een publiek sneller aan dan content die aanvoelt alsof het door een machine is uitgebraakt.

- Slechte SEO-prestaties: Google's algoritmen worden steeds slimmer in het identificeren en degraderen van content die robotachtig lijkt of alleen gemaakt is om het systeem te manipuleren.

- Academisch wangedrag: In elke onderwijsomgeving kan het inleveren van AI-gegenereerde tekst als eigen werk leiden tot serieuze academische sancties.

Humanisering: De moderne oplossing

Het antwoord is niet om AI helemaal te laten vallen, maar om de output als startpunt te behandelen. Dit is waar "humanisering" om de hoek komt kijken. Het is de kunst van het bewerken van een AI-concept om het te doordrenken met uw unieke stem, uw perspectief en uw stijl. Dit gaat niet om bedrog — het gaat om het tillen van het concept van een machine naar het kwaliteitsniveau van een mens.

Het kernidee is eenvoudig: behandel AI als een briljante maar ongepolijste assistent. Uw taak is om de hoofdredacteur te zijn, die de nuances, emoties en creatieve vonk toevoegt die technologie simpelweg niet kan repliceren.

Denk er zo over na: AI geeft u het ruwe materiaal — de basisstructuur en feiten. U, de menselijke redacteur, bent de timmerman die dat materiaal zaagt, vormt en schuurt tot een afgewerkt meubelstuk. Dit doordachte bewerkingsproces, soms versneld met gespecialiseerde tools zoals HumanText.pro, is hoe u content creëert die niet alleen ondetecteerbaar is, maar echt de moeite waard om te lezen.

Hoe AI-detectoren kunstmatig gegenereerde content herkennen

Om uw AI-ondersteunde content consequent langs detectoren te krijgen, moet u leren denken zoals zij. Het zijn geen magische dozen — het zijn geavanceerde patroonherkenninstools die gevoed zijn met een enorme hoeveelheid menselijk en AI-geschreven tekst. In de loop der tijd hebben ze geleerd de bijna onzichtbare vingerafdrukken te herkennen die AI achterlaat.

AI-modellen creëren vaak tekst die, bij gebrek aan een beter woord, te perfect is. Ze functioneren door het meest waarschijnlijke volgende woord in een reeks te voorspellen. Dit creëert zinnen die grammaticaal vlekkeloos zijn maar volledig de vonk en occasionele eigenaardigheden van menselijke expressie missen. Die statistische voorspelbaarheid is een duidelijk verklikkertje.

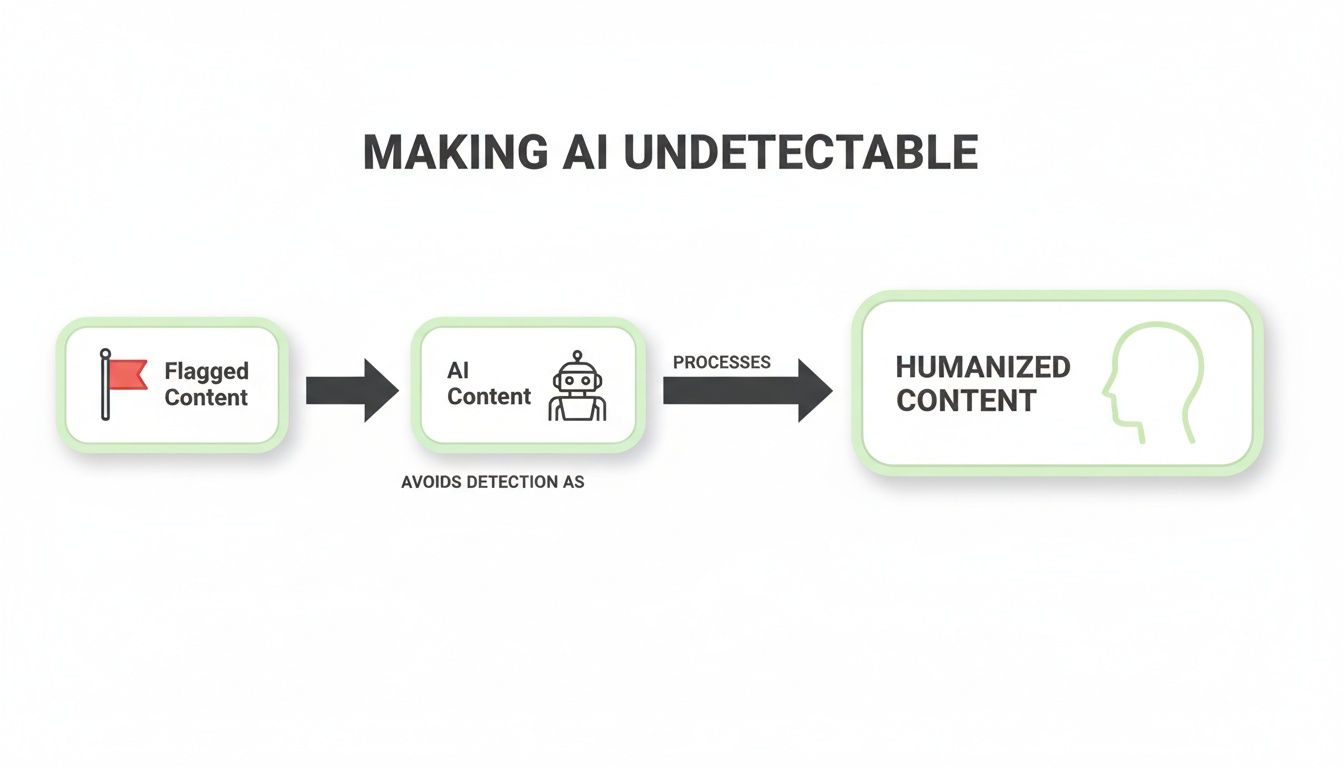

Het hele spel draait om het transformeren van die robotachtige, gemarkeerde tekst in iets dat leest alsof het door een persoon is geschreven. Dit stroomdiagram toont het basisproces:

Die middelste stap — de humanisering — is waar het echte werk gebeurt. Het is de brug die uw content van de "gemarkeerd"-stapel naar de "door mensen geschreven"-kant brengt.

Perplexiteit en burstiness: De twee verklikkende tekens

AI-detectoren leunen zwaar op twee belangrijke meetwaarden: perplexiteit en burstiness. Ze klinken wat academisch, maar de ideeën erachter zijn eigenlijk vrij eenvoudig.

- Perplexiteit is gewoon een chique manier om te meten hoe voorspelbaar tekst is. De output van een AI heeft meestal een lage perplexiteit omdat het bij gangbare woorden en eenvoudige zinsstructuren blijft. Menselijk schrijven, vol verrassingen en complexer vocabulaire, heeft een hoge perplexiteit.

- Burstiness meet het ritme en de vloeiendheid van uw zinnen. Mensen schrijven in uitbarstingen — een korte, bondige zin gevolgd door een lange, kronkelende, dan een middelmatige. AI-modellen neigen ertoe zinnen van uniforme lengte te produceren, wat een monotoon, robotachtig ritme creëert dat detectoren van kilometers afstand kunnen herkennen.

Stel het u voor als een hartslag. Een echte menselijke hartslag heeft een licht onregelmatig ritme, dat versnelt en vertraagt. Een AI schrijft als een vlekkeloze metronoom, die op een perfect gelijkmatig tempo tikt. Die onnatuurlijke consistentie is wat het elke keer laat opvallen.

Om onder de radar te vliegen, moet u deze patronen bewust doorbreken. Dat betekent uw persoonlijke stijl injecteren, zinslengte variëren en voorspelbare woorden vervangen door interessantere.

Dit is een constant kat-en-muisspel geworden. Naarmate detectoren slimmer worden, moet onze bewerking scherper worden. Branche-experts zijn het erover eens dat de enige echte langetermijnstrategie is om te focussen op kwaliteit, originaliteit en een gedegen redactionele review — niet alleen proberen de software te foppen. Goed bewerkte content met een duidelijk standpunt en natuurlijke variatie zal simpelweg veel minder snel een alarm triggeren. Als u dieper wilt duiken, is er fascinerend onderzoek naar kunstmatig schrijven en de detectie ervan.

De onderstaande tabel toont veelvoorkomende AI-schrijfkenmerken en hoe u ze kunt vervangen door meer menselijke alternatieven.

AI-schrijfpatronen vs. gehumaniseerde alternatieven

| AI-schrijfkenmerk | Waarom het wordt gemarkeerd | Gehumaniseerd alternatief |

|---|---|---|

| Uniforme zinslengte | Creëert een robotachtig, monotoon ritme. Mist natuurlijke "burstiness". | Mix korte, directe zinnen met langere, complexere zinnen om een gevarieerde cadans te creëren. |

| Voorspelbare woordkeuze | Gebruikt de statistisch meest voorkomende woorden (lage perplexiteit). Klinkt generiek en saai. | Introduceer uniek vocabulaire, idiomen en zelfs branchespecifiek jargon. Gebruik een synoniemenwoordenboek ter inspiratie. |

| Vlekkeloze grammatica & syntaxis | Tekst is vaak te perfect, zonder de kleine onvolkomenheden en stilistische keuzes van menselijk schrijven. | Gebruik samentrekkingen. Begin af en toe zinnen met "En" of "Maar". Gebruik zinsfragmenten voor effect. |

| Overdreven formele toon | Standaard een formele, academische toon, vermijdt persoonlijke voornaamwoorden en spreektaal. | Injecteer uw persoonlijkheid. Gebruik "ik", "wij" en "u". Stel retorische vragen om de lezer direct aan te spreken. |

| Generieke overgangen | Leunt op clichématige overgangen zoals "Concluderend", "Voorts" of "Bovendien". | Gebruik meer natuurlijke overgangen zoals "Maar hier is het punt", "Laten we het nu hebben over" of begin simpelweg een nieuwe alinea. |

| Gebrek aan persoonlijke ervaring | Content is puur informatief, zonder anekdotes, meningen of persoonlijke verhalen. | Weef voorbeelden uit de praktijk, persoonlijke ervaringen of sterke meningen in om authenticiteit en geloofwaardigheid toe te voegen. |

Door bewust te bewerken op deze "gehumaniseerde" kenmerken, foopt u niet alleen een detector — u verbetert fundamenteel de kwaliteit en leesbaarheid van de content.

Maak een snelle persoonlijke stijlgids

Een van de meest effectieve manieren om AI-tekst te humaniseren is het ontwikkelen van een persoonlijke stijlgids. Dit is geen enorm, formeel document. Zie het meer als een eenvoudige checklist van uw unieke schrijfeigenaardigheden waar u even naar kunt kijken voordat u begint met bewerken.

Uw gids kan dingen bevatten zoals:

- Uw voorkeurstoon: Bent u gevat en informeel? Gezaghebbend en direct? Conversationeel?

- Uw favoriete uitdrukkingen: Heeft u bepaalde overgangen of gezegden die u altijd gebruikt? (bijv. "Waar het op neerkomt is...")

- Uw cadans: Begint u alinea's graag met een korte, scherpe zin?

- Woorden die u haat: Zijn er robotachtige woorden zoals "implementeren", "faciliteren" of "optimaliseren" die u altijd vervangt?

Door een AI-concept bewust te filteren door uw persoonlijke stijl, overschrijft u de generieke patronen met uw eigen stem. Dit maakt de content authentiek van u en veel moeilijker voor welk algoritme dan ook om te markeren. Een tool als HumanText.pro is gebouwd om tekst te analyseren op precies deze patronen en u een basisscore te geven voordat u zelfs maar begint met bewerken. Die eerste controle is een enorme hulp — het vertelt u precies waar u uw energie op moet richten.

Uw handmatige bewerkingsworkflow voor authentieke content

Hier begint het echte werk. Een vlak, robotachtig AI-concept omzetten in iets dat oprecht menselijk klinkt is niet één truc — het is een gelaagd bewerkingsproces. Door u te concentreren op een paar sleutelgebieden kunt u systematisch de verklikkende tekens van AI wissen en uw eigen stem injecteren, waardoor uw content echt ondetecteerbaar wordt.

Het doel hier is eenvoudig. Ten eerste: doorbreek de monotone patronen waar AI-detectoren op getraind zijn. Ten tweede: doordrenk de tekst met de persoonlijkheid en nuances die een menselijke lezer overtuigen dat ze in goede handen zijn.

Beheers de kunst van zinsvariation

Het meest opvallende gebrek in AI-schrijven is het voorspelbare ritme. AI-modellen produceren graag zinnen van vergelijkbare lengte en structuur, wat een monotone flow creëert die gewoon "robot" schreeuwt. Uw eerste taak is om die uniformiteit te doorbreken.

Stel u uw content voor als een muziekstuk. Het heeft een beat nodig — een mix van korte, staccato noten en langere, vloeiende melodieën.

- Combineer korte, bondige zinnen om een sterk punt te maken.

- Volg op met een langere, meer gedetailleerde zin die dat idee uitpakt.

- Gebruik een middelmatig lange zin om naar de volgende gedachte over te stappen.

Deze techniek, bekend als het verbeteren van burstiness, is een van de meest effectieve manieren om AI ondetecteerbaar te maken. Het bootst de natuurlijke cadans van menselijke spraak en gedachte na — iets dat algoritmen simpelweg niet kunnen repliceren.

Voor: AI-content mist vaak gevarieerde zinsstructuur. Dit laat het robotachtig en voorspelbaar klinken voor lezers. Het is belangrijk voor schrijvers om dit te bewerken voor een betere flow.

Na: AI-content heeft een fatale fout: het ritme is vlak. Alles klinkt hetzelfde. Om dit te repareren, moet u die monotonie bewust doorbreken, korte, scherpe uitspraken mixen met langere, meer beschrijvende zinnen om een natuurlijke, boeiende flow te creëren.

De "na"-versie is dynamischer, meer conversationeel en voelt onmiddellijk menselijker aan.

Alinea's herstructureren voor een betere flow

Net zoals u uw zinnen varieert, moet u uw alinea's hervormen. AI spuugt vaak dichte, uniforme tekstblokken uit waarin elke alinea plichtgetrouw één punt behandelt voordat het doormarcheert naar het volgende.

Dit is uw kans om de leeservaring echt te sturen.

- Korte alinea's samenvoegen: Als u een paar korte alinea's heeft die nauw verwant zijn, combineer ze. Dit kan een samenhangender en krachtiger argument creëren.

- Lange alinea's splitsen: Aan de andere kant, als een AI een enorme muur van tekst heeft gecreëerd, breek deze op. Verdeel het in kleinere, beter verteerbare stukken, elk gericht op één enkel, duidelijk idee. Dit verbetert onmiddellijk de leesbaarheid.

Dit is niet alleen cosmetisch. Het verandert hoe de informatie wordt verwerkt, waardoor de logica organischer aanvoelt en minder als een machinaal gegenereerde outline. Een belangrijk onderdeel van handmatige bewerking is het verfijnen van content tot echte authenticiteit, zoals bij het maken van echt boeiende social media-bijschriften in plaats van genoegen te nemen met het eerste AI-concept.

Robotachtig vocabulaire vervangen door menselijke taal

AI-modellen hebben hun favoriete woorden, en die zijn vaak formeel, stijf en volledig overgebruikt. Woorden als "implementeren", "faciliteren", "optimaliseren" en "voorts" zijn rode vlaggen voor zowel detectoren als echte menselijke lezers.

Uw missie is om deze robotachtige woorden op te sporen en te vervangen door natuurlijke alternatieven.

| AI-favoriet woord | Menselijk klinkend alternatief |

|---|---|

| Implementeren | Invoeren, Toepassen |

| Faciliteren | Mogelijk maken, Helpen bij |

| Voorts | Daarnaast, Bovendien, Plus |

| Concluderend | Dus, wat is de bottom line? |

| Essentieel | Belangrijk, Cruciaal, Centraal |

Het gaat niet alleen om het openslaan van een synoniemenwoordenboek. Het gaat om het kiezen van woorden die passen bij uw specifieke toon. Wees niet bang om idiomen, samentrekkingen en zelfs een occasioneel zinsfragment te gebruiken. Voor effect. Dit zijn de stilistische eigenaardigheden die aangeven dat er een mens achter het toetsenbord zit.

Uw unieke stem en perspectief injecteren

Dit is de laatste, meest cruciale laag. AI kan u feiten geven, maar geen geleefde ervaring, persoonlijke meningen of een uniek perspectief. Dit is waar u de content echt van uzelf maakt.

- Persoonlijke anekdotes toevoegen: Begin een sectie met een kort, herkenbaar verhaal.

- Uw mening geven: Presenteer niet alleen informatie — reageer erop. Gebruik zinnen als "Wat ik het meest interessant vind is..." of "Eerlijk gezegd denk ik dat dit een fout is omdat..."

- Retorische vragen stellen: Spreek de lezer direct aan. "Maar wat betekent dit eigenlijk voor u?" Deze eenvoudige techniek creëert een conversationeel gevoel dat AI moeilijk kan nabootsen.

Door uw eigen gedachten en ervaringen in de tekst te weven, gaat u verder dan alleen het humaniseren van de taal. U geeft de content een ziel. Deze laatste finishing touch zorgt ervoor dat het stuk niet zomaar een verzameling algoritmisch gegenereerde zinnen is, maar een oprecht stuk communicatie dat een connectie maakt met uw publiek.

AI-humanizers gebruiken om uw workflow te versnellen

Laten we eerlijk zijn: AI-tekst met de hand bewerken is de zekerste weg naar een hoogwaardig resultaat, maar het kan een zielenvernietigende tijdverspilling zijn. Als deadlines in uw nek hijgen of u content op schaal moet produceren, is het simpelweg niet realistisch om uren te besteden aan het masseren van elk concept.

Dit is waar AI-humanizers in beeld komen. Zie ze niet als een magische "één-klik-oplossing" maar als een ongelooflijk krachtige bewerkingsassistent.

Tools zoals HumanText.pro zijn gebouwd om het zware initiële werk te doen. Ze scannen uw AI-gegenereerde concept en herschrijven onmiddellijk de kern linguïstische patronen — de voorspelbare zinsstructuren, het licht afwijkende vocabulaire, de robotachtige cadans — waar detectoren op getraind zijn. Deze eerste doorgang kan u een enorme hoeveelheid tijd en mentale energie besparen.

In plaats van elke zin zelf nauwgezet te herformuleren, laat u de tool de meest vervelende, mechanische delen afhandelen. Dat maakt u vrij om te focussen op wat er echt toe doet: uw unieke inzichten, persoonlijke verhalen en expertperspectief toevoegen.

De hybride workflow: Een praktische aanpak

De slimste manier om AI-content ondetecteerbaar te maken is geen strijd tussen handmatige bewerking en AI-humanizers. Het gaat om het combineren van hun sterke punten in een hybride workflow die u zowel snelheid als kwaliteit geeft.

De hele aanpak laat zich opdelen in een eenvoudig, herhaalbaar proces:

- Genereer uw eerste concept: Gebruik uw favoriete AI-model (zoals ChatGPT, Claude of Gemini) om de eerste content te creëren. Geef het een solide prompt om een goed gestructureerd startpunt te krijgen.

- Laat het door een humanizer lopen: Kopieer die ruwe AI-output en plak het direct in een tool zoals HumanText.pro. Deze stap maakt het robotachtige gevoel onmiddellijk gladder en diversifieert de woordkeuze.

- Doe een laatste handmatige polish: Met de meest voor de hand liggende AI-kenmerken al verdwenen, gaat uw finale review veel sneller. Dit is waar u uw persoonlijke stem injecteert, de feiten dubbel checkt en ervoor zorgt dat de content perfect aansluit bij uw merk.

Deze hybride methode transformeert het humaniseringsproces van een ontmoedigende herschrijving naar een snelle finishing touch.

Door de meest mechanische delen van het bewerken te automatiseren, spaart u uw creatieve energie voor de high-impact touches die alleen een mens kan leveren. Het draait allemaal om slimmer werken, niet harder.

De vraag naar deze tools is geëxplodeerd, vooral sinds platforms zoals Turnitin geavanceerde AI-detectie hebben uitgerold. Het goede nieuws? Onderzoek toont aan dat deze humaniseringstools opmerkelijk effectief zijn en detectoren 95% van de tijd succesvol passeren, met een gemiddelde detectiescore van slechts 18,3%.

Het verschil in actie zien

De impact van een goede AI-humanizer is vaak onmiddellijk en dramatisch. Het kan een tekst die direct gemarkeerd zou worden transformeren in iets dat volledig door mensen geschreven leest. Dit gaat niet alleen om het vervangen van een paar woorden — het gaat om het fundamenteel veranderen van het onderliggende ritme en de structuur van de tekst.

Bijvoorbeeld, een ruw AI-concept kan een score van meer dan 90% AI-gedetecteerd krijgen op een tool als GPTZero. Na een enkele doorgang door een krachtige humanizer kan diezelfde tekst zakken naar minder dan 10%, waardoor het functioneel onzichtbaar wordt voor detectoren. U kunt meer leren over hoe een eersteklas AI-humanizer deze resultaten bereikt in onze gedetailleerde gids.

Dit soort transformatie is cruciaal voor iedereen die content produceert voor SEO, marketing of professionele communicatie. Voor een breder beeld van hoe AI het spel verandert, belicht deze gids over AI social media content creatie verschillende workflows waarin humanisering een onmisbare stap wordt.

Uiteindelijk geeft een kwalitatieve humanizer u een enorme voorsprong, waardoor u authentieke, hoogwaardige content sneller dan ooit kunt produceren.

Hoe u zeker weet dat uw content de test doorstaat

U heeft dus het werk verzet. U heeft dat steriele AI-concept genomen, opengesneden, uw eigen smaak toegevoegd en het gepolijst tot het glanst. Het voelt menselijk. Maar hoe weet u het?

Gokken is geen strategie. Om er zeker van te zijn dat uw content langs geavanceerde AI-detectoren kan glippen, heeft u een bewust, herhaalbaar testproces nodig. Dit is uw kwaliteitsborgingsstap, die u van hopen dat uw content slaagt naar weten brengt.

Uw tekst door hetzelfde soort digitale poortwachters laten lopen die het zouden kunnen markeren is de enige manier om zeker te zijn dat uw werk klaar is — of het nu een blogpost, een academisch paper of een klantdeliverable betreft.

Uw detectie-toolkit opbouwen

Hier is een harde waarheid: niet alle AI-detectoren zijn gelijk gebouwd. Sommige zijn hypergevoelig voor robotachtige zinsstructuren, terwijl andere struikelen over voorspelbare woordkeuzes. Vertrouwen op één enkele checker is als een second opinion vragen aan dezelfde dokter — het kan een gevaarlijk vals gevoel van veiligheid creëren.

Om een echt beeld te krijgen, moet u uw werk controleren tegen een paar van de zwaargewichten.

- GPTZero: Dit is een van de grote namen, vaak gezien als een branchebenchmark. Het geeft u een algehele waarschijnlijkheidsscore maar, nog belangrijker, markeert de specifieke zinnen die het verdacht vindt.

- Copyleaks: Favoriet bij veel universiteiten en bedrijven vanwege de nauwkeurigheid. Het biedt een echt gedetailleerde breakdown, waarbij het de AI-waarschijnlijkheid alinea voor alinea analyseert.

- Writer.com: Een geweldige eerste stop. Deze gratis tool geeft een eenvoudige "door mensen gegenereerde content"-score die perfect is voor een snelle eerste indruk voordat u zich in een meer gedetailleerde analyse stort.

Het doel is niet alleen een groene "geslaagd"-score. Het echte goud zit in de gemarkeerde zinnen. Die gemarkeerde secties zijn uw routekaart, die u direct naar de plekken leiden die één laatste, chirurgische bewerking nodig hebben.

Wanneer uw content alle drie doorstaat, kunt u er vrij zeker van zijn dat het overall ondetecteerbaar is. Het hele debat over of ondetecteerbare AI echt werkt komt vaak neer op dit meerlaagse verificatieproces.

De test-en-verfijn-cyclus

De meest effectieve manier om AI ondetecteerbaar te maken is om testen niet te zien als een eenmalige gebeurtenis. Het is geen finish — het is een feedbackloop. U test, analyseert, bewerkt en herhaalt. Deze cyclus transformeert het proces van willekeurig giswerk in een methodische jacht op overgebleven AI-patronen.

Zo ziet dat er in de praktijk uit:

- Voer uw eerste scan uit: Neem uw gepolijste concept en plak het in uw hoofdtool (GPTZero is een goed startpunt). Raak niet in paniek als het niet meteen 100% menselijk scoort. Bijna niets doet dat.

- Zoek de hotspots: Kijk nu goed naar de resultaten. De detector zal vrijwel zeker een paar specifieke zinnen of zinsdelen markeren die het alarm activeerden. Dit zijn uw "hotspots".

- Maak gerichte bewerkingen: Ga terug naar uw document en concentreer u alleen op die gemarkeerde secties. Herschrijf niet alles. Pas alleen de probleemplekken aan. Herformuleer een zin, splits een lange in tweeën of voeg hem samen met de voorgaande. Uw enige taak is het patroon te breken dat de detector heeft gevangen.

- Opnieuw: Plak de nieuw bewerkte versie terug in de detector. U zou een veel betere score moeten zien. Als er nog een paar plekken gemarkeerd zijn, geef ze nog een snelle polish en test opnieuw.

Herhaal deze cyclus tot u consistent een hoge "menselijke" score haalt bij meerdere checkers. Deze eenvoudige loop neemt alle onzekerheid weg. Het geeft u harde data om uw finale bewerkingen te sturen en het vertrouwen dat uw content authentiek, gepolijst en echt klaar is.

De ethiek van het humaniseren van AI-content

Laten we een eerlijk gesprek voeren over het verantwoord gebruiken van deze technologie. Weten hoe u AI ondetecteerbaar maakt is niet alleen een technische vaardigheid — het komt met serieuze ethische vangrails. Het doel moet altijd zijn om AI-ondersteunde concepten te tillen naar menselijke kwaliteitsstandaarden — niet om mensen te misleiden of te frauderen in academische settings.

De grens tussen slim gebruik en misbruik is eigenlijk vrij duidelijk. Een gehumaniseerd essay inleveren voor een vak waar origineel denken de kern is? Dat is academische oneerlijkheid, simpel en duidelijk. Maar dezelfde technieken gebruiken in een professionele context is vaak een slimme, efficiënte strategie.

Gepaste toepassingen

Waar past dit in een professionele workflow? Hier zijn een paar veelvoorkomende scenario's:

- AI-bias overwinnen: Taalmodellen zijn niet perfect. Ze kunnen tekst produceren die bevooroordeeld of cultureel ongevoelig is. Het humaniseren van de content is essentieel om deze zeer reële gebreken te verhelpen.

- Fout-positieven vermijden: AI-detectoren kunnen onbetrouwbaar zijn. We hebben gezien dat ervaren schrijvers hun eigen, 100% door mensen geschreven werk gemarkeerd kregen. Tekst polijsten met deze methoden helpt ervoor te zorgen dat authentiek schrijven niet per ongeluk wordt bestraft.

- Marketingcontent opschalen: Voor bedrijven maakt het humaniseren van AI-concepten de efficiënte creatie mogelijk van hoogwaardige blogposts, e-mails en social media-updates die nog steeds een authentieke merkstem dragen.

Het kernprincipe komt neer op transparantie en intentie. Verfijnt u de output van een tool om betere, authentiekere content voor uw publiek te creëren? Of probeert u het werk van een machine als uw eigen originele gedachtegoed te presenteren waar dat verboden is?

Dit onderscheid is cruciaal. Het is het verschil tussen het correct gebruiken van een krachtig hulpmiddel en het bouwen van een kaartenhuis. Voor een diepere blik verkent onze gids over hoe u AI-content ondetecteerbaar maakt deze grenzen in detail.

Uiteindelijk ligt de verantwoordelijkheid bij u, de gebruiker, om deze methoden ethisch toe te passen. Zie AI als een krachtige assistent — niet als vervanging voor oprechte inspanning en integriteit.

Uw vragen beantwoord: AI-content laten werken

Als u deze technieken begint te gebruiken, duiken er altijd een paar praktische vragen op. Laten we de grote aanpakken zodat u met vertrouwen verder kunt.

Kan gehumaniseerde content nog steeds worden gemarkeerd?

Het eerlijke antwoord? Ja, het is mogelijk. Hoewel een krachtige tool als HumanText.pro een 99% slagingspercentage haalt, evolueert de technologie aan beide kanten voortdurend. Geen enkele oplossing is een wondermiddel dat voor altijd tegen elke toekomstige detector werkt.

Zie het als een tweestapsverificatie voor uw content. Gebruik een AI-humanizer voor het zware werk — het repareren van de robotachtige zinsstructuren en voorspelbare woordkeuze. Dan komt u voor de laatste, persoonlijke doorgang. Deze hybride aanpak is uw beste verdediging tegen zelfs de meest geavanceerde controles.

Is dit ethisch voor schoolwerk?

In bijna elk geval: nee. AI-gegenereerde of zelfs gehumaniseerde tekst inleveren als uw eigen werk voor een academische opdracht is een snelle weg naar het schenden van regels voor academische integriteit. Deze tools zijn ontworpen voor professioneel werk — marketingcontent, SEO-artikelen of zakelijke e-mails — niet voor het nabootsen van origineel denken in een klaslokaal.

Controleer altijd het specifieke AI-beleid van uw school. Het doel is om uw werk beter te maken, niet om het werk van een machine als uw eigen te presenteren.

Wat is belangrijker: zinsstructuur of woordkeuze?

Dit is een geweldige vraag. Hoewel beide belangrijk zijn, geeft zinsstructuur u meestal meer waar voor uw geld bij het passeren van detectoren.

AI-modellen hebben een verklikkertje: ze schrijven met een zeer stabiel, monotoon ritme. Onderzoekers noemen dit lage "burstiness". Door simpelweg korte, bondige zinnen te mixen met langere, meer beschrijvende, breekt u die voorspelbare cadans. Het is het grootste enkele alarmsignaal voor AI-detectoren, dus het doorbreken ervan maakt een enorm verschil. Woordkeuze corrigeren is belangrijk voor stijl, maar het doorbreken van het robotachtige ritme is waar u moet beginnen.

Klaar om uw AI-concepten te transformeren in content die oprecht menselijk klinkt? HumanText.pro gebruikt geavanceerde linguïstische modellering om uw tekst te herschrijven en u te helpen AI-detectoren in seconden te passeren. Probeer het nu en zie het verschil zelf.

Klaar om je AI-gegenereerde content om te zetten in natuurlijk, menselijk geschreven tekst? Humantext.pro verfijnt je tekst direct en zorgt ervoor dat deze natuurlijk leest terwijl AI-detectoren worden omzeild. Probeer onze gratis AI-humanizer vandaag →

Gerelateerde Artikelen

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.