Hoe maak je ChatGPT ondetecteerbaar (en waarom je dat zou moeten doen)

Leer hoe je AI-gegenereerde tekst duidelijk labelt en verantwoord ChatGPT-gebruik bevordert met praktische tips en best practices.

Het maken van je ChatGPT-output ondetecteerbaar gaat over meer dan een simpel zoeken-en-vervangen. Het gaat erom de tekst te herschrijven om het ritme te variëren en de subtiele eigenaardigheden te introduceren die kenmerkend zijn voor menselijk schrijven. Dit proces, vaak humaniseren genoemd, draait allemaal om het doorbreken van de voorspelbare patronen waar AI-detectoren op zijn getraind om te vinden. Het gaat minder om het proberen een systeem te misleiden en meer om een concept op te poetsen totdat het vloeit met echte creativiteit.

De realiteit van AI-inhoudsdetectie

Heb je ooit een perfect goede alinea als AI-gegenereerd laten markeren? Het is geen magie – het is gewoon patroonherkenning. AI-detectoren zoals Turnitin of GPTZero zijn digitale speurders, getraind om de statistische vingerafdrukken te herkennen die achterblijven door grote taalmodellen (LLM's). Met de opkomst van automatische contentcreatie met AI, is dit kat-en-muisspel ongelooflijk relevant geworden voor marketeers, studenten en schrijvers.

Deze tools "lezen" niet naar betekenis zoals een persoon dat doet. In plaats daarvan analyseren ze statistische eigenschappen in de tekst. Zie het als een forensisch expert die naar een handtekening kijkt. Hij leest de naam niet; hij analyseert de druk, de helling en de lussen die het uniek maken.

De verraadlijke tekens waar AI-detectoren naar zoeken

AI-detectoren zijn op jacht naar specifieke taalkundige kenmerken die gebruikelijk zijn in machinaal gegenereerde tekst. De twee grootste waarschuwingssignalen zijn perplexiteit en burstiness.

- Lage perplexiteit: Dit klinkt technisch, maar het gaat echt om voorspelbaarheid. AI-modellen zijn ontworpen om het statistisch meest waarschijnlijke volgende woord te kiezen, wat leidt tot vloeiende, logische, maar vaak ongeïnspireerde zinnen. Menselijk schrijven is gewoon rommelig en veel minder voorspelbaar. Bijvoorbeeld, een AI zou kunnen schrijven: "De economische voorspelling duidt op een periode van aanhoudende groei." Een mens zou kunnen schrijven: "Eerlijk gezegd, de economie lijkt eindelijk zijn zaakjes op orde te krijgen." De tweede zin is veel minder voorspelbaar.

- Lage burstiness: Mensen schrijven met horten en stoten. We mixen van nature korte, bondige zinnen met langere, complexere. Standaard neigt AI ertoe zinnen van een meer uniforme lengte te produceren, wat een robotachtig ritme creëert dat detectoren gemakkelijk kunnen herkennen. Een AI zou drie zinnen kunnen produceren die allemaal rond de 15 woorden lang zijn. Een mens zou een zin van 25 woorden kunnen schrijven, gevolgd door een zin van 4 woorden en dan een zin van 18 woorden.

Het kernprobleem is dat AI-gegenereerde tekst vaak te perfect is. Het mist de lichte onhandigheid, de af en toe vreemde woordkeuze en de gevarieerde cadans die authentieke menselijke expressie definieert. Jouw taak is om die natuurlijke onvolmaaktheid opnieuw te introduceren.

Waarom detectoren niet onfeilbaar zijn

Het is cruciaal om te onthouden dat deze detectietools verre van onfeilbaar zijn. Hun nauwkeurigheid kan verrassend wankel zijn, wat leidt tot een frustrerend aantal "vals positieven" waarbij menselijk schrijven wordt gemarkeerd.

Onafhankelijke tests tonen aan dat Turnitin het in bijna de helft van de gevallen bij die lastige grensgevallen fout heeft. Nog erger, het mist maar liefst 31% van de duidelijk door ChatGPT gegenereerde content, vooral bij nieuwere modellen zoals GPT-4 die beter zijn geworden in het nabootsen van menselijke eigenaardigheden.

Deze onbetrouwbaarheid is waarom het simpelweg aanpassen van een paar woorden vaak niet genoeg is. Je hebt een fundamentelere herschrijving nodig om de statistische handtekening van de tekst echt te veranderen. Als je op zoek bent naar praktische manieren om te beginnen, is onze gids over hoe ZeroGPT-detectie te omzeilen een geweldige plek om te starten. Dit legt de basis voor een workflow die prioriteit geeft aan echte verbetering boven oppervlakkige veranderingen.

Handmatige bewerkingen die je AI-content humaniseren

Terwijl AI een fantastisch startpunt is, is de ruwe output precies wat door detectoren wordt gemarkeerd. Het geheim om je content ondetecteerbaar te maken is geen complexe technische hack; het gaat erom je mouwen op te stropen en de tekst een echte menselijke touch te geven.

Dit hands-on proces pakt direct de kernproblemen aan van voorspelbaarheid en uniformiteit waar AI-detectoren op zijn ontworpen om te herkennen. Zie jezelf als een beeldhouwer. ChatGPT geeft je een solide blok marmer – de belangrijkste ideeën en informatie zijn er. Jouw taak is om de robotachtige randen weg te bikken en de fijne details erin te snijden die het tot leven brengen.

Varieer de zinstructuur voor betere burstiness

Een van de grootste AI-verraadlijke tekens is een monotoon, zangerig ritme. AI-modellen produceren vaak zinnen van vergelijkbare lengte en structuur, wat een vlakke, voorspelbare flow creëert. Experts noemen dit gebrek aan variatie lage burstiness.

Mensen daarentegen schrijven met een natuurlijke cadans. We gebruiken korte, bondige zinnen voor impact. Dan volgen we ze met langere, meer beschrijvende om dingen uit te leggen. Deze natuurlijke mix is het hart van burstiness.

Hier is een snel voorbeeld:

- AI-gegenereerde tekst: "Het systeem gebruikt geavanceerde algoritmen om gegevens efficiënt te verwerken. Het biedt gebruikers nauwkeurige inzichten voor betere besluitvorming. Het platform is ontworpen om gebruiksvriendelijk en zeer toegankelijk te zijn."

- Gehumaniseerde versie: "Het systeem gebruikt geavanceerde algoritmen om gegevens te verwerken. Maar wat betekent dat eigenlijk voor jou? Nauwkeurige inzichten. Betere beslissingen. Het is een krachtig platform dat ook ongelooflijk gemakkelijk te gebruiken is."

Zie je het verschil? De gehumaniseerde versie doorbreekt de uniforme structuur met een vraag, een kort fragment en gevarieerde zinlengtes. Het creëert een veel boeiender ritme en is een van de meest effectieve manieren om de patronen te verstoren waar AI-detectoren naar zoeken.

Spoor op en vervang veelvoorkomend AI-vocabulaire

Bepalde woorden zijn duidelijke verraadlijke tekens van AI-gegenereerde content. Modellen zoals ChatGPT neigen naar een specifieke set formele, licht overgebruikte termen. Woorden zoals "delve" (verdiepen), "leverage" (benutten), "unleash" (ontketenen) en "harness" (aanwenden) komen zo vaak voor dat ze praktisch AI schreeuwen.

Jouw missie is om een woorddetective te worden. Kam door de tekst, vind deze AI-favorieten en ruil ze in voor natuurlijkere, meer conversationele alternatieven. Dit helpt je niet alleen om ChatGPT ondetecteerbaar te maken, maar maakt je schrijven ook authentieker.

Uitvoerbare tip: Maak een "verboden woorden"-lijst. Elke keer dat je een woord betrapt dat te robotachtig aanvoelt (zoals "robuust", "naadloos" of "tapijt"), voeg het toe aan je lijst. Voordat je een tekst afrondt, doe een snelle zoekopdracht (Ctrl+F) naar deze woorden en daag jezelf uit om elk exemplaar te vervangen.

Handmatige bewerkingstechnieken en hun impact op AI-detectie

Deze tabel vat enkele belangrijke handmatige strategieën samen, welke taalkundige metriek ze beïnvloeden en een realistische schatting van de benodigde tijd voor een stuk van 1000 woorden.

| Techniek | Wat het verbetert | Tijdsinvestering (per 1000 woorden) |

|---|---|---|

| Variëren van zinlengte | Burstiness | 15-20 minuten |

| Vervangen van AI-vocabulaire | Voorspelbaarheid woordkeuze | 10-15 minuten |

| Toevoegen van anekdotes/verhalen | Perplexiteit & authenticiteit | 20-30 minuten |

| Gebruik van idiomen/beeldende taal | Natuurlijke taalpatronen | 10-15 minuten |

| Vereenvoudigen van complexe structuren | Leesbaarheid & perplexiteit | 15-20 minuten |

Zoals je kunt zien, kan een gefocuste bewerkingssessie van ongeveer een uur het taalkundige DNA van een AI-gegenereerd artikel dramatisch veranderen, waardoor het veel waarschijnlijker wordt dat het als door mensen geschreven wordt beschouwd.

Injecteer je persoonlijke stem en toon

Tot slot is het krachtigste gereedschap in je arsenaal je eigen unieke stem. AI heeft geen persoonlijke ervaringen, meningen of emoties. Het kan een toon nabootsen, maar kan geen echte persoonlijkheid repliceren.

Hier zijn een paar manieren om je stem te injecteren:

- Voeg persoonlijke anekdotes toe: Deel een kort, relevant persoonlijk verhaal. In plaats van te zeggen: "Veel gebruikers vinden deze functie nuttig", probeer: "Ik herinner me dat ik wekenlang met dit exacte probleem worstelde, en deze functie was een totale gamechanger."

- Stel retorische vragen: Betrek de lezer direct. "Maar hoe werkt dit eigenlijk in een real-world scenario?" Dit doorbreekt de monotonie en bootst een natuurlijk gesprek na.

- Gebruik idiomen (gepast): Afhankelijk van je publiek kunnen veelvoorkomende idiomen tekst onmiddellijk menselijker laten aanvoelen. Een zin als "het is een compleet nieuw balspel" voelt veel natuurlijker aan dan "het vertegenwoordigt een significante paradigmaverschuiving."

Door deze handmatige bewerkingen actief toe te passen, herstructureer je fundamenteel het DNA van de tekst. Het wordt minder voorspelbaar en veel authentieker. Voor een diepere duik in dit bewerkingsproces, bekijk onze gids over het omzetten van AI-gegenereerde tekst naar mensachtige content voor meer geavanceerde voorbeelden.

Het creëren van prompts voor natuurlijkere outputs

Hoewel je altijd wat handmatige bewerking zult moeten doen, kun je die tijd aanzienlijk verminderen door een betere eerste versie van de AI te krijgen. Waarom een uur worstelen met een generieke, robotachtige output wanneer een slimmere prompt je van meet af aan iets 90% kant-en-klaar had kunnen geven?

Dit draait allemaal om het begeleiden van ChatGPT om minder als een machine en meer als een specifiek type menselijke schrijver te denken.

De standaard ChatGPT-stem is gemakkelijk te herkennen. Het is vaak een beetje te formeel, een beetje langdradig en bijna pijnlijk behulpzaam – precies de combinatie waar AI-detectoren op zijn getraind om te herkennen. Door meer verfijnde prompts te maken, vertel je het model een persona aan te nemen, een schrijfstijl na te bootsen en specifieke regels te volgen. Dit is je eerste en krachtigste zet om ChatGPT ondetecteerbaar te maken.

Gebruik van rollenspel-prompts om persoonlijkheid toe te voegen

Een van de snelste manieren om menselijker klinkende tekst te krijgen, is om de AI een baan te geven. Vraag niet alleen om informatie; vertel het wie het moet zijn. Dit wordt rollenspel genoemd en dwingt het model om de stem, toon en zelfs de subtiele vooroordelen van een specifiek personage aan te nemen.

Deze simpele verschuiving trekt de output weg van de generieke "behulpzame assistent"-persona en in iets veel meer gespecialiseerd en authentiek.

Generieke prompt:

"Schrijf een alinea over de uitdagingen van werken op afstand."

Rollenspel-prompt:

"Gedraag je als een cynische senior projectmanager die de afgelopen twee jaar gedwongen werd een remote team te managen. Schrijf een korte, licht blasé alinea over de uitdagingen van werken op afstand, met focus op communicatieproblemen en de mythe van verhoogde productiviteit. Gebruik een wereldmoe maar professionele toon."

De tweede prompt zal een dramatisch ander resultaat genereren – een gevuld met een duidelijk standpunt dat veel moeilijker is voor elke detector om te markeren.

Toepassen van beperkingen om AI-gewoonten te vermijden

Laten we eerlijk zijn, AI-modellen hebben eigenaardigheden. Ze hebben voorspelbare gewoonten, zoals een overmatige afhankelijkheid van passieve stem, een voorliefde voor overgangszinnen zoals "concluderend" en een neiging om perfect uitgebalanceerde, symmetrische alinea's te creëren.

Je kunt deze gewoonten doorbreken door duidelijke regels of beperkingen in je prompt in te stellen.

Zie het als het opzetten van vangrails. Deze beperkingen dwingen de AI om zinnen op minder voorspelbare manieren te construeren, wat een sleutelfactor is in het verhogen van de natuurlijke complexiteit en "burstiness" van de tekst.

Hier zijn een paar praktische beperkingen die je onmiddellijk kunt gebruiken:

- "Vermijd passieve stem volledig." Deze ene simpele regel dwingt actievere, directere zinnen af.

- "Gebruik minstens twee retorische vragen." Dit maakt de tekst onmiddellijk conversationeler.

- "Houd de gemiddelde zinlengte onder 20 woorden." Dit voorkomt de lange, warrige zinnen die vaak "AI" schreeuwen.

- "Verwerk één korte, herkenbare anekdote." Dit voegt een persoonlijke touch toe die AI fundamenteel mist.

Bijvoorbeeld, gewoon "Schrijf dit in een conversationele toon, vermijd passieve stem en voeg een korte, herkenbare metafoor toe" eraan toevoegen, kan een droge, saaie uitleg volledig transformeren in iets dat klinkt alsof een echte persoon het schreef.

Door specifieke stilistische en structurele regels in te stellen, bewerk je de content in wezen vooraf voordat deze zelfs maar is geschreven. Deze proactieve stap bespaart immense tijd en bestrijdt direct de kernpatronen waar AI-detectoren op zijn geprogrammeerd om te identificeren.

Beter worden in prompt engineering is een must als je natuurlijke outputs wilt die detectie omzeilen. Voor enkele geweldige, concrete voorbeelden, bekijk deze 10 uitvoerbare ChatGPT-prompts voor SEO. Hoewel ze zijn ingekaderd voor zoekmachineoptimalisatie, gelden de kernprincipes van het maken van gedetailleerde, effectieve prompts overal. Wanneer je leert de AI preciezer te begeleiden, is je eerste versie al veel dichter bij de hoogwaardige, ondetecteerbare content die je nodig hebt, waardoor je definitieve humaniserende bewerkingen sneller en effectiever worden.

Slimme manier van gebruik van AI-humanizers

Handmatige bewerkingen en slimme prompts zijn geweldig, maar laten we eerlijk zijn – ze kosten veel tijd. Wanneer je tegen een deadline aan kijkt of een berg content te verwerken hebt, heb je een ander gereedschap in je riem nodig. Dit is waar een goede AI-humanizer een onmisbaar onderdeel van je workflow wordt.

Deze gespecialiseerde platforms zijn gebouwd om één ding te doen en dat uitzonderlijk goed te doen: robotachtige AI-tekst nemen en herschrijven zodat het klinkt alsof een mens het schreef. Dit is niet slechts een simpele synoniemvervanger. Tools zoals HumanText.pro gebruiken hun eigen geavanceerde taalkundige modellen om de structuur, woordkeuze en het ritme van AI-gegenereerde content te analyseren. Vervolgens herbouwen ze het vanaf de grond, waarbij je kernboodschap intact blijft terwijl de natuurlijke complexiteit en variatie wordt toegevoegd waar detectoren (en lezers) naar zoeken.

Het resultaat is een workflow die je het beste van beide werelden geeft. Je krijgt de ruwe snelheid en ideegeneratie van een LLM zoals ChatGPT, gevolgd door de laatste polijsting van een mensachtige herschrijving – allemaal binnen enkele seconden.

Hoe AI-humanizers detectie slim af zijn

AI-humanizers werken door zich te richten op de exacte statistische patronen waar detectoren op zijn getraind om te markeren. Ze zijn specifiek ontworpen om de "perplexiteit" en "burstiness" van een tekst te verhogen, waarmee ze effectief de digitale vingerafdrukken verwisselen die achterblijven door modellen zoals GPT-4.

Dit proces omvat verschillende lagen van transformatie:

- Structurele herformulering: In plaats van alleen woorden te verwisselen, herstructureert een humanizer zinnen en alinea's volledig. Dit creëert een natuurlijkere, minder voorspelbare flow die menselijk schrijven nabootst.

- Vocabulaireverrijking: Het vervangt intelligent veelvoorkomende, luie AI-zinnen door meer genuanceerde en contextueel passende taal.

- Idiomatische aanpassingen: De beste humanizers kunnen zelfs subtiele idiomen, culturele referenties en conversationele eigenaardigheden injecteren die de tekst echt authentiek laten aanvoelen.

Het is belangrijk om te onthouden dat AI-detectoren verre van perfect zijn. Eén experiment vond dat vijf grote detectoren AI-content slechts 58,3% van de tijd correct identificeerden. Toen diezelfde tekst door simpele grammaticacorrecties of contentverbeteraars werd gehaald, daalden de detectiepercentages dramatisch, waarbij sommige tools elke detector omzeilden. Dit bewijst dat zelfs een kleine hoeveelheid slimme nabewerking een wereld van verschil kan maken. Je kunt een uiteenzetting van deze bevindingen zien over hoe slimme verwerking detectiesystemen te slim af is.

AI-humanizers zijn gebouwd op exact dit principe, maar ze brengen het naar een veel verfijnder en gerichter niveau.

Een praktische mini-casestudy

Laten we zeggen dat je net ChatGPT hebt gebruikt om een essay van 500 woorden te genereren over de impact van klimaatverandering. De feiten zijn solide, maar je voert het door een AI-detector en krijgt een ontnuchterende 92% AI-gegenereerd-score. Het indienen daarvan zou een groot risico zijn.

In plaats van een uur te blokkeren voor een handmatige herschrijving, wend je je tot een AI-humanizer.

Hier is een blik op de HumanText.pro-interface. Je kunt gewoon je tekst plakken en onmiddellijk de AI-detectiescore zien voordat je überhaupt iets doet.

Dit simpele dashboard toont je onmiddellijk het probleem (een hoge AI-score) en plaatst de oplossing één klik verwijderd.

Na het plakken van het essay en het klikken op de "Humanize"-knop, herschrijft het platform het in minder dan 30 seconden. De nieuwe versie heeft alle dezelfde belangrijke feiten en argumenten, maar de zinnen zijn gevarieerder, de toon is minder stijf en de voorspelbare AI-zinnen zijn verdwenen. Je voert deze nieuwe versie door dezelfde detector en de score stort in naar slechts 8% AI-gegenereerd.

Het hele proces duurde minder dan een minuut. Dit is de echte kracht van een AI-humanizer: het geeft je de resultaten van een diepe, handmatige bewerking met de snelheid van automatisering. Het helpt je ChatGPT ondetecteerbaar te maken op schaal.

Belangrijkste voordelen: snelheid, effectiviteit en privacy

Wanneer op de juiste manier gebruikt, bieden AI-humanizers een enorm voordeel. Ze gaan niet alleen over het langs detectoren glippen; ze gaan over het verheffen van de uiteindelijke kwaliteit van je werk op een snelle, efficiënte en veilige manier.

Hier is wat je kunt winnen:

- Snelheid en efficiëntie: Dit is de grote. Het humaniseren van een artikel van 1.000 woorden kan in seconden worden gedaan. Een grondige handmatige bewerking? Dat kan gemakkelijk een uur of meer kosten.

- Effectiviteit: Deze tools zijn speciaal gebouwd om de nieuwste detectie-algoritmen te verslaan. Ze zijn vaak effectiever dan simpele handmatige aanpassingen bij het verlagen van hoge AI-scores.

- Privacy: Gerenommeerde diensten zoals HumanText.pro leggen een premie op gebruikersprivacy. Je content wordt verwerkt, gehumaniseerd en aan je geretourneerd zonder te worden opgeslagen of gebruikt om andere AI-modellen te trainen, waardoor je werk volledig vertrouwelijk blijft.

Als je deze technologie in je contentstrategie wilt brengen, biedt onze gedetailleerde gids over de beste beschikbare AI-humanizer-tools een diepere vergelijking om je te helpen de juiste fit te vinden. Deze aanpak laat je slimmer werken, niet alleen harder, en transformeert AI in een echte assistent van de eerste versie tot het laatste, gepolijste stuk.

Je kwaliteitsborgings-checklist voor indiening

Oké, voordat je er ook maar aan denkt om op "publiceren" of "indienen" te klikken, is het tijd voor een laatste kwaliteitscontrole. Dit gaat niet alleen over het kruisen van je T's; het is een methodisch proces om ervoor te zorgen dat je content gepolijst, authentiek en klaar is voor welke scrutinie dan ook die erop afkomt.

Ik heb het duizend keer zien gebeuren: het overhaasten van deze laatste stap is wat content die probleemloos passeert scheidt van content die wordt gemarkeerd. Deze systematische review helpt je die subtiele, bijna onzichtbare patronen te vangen die gewoon "AI" schreeuwen. Het verandert een willekeurige steekproef in een zelfverzekerde definitieve goedkeuring.

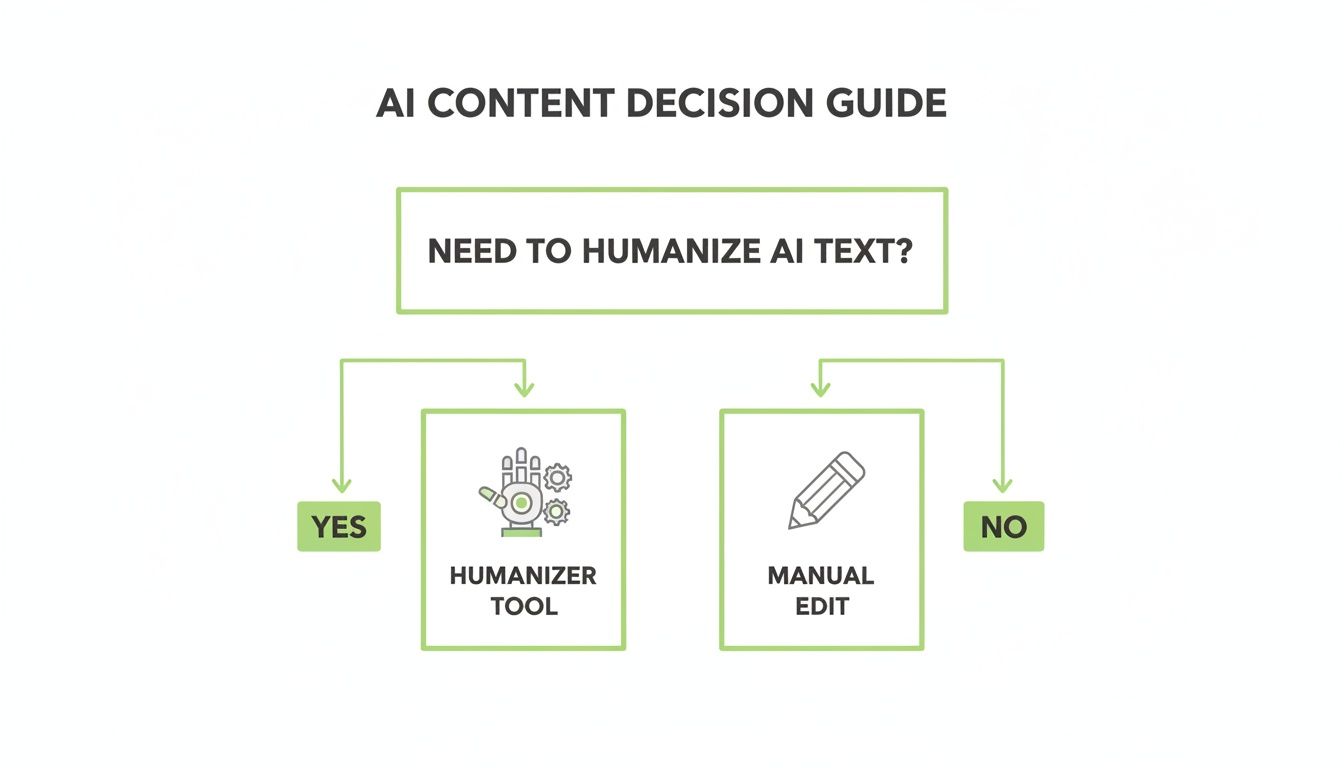

Deze snelle gids kan je helpen beslissen of een snelle doorgang met een humanizer-tool genoeg is of dat je je mouwen moet opstropen voor een diepere handmatige bewerking.

Deze beslissingsboom legt de twee belangrijkste workflows uit die je kunt volgen na het verkrijgen van die eerste AI-versie, waarbij je naar snelle efficiëntie of diepe, gepersonaliseerde verfijning wordt gestuurd, afhankelijk van wat je nodig hebt.

Kruisreferentie meerdere AI-detectoren

Hier is een beginnerfout: vertrouwen op slechts één AI-detector. Deze tools zijn berucht overal. Wat de ene met vlag en wimpel passeert, kan bij een andere een 90% AI-score krijgen. Elk gebruikt een enigszins verschillend algoritme en zoekt naar zijn eigen unieke statistische eigenaardigheden in de tekst.

Om een veel beter gevoel te krijgen van waar je eigenlijk staat, voer je definitieve versie door minstens twee of drie verschillende tools. Ik gebruik graag een mix, misschien GPTZero, Copyleaks en de checker ingebouwd in een platform zoals HumanText.pro. Deze triangulatieaanpak geeft je een veel nauwkeuriger beeld van het echte risiconiveau van je content. Als het er meerdere passeert, kun je veel gemakkelijker ademen.

Voer een definitieve handmatige review uit

Zelfs na al het prompten en humaniseren, gaat niets boven een definitieve hands-on review. Dit is je kans om de kleine onvolkomenheden te vangen die geautomatiseerde tools gewoon niet kunnen zien. Je doel hier is niet alleen om op fouten te controleren, maar om echt de flow, toon en algehele authenticiteit af te stemmen.

Hier is een praktische samenvatting van wat ik doe voor mijn definitieve doorlezing:

- Lees het hardop: Dit is de beste truc in het boek. Het onthult onmiddellijk onhandige formuleringen en klunzige zinnen. Als het niet goed klinkt wanneer je het zegt, zal het niet goed lezen, punt uit.

- Controleer op herhalende starters: Scan je alinea's snel. Begin je er te veel met "Bovendien", "Concluderend" of "De..."? Het mixen van hoe je je zinnen opent is een simpele oplossing die een enorm verschil maakt in leesbaarheid.

- Verifieer toonconsistentie: Voelt de toon consistent aan van de eerste zin tot de laatste? AI-concepten kunnen soms afdrijven van een vriendelijke, conversationele intro naar een stijve, formele conclusie. Zorg ervoor dat het klinkt alsof één persoon het hele ding schreef.

- Feitencontrole belangrijke claims: AI-modellen zijn berucht om te "hallucineren", wat een beleefde manier is om te zeggen dat ze dingen verzinnen met ongelooflijk zelfvertrouwen. Dubbelcheck altijd specifieke gegevens, namen of statistieken. Je geloofwaardigheid staat op het spel.

Om deze laatste stap nog gestructureerder te maken, heb ik een checklist samengesteld die je elke keer kunt gebruiken. Het zorgt ervoor dat je al je bases dekt voordat je je werk de wereld in stuurt.

Je kwaliteitsborgings-checklist voor indiening

| Controle | Doel | Aanbevolen tool(s) |

|---|---|---|

| Plagiaatscan | Originaliteit waarborgen en auteursrechtproblemen vermijden. | Copyscape, Grammarly |

| AI-detectiescan (Meerdere) | AI-score trianguleren voor betrouwbaardere risicobeoordeling. | GPTZero, Copyleaks, HumanText.pro |

| Hardop-lees-test | Onnatuurlijke formuleringen vangen en zinflow verbeteren. | Je eigen stem |

| Grammatica- & spellingcontrole | Polijsten voor professionaliteit en basisfouten verwijderen. | Grammarly, ProWritingAid |

| Feitencontrole | Alle gegevens, statistieken en claims verifiëren op nauwkeurigheid. | Google, brondocumenten |

| Toon- & stemconsistentie | Ervoor zorgen dat de schrijfstijl consistent is van begin tot eind. | Handmatige review |

Het doorlopen van deze checklist duurt niet lang, maar voegt een cruciale laag van polijsting en bescherming toe, bevestigend dat je content klaar is voor menselijke lezers en algoritmische checkers.

Deze definitieve, door mensen geleide kwaliteitscontrole is je laatste verdedigingslinie. Het overbrugt de kloof tussen content die alleen technisch "ondetecteerbaar" is en schrijven dat echt overtuigend, betrouwbaar en effectief is. Het zorgt ervoor dat je inspanningen om ChatGPT ondetecteerbaar te maken ook resulteren in een echt hoogwaardig eindproduct.

Laten we praten over de ethiek van "ondetecteerbare" AI

Dit hele gesprek over het ondetecteerbaar maken van AI-content komt met een enorm sterretje. Het is een krachtig idee, maar we bewegen ons hier in een serieus grijs gebied, en het is cruciaal om voorzichtig te treden. Het doel moet nooit zijn om vals te spelen bij een essay of AI's werk als je eigen werk uit te geven. Dat is een snelle route naar problemen.

In plaats daarvan, beschouw dit als een productiviteitsboost. Een AI-assistent is als een supercharged rekenmachine of een geavanceerd grammatica-tool. Het is fantastisch om een eerste versie uit te spugen, je gedachten te ontwarren of gewoon een nare writer's block te doorbreken. Het "humaniseren"-proces gaat echt over het nemen van dat ruwe materiaal en het polijsten tot iets dat je eigen expertise en stem weerspiegelt.

Dus, waar ligt de grens?

Het komt echt neer op één simpel ding: intentie.

Gebruik je AI om te brainstormen, een outline te maken of een ruwe versie te genereren die je vervolgens zwaar herschrijft, feitencheckt en doordringt met je eigen inzichten? Dat is gewoon een slimme, moderne workflow. Maar als je alleen een essay genereert, het door een tool haalt en je naam erop plakt om een cijfer te krijgen – je hebt de grens overschreden.

Het kernprincipe hier is augmentatie, geen vervanging. Gebruik AI om je sneller en beter te maken, maar laat het nooit je eigen kritisch denken, creativiteit en integriteit vervangen.

Laten we eerlijk zijn: scholen en werkgevers hebben legitieme zorgen. Deze technologie gooit volledig overhoop hoe we traditioneel kennis en inspanning hebben gemeten. Het meest verantwoorde pad vooruit is transparantie.

Als je een student bent, moet je het specifieke beleid van je school over AI kennen. Gok niet. Als je een professional bent, ligt de focus op het produceren van werk dat hoogwaardig, nauwkeurig en waardevol is. In die context is AI je copiloot, niet de piloot.

Uiteindelijk ligt de ethiek van AI in onze handen. Het is slechts een tool. En zoals elke tool, kun je het gebruiken om iets geweldigs te bouwen of om veel schade aan te richten.

Je vragen, beantwoord

De wereld van AI-gegenereerde content induiken kan aanvoelen als navigeren door een doolhof. Veel vragen komen op. Laten we de lucht klaren en enkele van de meest voorkomende vragen aanpakken die we horen over het menselijker laten klinken van AI-tekst.

Zijn AI-detectoren echt 100% nauwkeurig?

Nee, zelfs niet in de buurt. AI-detectoren zijn niet onfeilbaar. Ze zijn ontworpen om te zoeken naar statistische patronen, zoals hoe voorspelbaar de woordkeuzes zijn (perplexiteit) of hoe uniform de zinlengtes zijn (burstiness).

Dit betekent dat ze het kunnen en vaak fout hebben. We hebben veel gevallen gezien waarin volledig door mensen geschreven tekst als AI werd gemarkeerd. Vertrouwen op een enkele detector is een beginnerfout. Voer je tekst altijd door een paar verschillende tools om een meer gebalanceerd beeld te krijgen.

Is het verkeerd om AI-content ondetecteerbaar te maken?

Dit hangt af van de intentie. Gebruik je AI om over writer's block heen te komen of om snel een eerste versie uit te spugen waar je vervolgens je eigen expertise in giet? Dat is gewoon een slimme, efficiënte workflow.

Maar als je probeert ruwe AI-output als je eigen werk uit te geven voor een schoolopdracht of klantproject zonder echte waarde toe te voegen, overschrijd je een grens. Dat is niet alleen onethisch; het schendt vaak academische integriteitsbeleid of professionele gedragscodes.

Het doel moet altijd zijn om je eigen vaardigheden te augmenteren, niet te vervangen. Beschouw AI als een krachtige assistent die je helpt sneller werk van hogere kwaliteit te produceren, met je eigen expertise en stem die de leiding neemt.

Wat is de snelste manier om AI-tekst te humaniseren?

Als snelheid is wat je nodig hebt, is een toegewijde AI-humanizer je beste gok. Hoewel niets de controle van handmatige bewerking verslaat, kan een tool een heel artikel in seconden herschrijven. Het is specifiek gebouwd om de robotachtige patronen te vinden en te repareren waar AI-detectoren zich aan vastklampen.

Voor iedereen die een groot volume aan content moet verwerken, is het een essentieel onderdeel van een efficiënte workflow. Je kunt die snelheid met de hand gewoon niet matchen.

Zal het gebruik van een AI-humanizer mijn SEO schaden?

Wanneer goed gedaan, zou het je SEO eigenlijk moeten helpen. Zoekmachines worden slimmer in het belonen van content die mensen echt willen lezen.

Het transformeren van generieke, robotachtige tekst in iets boeiends en natuurlijks zorgt voor een betere gebruikerservaring. Betere leesbaarheid en meer tijd op de pagina zijn positieve signalen voor Google. Uiteindelijk creëer je content van hogere kwaliteit die authentiek aanvoelt, en dat is precies wat zoekmachines willen ranken.

Klaar om je AI-concepten te transformeren in gepolijste, ondetecteerbare content? HumanText.pro geeft je een krachtige en private manier om je tekst in seconden te humaniseren. Probeer het gratis en zie hoe gemakkelijk het is om AI-detectoren te omzeilen terwijl je de integriteit van je boodschap intact houdt.

Klaar om je AI-gegenereerde content om te zetten in natuurlijk, menselijk geschreven tekst? Humantext.pro verfijnt je tekst direct en zorgt ervoor dat deze natuurlijk leest terwijl AI-detectoren worden omzeild. Probeer onze gratis AI-humanizer vandaag →

Gerelateerde Artikelen

Between or Among: The Simple Guide to Getting It Right

Confused about 'between or among'? Our guide explains the real rule (it's not about the number!) with clear examples, tips, and common mistakes to avoid.

El Gato in English: Translation, Grammar, and Examples

Discover the meaning of el gato in English. Learn the direct translation, correct pronunciation, essential grammar rules, and see common example sentences.

Master Dangling and Misplaced Modifiers

Tired of confusing sentences? Learn to spot and fix dangling and misplaced modifiers with our clear guide, examples, checklist, and exercises.